- Разгадывая Язык Цифрового Мира: Наш Глубокий Погружение в NLP на Python

- Наши Первые Шаги: Фундаментальные Строительные Блоки NLP

- NLTK и SpaCy: Наши Верные Помощники в Предобработке

- Очистка Данных: Наша Рутина

- Представление Текста: Как Компьютер "Видит" Слова

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: Понимание Смысла Слов

- Контекстные Встраивания и Трансформеры: Революция в NLP

- Наши Любимые Задачи NLP: От Классификации до Генерации

- Классификация Текстов: Сортируем и Категоризируем

- Анализ Тональности (Sentiment Analysis): Чувства Машин

- Тематическое Моделирование: Выявление Скрытых Темы

- Извлечение Информации: NER и Ключевые Фразы

- Суммаризация Текста: Сжимаем Суть

- Машинный Перевод и Многоязычность: Преодолевая Языковые Барьеры

- Разработка Чат-ботов и QA-систем: Интеллектуальное Взаимодействие

- Продвинутые Применения и Нишевые Задачи, Которые Мы Исследуем

- Анализ Стилистики и Авторства

- Работа с Неструктурированным Текстом и Специфическими Документами

- Инструменты для Качества и Сравнения

- Работа с Большими Данными и GPU-ускорением

- Визуализация Текстовых Данных

Разгадывая Язык Цифрового Мира: Наш Глубокий Погружение в NLP на Python

Добро пожаловать, дорогие читатели, в мир, где машины начинают понимать наш человеческий язык! Мы, как опытные исследователи и блогеры, постоянно находимся в поиске новых горизонтов и делимся своими открытиями. Сегодня мы хотим увлечь вас в захватывающее путешествие по просторам Обработки Естественного Языка (NLP) с использованием такого мощного и гибкого инструмента, как Python. Это не просто набор академических терминов, это ключ к пониманию огромных объемов текстовой информации, которая окружает нас каждый день – от сообщений в социальных сетях до сложных научных статей и юридических документов.

На протяжении многих лет мы видели, как NLP эволюционировало от простых правил и статистических методов до сложных нейросетевых архитектур, способных улавливать тончайшие нюансы смысла. В этой статье мы не просто расскажем вам о концепциях; мы поделимся нашим практическим опытом, покажем, какие инструменты мы используем и как подходим к решению реальных задач. Мы хотим, чтобы вы почувствовали эту мощь и вдохновились на собственные эксперименты. Приготовьтесь, ведь мы собираемся разобрать фундаментальные основы, рассмотреть передовые методы и заглянуть в будущее этой удивительной области!

Наши Первые Шаги: Фундаментальные Строительные Блоки NLP

Прежде чем мы сможем научить компьютер "читать" и "понимать", нам необходимо подготовить текст. Этот этап, известный как предобработка, является критически важным и закладывает основу для всех последующих аналитических задач. Мы всегда начинаем с того, что превращаем необработанный поток символов в нечто более структурированное и удобное для машинной обработки. Это как разобрать огромный пазл на отдельные кусочки, прежде чем пытаться собрать его целиком.

NLTK и SpaCy: Наши Верные Помощники в Предобработке

Когда речь заходит о базовой предобработке текста, мы неизменно обращаемся к двум столпам Python-NLP: библиотекам NLTK (Natural Language Toolkit) и spaCy. Каждая из них имеет свои сильные стороны и области применения, и мы часто используем их в тандеме, извлекая лучшее из обеих.

NLTK — это своего рода "швейцарский нож" для лингвистов и исследователей. Он предоставляет огромное количество алгоритмов и корпусов для изучения основ NLP. С NLTK мы осваиваем такие понятия, как:

- Токенизация: Это процесс разделения текста на отдельные слова (токены) или предложения. Например, фраза "Привет, мир!" будет разбита на токены "Привет", ",", "мир", "!". Это кажется простым, но корректная обработка пунктуации, чисел и сокращений требует продуманных алгоритмов.

- Стемминг: Мы используем стемминг для приведения слов к их корневой форме путем отсечения суффиксов. Например, слова "бежать", "бежит", "бегущий" могут быть приведены к "беж". Это быстрый и эффективный способ уменьшить размер словаря и улучшить производительность моделей, но он не всегда возвращает реальное слово.

- Лемматизация: В отличие от стемминга, лемматизация более "интеллектуальна". Она использует морфологический анализ словаря для приведения слова к его базовой (словарной) форме, известной как лемма. Так, "бежать", "бежит", "бегущий" станут "бежать". Мы предпочитаем лемматизацию для задач, где точность и сохранение смысла слова критически важны.

- POS-теггинг (Part-of-Speech Tagging): Определение части речи каждого слова (существительное, глагол, прилагательное и т.д.). Это крайне полезно для понимания синтаксической структуры предложения.

С другой стороны, spaCy — это современная, высокопроизводительная библиотека, разработанная для работы с большими объемами текста в продакшн-средах. Если NLTK больше ориентирован на исследование и обучение, то spaCy – это наш выбор для быстрого и эффективного продакшн-NLP. Мы ценим spaCy за:

- Быстрое NER (Named Entity Recognition): Распознавание именованных сущностей – это процесс выявления и классификации имен людей, организаций, географических объектов, дат и т.д. в тексте. SpaCy делает это невероятно быстро и точно благодаря хорошо обученным моделям.

- Синтаксический парсинг: SpaCy может строить дерево зависимостей для каждого предложения, показывая отношения между словами. Это позволяет нам глубоко анализировать структуру предложений и извлекать сложные связи.

- Готовые модели: SpaCy поставляется с предварительно обученными моделями для различных языков, что значительно ускоряет начало работы.

Очистка Данных: Наша Рутина

Помимо токенизации и лемматизации, мы всегда уделяем большое внимание общей очистке данных. Необработанный текст часто содержит шум: HTML-теги, специальные символы, лишние пробелы, URL-адреса, эмодзи, сленг, опечатки. Регулярные выражения (библиотека re в Python) становятся нашими незаменимыми помощниками на этом этапе.

Мы создаем собственные пайплайны очистки, которые включают:

- Удаление HTML-тегов: Используем

Beautiful Soupдля веб-скрейпинга, а затем регулярные выражения или простые функции для удаления оставшихся тегов. - Удаление пунктуации и специальных символов: Обычно мы оставляем только буквы и цифры, если это не противоречит задаче (например, для анализа тональности пунктуация может быть важна).

- Приведение к нижнему регистру: Стандартная практика для уменьшения количества уникальных слов.

- Удаление стоп-слов: Слова вроде "и", "в", "на", которые не несут смысловой нагрузки для многих задач. NLTK предоставляет готовые списки стоп-слов, но мы часто дополняем их собственными или даже создаем контекстно-зависимые списки.

- Нормализация сленга и эмодзи: Для текстов из социальных сетей мы разрабатываем специальные словари и правила для перевода сленга и эмодзи в более "понятные" для машины формы.

- Исправление орфографии и грамматики: Для некоторых задач, особенно связанных с анализом пользовательского ввода, мы используем сторонние библиотеки или разрабатываем простые инструменты для исправления очевидных ошибок.

Наш опыт показывает, что качество предобработки напрямую влияет на качество конечных результатов. Иногда даже самые продвинутые модели бессильны перед "грязными" данными.

Представление Текста: Как Компьютер "Видит" Слова

После того как текст очищен и токенизирован, возникает следующая задача: как представить эти слова и предложения в виде, понятном для математических моделей? Компьютеры работают с числами, а не с буквами. Здесь на помощь приходят методы векторизации.

Классические Векторизаторы: CountVectorizer и TF-IDF

Наши первые шаги в векторизации часто начинаются с простых, но очень эффективных методов:

- CountVectorizer: Мы используем его для подсчета частоты появления каждого слова в документе. Это создает разреженную матрицу, где строки – это документы, а столбцы – уникальные слова, а значения – их счетчики. Это дает нам базовое представление о содержании документа.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF – это улучшенный подход. Он не просто считает слова, но и взвешивает их значимость. Мы используем его, чтобы понять, насколько важно слово для конкретного документа в рамках всего корпуса текстов. Слова, которые часто встречаются во многих документах (например, "и", "в"), получают низкий вес, а слова, уникальные для данного документа, – высокий. Это позволяет нам сосредоточиться на наиболее информативных терминах.

| Характеристика | CountVectorizer | TfidfVectorizer |

|---|---|---|

| Что измеряет | Частоту появления слова | Важность слова в документе относительно корпуса |

| Преимущества | Прост, быстр, эффективен для базовых моделей | Учитывает контекст корпуса, выделяет ключевые слова |

| Недостатки | Не учитывает важность слов, создает очень разреженные векторы | Вычислительно дороже, все еще создает разреженные векторы |

| Когда используем | Для простых классификаторов, быстрого прототипирования | Для тематического моделирования, поиска информации, классификации |

Word Embeddings: Понимание Смысла Слов

Простые счетчики частот не улавливают семантические связи между словами. Именно здесь на сцену выходят Word Embeddings – векторные представления слов, которые кодируют их смысл и отношения. Мы активно используем:

- Word2Vec и GloVe (с использованием Gensim): Эти модели обучаются на больших корпусах текста и размещают семантически близкие слова (например, "король" и "королева") близко друг к другу в многомерном векторном пространстве. Мы применяем библиотеку Gensim для обучения собственных моделей Word2Vec или загрузки предобученных моделей GloVe. Это позволяет нам улавливать синонимию, антонимию и другие смысловые связи, что значительно улучшает качество многих NLP-задач.

- FastText: В отличие от Word2Vec, FastText (также доступный через Gensim) учитывает субсловесные единицы (н-граммы символов). Это делает его особенно полезным для работы с редкими словами и языками с богатой морфологией, а также для классификации текста. Мы ценим его за способность обрабатывать слова, которые не встречались в обучающем корпусе.

- Doc2Vec: Если Word Embeddings работают со словами, то Doc2Vec (также в Gensim) позволяет нам получать векторные представления для целых документов или абзацев. Это мощный инструмент для задач, где нам нужно сравнивать документы по смыслу или классифицировать их целиком.

- Sentence Transformers: Для получения качественных векторных представлений предложений, которые учитывают контекст и порядок слов, мы используем библиотеку Sentence Transformers. Она основана на трансформерных архитектурах и позволяет получать семантически насыщенные векторы, что очень полезно для поиска схожих предложений или кластеризации текстов.

Контекстные Встраивания и Трансформеры: Революция в NLP

Последние годы принесли настоящую революцию в NLP с появлением трансформерных моделей и контекстных встраиваний. Такие модели, как BERT, GPT, Flair, изменили наше представление о том, что могут делать машины с языком.

Эти модели способны генерировать векторные представления слов, которые меняются в зависимости от контекста, в котором слово используется. Это означает, что слово "банк" будет иметь разные векторы в предложениях "Я пошел в банк" (финансовое учреждение) и "Я сидел на берегу реки, на банке" (песчаная отмель); Мы активно используем:

- Hugging Face Transformers: Это наша основная платформа для работы с самыми современными трансформерными моделями. Она предоставляет простой интерфейс для загрузки и использования предобученных моделей (BERT, GPT, RoBERTa, T5 и многих других) для широкого спектра задач: от классификации текста и NER до генерации текста и машинного перевода. Мы часто проводим тонкую настройку (fine-tuning) этих моделей на наших собственных данных, чтобы добиться максимальной производительности для конкретных задач.

- Flair: Эта библиотека предоставляет state-of-the-art модели для NER, POS-теггинга и других задач, используя глубокие контекстные встраивания. Мы особенно ценим Flair за его простоту использования и высокую точность в задачах распознавания сущностей.

Переход к контекстным встраиваниям открыл двери для решения гораздо более сложных и нюансированных задач NLP.

Наши Любимые Задачи NLP: От Классификации до Генерации

После того как текст подготовлен и представлен в числовом виде, мы можем приступить к решению конкретных задач. Здесь мы покажем, как мы подходим к самым распространенным и интересным применениям NLP.

Классификация Текстов: Сортируем и Категоризируем

Классификация текста – это одна из самых фундаментальных задач NLP, где мы присваиваем тексту одну или несколько предопределенных категорий. Мы используем её для автоматической категоризации статей, фильтрации спама, маршрутизации запросов клиентов и многого другого.

Для классификации мы применяем различные подходы:

- Scikit-learn: Это наш основной инструмент для классического машинного обучения. Мы часто используем такие алгоритмы, как SVM (метод опорных векторов), Наивный Байесовский классификатор, Логистическая регрессия. В сочетании с TF-IDF векторизацией эти методы дают отличные результаты на многих задачах.

- Глубокое обучение (PyTorch/TensorFlow): Для более сложных задач, где требуется улавливать долгосрочные зависимости в тексте, мы обращаемся к нейронным сетям. Мы строим LSTM-сети (Long Short-Term Memory) и CNN-сети (Convolutional Neural Networks) на фреймворках PyTorch или TensorFlow. Эти архитектуры способны извлекать более абстрактные и мощные признаки из текстовых данных.

- BERT для классификации: С появлением трансформерных моделей, BERT и его вариации стали нашим предпочтительным выбором для задач классификации, когда у нас достаточно данных для тонкой настройки или когда требуется максимально возможная точность. Мы используем предобученные BERT-модели из Hugging Face и добавляем простой классификационный слой сверху.

Анализ Тональности (Sentiment Analysis): Чувства Машин

Понимание эмоционального окраса текста – это невероятно ценная задача для бизнеса, маркетинга и анализа социальных медиа. Мы используем анализ тональности для оценки отзывов клиентов, мониторинга репутации бренда, анализа финансовых новостей и даже политических постов.

Наш подход к анализу тональности включает:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Для быстрого и простого анализа тональности англоязычного текста мы часто используем VADER. Он основан на словаре, учитывает интенсивность слов, использование заглавных букв и пунктуации. Это отличный инструмент для начальной оценки.

- TextBlob: Эта библиотека предоставляет простой API для анализа тональности (и других базовых NLP-задач). Хотя она не всегда самая точная, её простота делает её идеальной для быстрого прототипирования. Мы также используем TextBlob для определения языка текста.

- Модели машинного обучения: Для более точного и специфичного для домена анализа тональности мы обучаем собственные классификаторы, используя размеченные данные и методы, описанные выше (SVM, нейронные сети, BERT). Мы особенно внимательно относимся к анализу тональности в социальных сетях, где необходимо учитывать сарказм, иронию, эмодзи и сленг.

Тематическое Моделирование: Выявление Скрытых Темы

Когда у нас есть большой корпус неразмеченных текстов, и мы хотим понять, о чем они говорят, мы обращаемся к тематическому моделированию. Это позволяет нам автоматически выявлять скрытые темы или кластеры документов.

Мы активно используем библиотеку Gensim для:

- LDA (Latent Dirichlet Allocation): LDA – это один из самых популярных алгоритмов тематического моделирования. Он предполагает, что каждый документ состоит из смеси тем, а каждая тема – из смеси слов. Мы используем LDA для анализа текстов отзывов, новостных статей, блогов и форумов, чтобы понять основные дискурсы.

- LSI (Latent Semantic Indexing): LSI использует методы сингулярного разложения для выявления скрытых семантических структур в тексте. Хотя и старше LDA, он по-прежнему эффективен для некоторых задач.

Мы также проводим сравнение моделей тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящую для конкретной задачи, так как каждая из них имеет свои особенности и предположения.

Извлечение Информации: NER и Ключевые Фразы

Извлечение информации – это процесс автоматического извлечения структурированной информации из неструктурированного текста.

- Распознавание именованных сущностей (NER): Как мы уже упоминали, spaCy и Flair – наши основные инструменты для NER. Мы используем их для автоматической разметки сущностей, извлечения имен, организаций, мест, дат и других важных объектов из юридических документов, новостей или медицинских записей. Для особо сложных случаев или доменов мы можем обучать собственные CRF-модели или fine-тюнить BERT.

- Извлечение ключевых фраз: Для быстрого понимания сути документа мы используем алгоритмы извлечения ключевых фраз. RAKE (Rapid Automatic Keyword Extraction) и TextRank (реализованный, например, в библиотеке

textrankилиgensim) позволяют нам автоматически выделять наиболее важные слова и фразы из текста. Мы применяем TextRank также для суммаризации, извлекая ключевые предложения.

«Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут.»

— Рита Мэй Браун

Суммаризация Текста: Сжимаем Суть

В мире перегруженном информацией, способность быстро извлекать основную мысль из длинного текста становится критически важной. Мы различаем два основных подхода к суммаризации:

- Экстрактивная суммаризация: Мы извлекаем наиболее важные предложения из исходного текста, чтобы сформировать краткое изложение. TextRank часто используется для этой цели.

- Абстрактивная суммаризация: Это более сложная задача, при которой модель генерирует новые предложения, которые передают смысл исходного текста, но не обязательно являются его прямыми цитатами. Для этого мы используем трансформерные модели (например, T5 или BART из Hugging Face), которые предварительно обучены на больших корпусах для задач генерации текста.

Мы постоянно сравниваем эти подходы, чтобы выбрать наиболее подходящий для конкретных сценариев, таких как создание кратких обзоров новостей или суммаризация длинных отчетов.

Машинный Перевод и Многоязычность: Преодолевая Языковые Барьеры

В нашем глобализованном мире работа с многоязычными текстовыми корпусами становится нормой. Мы не ограничиваемся только английским языком;

- Polyglot и Stanza: Для языков с богатой морфологией (например, русский, арабский) и для работы с мультиязычностью мы используем библиотеки Polyglot и Stanza. Stanza, разработанная Stanford NLP Group, предоставляет высокоточные модели для токенизации, лемматизации, POS-теггинга и синтаксического анализа для многих языков, включая русский.

- Трансформеры для машинного перевода: Для создания систем машинного перевода мы используем предобученные трансформерные модели (например, MarianMT из Hugging Face). Эти модели показывают впечатляющие результаты даже для узкоспециализированных текстов, требуя лишь тонкой настройки на специфических данных.

Разработка Чат-ботов и QA-систем: Интеллектуальное Взаимодействие

Мы также погружались в создание интерактивных систем, которые могут понимать запросы пользователя и давать релевантные ответы.

- Чат-боты (Rasa framework): Для разработки чат-ботов мы часто используем фреймворк Rasa. Он позволяет нам строить контекстно-зависимые диалоговые системы, которые могут понимать намерения пользователя, извлекать сущности и управлять диалогом.

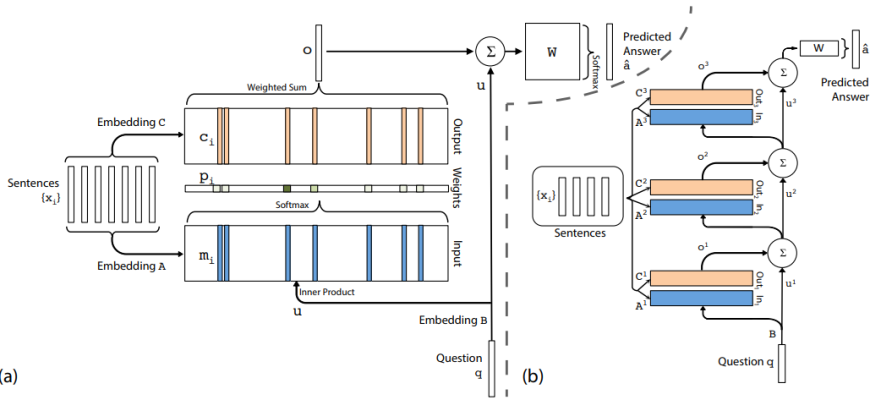

- Системы вопросно-ответных систем (QA): Для QA-систем мы используем трансформерные модели (например, BERT, обученный на задаче SQuAD), которые могут находить ответы на вопросы непосредственно в тексте или даже генерировать их.

Продвинутые Применения и Нишевые Задачи, Которые Мы Исследуем

Мир NLP огромен, и помимо основных задач, мы постоянно открываем для себя новые области применения и инструменты.

Анализ Стилистики и Авторства

Мы также интересуемся анализом стилистики текстов и определением авторства. Это задачи, где мы пытаемся понять уникальный "почерк" автора, его лексическое богатство, использование грамматических конструкций и паттернов. Это может быть полезно для криминалистики, литературоведения или даже для выявления фейковых новостей. Для этого мы анализируем частотность слов, н-грамм, распределение длин предложений, использование стоп-слов и другие метрики.

Работа с Неструктурированным Текстом и Специфическими Документами

Наш опыт включает и работу с очень специфическими типами данных:

- Веб-скрейпинг (Beautiful Soup): Для сбора текстовых данных из интернета мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML-страницы и извлекать нужный контент для дальнейшей обработки.

- Извлечение текста из PDF (PyMuPDF): Работа с PDF-документами часто бывает сложной, но PyMuPDF позволяет нам эффективно извлекать текст, изображения и метаданные, что критически важно для анализа юридических документов, научных статей или финансовой отчетности.

- Анализ лог-файлов: Лог-файлы – это сокровищница информации о работе систем. Мы применяем NLP для анализа этих неструктурированных данных, выявления аномалий, ошибок и поведенческих паттернов.

- Анализ кода (сжатие кода): Даже программный код может быть рассмотрен как текст. Мы экспериментируем с трансформерами для анализа кода, например, для его сжатия или автоматического рефакторинга.

Инструменты для Качества и Сравнения

Мы всегда стремимся к высокому качеству и эффективности. Для этого мы используем:

- Оценка качества моделей (F1-score, Precision, Recall): Для оценки NER-моделей, классификаторов и других алгоритмов мы тщательно анализируем метрики, такие как точность (Precision), полнота (Recall) и F1-мера.

- TextDistance и Jellyfish: Для измерения сходства строк и поиска дубликатов в текстах, а также для задач проверки орфографии, мы используем библиотеки TextDistance и Jellyfish. Они предоставляют различные метрики расстояния (Левенштейн, Джаро-Винклер и др.).

- Sweetviz для анализа текстовых данных: Для быстрого исследовательского анализа текстовых данных и визуализации их распределений мы используем библиотеку Sweetviz, которая автоматизирует многие аспекты анализа.

- Разработка инструментов для проверки фактов (Fact-Checking) и обнаружения плагиата: Это сложные, но крайне важные задачи, где мы комбинируем методы поиска сходства, NER и понимания контекста для выявления недостоверной информации или заимствований.

Работа с Большими Данными и GPU-ускорением

Обработка больших текстовых массивов (Big Data NLP) требует особых подходов. Мы используем оптимизированные библиотеки и, при необходимости, GPU-ускорение (особенно для глубокого обучения с PyTorch/TensorFlow и трансформерами), чтобы эффективно справляться с огромными объемами данных.

Визуализация Текстовых Данных

Понимание данных часто начинается с их визуализации. Мы создаем Word Clouds (облака слов) для быстрого выявления наиболее частых терминов и Heatmaps для отображения корреляций или распределений.

Проделав такой обширный путь по миру NLP на Python, мы можем с уверенностью сказать: это одна из самых динамичных и захватывающих областей компьютерных наук. От базовой токенизации до продвинутых трансформерных моделей, способных генерировать осмысленный текст и отвечать на сложные вопросы, мы видим, как машины все ближе подходят к пониманию человеческого языка. Мы используем эти знания для анализа текстов отзывов клиентов, разработки систем для автоматической категоризации статей, анализа тональности сообщений в социальных сетях, создания чат-ботов и многого другого.

Мы постоянно учимся, экспериментируем с новыми библиотеками и алгоритмами, такими как Stanza для русского языка, FastText для работы с редкими словами, или Sentence Transformers для контекстных встраиваний предложений. Мы видим огромный потенциал в тонкой настройке предварительно обученных моделей для решения узкоспециализированных задач и в разработке инструментов для проверки грамматики и исправления орфографии, чтобы сделать текстовые данные еще чище и доступнее для анализа.

Наш опыт показывает, что ключ к успеху в NLP лежит в глубоком понимании основ, умении выбирать правильные инструменты для конкретной задачи и готовности постоянно адаптироваться к новым технологиям. Мы надеемся, что это путешествие вдохновило вас так же, как оно вдохновляет нас каждый день. Мир текста ждет своих исследователей, и Python предоставляет все необходимое для начала этого удивительного приключения. Присоединяйтесь к нам, и давайте вместе продолжим разгадывать язык цифрового мира!

На этом статья заканчивается.

Подробнее

| NLP Python основы | Токенизация стемминг NLTK | SpaCy NER | Word Embeddings Gensim | Анализ тональности VADER |

| Трансформеры Hugging Face | Классификация текста Scikit-learn | Тематическое моделирование LDA | Разработка чат-ботов Python | Очистка текста регулярные выражения |