- Разгадывая Язык Цифровой Эры: Наш Путь в Мир Python и NLP

- Фундамент: От Сырого Текста к Пониманию

- Первые Шаги: Токенизация и Регулярные Выражения

- Нормализация Текста: Стемминг и Лемматизация

- Очистка и Обогащение: Стоп-слова, Части Речи и Зависимости

- Представление Текста: От Слов к Числам

- Классические Методы: CountVectorizer и TF-IDF

- Смысловые Векторы: Word Embeddings (Word2Vec, GloVe, FastText, Doc2Vec)

- Контекстные Встраивания: Революция Трансформеров

- Ключевые Задачи NLP: От Смысла к Действию

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Суммаризация Текста и Извлечение Ключевых Фраз

- Продвинутые Применения и Инструменты

- Трансформеры и Генерация Текста

- Чат-боты и Вопросно-ответные Системы (QA)

- Мультиязычный NLP и Редкие Языки

- Работа с Неструктурированными Данными и Очистка

- Анализ Стилистики и Авторства

- Визуализация Текстовых Данных

- Наши Инструменты и Методы в Действии

- Завершая Наш Путь: Будущее NLP и Python

Разгадывая Язык Цифровой Эры: Наш Путь в Мир Python и NLP

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим погрузиться в одну из самых увлекательных и быстро развивающихся областей современной информатики – Обработку Естественного Языка, или NLP (Natural Language Processing). Мы, команда увлеченных исследователей и практиков, на собственном опыте убедились, насколько мощным и многогранным инструментом является Python в этом домене. Забудьте о скучных учебниках и сухой теории – мы расскажем вам о нашем путешествии в мир NLP, о том, как мы применяем его для решения реальных задач, и какие библиотеки стали нашими верными спутниками.

Мир вокруг нас пронизан текстом: электронные письма, сообщения в мессенджерах, посты в социальных сетях, статьи, книги, юридические документы, медицинские записи. Объем информации, генерируемой ежедневно, ошеломляет, и вручную его обработать практически невозможно. Именно здесь на помощь приходит NLP – дисциплина, которая позволяет компьютерам понимать, интерпретировать и генерировать человеческий язык. Мы увидим, как Python, благодаря своей простоте, мощным библиотекам и огромному сообществу, стал де-факто стандартом для работы с текстом. Приготовьтесь, наше путешествие будет долгим и невероятно интересным!

Фундамент: От Сырого Текста к Пониманию

Прежде чем мы сможем научить машину "читать" и "понимать", нам необходимо подготовить текст. Этот этап, известный как предобработка, является краеугольным камнем любого NLP-проекта. Мы неоднократно убеждались, что качество предобработки напрямую влияет на успех последующих аналитических задач. Именно здесь мы начинаем свое погружение в удивительный мир лингвистических структур, превращая хаотичный поток символов в нечто осмысленное для алгоритмов.

Первые Шаги: Токенизация и Регулярные Выражения

Самый первый шаг – это разбиение текста на более мелкие, осмысленные единицы, которые мы называем токенами. Это могут быть слова, пунктуационные знаки, числа или даже эмодзи. Для этого мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает широкий спектр токенизаторов. Например, для разбиения текста на слова мы можем использовать `word_tokenize`, а для предложений – `sent_tokenize`. Это кажется простым, но учтите, что языки имеют свои особенности: сокращения, дефисы, слитные слова – все это требует умного подхода, и NLTK справляется с этим весьма эффективно.

Параллельно с токенизацией, а иногда и до нее, мы активно применяем регулярные выражения (модуль `re` в Python). Это универсальный инструмент для поиска, замены и извлечения паттернов в тексте. С их помощью мы очищаем текст от HTML-тегов, удаляем ненужные символы, приводим к нижнему регистру, стандартизируем форматы дат и времени. Например, чтобы удалить все ссылки из текста, мы можем написать одно короткое регулярное выражение. Этот этап критически важен, особенно когда мы работаем с неструктурированными данными, собранными из интернета, где "шума" всегда предостаточно.

Нормализация Текста: Стемминг и Лемматизация

Когда мы анализируем текст, часто разные формы одного и того же слова ("бежать", "бежит", "бежал") несут одно и то же смысловое ядро. Чтобы снизить размер словаря и улучшить качество анализа, мы применяем методы нормализации. Стемминг – это процесс отсечения окончаний и суффиксов, чтобы получить "корень" слова (например, "бежать" -> "беж"). NLTK предоставляет популярные стеммеры, такие как PorterStemmer и SnowballStemmer. Это быстрый и эффективный способ, но иногда он может создавать несуществующие слова.

Лемматизация, в свою очередь, является более продвинутым процессом. Она стремится привести слово к его базовой словарной форме (лемме), используя морфологический анализ и знание частей речи. Например, "был", "есть", "будет" превратятся в "быть". Здесь на помощь приходят такие библиотеки, как spaCy и Stanza. spaCy особенно хорош для языков с богатой морфологией, предлагая высококачественную лемматизацию наряду с другими мощными функциями. Мы видим, что лемматизация, хотя и более ресурсоемкая, часто дает лучшие результаты для последующих этапов, поскольку сохраняет семантическую целостность слов.

Очистка и Обогащение: Стоп-слова, Части Речи и Зависимости

После нормализации мы обычно удаляем стоп-слова – это часто встречающиеся, но обычно не несущие большой смысловой нагрузки слова, такие как "и", "в", "на", "он". NLTK содержит списки стоп-слов для многих языков, но мы часто создаем и свои, адаптированные под конкретную задачу. Это помогает сосредоточиться на наиболее информативных словах.

Для более глубокого понимания структуры предложения мы используем POS-теггинг (Part-of-Speech Tagging), то есть определение части речи каждого слова (существительное, глагол, прилагательное и т.д.). spaCy и NLTK превосходно справляются с этой задачей. Более того, spaCy позволяет проводить синтаксический парсинг, строя деревья зависимостей, которые показывают, как слова связаны друг с другом в предложении. Это открывает двери для извлечения более сложной информации и понимания структуры предложений.

"Язык – это всего лишь инструмент. Он существует, чтобы передавать мысль."

— Ноам Хомский

Представление Текста: От Слов к Числам

После того как текст очищен и нормализован, нам нужно преобразовать его в числовой формат, понятный для алгоритмов машинного обучения. Это один из самых креативных и важных этапов в NLP, поскольку способ представления текста напрямую влияет на производительность наших моделей. Мы постоянно ищем оптимальные подходы, экспериментируя с различными векторизаторами.

Классические Методы: CountVectorizer и TF-IDF

Самые простые, но часто весьма эффективные способы представления текста – это CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer создает матрицу, где каждая строка соответствует документу, а каждый столбец – уникальному слову (токену) во всем корпусе. Значение в ячейке – это просто количество вхождений слова в документ. Этот подход интуитивно понятен, но не учитывает важность слов.

Здесь на сцену выходит TfidfVectorizer (Term Frequency-Inverse Document Frequency). Он не только считает частоту слова в документе, но и взвешивает ее обратно пропорционально частоте этого слова во всем корпусе. Это означает, что слова, часто встречающиеся в одном документе, но редко во всем корпусе, получают больший вес. Это позволяет выделить действительно важные, специфические для документа термины. Мы часто используем TF-IDF для задач классификации текста и тематического моделирования, так как он отлично справляется с выделением ключевых концепций.

| Характеристика | CountVectorizer | TfidfVectorizer |

|---|---|---|

| Принцип | Подсчет вхождений слов | Взвешенная частота слов |

| Важность слов | Не учитывает | Учитывает редкость слова в корпусе |

| Размерность | Высокая, разреженная | Высокая, разреженная |

| Применение | Простая классификация, анализ частотности | Классификация, тематическое моделирование, поиск |

Смысловые Векторы: Word Embeddings (Word2Vec, GloVe, FastText, Doc2Vec)

Классические методы имеют один существенный недостаток: они не улавливают семантические отношения между словами. Слова "король" и "царь" будут для них совершенно разными, хотя и имеют схожий смысл. Здесь на помощь приходят Word Embeddings – плотные векторные представления слов, которые отображают их смысл и контекст. Мы, как и многие, были поражены возможностями этих моделей.

Word2Vec (от Google) и GloVe (от Stanford) – это два пионера в этой области. Они обучаются на огромных корпусах текста и генерируют векторы, где семантически близкие слова располагаются близко друг к другу в многомерном пространстве. Мы используем библиотеку Gensim для работы с Word2Vec и GloVe. Gensim также позволяет нам создавать Doc2Vec, который генерирует векторы для целых документов, а не только для слов, что невероятно полезно для сравнения и классификации больших текстовых фрагментов. FastText – еще одна мощная модель от Facebook, которая учитывает морфологию слов, разбивая их на подслова, что делает ее особенно эффективной для работы с редкими словами и языками с богатой морфологией.

Контекстные Встраивания: Революция Трансформеров

Word embeddings были прорывом, но у них есть ограничение: одно слово всегда имеет один и тот же вектор, независимо от контекста. Слово "банк" может означать финансовое учреждение или берег реки, но его вектор будет одинаковым. Это изменилось с появлением трансформерных архитектур, таких как BERT (Bidirectional Encoder Representations from Transformers) и GPT. Эти модели способны создавать контекстные встраивания, где вектор слова меняется в зависимости от окружающих его слов в предложении. Это фундаментальное изменение позволило нам достичь беспрецедентной точности во многих задачах NLP.

Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет доступ к сотням предварительно обученных моделей. Это позволяет нам не только использовать готовые решения для классификации, NER или QA, но и проводить тонкую настройку (fine-tuning) этих моделей на наших собственных данных, адаптируя их под специфические задачи. Векторизация предложений и документов с учетом контекста стала стандартом для многих продвинутых приложений.

Ключевые Задачи NLP: От Смысла к Действию

Имея подготовленный и векторизованный текст, мы можем переходить к решению конкретных задач. Этот раздел посвящен основным направлениям, где NLP оказывает наибольшее влияние, и мы расскажем, как мы подходим к их решению, используя арсенал Python-библиотек.

Распознавание Именованных Сущностей (NER)

Одной из наиболее востребованных задач является Распознавание Именованных Сущностей (Named Entity Recognition, NER). Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т.д. Представьте, что вам нужно автоматически извлечь все имена клиентов и даты заказов из тысяч электронных писем – NER делает это возможным.

Для NER мы активно используем spaCy, который предоставляет очень быстрые и точные модели для различных языков. Также мы обращаемся к библиотеке Flair, известной своими мощными трансформерными моделями для NER, часто дающими state-of-the-art результаты. Иногда, для специфических задач, мы даже разрабатываем собственные CRF (Conditional Random Fields) модели, когда требуется максимальная гибкость и контроль над разметкой.

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – это бесценная информация для бизнеса, маркетинга и социальных исследований. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв положительным, отрицательным или нейтральным. Мы применяем его для анализа отзывов клиентов, сообщений в социальных сетях (Twitter, Reddit), финансовых новостей и даже медицинских записей.

Для быстрого и простого анализа тональности на английском языке мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который является частью NLTK. Это правило-ориентированный подход, который хорошо справляется с текстами из социальных сетей. Для более сложных сценариев, включая работу с эмодзи, сленгом и сарказмом, мы переходим к моделям на основе машинного обучения, используя Scikit-learn с TF-IDF или более продвинутые трансформерные модели от Hugging Face, специально обученные для анализа тональности. TextBlob также предлагает простой интерфейс для анализа тональности, хотя его возможности более ограничены.

Тематическое Моделирование (Topic Modeling)

Когда у нас есть большой корпус документов, и мы хотим понять, о чем они, не читая каждый из них, на помощь приходит Тематическое Моделирование. Это методы, которые автоматически обнаруживают абстрактные "темы", присутствующие в коллекции документов. Для нас это незаменимый инструмент для анализа блогов, форумов, отзывов о продуктах и даже юридических документов.

Библиотека Gensim является нашим основным инструментом для тематического моделирования. Мы активно используем LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing) для извлечения скрытых тем. Эти алгоритмы позволяют нам определить, какие слова чаще встречаются вместе, формируя таким образом семантические кластеры, представляющие собой темы. Мы также сравниваем LDA с NMF (Non-negative Matrix Factorization) из Scikit-learn, чтобы найти оптимальную модель для конкретного набора данных. Визуализация тем с помощью Word Clouds помогает нам быстро интерпретировать результаты.

- LDA (Latent Dirichlet Allocation): Вероятностная модель, которая предполагает, что каждый документ состоит из смеси тем, а каждая тема – из смеси слов.

- LSI (Latent Semantic Indexing): Использует сингулярное разложение для выявления скрытых семантических структур в тексте.

- NMF (Non-negative Matrix Factorization): Линейная алгебраическая модель, которая разлагает матрицу "документ-слово" на две другие матрицы, представляющие темы и их распределение в документах.

Классификация Текстов

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Мы применяем ее для автоматической категоризации статей, фильтрации спама, маршрутизации запросов в службу поддержки, анализа тональности (как бинарной классификации) и многого другого. Это одна из самых распространенных и мощных задач в NLP.

Для классификации мы часто начинаем с классических моделей машинного обучения из Scikit-learn: SVM (Support Vector Machines), Naive Bayes Classifier, Logistic Regression. В качестве признаков мы используем TF-IDF векторы или Word Embeddings. Для более сложных задач, где требуеться уловить глубокие контекстные зависимости, мы переходим к нейронным сетям. Мы строим LSTM-сети с использованием PyTorch или TensorFlow/Keras, а для достижения наивысшей точности – используем трансформерные модели (например, BERT), тонко настроенные на наших данных.

Суммаризация Текста и Извлечение Ключевых Фраз

В мире перегруженном информацией, способность быстро извлекать суть из длинных документов становится критически важной. Суммаризация текста позволяет нам создавать краткие изложения. Мы различаем два основных подхода: экстрактивную суммаризацию, которая выбирает наиболее важные предложения из оригинального текста, и абстрактивную суммаризацию, которая генерирует совершенно новые предложения, перефразируя информацию.

Для экстрактивной суммаризации и извлечения ключевых фраз мы используем алгоритмы вроде TextRank (реализован в библиотеках вроде `textrank` или `gensim.summarization`), который строит граф предложений или слов и ранжирует их по важности. Также мы применяем RAKE (Rapid Automatic Keyword Extraction) для извлечения ключевых слов. Для абстрактивной суммаризации, которая является гораздо более сложной задачей, мы полагаемся на продвинутые трансформерные модели от Hugging Face, такие как BART или T5, которые способны генерировать связный и осмысленный текст.

Продвинутые Применения и Инструменты

Помимо базовых задач, мир NLP предлагает гораздо больше возможностей. Мы постоянно исследуем новые горизонты, применяя передовые методы и библиотеки для решения уникальных и сложных проблем. От генерации текста до работы с редкими языками – Python остается нашим надежным спутником.

Трансформеры и Генерация Текста

Мы уже упоминали трансформеры в контексте векторизации, но их истинная мощь раскрывается в задачах генерации текста. Модели, подобные GPT (Generative Pre-trained Transformer), способны генерировать связный, грамматически правильный и даже творческий текст на основе заданного начального фрагмента. Мы применяем их для создания описаний товаров, генерации диалогов для чат-ботов, автоматического написания кратких новостей и даже для помощи в написании кода.

Работа с Hugging Face Transformers позволяет нам легко использовать эти огромные модели. Мы учились тонкой настройке GPT-подобных моделей на наших собственных данных для получения более специфичных и релевантных результатов. Это открывает невероятные возможности для автоматизации контент-мейкинга и интерактивных систем.

Чат-боты и Вопросно-ответные Системы (QA)

Создание интеллектуальных диалоговых систем – одна из самых захватывающих областей NLP. Мы разрабатываем чат-боты, используя фреймворки, такие как Rasa, который позволяет строить контекстно-зависимые диалоговые агенты. Rasa объединяет понимание естественного языка (NLU) и управление диалогом, что делает его мощным инструментом для создания сложных ботов для поддержки клиентов, виртуальных ассистентов и интерактивных игр.

Для создания вопросно-ответных систем (QA), которые могут извлекать точные ответы из больших объемов текста, мы также используем трансформерные модели. Модели, обученные на QA-датасетах (например, SQuAD), способны находить ответы на вопросы в предоставленных документах, что незаменимо для создания систем поиска по корпоративной документации или медицинским справочникам.

Мультиязычный NLP и Редкие Языки

Мир не ограничивается английским языком, и мы часто работаем с многоязычными текстовыми корпусами. NLTK, spaCy и Stanza предоставляют поддержку для многих языков, включая русский, с продвинутой лемматизацией и POS-теггингом. Для работы с языками с богатой морфологией Stanza (от Stanford NLP Group) зарекомендовал себя как исключительно мощный инструмент.

Для более экзотических или редких языков, где стандартные библиотеки могут быть ограничены, мы обращаемся к библиотеке Polyglot; Она предоставляет широкий спектр функций для многоязычного NLP, включая токенизацию, NER, анализ тональности и перевод для десятков языков. Это позволяет нам расширять наши проекты за пределы доминирующих языков и работать с глобальной аудиторией.

Работа с Неструктурированными Данными и Очистка

Реальный мир полон неструктурированного текста, который часто содержит ошибки, неполные данные, сленг, эмодзи и специфические форматы. Это один из самых больших вызовов в NLP. Мы разработали целый арсенал инструментов для очистки данных. Помимо регулярных выражений, мы используем:

- Библиотека Jellyfish: для сравнения строк и поиска похожих, но не идентичных терминов.

- Собственные словари и тезаурусы: для нормализации сленга, синонимов и специфической терминологии.

- Инструменты для проверки грамматики и орфографии: часто основанные на правилах или языковых моделях.

- Библиотека Beautiful Soup: для веб-скрейпинга и извлечения текста из HTML-страниц, отфильтровывая ненужные теги.

- PyMuPDF: для извлечения текста из PDF-документов, что является частой задачей при работе с отчетами или научными статьями.

Мы знаем, что чем чище данные, тем точнее наши модели. Проблемы обработки неполных и ошибочных данных – это не приговор, а возможность для инженеров NLP проявить изобретательность.

Анализ Стилистики и Авторства

Анализ стилистики текстов – это увлекательная область, которая позволяет нам определить авторский почерк, выявить плагиат или даже анализировать эволюцию языка. Мы используем различные метрики лексического богатства, частотности слов и n-грамм, длины предложений, а также продвинутые методы векторизации для создания "отпечатков" авторского стиля. Сравнение этих "отпечатков" с использованием метрик сходства (например, из библиотеки Textdistance) позволяет нам решать задачи определения авторства и обнаружения плагиата.

Визуализация Текстовых Данных

Числа и векторы важны, но для понимания и презентации результатов нам часто требуется визуализация. Мы активно используем:

- Word Clouds: для быстрого отображения частотности слов в документе или теме.

- Heatmaps: для визуализации матриц сходства между документами или темами.

- Графы зависимостей: с помощью spaCy для интерактивного исследования синтаксической структуры предложений.

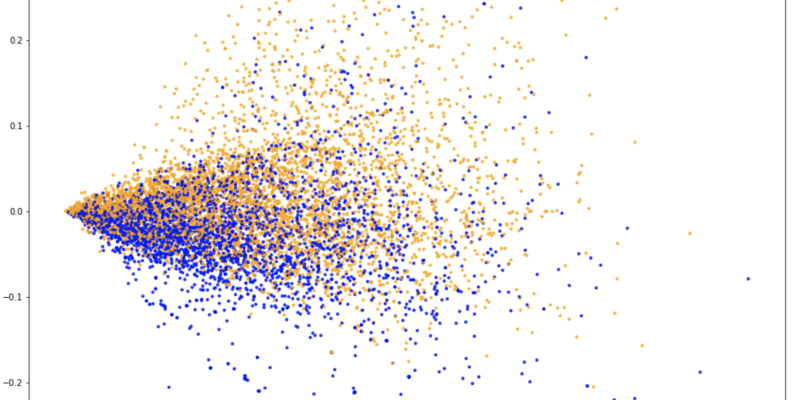

- TSNE/UMAP: для снижения размерности и визуализации кластеров документов или Word Embeddings в 2D/3D пространстве.

Библиотека Sweetviz также может быть полезна для быстрого анализа и визуализации различных аспектов текстовых данных.

Наши Инструменты и Методы в Действии

Мы видим, что арсенал Python-библиотек для NLP огромен, и каждый инструмент находит свое место в нашем рабочем процессе. Вот краткий обзор того, как мы используем некоторые из них:

- NLTK: Отлично подходит для базовой токенизации, стемминга, работы со стоп-словами и лексическими ресурсами. Наша отправная точка для многих проектов.

- spaCy: Незаменим для быстрой и точной лемматизации, POS-теггинга, синтаксического парсинга и NER, особенно когда производительность имеет значение.

- Gensim: Наш выбор для тематического моделирования (LDA, LSI) и работы с классическими Word Embeddings (Word2Vec, GloVe, Doc2Vec).

- Scikit-learn: Основная библиотека для классификации текстов, кластеризации и разработки собственных векторизаторов (CountVectorizer, TfidfVectorizer).

- Hugging Face Transformers: Наш goto-инструмент для самых современных задач, требующих контекстного понимания, генерации текста и тонкой настройки больших языковых моделей.

- PyTorch/TensorFlow: Используем для создания собственных нейронных сетей, когда требуется максимальная гибкость в архитектуре.

- Библиотека Flair: Часто применяется для высокоточного NER и векторизации предложений.

- TextBlob: Для быстрого прототипирования и простого анализа тональности или определения языка.

- Regular Expressions (`re`): Постоянно используется для очистки и извлечения паттернов из сырого текста.

Мы также не забываем о таких нишевых, но мощных библиотеках, как Textacy для более продвинутого анализа зависимостей и извлечения информации, Stanza для языков с богатой морфологией, и Pattern для различных задач NLP, включая анализ социальных сетей. Sentence Transformers стал для нас стандартом для получения высококачественных векторов предложений и документов, особенно для задач поиска сходства;

Завершая Наш Путь: Будущее NLP и Python

Мы стоим на пороге новой эры в NLP, где возможности кажутся безграничными. Благодаря Python, его мощным библиотекам и активному сообществу, мы можем решать все более сложные задачи – от анализа медицинских записей и юридических документов до разработки систем автоматического перевода узкоспециализированных текстов и создания инструментов для проверки фактов. Обработка больших текстовых массивов (Big Data NLP) становится все более доступной, а применение GPU-ускорения делает возможным обучение и использование еще более крупных и сложных моделей;

Наш опыт показывает, что ключ к успеху в NLP лежит не только в знании алгоритмов, но и в глубоком понимании языка, тщательной предобработке данных и постоянном экспериментировании с различными инструментами и подходами. Мы призываем вас не бояться погружаться в этот захватывающий мир, пробовать новые библиотеки, участвовать в сообществе и делиться своими открытиями. В конце концов, язык – это то, что делает нас людьми, и возможность научить машины понимать его – это одна из самых грандиозных задач, которую мы когда-либо решали. И Python делает ее доступной для каждого из нас.

Подробнее

| Тема 1 | Тема 2 | Тема 3 | Тема 4 | Тема 5 |

|---|---|---|---|---|

| Основы токенизации NLTK | Применение spaCy для NER | Тематическое моделирование Gensim | Векторизация текстов Word2Vec | Анализ тональности VADER |

| Разработка векторизаторов Scikit-learn | Регулярные выражения в NLP | Продвинутая лемматизация Stanza | Трансформеры Hugging Face | Разработка чат-ботов Rasa |