- Разгадывая язык машин: Наш глубокий дайв в мир NLP на Python

- Что такое NLP и почему это важно для нас?

- Наши первые шаги: Основы предобработки текста

- NLTK и spaCy: Наши верные спутники

- Регулярные выражения и очистка данных

- Как компьютеры "понимают" слова: Векторизация текста

- От простых счетчиков до глубоких эмбеддингов

- Разгадываем смысл: Основные задачи NLP

- Распознавание именованных сущностей (NER)

- Анализ тональности: За гранью простого "хорошо" или "плохо"

- Тематическое моделирование: Поиск скрытых тем

- Классификация текстов: Сортируем и организуем

- Извлечение информации: Ключевые фразы и суммаризация

- Эра Трансформеров: Новый уровень NLP

- Hugging Face и предобученные модели

- Нейросети и глубокое обучение

- NLP в реальном мире: Прикладные решения и инструменты

- Работа с различными источниками данных

- Мультиязычный NLP

- Создание интеллектуальных систем

- Анализ стилистики и уникальности

- Визуализация текстовых данных

- Вызовы и перспективы: Куда движется NLP?

- Наши любимые инструменты и библиотеки

Разгадывая язык машин: Наш глубокий дайв в мир NLP на Python

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами нашим многолетним опытом и страстью к одной из самых увлекательных областей искусственного интеллекта – Обработке Естественного Языка, или NLP (Natural Language Processing)․ Мы живем в эпоху, когда текст окружает нас повсюду: от коротких сообщений в мессенджерах до многостраничных юридических документов, от отзывов клиентов до сложнейших научных статей․ И главная задача NLP – научить компьютеры понимать, интерпретировать и даже генерировать этот текст так же, как это делаем мы, люди․ Звучит амбициозно, не правда ли?

В этой статье мы не просто расскажем о теории, но и проведем вас через практические аспекты работы с NLP, опираясь на наши собственные проекты и наблюдения․ Мы сосредоточимся на Python – языке, который стал де-факто стандартом для большинства задач в области машинного обучения и искусственного интеллекта благодаря своей простоте, мощным библиотекам и огромному сообществу․ Приготовьтесь к увлекательному путешествию, где мы раскроем секреты токенизации, стемминга, тематического моделирования и даже прикоснемся к магии трансформерных моделей, которые сейчас творят чудеса в мире NLP․

Что такое NLP и почему это важно для нас?

Обработка естественного языка – это междисциплинарная область на стыке информатики, искусственного интеллекта и лингвистики․ Её цель – дать компьютерам способность обрабатывать и анализировать человеческий язык․ Представьте, сколько информации содержится в неструктурированном тексте! Это огромный массив данных, который традиционные методы анализа не могут эффективно использовать․ Именно здесь на помощь приходит NLP, открывая двери для автоматизации множества задач, которые раньше требовали колоссальных человеческих усилий․

Для нас, как для практиков и исследователей, NLP – это не просто набор алгоритмов, а мощный инструмент, который позволяет извлекать ценные инсайты из текстовых данных, повышать эффективность бизнес-процессов и даже создавать совершенно новые пользовательские интерфейсы․ От голосовых помощников, которые понимают наши команды, до систем, способных предсказывать настроения рынка по новостным заголовкам – всё это стало возможным благодаря прорывам в NLP․ Мы видим, как эта область продолжает стремительно развиваться, предлагая всё более изощренные и точные методы для взаимодействия человека и машины через язык․

Наши первые шаги: Основы предобработки текста

Прежде чем мы сможем анализировать текст, его необходимо подготовить․ Этот этап, известный как предобработка, является одним из самых критически важных в любом NLP-проекте․ Без качественной предобработки даже самые продвинутые модели будут давать сомнительные результаты․ Представьте, что вы пытаетесь приготовить изысканное блюдо из немытых и неочищенных ингредиентов – результат будет, мягко говоря, неудовлетворительным․ То же самое и с текстом․ Наш опыт показывает, что львиная доля времени в работе над NLP-проектом уходит именно на предобработку, ведь "мусор на входе – мусор на выходе" (garbage in, garbage out) – это золотое правило, которое нельзя игнорировать․

Мы начинаем с того, что разбиваем текст на более мелкие, осмысленные единицы, удаляем ненужные элементы и приводим слова к их базовым формам․ Эти, казалось бы, простые шаги формируют фундамент для всего последующего анализа․ Давайте подробнее рассмотрим основные техники и инструменты, которые мы используем на этом этапе․

NLTK и spaCy: Наши верные спутники

Когда речь заходит о предобработке текста в Python, две библиотеки сразу приходят нам на ум: NLTK (Natural Language Toolkit) и spaCy․ NLTK – это настоящая "рабочая лошадка", ставшая стандартом де-факто для академических исследований и обучения․ Она предлагает обширный набор алгоритмов для токенизации, стемминга, лемматизации, POS-теггинга (разметки частей речи) и многого другого․ Мы часто начинаем знакомство с NLP именно с NLTK благодаря его исчерпывающей документации и множеству примеров․

Например, токенизация – это процесс разбиения текста на слова или фразы (токены)․

import nltk

from nltk․tokenize import word_tokenize

text = "Наши первые шаги в NLP очень важны!"

tokens = word_tokenize(text)

print(tokens)

Стемминг – это процесс сокращения слов до их корневой формы (стема), часто путем отсечения суффиксов․ Например, слова "работать", "работает", "работал" могут быть сведены к "работ"․

from nltk․stem import PorterStemmer

stemmer = PorterStemmer

words = ["running", "runner", "runs"]

stemmed_words = [stemmer․stem(word) for word in words]

print(stemmed_words)

Лемматизация же более сложный процесс, который приводит слова к их словарной (нормальной) форме, учитывая морфологию языка․ Например, "был", "есть", "будет" будут лемматизированы до "быть"․

from nltk․stem import WordNetLemmatizer

lemmatizer = WordNetLemmatizer

print(lemmatizer․lemmatize("better", pos="a")) # 'a' for adjective

SpaCy, в свою очередь, – это более современная и производительная библиотека, разработанная с прицелом на промышленное применение․ Она известна своей скоростью, эффективностью и предконфигурированными моделями для различных языков, включая русский․ SpaCy превосходно справляется с задачами, требующими высокой точности и скорости, такими как Распознавание Именованных Сущностей (NER) и синтаксический парсинг․ Мы часто используем spaCy, когда производительность и простота интеграции с другими частями системы выходят на первый план․

Регулярные выражения и очистка данных

Помимо специализированных библиотек, в нашем арсенале всегда присутствует модуль re для работы с регулярными выражениями․ Это незаменимый инструмент для тонкой настройки предобработки текста: удаления HTML-тегов из веб-страниц, очистки от пунктуации, чисел, специальных символов или даже фильтрации спама․ Регулярные выражения позволяют нам создавать гибкие шаблоны для поиска и замены любых последовательностей символов в тексте․

Например, чтобы удалить все HTML-теги из текста:

import re

html_text = "Это <b>важный</b> текст с <a href='#'>ссылкой</a>․"

clean_text = re․sub(r'<․*?>', '', html_text)

print(clean_text)

Мы также активно работаем над очисткой данных от так называемых "стоп-слов" (слишком часто встречающихся слов, не несущих смысловой нагрузки, таких как "и", "в", "на"), нормализацией сленга и даже обработкой эмодзи, которые становятся всё более распространенной частью современного общения․ Для русского языка, где морфология намного богаче, чем в английском, продвинутая лемматизация с использованием моделей spaCy или Stanza дает гораздо лучшие результаты, чем простой стемминг NLTK․

Давайте сравним NLTK и spaCy для задач лемматизации и стемминга на примере русского языка, чтобы понять, какой подход предпочтительнее в разных сценариях:

| Критерий | NLTK (русский стемминг/лемматизация) | spaCy (русская лемматизация) |

|---|---|---|

| Основной подход | Преимущественно стемминг (например, SnowballStemmer)․ Лемматизация требует сторонних словарей (pymorphy2)․ | Продвинутая лемматизация на основе статистических моделей и правил․ |

| Точность | Стемминг может отсекать лишнее, приводя к несловарным формам․ Лемматизация с pymorphy2 точнее, но требует интеграции․ | Высокая, благодаря контекстуальному анализу и готовым моделям․ |

| Скорость | Стемминг быстрый, но лемматизация с внешними библиотеками может быть медленнее․ | Оптимизирована для производительности, быстрая обработка больших объемов текста․ |

| Простота использования | Требует загрузки отдельных корпусов и, возможно, дополнительных библиотек для лемматизации․ | "Из коробки" предлагает готовые модели, проста в настройке и использовании․ |

| Рекомендация | Хорош для быстрого прототипирования или когда некритична точная словарная форма․ | Предпочтителен для продакшн-систем и задач, требующих высокой лингвистической точности․ |

Как компьютеры "понимают" слова: Векторизация текста

Представьте, что вы хотите научить компьютер различать яблоки и апельсины․ Вы не можете просто показать ему картинки и сказать "это яблоко"․ Вам нужно дать ему числовые характеристики: размер, цвет, вес, форма․ То же самое происходит и с текстом․ Компьютеры работают с числами, а не со словами․ Поэтому, после предобработки, следующим критически важным шагом является векторизация текста – процесс преобразования слов, фраз или целых документов в числовые векторы․ Именно эти векторы становятся входными данными для моделей машинного обучения․

История векторизации – это история постоянного стремления сделать эти числовые представления всё более осмысленными и контекстуальными․ Мы прошли путь от простых подсчетов до сложных нейросетевых эмбеддингов, которые улавливают тонкие семантические связи между словами․ Каждая новая методика векторизации открывает новые возможности для анализа текста, позволяя машинам "понимать" его всё глубже․

От простых счетчиков до глубоких эмбеддингов

Наши первые эксперименты с векторизацией часто начинались с простых, но эффективных методов, таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn․ CountVectorizer просто подсчитывает частоту каждого слова в документе, создавая вектор, где каждая позиция соответствует слову из всего корпуса․ TfidfVectorizer (Term Frequency-Inverse Document Frequency) идет дальше, взвешивая частоту слова в документе с учетом его редкости во всем корпусе, что помогает выделить более значимые слова․

Пример CountVectorizer:

from sklearn․feature_extraction․text import CountVectorizer

corpus = ['это очень хороший фильм', 'это очень плохой фильм']

vectorizer = CountVectorizer

X = vectorizer․fit_transform(corpus)

print(vectorizer․get_feature_names_out)

print(X․toarray)

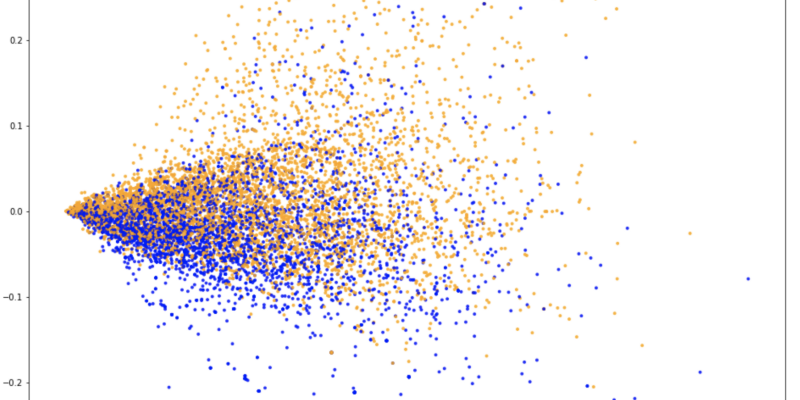

Однако эти методы не учитывают семантику слов – то, что "король" и "королева" связаны, или что "быстрый" и "скорый" синонимы․ Здесь на сцену выходят Word Embeddings (векторные представления слов), такие как Word2Vec и GloVe․ Эти модели, часто реализуемые с помощью библиотеки Gensim, обучаются на огромных текстовых корпусах и создают плотные векторы, где слова с похожим смыслом располагаются близко друг к другу в многомерном пространстве․ Они улавливают семантические и синтаксические отношения, позволяя нам выполнять такие операции, как "король ― мужчина + женщина = королева"․

Мы также активно используем FastText, который, помимо Word2Vec и GloVe, учитывает подсловные единицы (символьные n-граммы), что делает его особенно эффективным для работы с редкими словами и морфологически богатыми языками, где обычные эмбеддинги могут столкнуться с проблемой "нулевых" представлений для незнакомых слов․

Для представления целых документов или предложений мы применяем Doc2Vec (расширение Word2Vec) и более современные Sentence Transformers, которые позволяют получить качественные эмбеддинги для более длинных текстовых фрагментов․ А появление контекстных эмбеддингов, таких как те, что используются в моделях BERT, GPT и других трансформерах, стало настоящей революцией, поскольку они генерируют векторное представление слова не в вакууме, а с учетом его конкретного контекста в предложении․ Это позволяет различать значения слов-омонимов, например, "коса" (инструмент) и "коса" (прическа)․

Мы часто сталкиваемся с необходимостью выбора подходящего метода векторизации для конкретной задачи․ Вот краткое сравнение:

| Метод векторизации | Основные характеристики | Преимущества | Недостатки | Типичные сценарии |

|---|---|---|---|---|

| CountVectorizer | Подсчет частоты слов․ | Простота, интерпретируемость․ | Не учитывает семантику, большая разреженность․ | Базовая классификация, анализ частотности․ |

| TfidfVectorizer | Взвешивание частоты слов с учетом их редкости․ | Выделяет важные слова, уменьшает влияние стоп-слов․ | Не учитывает семантику, разреженность․ | Классификация, поиск релевантных документов․ |

| Word2Vec/GloVe | Плотные векторные представления слов, обученные на больших корпусах․ | Учитывает семантические связи, меньшая размерность․ | Слова вне словаря (OOV) не обрабатываются, не учитывает контекст․ | Поиск синонимов, семантическая близость․ |

| FastText | Как Word2Vec, но с учетом подсловных единиц․ | Хорошо справляется с редкими словами и морфологически богатыми языками․ | Требует больших данных для обучения, не контекстный․ | Мультиязычный NLP, работа с опечатками․ |

| Doc2Vec | Векторные представления для целых документов․ | Позволяет сравнивать документы по смыслу․ | Требует настройки, качество зависит от данных․ | Поиск похожих документов, кластеризация․ |

| Контекстные эмбеддинги (BERT, GPT) | Динамические векторные представления слов, зависящие от контекста․ | Высочайшая точность, понимание омонимов, многозадачность․ | Очень ресурсоемкие, требуют больших моделей․ | NER, QA, машинный перевод, суммаризация․ |

Разгадываем смысл: Основные задачи NLP

После того как текст очищен и превращен в числовые векторы, мы можем приступать к решению более сложных и интересных задач․ Это тот момент, когда машины начинают по-настоящему "понимать" текст, извлекая из него информацию, классифицируя его, оценивая эмоциональную окраску и даже выявляя скрытые темы․ Мы используем широкий спектр методов и библиотек для решения этих задач, каждая из которых имеет свои нюансы и области применения․ Наш путь в NLP всегда был наполнен экспериментами и поиском оптимальных решений для самых разнообразных сценариев․

Распознавание именованных сущностей (NER)

Одной из фундаментальных задач в NLP является Распознавание Именованных Сущностей (NER)․ Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, денежные суммы и т․д․ Представьте, что вы читаете новостную статью и хотите быстро выделить всех упомянутых людей и компании․ NER делает это за вас автоматически․

Мы активно используем spaCy для быстрого и точного NER, так как она поставляется с предварительно обученными моделями, способными распознавать широкий спектр сущностей․ Для более сложных или специфических задач, требующих высокой точности, мы обращаемся к библиотеке Flair, которая предлагает современные подходы на основе нейронных сетей, или даже к моделям на основе CRF (Conditional Random Fields) для мелкозернистой разметки․ С появлением трансформерных моделей, таких как BERT, точность NER значительно возросла, позволяя нам решать задачи, которые раньше казались невыполнимыми․

Анализ тональности: За гранью простого "хорошо" или "плохо"

Анализ тональности (Sentiment Analysis) – это процесс определения эмоциональной окраски текста: позитивной, негативной или нейтральной․ Это критически важно для понимания отзывов клиентов, анализа упоминаний бренда в социальных сетях или даже оценки настроений на финансовых рынках․ Мы начинали с простых лексических подходов, таких как библиотека VADER (Valence Aware Dictionary and sEntiment Reasoner), которая отлично справляется с англоязычным текстом, или TextBlob для более простого NLP․

Однако, наш опыт показывает, что анализ тональности – это не просто бинарная классификация․ Мы постоянно сталкиваемся с нюансами, такими как сарказм, ирония, двойные отрицания, которые могут полностью изменить смысл предложения․ Поэтому для анализа тональности сообщений в социальных сетях (Twitter/Reddit) или финансовых новостей мы переходим к более продвинутым моделям на основе машинного обучения и глубоких нейронных сетей, способных улавливать контекст и тонкие эмоциональные оттенки․ Мы также разрабатываем собственные словари тональности, адаптированные под специфику предметной области․

Тематическое моделирование: Поиск скрытых тем

Представьте, что у вас есть огромный архив документов, и вы хотите понять, о чем они вообще․ Тематическое моделирование – это набор алгоритмов, которые позволяют нам автоматически выявлять скрытые "темы" в коллекции текстовых документов․ Это не просто поиск ключевых слов, а скорее обнаружение групп слов, которые часто встречаются вместе, формируя смысловые кластеры․

Библиотека Gensim является нашим основным инструментом для тематического моделирования, предлагая реализации таких популярных алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Мы используем их для анализа текстов отзывов клиентов, статей, новостей, чтобы понять, какие основные темы волнуют людей или какие дискуссии ведутся․ Помимо LDA и LSI, мы также сравниваем их с NMF (Non-negative Matrix Factorization), который часто дает хорошие результаты, особенно когда темы хорошо разделены․ Сравнение моделей тематического моделирования (LDA vs NMF) – это отдельная большая тема, но на практике мы часто видим, что NMF может быть более интерпретируемым в некоторых случаях, в то время как LDA лучше справляется с определением вероятностного распределения тем․

Классификация текстов: Сортируем и организуем

Классификация текстов – это задача присвоения тексту одной или нескольких категорий из заранее определенного набора․ Это может быть спам/не спам, позитивный/негативный отзыв, спортивная/политическая новость и т․д․․ Это одна из самых распространенных и полезных задач в NLP․ Мы используем библиотеку Scikit-learn как нашу отправную точку для классификации, применяя такие алгоритмы, как SVM (Support Vector Machines) и Наивный Байесовский классификатор, которые показали свою эффективность на многих задачах․

Для более сложных сценариев, где традиционные методы машинного обучения достигают своих пределов, мы переходим к глубокому обучению․ Применение PyTorch/TensorFlow для создания нейросетей NLP, таких как LSTM (Long Short-Term Memory), позволяет нам улавливать сложные зависимости в последовательностях слов․ А с появлением моделей-трансформеров, таких как BERT, мы достигли нового уровня точности в классификации текстов, используя их либо как мощные векторизаторы, либо для тонкой настройки (fine-tuning) под конкретную задачу․

Извлечение информации: Ключевые фразы и суммаризация

Извлекать ключевые фразы или создавать краткое содержание – это еще две невероятно полезные задачи․ Представьте, что вам нужно быстро понять суть длинной статьи или документа․

Вот список задач, которые мы решаем в этой категории:

- Анализ текста для извлечения ключевых фраз: Мы используем алгоритмы типа RAKE (Rapid Automatic Keyword Extraction) или методы, основанные на TF-IDF, чтобы автоматически находить наиболее значимые слова и фразы в тексте․

- Использование библиотеки TextRank для извлечения ключевых предложений и суммаризации: TextRank – это алгоритм, основанный на графах, который определяет важность предложений или слов в тексте, позволяя создавать экстрактивные суммаризации (когда суммарный текст состоит из наиболее важных предложений оригинала)․

- Разработка системы суммаризации текста (Abstractive vs Extractive): Мы работаем как с экстрактивными методами, которые выбирают наиболее важные предложения из исходного текста, так и с абстрактивными методами, которые генерируют новый, сжатый текст, перефразируя исходный (что гораздо сложнее и часто требует трансформерных моделей)․

- Разработка систем вопросно-ответных систем (QA): Создание систем, которые могут отвечать на вопросы, заданные на естественном языке, на основе предоставленных документов․

"Язык, это дорожная карта культуры․ Он говорит нам, откуда пришли его люди и куда они идут․" – Рита Мэй Браун

Эра Трансформеров: Новый уровень NLP

Если бы нас попросили назвать одно событие, которое кардинально изменило ландшафт NLP в последние годы, мы бы без колебаний указали на появление архитектуры Трансформеров (Transformers)․ Это стало настоящей революцией, позволившей машинам не просто обрабатывать язык, а по-настоящему "понимать" его контекст, зависимости и тончайшие нюансы․ Трансформеры значительно превзошли предыдущие рекуррентные и сверточные нейронные сети в задачах, связанных с последовательностями, и открыли путь к созданию невероятно мощных языковых моделей․

Для нас это означало переход на новый уровень сложности и возможностей․ Мы начали переосмысливать подходы к решению многих задач, которые раньше казались трудоемкими или вообще неразрешимыми с предыдущими технологиями․ Работа с трансформерами требует понимания новых концепций, но вознаграждает нас беспрецедентной производительностью и точностью․

Hugging Face и предобученные модели

Ключевую роль в распространении трансформерных моделей сыграла библиотека Hugging Face Transformers․ Она стала де-факто стандартом для работы с такими гигантами, как BERT (Bidirectional Encoder Representations from Transformers), GPT (Generative Pre-trained Transformer), RoBERTa, T5 и многими другими․ Эти модели, предварительно обученные на огромных массивах текста, уже обладают глубоким пониманием языка и могут быть адаптированы (тонкая настройка — Fine-tuning) под конкретные задачи с относительно небольшим объемом размеченных данных․

Мы используем трансформеры для широкого спектра задач:

- Разработка систем вопросно-ответных систем (QA): Трансформеры позволяют нам создавать системы, способные находить точные ответы на вопросы в больших текстовых корпусах․

- Использование Transformer-моделей для генерации текста (GPT): Мы экспериментируем с генерацией связных и осмысленных текстов, от маркетинговых слоганов до черновиков статей․

- Использование Transformer-моделей для генерации диалогов: Создание более естественных и контекстно-зависимых чат-ботов․

- Использование Transformer-моделей для машинного перевода: Достижение высокого качества перевода, особенно в специализированных областях;

- Использование трансформеров для анализа кода (сжатие кода, генерация кода): Применение NLP-техник к исходному коду для его анализа и оптимизации․

- Тонкая настройка (Fine-tuning) предварительно обученных моделей: Адаптация BERT для задач классификации, NER или анализа тональности, что значительно повышает производительность по сравнению с обучением с нуля․

Возможности трансформеров кажутся безграничными, и мы с увлечением исследуем новые способы их применения․

Нейросети и глубокое обучение

До появления трансформеров, нейронные сети, особенно рекуррентные нейронные сети (RNN) и их разновидности, такие как LSTM (Long Short-Term Memory), были передовыми моделями для многих задач NLP․ Мы активно применяли PyTorch/TensorFlow для создания нейросетей NLP, используя LSTM для классификации текстов, распознавания последовательностей и даже простых систем машинного перевода․ LSTM отлично справлялись с захватом долгосрочных зависимостей в тексте, что было критично для понимания сложных предложений․

Хотя трансформеры сейчас доминируют, понимание основ нейросетей и глубокого обучения остается фундаментальным․ Мы часто используем GPU-ускорение для обработки текста, особенно когда работаем с большими моделями или объемными наборами данных․ Это позволяет нам значительно сократить время обучения и увеличить скорость инференса, делая наши решения более практичными и масштабируемыми․ Глубокое обучение продолжает развиваться, и мы всегда следим за новейшими архитектурами и подходами, чтобы оставаться на переднем крае технологий․

NLP в реальном мире: Прикладные решения и инструменты

Теория и модели – это прекрасно, но истинная ценность NLP проявляется в его практическом применении․ Мы постоянно работаем над тем, чтобы наши знания и навыки превращались в реальные, работающие решения, которые помогают решать конкретные задачи и приносят пользу․ Наш опыт охватывает широкий спектр прикладных областей, от извлечения данных до создания интеллектуальных ассистентов․

Работа с различными источниками данных

Текст редко приходит к нам в идеально чистом виде․ Часто нам приходится извлекать его из разнообразных и порой сложных источников:

- Библиотека Beautiful Soup для веб-скрейпинга текста: Мы регулярно используем Beautiful Soup для извлечения текстового контента с веб-страниц, что является первым шагом для анализа онлайн-данных, таких как новости, блоги или отзывы․

- Использование PyMuPDF для извлечения текста из PDF: PDF-документы – это распространенный формат для юридических, финансовых и научных текстов․ PyMuPDF позволяет нам эффективно извлекать текст, даже если он представлен в сложном форматировании․

- Анализ текста в медицинских записях, юридических контрактах, финансовых отчетах: Эти области требуют специализированных подходов и высокой точности, так как ошибки могут иметь серьезные последствия․ Мы разрабатываем кастомизированные пайплайны для извлечения ключевой информации из этих чувствительных документов․

- Использование Python для анализа лог-файлов: Логи содержат огромное количество текстовой информации, которая может быть использована для мониторинга систем, обнаружения аномалий и диагностики проблем․

- Обработка больших текстовых массивов (Big Data NLP): Когда объем данных исчисляется терабайтами, нам приходится применять распределенные вычисления и оптимизированные алгоритмы, используя библиотеки типа Gensim для работы с большими корпусами․

Мультиязычный NLP

Мир не ограничивается английским языком․ Мы постоянно сталкиваемся с необходимостью обработки многоязычных текстовых корпусов․ Для языков с богатой морфологией, таких как русский, финский или турецкий, стандартные английские подходы часто не работают․ Здесь на помощь приходят специализированные библиотеки:

- Использование библиотеки Polyglot для мультиязычности: Polyglot предоставляет широкий спектр функций для различных языков, включая NER, токенизацию, анализ тональности․

- Использование Stanza для языков с богатой морфологией (и русского языка): Stanza (от Stanford NLP Group) предлагает высококачественные модели для многих языков, включая русский, с продвинутой лемматизацией и синтаксическим парсингом․

- Работа с нелатинскими алфавитами в Python NLP: Это отдельный вызов, требующий правильной кодировки, шрифтов и моделей, обученных на соответствующих языковых корпусах․

Мы также активно работаем над разработкой систем машинного перевода на Python, используя как классические подходы, так и современные трансформерные архитектуры, а также разработку систем для автоматического перевода узкоспециализированных текстов, где требуется высокая точность и знание предметной области․

Создание интеллектуальных систем

Наши проекты часто включают создание полноценных интеллектуальных систем, которые взаимодействуют с пользователями или автоматизируют сложные процессы:

- Разработка чат-ботов на Python (Rasa framework): Rasa – это мощный фреймворк для создания контекстно-зависимых диалоговых систем, которые могут понимать намерения пользователя и генерировать осмысленные ответы․

- Разработка систем вопросно-ответных систем (QA): Создание систем, которые могут отвечать на вопросы, заданные на естественном языке, на основе предоставленных документов․

- Разработка системы для создания FAQ на основе документов: Автоматическое формирование списка часто задаваемых вопросов и ответов из существующих текстовых ресурсов․

- Разработка систем автоматической категоризации статей/новостей/контента: Автоматическое присвоение тегов и категорий входящему контенту․

Анализ стилистики и уникальности

Помимо семантики, мы также глубоко погружаемся в анализ стиля и уникальности текста:

- Анализ стилистики текстов (авторский почерк): Мы разрабатываем инструменты для определения авторства текста, анализа лексического богатства, сложности и уникальных стилистических паттернов․

- Разработка систем обнаружения плагиата: Сравнение документов на предмет сходства, используя методы, такие как TextDistance, Doc2Vec и векторизация․

- Разработка инструментов для проверки грамматики и синтаксиса: Создание систем, которые помогают улучшить качество написанного текста․

- Использование библиотеки Jellyfish для сравнения строк: Полезна для поиска нечетких совпадений и исправления опечаток․

Визуализация текстовых данных

Визуализация является неотъемлемой частью любого анализа․ Она помогает нам и нашим заказчикам быстро понять основные закономерности в текстовых данных:

- Инструменты для визуализации текстовых данных (Word Clouds, Heatmaps): Облака слов дают быстрое представление о наиболее часто встречающихся словах, а тепловые карты могут показывать корреляции между темами или сущностями․

Вызовы и перспективы: Куда движется NLP?

Несмотря на все достижения, область NLP всё ещё сталкивается с рядом серьезных вызовов․ Мы постоянно работаем с проблемами обработки неполных и ошибочных данных, которые встречаются в реальных текстовых корпусах․ Анализ тональности сообщений в социальных сетях с учетом сарказма, иронии, сленга и эмодзи остается одной из сложнейших задач, требующей глубокого контекстуального понимания․

Мы также видим, что этические аспекты и предвзятость в языковых моделях становятся всё более актуальными․ Модели, обученные на огромных массивах текста из интернета, могут усваивать и воспроизводить социальные стереотипы и предрассудки, что требует от нас ответственного подхода к их разработке и внедрению․

Будущее NLP выглядит невероятно захватывающим․ Мы наблюдаем стремительное развитие Transformer-моделей, которые становятся всё более мощными и универсальными․ Обработка текста в режиме реального времени (Streaming NLP), персонализированные языковые модели, мультимодальный NLP (объединяющий текст с изображениями, видео и звуком) – это лишь некоторые из направлений, которые мы активно исследуем․ Наш путь в мире NLP – это бесконечное обучение и адаптация к новым технологиям․

Наши любимые инструменты и библиотеки

За годы работы мы собрали внушительный арсенал инструментов, каждый из которых доказал свою эффективность в определенных задачах․ Вот краткий обзор библиотек, которые мы чаще всего используем в наших проектах по NLP на Python:

| Категория | Библиотеки/Инструменты | Основные функции |

|---|---|---|

| Базовая предобработка | NLTK, spaCy, re (модуль регулярных выражений) | Токенизация, стемминг, лемматизация, удаление стоп-слов, очистка текста |

| Векторизация текста | Scikit-learn (CountVectorizer, TfidfVectorizer), Gensim (Word2Vec, GloVe, FastText, Doc2Vec), Hugging Face Transformers (для контекстных эмбеддингов) | Преобразование текста в числовые векторы для машинного обучения |

| Распознавание именованных сущностей (NER) | spaCy, Flair, Hugging Face Transformers (BERT, RoBERTa) | Идентификация и классификация имен, мест, организаций и т․д․ |

| Анализ тональности | VADER, TextBlob, Hugging Face Transformers | Определение эмоциональной окраски текста (позитивный, негативный, нейтральный) |

| Тематическое моделирование | Gensim (LDA, LSI, NMF) | Выявление скрытых тем в больших коллекциях документов |

| Классификация текстов | Scikit-learn (SVM, Наивный Байесовский классификатор), PyTorch/TensorFlow (LSTM, CNN), Hugging Face Transformers | Присвоение тексту одной или нескольких категорий |

| Трансформеры и глубокое обучение | Hugging Face Transformers, PyTorch, TensorFlow | Работа с предобученными моделями (BERT, GPT), создание и обучение нейросетей |

| Извлечение информации | TextRank, RAKE, Beautiful Soup (веб-скрейпинг), PyMuPDF (PDF-документы) | Извлечение ключевых фраз, суммаризация, скрейпинг данных, извлечение из PDF |

| Мультиязычный NLP | Polyglot, Stanza | Обработка текста на различных языках, работа с богатой морфологией |

| Создание диалоговых систем | Rasa framework | Разработка чат-ботов и вопросно-ответных систем |

Мы подошли к концу нашего обширного обзора мира NLP на Python․ Надеемся, что это путешествие было для вас таким же увлекательным, как и для нас, когда мы делились нашим опытом․ От самых простых шагов по предобработке текста до применения передовых трансформерных моделей – мы увидели, как Python предоставляет невероятно мощный и гибкий инструментарий для работы с естественным языком․

Каждый день в этой области происходят новые открытия, появляются новые библиотеки и модели․ Что было передовым вчера, сегодня уже становится стандартом, а завтра – частью фундамента․ Мы призываем вас не останавливаться на достигнутом, экспериментировать, пробовать новые подходы и создавать свои собственные удивительные проекты․ Мир NLP огромен и полон нераскрытых возможностей․ Присоединяйтесь к нам в этом захватывающем приключении, и давайте вместе продолжим разгадывать язык машин!

Подробнее

| NLTK основы | spaCy NER | Gensim LDA | Scikit-learn текст | Word2Vec обучение |

| Анализ тональности | TextBlob NLP | Hugging Face Transformers | Python regex текст | Продвинутая лемматизация |