- Разгадывая Язык Машин: Наш Полный Путеводитель по Миру NLP с Python

- Первые Шаги в Мир Текста: Основы Предобработки

- NLTK и spaCy: Наши Первые Помощники

- Токенизация и Стемминг с NLTK

- Продвинутая Лемматизация и Стемминг

- Регулярные Выражения (re) в Предобработке Текста

- Представление Текста для Машин: От Слов к Векторам

- Разработка Собственных Векторизаторов Текста

- CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Word2Vec и GloVe

- FastText и Doc2Vec

- Векторизация Предложений и Документов: Sentence Transformers

- Ключевые Задачи NLP: От Распознавания до Генерации

- Распознавание Именованных Сущностей (NER) с spaCy и Flair

- Использование spaCy для Быстрого NER

- Библиотека Flair для Современного NER

- Тематическое Моделирование с Gensim: LDA и LSI

- Библиотека Gensim для Тематического Моделирования (LDA, LSI)

- Анализ Тональности (Sentiment Analysis)

- Анализ Тональности с VADER и TextBlob

- Продвинутый Анализ Тональности: Учет Сарказма и Эмодзи

- Классификация Текстов с Scikit-learn и Глубоким Обучением

- Применение Scikit-learn для Классификации Текстов

- Использование PyTorch/TensorFlow для Создания Нейросетей NLP

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение BERT для Задач Классификации и NER

- Использование Transformer-моделей для Генерации Текста (GPT) и Диалогов

- Разработка Систем Вопросно-ответных Систем (QA)

- Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

- Применение RAKE и TextRank для Извлечения Ключевых Слов

- Разработка Системы Суммаризации Текста (Abstractive vs Extractive)

- Практические Инструменты и Приложения NLP

- Работа с Различными Источниками Текста

- Библиотека Beautiful Soup для Веб-скрейпинга Текста

- Использование PyMuPDF для Извлечения Текста из PDF

- Многоязычный NLP и Специализированные Задачи

- Обработка Многоязычных Текстовых Корпусов с Polyglot и Stanza

- Анализ Стилистики Текстов и Определение Авторства

- Разработка Чат-ботов на Python (Rasa Framework)

- Работа с Неструктурированными и "Грязными" Данными

- Обработка Неструктурированного Текста: Очистка Данных

- Анализ Текстов Отзывов Клиентов и Социальных Сетей

- Продвинутые Методы и Оптимизация

- Обработка Больших Текстовых Массивов (Big Data NLP)

- Использование GPU-ускорения для Обработки Текста

- Оценка и Сравнение Моделей

- Оценка Качества NER-моделей (F1-score, Precision, Recall)

- Сравнение Различных Методов и Алгоритмов

- Инструменты для Визуализации Текстовых Данных

- Завершение Нашего Путешествия

Разгадывая Язык Машин: Наш Полный Путеводитель по Миру NLP с Python

Приветствуем вас, дорогие читатели, в нашем увлекательном путешествии по необъятным просторам обработки естественного языка (NLP)! Если вы когда-либо задавались вопросом, как машины понимают и взаимодействуют с человеческим языком, как они могут анализировать эмоции, переводить тексты или даже генерировать их, то вы попали по адресу․ Мы, как давние исследователи и практики в этой области, готовы поделиться нашим опытом и знаниями, проведя вас от самых азов до продвинутых концепций, которые сегодня формируют будущее искусственного интеллекта․

Наш мир переполнен текстами: от миллиардов сообщений в социальных сетях и электронных писем до гигантских архивов научных статей и юридических документов․ Вся эта информация обладает колоссальной ценностью, но ее объем настолько велик, что человеку просто не под силу обработать ее вручную․ Именно здесь на помощь приходит NLP – дисциплина на стыке лингвистики, компьютерных наук и искусственного интеллекта, которая позволяет машинам не просто "читать" текст, а по-настоящему "понимать" его смысл, структуру и даже скрытые подтексты․ Мы покажем, как Python, с его богатой экосистемой библиотек, стал де-факто стандартом для разработки NLP-решений, открывая перед нами безграничные возможности․

Первые Шаги в Мир Текста: Основы Предобработки

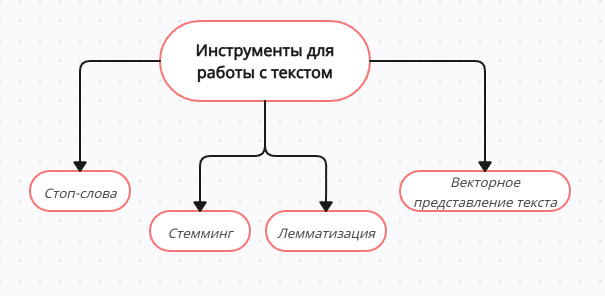

Прежде чем машина сможет "понять" текст, его необходимо подготовить․ Представьте, что вы хотите научить ребенка читать: сначала мы учим его различать буквы, затем слова, и только потом предложения․ В NLP процесс очень похож, и начинается он с предобработки – этапа, на котором необработанный текст превращается в структурированные данные, пригодные для анализа․ Мы рассмотрим ключевые инструменты и методы, которые составляют основу любой NLP-задачи․

NLTK и spaCy: Наши Первые Помощники

Наши первые шаги в NLP часто начинаются с изучения таких фундаментальных библиотек, как NLTK (Natural Language Toolkit) и spaCy․ NLTK – это мощный набор инструментов, который идеально подходит для академических исследований и обучения; Он предоставляет нам доступ к огромному количеству корпусов, лексических ресурсов и алгоритмов для различных задач․ SpaCy, в свою очередь, известен своей скоростью и оптимизацией для производственных систем, предлагая нам готовые модели для различных языков и эффективные методы обработки․

Токенизация и Стемминг с NLTK

Когда мы говорим о тексте, первое, что нам нужно сделать, это разбить его на более мелкие, осмысленные единицы – токены․ Это могут быть слова, пунктуация, числа․ NLTK предлагает нам различные токенизаторы․ Например, для разбиения текста на слова мы часто используем word_tokenize, а для предложений – sent_tokenize․ Это кажется простым, но выбор правильного токенизатора критически важен, особенно когда мы работаем с текстами, содержащими аббревиатуры, числа или специфические символы․

После токенизации мы часто сталкиваемся с проблемой вариативности слов: "бежать", "бежит", "бежал" – все это формы одного и того же глагола․ Стемминг (удаление суффиксов и окончаний) – один из способов привести эти слова к их базовой форме, или "стволу"․ NLTK предоставляет нам несколько стеммеров, таких как PorterStemmer и SnowballStemmer․ Хотя стемминг быстр и прост, он не всегда приводит к корректным словам, иногда создавая несуществующие "корни", что является его основным недостатком․

Пример токенизации и стемминга:

import nltk

from nltk․stem import PorterStemmer

from nltk․tokenize import word_tokenize

nltk․download('punkt') # Загружаем необходимые данные

text = "Мы любим изучать языки и программирование․"

tokens = word_tokenize(text)

print(f"Токены: {tokens}")

stemmer = PorterStemmer

stemmed_tokens = [stemmer․stem(word) for word in tokens]

print(f"Стемминг: {stemmed_tokens}")

Продвинутая Лемматизация и Стемминг

В отличие от стемминга, лемматизация стремится привести слово к его словарной форме (лемме), используя морфологический анализ․ Это означает, что "бежал" превратится в "бежать", а не в "беж", что гораздо полезнее для дальнейшего анализа․ SpaCy и NLTK (с WordNetLemmatizer) предлагают нам инструменты для лемматизации․ Мы часто предпочитаем лемматизацию стеммингу, когда точность и сохранение смысла слов имеют первостепенное значение, несмотря на то, что это более ресурсоемкий процесс․

Помимо NLTK и spaCy, существуют и другие библиотеки, такие как Stanza (от Stanford NLP Group), которые специализируются на языках с богатой морфологией, включая русский․ Stanza предлагает нам мощные пайплайны для выполнения всех этапов NLP, от токенизации до анализа зависимостей, с высокой точностью․ Мы обнаружили, что для сложных морфологических задач Stanza может быть незаменима․

Регулярные Выражения (re) в Предобработке Текста

Регулярные выражения, или RegEx (библиотека re в Python), являются нашими верными спутниками, когда речь заходит о тонкой настройке предобработки․ Они позволяют нам находить, извлекать и заменять текстовые паттерны любой сложности․ Например, мы можем использовать их для удаления HTML-тегов, очистки текста от пунктуации, извлечения email-адресов или URL-ссылок․ Это мощный инструмент, который дает нам полный контроль над структурой текста, позволяя нам превратить хаотичный ввод в чистые, стандартизированные данные․ Без регулярных выражений многие задачи очистки текста были бы гораздо более трудоемкими и менее надежными․

Представление Текста для Машин: От Слов к Векторам

Машины не понимают слова в человеческом смысле․ Для них текст – это просто последовательность символов․ Чтобы компьютер мог работать с языком, нам необходимо преобразовать слова и фразы в числовые представления, или векторы․ Этот процесс называется векторизацией текста, и он является одним из краеугольных камней современного NLP․ Мы рассмотрим различные подходы к векторизации, от простых до самых продвинутых․

Разработка Собственных Векторизаторов Текста

Начнем с классических методов, которые до сих пор широко используются благодаря своей простоте и эффективности․

CountVectorizer и TfidfVectorizer

CountVectorizer из библиотеки Scikit-learn – это наш самый простой способ превратить коллекцию текстовых документов в матрицу подсчета токенов․ Каждая строка матрицы соответствует документу, а каждый столбец – уникальному слову (токену) во всем корпусе․ Значение в ячейке – это просто количество вхождений слова в документ․ Это отличный способ для начала, но он не учитывает важность слова․

Здесь на сцену выходит TfidfVectorizer (Term Frequency-Inverse Document Frequency)․ Этот векторизатор не просто считает слова, но и взвешивает их, придавая большее значение словам, которые часто встречаются в конкретном документе, но редко – во всем корпусе․ Таким образом, мы можем выделить слова, которые являются уникальными и важными для каждого документа, игнорируя при этом общие слова, такие как "и", "в", "на", которые встречаются повсеместно и не несут особой смысловой нагрузки․ Мы часто используем TF-IDF для задач классификации и поиска похожих документов․

Сравнение CountVectorizer и TfidfVectorizer:

| Характеристика | CountVectorizer | TfidfVectorizer |

|---|---|---|

| Метод | Прямой подсчет вхождений слов | Взвешивание слов по частоте и редкости |

| Результат | Матрица частот | Матрица TF-IDF значений |

| Преимущества | Простота, интуитивность | Выделение важных слов, снижение веса общих слов |

| Недостатки | Не учитывает важность слова, чувствителен к стоп-словам | Сложнее интерпретировать, может быть медленнее для больших корпусов |

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

Классические методы векторизации рассматривают слова как независимые сущности․ Однако язык устроен гораздо сложнее: слова имеют смысл, контекст, отношения друг с другом․ Здесь на помощь приходят эмбеддинги слов (Word Embeddings) – плотные векторные представления, которые улавливают семантические и синтаксические отношения между словами․ Мы часто говорим, что "слова, которые встречаются в похожих контекстах, имеют схожий смысл", и эмбеддинги блестяще это демонстрируют․

Word2Vec и GloVe

Word2Vec, разработанный Google, стал революцией в этой области․ Он предлагает нам два архитектурных подхода: Skip-gram и CBOW (Continuous Bag of Words); Skip-gram пытается предсказать контекстные слова, зная текущее слово, в то время как CBOW делает наоборот – предсказывает текущее слово на основе его контекста․ Мы обнаружили, что Skip-gram часто дает лучшие результаты для редких слов․

GloVe (Global Vectors for Word Representation) – это еще один популярный метод, который сочетает в себе глобальные статистические данные о частоте совместного появления слов с локальными контекстными окнами․ Эти модели позволяют нам выполнять удивительные вещи, например, находить аналогии: "король" ⸺ "мужчина" + "женщина" = "королева"․ Библиотека Gensim предоставляет нам удобные инструменты для обучения и работы с Word2Vec и GloVe, а также предварительно обученными моделями, что значительно упрощает нашу работу․

FastText и Doc2Vec

FastText, расширение Word2Vec от Facebook, решает проблему редких слов и слов, отсутствующих в словаре (Out-Of-Vocabulary, OOV), путем представления слов как суммы их n-грам символов․ Это означает, что даже если слово не встречалось во время обучения, FastText может создать для него вектор на основе его подслов․ Это особенно полезно для языков с богатой морфологией․

Doc2Vec (Paragraph Vectors), также из Gensim, развивает идею Word2Vec, позволяя нам создавать векторные представления для целых документов или абзацев․ Это открывает нам двери для задач, таких как поиск похожих документов, кластеризация текстов и построение рекомендательных систем на основе содержания․

Векторизация Предложений и Документов: Sentence Transformers

Современные подходы, такие как Sentence Transformers, позволяют нам создавать высококачественные эмбеддинги не только для отдельных слов, но и для целых предложений и даже документов․ Эти модели, часто основанные на архитектуре трансформеров, способны улавливать контекст и нюансы смысла, что делает их незаменимыми для задач сравнения текстов, поиска семантической схожести и кластеризации․

Ключевые Задачи NLP: От Распознавания до Генерации

Имея средства для представления текста в числовом виде, мы можем приступить к решению более сложных и интересных задач․ Мы погрузимся в мир распознавания сущностей, тематического моделирования, анализа тональности и многих других областей, где NLP демонстрирует свою истинную силу․

Распознавание Именованных Сущностей (NER) с spaCy и Flair

Распознавание именованных сущностей (Named Entity Recognition, NER) – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, организаций, географические названия, даты и т․д․․ Это критически важный шаг для извлечения информации из неструктурированного текста․

Использование spaCy для Быстрого NER

SpaCy предлагает нам высокооптимизированные и точные модели для NER "из коробки"․ Мы часто используем spaCy, когда нам нужна быстрая и надежная идентификация стандартных типов сущностей․ Его простой API позволяет нам легко интегрировать NER в наши рабочие процессы․ Для многих практических задач spaCy является золотым стандартом․

Библиотека Flair для Современного NER

Flair – это относительно новая, но очень мощная библиотека, которая использует глубокие контекстуальные строковые эмбеддинги для NER․ Она часто демонстрирует передовые результаты, особенно для языков с богатой морфологией и когда нам нужно распознавать пользовательские типы сущностей․ Flair также поддерживает CRF (Conditional Random Fields) для распознавания сущностей, что является классическим, но все еще эффективным методом, особенно когда у нас есть ограниченный набор размеченных данных․

Тематическое Моделирование с Gensim: LDA и LSI

Тематическое моделирование позволяет нам обнаруживать скрытые "темы" в больших коллекциях документов․ Это невероятно полезно для понимания основного содержания и структуры текстовых данных без необходимости ручного чтения каждого документа․

Библиотека Gensim для Тематического Моделирования (LDA, LSI)

Gensim является нашей основной библиотекой для тематического моделирования․ Он предоставляет нам реализации таких алгоритмов, как LSI (Latent Semantic Indexing) и LDA (Latent Dirichlet Allocation)․ LSI основан на сингулярном разложении (SVD) матрицы "слово-документ" и выявляет скрытые семантические связи․ LDA, в свою очередь, является вероятностной моделью, которая предполагает, что каждый документ представляет собой смесь нескольких тем, и каждая тема характеризуется распределением слов․

Когда мы стоим перед выбором между LDA и NMF (Non-Negative Matrix Factorization), мы часто учитываем природу наших данных․ LDA, будучи вероятностной моделью, часто более интерпретируем, но NMF может быть более эффективным для очень больших разреженных матриц и иногда дает более четкие темы․ Мы часто экспериментируем с обоими подходами, чтобы найти наилучшее соответствие для конкретной задачи․

Анализ Тональности (Sentiment Analysis)

Анализ тональности, или сентимент-анализ, – это процесс определения эмоциональной окраски текста (положительной, отрицательной, нейтральной)․ Это незаменимый инструмент для анализа отзывов клиентов, мониторинга социальных сетей, понимания общественного мнения и многого другого․

Анализ Тональности с VADER и TextBlob

VADER (Valence Aware Dictionary and sEntiment Reasoner) – это правило-ориентированный анализатор тональности, специально обученный на текстах из социальных сетей․ Он отлично справляется с учетом знаков препинания, капитализации и усиления, что делает его очень эффективным для коротких, неформальных текстов․ Мы любим VADER за его простоту использования и отсутствие необходимости в предварительном обучении․

TextBlob – это еще одна легкая библиотека для NLP, которая предоставляет простой API для выполнения различных задач, включая анализ тональности․ Она использует свою собственную модель, основанную на Pattern, и выдает оценку полярности (от -1 до 1) и субъективности (от 0 до 1)․ TextBlob идеально подходит для быстрого прототипирования и простых задач․

"Язык – это карта дорог для нашей мысли․"

– Людвиг Витгенштейн

Эта цитата прекрасно отражает нашу миссию в NLP: мы стремимся не просто обрабатывать слова, но и понимать те мысли и идеи, которые они выражают, прокладывая новые пути для взаимодействия человека и машины․

Продвинутый Анализ Тональности: Учет Сарказма и Эмодзи

Современные тексты, особенно в социальных сетях, часто содержат сарказм, иронию, эмодзи и сленг, что значительно усложняет анализ тональности․ Для таких задач мы часто прибегаем к более продвинутым моделям, основанным на глубоком обучении и трансформерах, которые способны улавливать тонкие нюансы контекста․ Разработка инструментов для нормализации сленга и учета эмодзи становится критически важной для получения точных результатов․

Классификация Текстов с Scikit-learn и Глубоким Обучением

Классификация текстов – это одна из самых распространенных задач в NLP, где мы присваиваем документу одну или несколько предопределенных категорий․ Это может быть спам-фильтрация, категоризация новостей, определение жанра статьи и т․д․

Применение Scikit-learn для Классификации Текстов

Scikit-learn предлагает нам богатый набор алгоритмов машинного обучения, которые идеально подходят для классификации текстов․ После векторизации текста (например, с помощью TF-IDF), мы можем использовать такие модели, как SVM (Support Vector Machines), Наивный Байесовский классификатор (Naive Bayes), Логистическая Регрессия и многие другие․ Мы часто начинаем с этих методов, так как они относительно просты в реализации и интерпретации, при этом демонстрируя отличные результаты для многих задач․

Использование PyTorch/TensorFlow для Создания Нейросетей NLP

Для более сложных задач классификации, особенно когда у нас есть большие объемы данных, мы обращаемся к глубокому обучению․ PyTorch и TensorFlow – это наши основные фреймворки для создания нейросетей․ LSTM (Long Short-Term Memory) сети, например, долгое время были популярны для последовательных данных, таких как текст, благодаря их способности запоминать информацию на долгих промежутках․ Сегодня мы все чаще используем трансформерные архитектуры, которые показывают беспрецедентные результаты․

Трансформеры (Hugging Face) для Сложных Задач NLP

Трансформеры произвели революцию в NLP․ Они основаны на механизме внимания, который позволяет модели взвешивать важность различных частей входной последовательности при обработке․ Библиотека Hugging Face Transformers стала де-факто стандартом для работы с этими моделями, предоставляя нам доступ к сотням предварительно обученных моделей, таких как BERT, GPT, RoBERTa и многим другим․

Применение BERT для Задач Классификации и NER

BERT (Bidirectional Encoder Representations from Transformers) – это одна из самых влиятельных моделей-трансформеров․ Она обучена на огромных объемах текста и способна понимать контекст слова, учитывая его окружение с обеих сторон․ Мы используем BERT для тонкой настройки (fine-tuning) под конкретные задачи, такие как классификация текстов, NER, вопросно-ответные системы и многое другое․ Его способность улавливать тонкие семантические нюансы значительно повышает точность наших моделей․

Использование Transformer-моделей для Генерации Текста (GPT) и Диалогов

Модели, такие как GPT (Generative Pre-trained Transformer), демонстрируют удивительные способности в генерации текста․ Они могут писать связные и осмысленные тексты, отвечать на вопросы, перефразировать предложения и даже генерировать код․ Мы используем их для создания систем суммаризации текста (как абстрактивной, так и экстрактивной), разработки чат-ботов и других задач, где требуется порождение нового текста․ Генерация диалогов с использованием трансформеров открывает нам путь к созданию более естественных и интеллектуальных разговорных агентов․

Разработка Систем Вопросно-ответных Систем (QA)

Вопросно-ответные системы (QA) – это системы, которые могут отвечать на вопросы, заданные на естественном языке, используя предоставленный текст или базу знаний․ Это одна из самых сложных и интересных задач в NLP, требующая глубокого понимания текста․

Мы используем трансформерные модели, такие как BERT, которые могут быть тонко настроены для задачи QA․ Эти модели способны находить точные фрагменты текста, содержащие ответ на вопрос․ Разработка систем для создания FAQ на основе документов также является важным направлением, где QA-технологии находят свое применение, автоматизируя процесс извлечения информации и предоставления ответов пользователям․

Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

Извлечение ключевых фраз и суммаризация текста помогают нам быстро понять основное содержание больших документов․

Применение RAKE и TextRank для Извлечения Ключевых Слов

RAKE (Rapid Automatic Keyword Extraction) – это простой, но эффективный алгоритм для извлечения ключевых фраз из текста․ Он основан на статистических свойствах слов и их встречаемости․ TextRank, вдохновленный алгоритмом PageRank, строит граф слов и предложений, а затем ранжирует их по степени важности, позволяя нам извлекать как ключевые слова, так и ключевые предложения для экстрактивной суммаризации․

Разработка Системы Суммаризации Текста (Abstractive vs Extractive)

Суммаризация текста делится на два основных типа: экстрактивная и абстрактивная․ Экстрактивная суммаризация выбирает наиболее важные предложения из исходного текста и объединяет их․ Абстрактивная суммаризация, в свою очередь, генерирует новые предложения, которые передают суть исходного текста, подобно тому, как это делает человек․ Для абстрактивной суммаризации мы часто используем трансформерные модели, которые способны к генерации нового, связного текста․

Практические Инструменты и Приложения NLP

Теперь, когда мы рассмотрели основные концепции и задачи, давайте перейдем к практическим инструментам и сценариям их применения, которые мы используем в нашей повседневной работе․

Работа с Различными Источниками Текста

Текст может поступать к нам из самых разных источников, и каждый из них требует особого подхода․

Библиотека Beautiful Soup для Веб-скрейпинга Текста

Когда нам нужно извлечь текст с веб-страниц, Beautiful Soup – это наш незаменимый инструмент․ Он позволяет нам парсить HTML и XML документы, находить нужные элементы и извлекать их содержимое․ После скрейпинга мы часто используем регулярные выражения для очистки текста от HTML-тегов, скриптов и других нежелательных элементов, чтобы получить чистый, пригодный для анализа текст․

Использование PyMuPDF для Извлечения Текста из PDF

PDF-документы остаются одним из самых распространенных форматов для хранения информации․ Библиотека PyMuPDF (или Fitz) позволяет нам эффективно извлекать текст, изображения и метаданные из PDF-файлов․ Мы используем ее для автоматизации обработки юридических документов, научных статей и отчетов, где данные часто заблокированы в PDF-формате․

Многоязычный NLP и Специализированные Задачи

Мир не ограничивается одним языком, и наши NLP-решения должны быть готовы к работе с многоязычными данными․

Обработка Многоязычных Текстовых Корпусов с Polyglot и Stanza

Библиотека Polyglot предоставляет нам простой интерфейс для работы с различными языками, включая определение языка, токенизацию, NER и анализ тональности для многих языков․ Stanza, как уже упоминалось, также отлично подходит для многоязычного NLP, особенно для языков со сложной морфологией․

Разработка систем машинного перевода на Python, хотя и является очень сложной задачей, также стала более доступной благодаря трансформерным моделям․ Мы можем использовать предварительно обученные модели (например, из Hugging Face) и тонко настраивать их для конкретных языковых пар или доменов, что позволяет создавать системы автоматического перевода узкоспециализированных текстов․

Анализ Стилистики Текстов и Определение Авторства

Анализ стилистики текстов, или стилометрия, позволяет нам изучать авторский почерк, выявлять уникальные черты письма․ Это используется для определения авторства текста, анализа литературных стилей или даже для выявления плагиата․ Мы используем различные метрики, такие как частотность слов и n-грамм, длина предложений, использование пунктуации, чтобы создать "отпечаток" стиля автора․

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты стали повсеместными, и Python является отличным выбором для их разработки․ Rasa – это мощный фреймворк с открытым исходным кодом, который позволяет нам создавать контекстно-зависимые разговорные ИИ․ Он включает в себя модули для понимания естественного языка (NLU) и управления диалогом, позволяя нам строить сложные и интерактивные чат-боты, способные решать широкий круг задач․

Работа с Неструктурированными и "Грязными" Данными

Реальный мир редко предлагает нам идеально чистые данные․ Мы постоянно сталкиваемся с неструктурированным, неполным и ошибочным текстом․

Обработка Неструктурированного Текста: Очистка Данных

Очистка данных – это один из самых трудоемких, но критически важных этапов․ Мы удаляем дубликаты, исправляем орфографические ошибки (с помощью таких библиотек, как TextBlob или собственных инструментов), нормализуем пунктуацию, работаем с нелатинскими алфавитами и обрабатываем неполные или отсутствующие данные․ Библиотека Jellyfish, например, помогает нам измерять сходство строк, что полезно для поиска дубликатов или исправления опечаток․

Анализ Текстов Отзывов Клиентов и Социальных Сетей

Отзывы клиентов и сообщения в социальных сетях – это золотая жила для бизнеса․ Мы используем NLP для анализа тональности сообщений (например, в Twitter/Reddit), выявления скрытых тем (с помощью тематического моделирования), анализа поведенческих паттернов в чатах и отзывах, а также для извлечения ключевых фраз и мнений о продуктах по категориям․ Это позволяет нам получать ценные инсайты о потребностях и настроениях нашей аудитории․

Продвинутые Методы и Оптимизация

Чтобы наши NLP-системы работали эффективно с большими объемами данных и демонстрировали высокую производительность, мы используем продвинутые методы и оптимизации․

Обработка Больших Текстовых Массивов (Big Data NLP)

Когда мы работаем с гигабайтами и терабайтами текста, обычные методы могут быть неэффективными․ Мы используем распределенные вычислительные системы и библиотеки, такие как Dask, PySpark или параллельные вычисления в Python, чтобы масштабировать наши NLP-процессы․ Оптимизация алгоритмов, таких как тематическое моделирование с Gensim, также играет ключевую роль․

Использование GPU-ускорения для Обработки Текста

Глубокое обучение в NLP, особенно с трансформерными моделями, требует значительных вычислительных ресурсов․ Мы активно используем GPU-ускорение с PyTorch и TensorFlow, чтобы значительно сократить время обучения и инференса наших моделей․ Это позволяет нам экспериментировать с более крупными моделями и быстрее получать результаты․

Оценка и Сравнение Моделей

Как понять, насколько хороша наша NLP-модель? Оценка и сравнение моделей – это неотъемлемая часть нашего рабочего процесса․

Оценка Качества NER-моделей (F1-score, Precision, Recall)

Для оценки качества моделей NER мы используем стандартные метрики, такие как Precision (точность), Recall (полнота) и F1-score․ Precision показывает, сколько из распознанных сущностей были верными, Recall – сколько верных сущностей было найдено, а F1-score – это гармоническое среднее Precision и Recall․ Эти метрики помогают нам понять, насколько хорошо наша модель справляется с задачей․

Сравнение Различных Методов и Алгоритмов

Мы постоянно сравниваем различные методы и алгоритмы для решения одной и той же задачи․ Например:

- Сравнение моделей тематического моделирования: LDA vs NMF․

- Сравнение методов машинного обучения для NLP: SVM, Наивный Байесовский классификатор, Логистическая Регрессия․

- Сравнение библиотек для лемматизации: SpaCy vs NLTK․

- Сравнение различных методов векторизации: TF-IDF vs Word2Vec vs Doc2Vec․

- Сравнение алгоритмов кластеризации: K-Means vs DBSCAN․

- Сравнение моделей Word2Vec: Skip-gram vs CBOW․

Такие сравнения позволяют нам выбрать наиболее подходящий инструмент для конкретной задачи и оптимизировать производительность нашей системы․

Инструменты для Визуализации Текстовых Данных

Визуализация помогает нам понять наши текстовые данные и результаты работы моделей․ Word Clouds (облака слов) – это простой и эффектный способ показать наиболее часто встречающиеся слова․ Heatmaps (тепловые карты) могут использоваться для визуализации матриц сходства или корреляции․ Мы также используем библиотеки, такие как Matplotlib, Seaborn, Plotly, для создания различных графиков и диаграмм, которые помогают нам выявлять паттерны, распределения и взаимосвязи в текстовых данных․

Например, библиотека Sweetviz может быть использована для быстрого анализа текстовых данных, предоставляя красивые и информативные визуализации для обзора данных, выявления пропущенных значений, а также для сравнения различных наборов данных․

Завершение Нашего Путешествия

Надеемся, наше глубокое погружение в мир обработки естественного языка с Python было для вас таким же увлекательным, как и для нас самих․ Мы прошли путь от самых азов предобработки текста до сложных архитектур трансформеров, рассмотрели множество библиотек и инструментов, которые позволяют нам разгадывать тайны человеческого языка и строить интеллектуальные системы․

Мир NLP постоянно развивается, и каждый день появляются новые открытия и методы․ Мы верим, что с этими знаниями и инструментами в вашем арсенале вы сможете не только эффективно решать текущие задачи, но и активно участвовать в формировании будущего этой захватывающей области․ Продолжайте учиться, экспериментировать и исследовать – возможности безграничны!

На этом статья заканчивается․

Подробнее

| Основы NLTK | SpaCy NER | Gensim LDA | Scikit-learn классификация | Word2Vec GloVe |

| Анализ тональности Python | Трансформеры Hugging Face | Разработка чат-ботов | Очистка текста Python | Многоязычный NLP |