- Разгадывая Язык Машин: Наш Путь в Захватывающий Мир NLP с Python

- Фундамент Понимания: Первые Шаги в Мире Текста

- От Хаоса к Структуре: Токенизация, Стемминг и Лемматизация

- Представление Текста: Как Машины "Видят" Слова

- Глубина Смысла: Word2Vec, GloVe и FastText

- Разгадывая Значение: От Частей Речи до Эмоций

- Распознавание Именованных Сущностей (NER) и Анализ Тональности

- Глубже в Смысл: Тематическое Моделирование и Классификация

- Поиск Скрытых Тем: LDA и LSI с Gensim

- Распределение по Категориям: Классификация Текстов

- Революция Трансформеров: Новый Уровень Понимания Языка

- Hugging Face и Предварительно Обученные Модели

- NLP в Действии: От Веб-Скрейпинга до Чат-Ботов

- Собираем Данные: Веб-Скрейпинг и Работа с Различными Форматами

- Создаем Интеллектуальные Системы: QA, Чат-боты и Суммаризация

- Вопросно-Ответные Системы (QA)

- Разработка Чат-ботов на Python

- Суммаризация Текста

- Тонкости и Нюансы: Продвинутые Методы и Визуализация

- Извлечение Ключевых Фраз и Анализ Стилистики

- Визуализация Данных: Делаем Невидимое Видимым

- Наши Вызовы и Взгляд в Будущее NLP

- Проблемы Данных: Неполнота, Ошибки и Предвзятость

- Масштаб и Производительность: Big Data NLP

Разгадывая Язык Машин: Наш Путь в Захватывающий Мир NLP с Python

Добро пожаловать, дорогие читатели, в мир, где машины начинают понимать человеческий язык! Мы, как опытные путешественники по бескрайним просторам данных, с огромным энтузиазмом делимся своим личным опытом погружения в одну из самых увлекательных областей искусственного интеллекта – обработку естественного языка, или NLP (Natural Language Processing). Это не просто набор алгоритмов и библиотек; это целое искусство, позволяющее компьютерам не только читать текст, но и извлекать из него смысл, эмоции, намерения. Мы уверены, что каждый из вас, кто хоть раз задумывался о том, как поисковики понимают наши запросы, как чат-боты отвечают на вопросы или как социальные сети анализируют настроение публики, найдет здесь что-то невероятно интересное и полезное для себя.

Наш путь в NLP начался с чистого любопытства. Мы видели, как мир вокруг нас наполняется текстовыми данными – от твитов и отзывов до научных статей и юридических документов. И мы задались вопросом: можем ли мы научить машины работать с этим хаосом слов, превращая его в структурированные знания? Ответ был однозначным: да, можем, и Python стал нашим верным проводником в этом приключении. Сегодня мы приглашаем вас присоединиться к нам, чтобы вместе исследовать основные концепции, мощные инструменты и передовые методы, которые мы освоили, работая с текстом на протяжении многих лет. Приготовьтесь, это будет увлекательное погружение!

Фундамент Понимания: Первые Шаги в Мире Текста

Прежде чем мы начнем строить сложные модели и обучать нейронные сети, нам необходимо освоить базовые принципы работы с текстом. Представьте, что вы хотите понять иностранный язык, не зная его алфавита, слов и грамматики. Это было бы невозможно! Точно так же и с машинами: сырой текст для них – это просто последовательность символов. Наша задача – разбить его на осмысленные единицы и привести к стандартному виду, чтобы алгоритмы могли его "переварить". Этот этап, известный как предобработка текста, является краеугольным камнем любого NLP-проекта.

От Хаоса к Структуре: Токенизация, Стемминг и Лемматизация

Первое, что мы делаем с текстом, это делим его на более мелкие, осмысленные единицы – токены. Этот процесс называется токенизацией. Токенами могут быть слова, знаки препинания, числа. Например, предложение "Мы любим NLP!" можно разбить на токены ["Мы", "любим", "NLP", "!"]. Для этого мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает различные токенизаторы, или же более производительный spaCy, который справляется с этим гораздо быстрее и умнее, учитывая особенности языка.

Мы также столкнулись с тем, что одно и то же слово может иметь разные формы: "бежать", "бежит", "бегал", "бегущий". Для машины это четыре разных слова, хотя смысл у них один – действие "бежать". Здесь на помощь приходят стемминг и лемматизация. Стемминг (от англ. stem – корень) обрезает окончания слов, оставляя их основу. Это быстрый, но иногда грубый метод, который может привести к "несуществующим" словам. Лемматизация же более интеллектуальна: она приводит слово к его начальной словарной форме (лемме) с учетом его части речи. Например, "бегущий" превратится в "бежать". Мы предпочитаем лемматизацию с помощью spaCy или Stanza, поскольку она сохраняет больше смысла и точности, что критически важно для дальнейшего анализа.

Вот как мы могли бы сравнить эти процессы:

| Оригинальное слово | Стемминг (Porter Stemmer) | Лемматизация (spaCy) |

|---|---|---|

| бегущий | бегущ | бежать |

| лучший | лучш | хороший |

| компьютеры | компьютер | компьютер |

Кроме того, на этапе предобработки мы удаляем стоп-слова (артикли, предлоги, союзы – "и", "в", "на", "он", "она"), которые часто встречаются, но не несут существенной смысловой нагрузки для большинства задач. Мы также используем регулярные выражения (`re` в Python) для очистки текста от HTML-тегов, специальных символов, ссылок и других "шумов", которые могут мешать анализу. Это своего рода генеральная уборка данных перед тем, как мы пригласим их на "аналитический бал".

Представление Текста: Как Машины "Видят" Слова

После того как текст очищен и токенизирован, возникает следующая задача: как преобразовать слова в числовой формат, понятный для математических моделей и алгоритмов машинного обучения? Ведь компьютеры работают с числами, а не с буквами. Здесь мы используем различные методы векторизации текста.

Наиболее распространенные из них, с которых мы начинали:

- CountVectorizer: Простейший метод, который создает вектор для каждого документа, где каждая позиция соответствует слову из всего корпуса текстов, а значение – количеству вхождений этого слова в документ.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Усовершенствованный CountVectorizer. Он не только учитывает, как часто слово встречается в документе (TF), но и как редко оно встречается во всем корпусе документов (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко – в других, получают больший вес, что позволяет выявить более значимые термины. Это было для нас настоящим откроветием, когда мы впервые применили его для извлечения ключевых слов!

Однако эти методы имеют свои ограничения: они не учитывают семантическую близость слов. То есть, "король" и "королева" для них так же далеки, как "король" и "банан". И вот тут мы открыли для себя мир векторных представлений слов (Word Embeddings).

Глубина Смысла: Word2Vec, GloVe и FastText

Word Embeddings – это плотные векторы, которые улавливают семантические и синтаксические отношения между словами. Слова с похожим значением или контекстом оказываются близко друг к другу в многомерном векторном пространстве.

Мы активно использовали:

- Word2Vec (Gensim): Эта модель, разработанная Google, обучается предсказывать слово по его контексту (Skip-gram) или контекст по слову (CBOW). Мы были поражены, когда обнаружили, что векторное представление "король" ‒ "мужчина" + "женщина" = "королева" действительно работает!

- GloVe (Global Vectors for Word Representation): Разработанный в Стэнфорде, GloVe сочетает в себе преимущества методов, основанных на частоте слов, и методов, основанных на предсказаниях.

- FastText: Расширение Word2Vec от Facebook, которое учитывает подсловные единицы (символьные n-граммы). Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией.

Эти методы стали для нас мостом от "поверхностного" понимания текста к более глубокому, контекстуальному. Мы также применяли Doc2Vec для представления целых документов, что оказалось очень полезным для поиска похожих статей или кластеризации текстов.

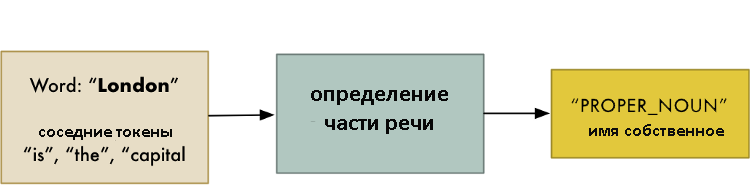

Разгадывая Значение: От Частей Речи до Эмоций

После того как текст преобразован в числа, мы можем начать извлекать из него более сложную информацию. Это как освоение грамматики и синтаксиса после изучения алфавита. Мы переходим от простого подсчета слов к пониманию их роли в предложении, их связей и, что самое интересное, их эмоциональной окраски.

Распознавание Именованных Сущностей (NER) и Анализ Тональности

Одним из наших первых серьезных проектов было Распознавание Именованных Сущностей (NER). Эта задача заключается в идентификации и классификации именованных сущностей в тексте, таких как имена людей, организации, географические местоположения, даты и т.д. Мы обнаружили, что spaCy является невероятно мощным и быстрым инструментом для NER "из коробки", особенно для английского языка. Для более сложных задач и языков с богатой морфологией мы углублялись в использование Flair и даже строили собственные модели на основе CRF (Conditional Random Fields) или с использованием трансформеров из Hugging Face, что позволяло достигать невероятной точности.

Пример сущностей, которые мы можем распознать:

- PERSON: Дональд Трамп, Иван Иванов

- ORG: Google, ООН, Сбербанк

- GPE (Geopolitical Entity): Нью-Йорк, Россия, Франция

- PRODUCT: iPhone, Windows 11

Еще одной захватывающей областью для нас стал Анализ Тональности (Sentiment Analysis). Это процесс определения эмоциональной окраски текста – является ли он позитивным, негативным или нейтральным. Мы начинали с простых подходов, используя библиотеку TextBlob, которая предоставляет быстрый и удобный способ оценки тональности. Однако для более тонкого анализа, особенно в социальных сетях, где много сленга, сарказма и эмодзи, мы обратились к VADER (Valence Aware Dictionary and sEntiment Reasoner). VADER специально разработан для анализа тональности текстов из социальных медиа и удивительно хорошо справляется с нюансами. Наш опыт показывает, что для специфических доменных текстов, например, финансовых новостей или медицинских записей, часто требуется обучение собственных моделей тональности, учитывающих контекст.

"Язык – это дорожная карта культуры. Он говорит нам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Глубже в Смысл: Тематическое Моделирование и Классификация

Когда мы преодолели базовые этапы, нам захотелось понять более глобальные закономерности в больших массивах текста. Какие скрытые темы присутствуют в тысячах отзывов? Как автоматически распределить статьи по категориям? Здесь мы столкнулись с мощными методами, которые позволили нам увидеть "большую картину".

Поиск Скрытых Тем: LDA и LSI с Gensim

Одной из самых интригующих задач было Тематическое Моделирование. Представьте, что у вас есть огромный архив документов, и вы хотите понять, о чем они. Прочитать все вручную невозможно. Тематическое моделирование позволяет автоматически выявлять скрытые "темы" в коллекции документов. Мы активно использовали библиотеку Gensim, которая является настоящей жемчужиной для работы с векторными представлениями и тематическим моделированием.

Мы работали с двумя основными алгоритмами:

- LDA (Latent Dirichlet Allocation): Это вероятностная модель, которая предполагает, что каждый документ представляет собой смесь нескольких тем, и каждая тема, в свою очередь, характеризуется распределением слов. LDA оказался очень эффективным для анализа текстов отзывов клиентов, помогая нам выявить основные проблемы и преимущества продуктов, о которых говорили пользователи.

- LSI (Latent Semantic Indexing): Более старый, но все еще полезный метод, основанный на сингулярном разложении (SVD). Он выявляет латентные семантические связи между терминами и документами. Мы использовали его для поиска похожих документов и улучшения рекомендательных систем.

Сравнение этих моделей показало нам, что LDA часто дает более интерпретируемые темы, в то время как LSI может быть быстрее для очень больших корпусов. Мы также экспериментировали с NMF (Non-negative Matrix Factorization) как альтернативой LDA, которая часто дает хорошие результаты для разреженных данных.

Распределение по Категориям: Классификация Текстов

Еще одна фундаментальная задача в NLP – это классификация текстов. Представьте, что вам нужно автоматически отсортировать входящие электронные письма по папкам ("Спам", "Работа", "Личное") или распределить новости по категориям ("Спорт", "Политика", "Экономика"). Для этого мы применяем различные алгоритмы машинного обучения.

Мы начинали с классических методов, используя библиотеку Scikit-learn:

- Наивный Байесовский классификатор (Naive Bayes): Простой, но часто удивительно эффективный алгоритм, основанный на теореме Байеса. Он хорошо работает для задач классификации текста, особенно при большом количестве признаков.

- Метод опорных векторов (SVM ‒ Support Vector Machines): Мощный алгоритм, который строит гиперплоскость для разделения классов. Мы использовали его для задач, где требовалась высокая точность, например, для анализа юридических документов.

С развитием технологий мы стали активно применять и более продвинутые подходы. Когда мы перешли к глубокому обучению с PyTorch и TensorFlow, мы начали строить нейронные сети, такие как LSTM (Long Short-Term Memory), которые способны улавливать долгосрочные зависимости в последовательностях слов, что особенно важно для понимания контекста в длинных текстах. А с появлением трансформерных архитектур, о которых мы поговорим чуть позже, классификация текстов вышла на совершенно новый уровень точности и универсальности.

Революция Трансформеров: Новый Уровень Понимания Языка

Если бы нас спросили, что изменило NLP больше всего за последние несколько лет, мы бы без колебаний ответили: Трансформеры. Это архитектуры нейронных сетей, которые совершили настоящую революцию, позволив моделям обрабатывать и понимать контекст на беспрецедентном уровне. Мы были свидетелями того, как эти модели преобразили практически все задачи NLP.

Hugging Face и Предварительно Обученные Модели

В основе этой революции лежит концепция предварительно обученных моделей (Pre-trained Models). Вместо того чтобы обучать модель с нуля для каждой новой задачи, мы можем взять огромную модель (например, BERT, GPT, RoBERTa), которая уже "прочитала" гигантские объемы текста из интернета и "поняла" общие закономерности языка. Затем мы можем "тонко настроить" (fine-tune) эту модель на нашей конкретной задаче с гораздо меньшим объемом данных.

Для нас это стало настоящим Game Changer’ом. Библиотека Hugging Face Transformers стала нашим основным инструментом. Она предоставляет удобный интерфейс для работы с сотнями предварительно обученных моделей для широкого спектра задач:

- BERT (Bidirectional Encoder Representations from Transformers): Позволяет понимать контекст слова, учитывая все слова в предложении, а не только предыдущие. Мы использовали BERT для NER, классификации текстов и даже для построения систем вопросно-ответных систем (QA).

- GPT (Generative Pre-trained Transformer): Модели этой серии (GPT-2, GPT-3, GPT-4) специализируются на генерации текста. Мы экспериментировали с ними для создания автоматических суммаризаций, генерации диалогов для чат-ботов и даже для творческого письма.

Тонкая настройка предварительно обученных моделей значительно ускорила наши проекты и повысила их качество. Мы могли взять модель, обученную на миллионах страниц текста, и за несколько часов адаптировать ее для специфической задачи, например, анализа тональности финансовых новостей, где обычные слова могут иметь совершенно другое значение.

NLP в Действии: От Веб-Скрейпинга до Чат-Ботов

Теория и алгоритмы – это, конечно, прекрасно, но настоящая магия NLP раскрывается тогда, когда мы применяем ее для решения реальных задач. Наш опыт охватывает широкий спектр практических применений, которые демонстрируют всю мощь и гибкость Python в этой области.

Собираем Данные: Веб-Скрейпинг и Работа с Различными Форматами

Прежде чем мы можем анализировать текст, нам нужно его получить. Часто это означает извлечение информации из интернета. Здесь нашим надежным помощником стала библиотека Beautiful Soup для веб-скрейпинга. Мы использовали ее для извлечения текстового контента с веб-страниц, новостных порталов, блогов и форумов. Это позволило нам собрать огромные объемы данных для обучения наших моделей.

Наши основные шаги в сборе данных:

- Определение источников: Выбор веб-сайтов или API для извлечения данных.

- Использование Beautiful Soup: Парсинг HTML-структуры для извлечения нужных текстовых блоков.

- Очистка текста: Удаление HTML-тегов, скриптов, рекламных вставок с помощью регулярных выражений.

- Работа с PDF: Для извлечения текста из PDF-документов мы успешно применяли библиотеку PyMuPDF, которая оказалась очень эффективной и надежной.

Также мы часто работаем с многоязычными текстовыми корпусами. Для этого мы используем библиотеки, такие как Polyglot и Stanza, которые отлично справляются с языками, обладающими богатой морфологией, такими как русский, арабский или финский. Это позволяет нам расширять наши проекты за пределы англоязычного мира.

Создаем Интеллектуальные Системы: QA, Чат-боты и Суммаризация

Собранные и обработанные данные открывают двери для создания по-настоящему умных систем.

Вопросно-Ответные Системы (QA)

Разработка систем вопросно-ответных систем (QA) – это одна из самых сложных и увлекательных задач. Цель такой системы – найти точный ответ на вопрос пользователя в заданном тексте или корпусе документов. Мы использовали трансформерные модели, такие как BERT, для реализации QA, где модель учится находить спан (непрерывный фрагмент) текста, который содержит ответ. Это было особенно полезно для автоматического поиска информации в больших базах знаний или юридических документах.

Разработка Чат-ботов на Python

Чат-боты стали неотъемлемой частью современного цифрового мира. Мы работали над созданием умных чат-ботов, используя фреймворк Rasa. Rasa позволяет строить контекстно-зависимые диалоговые системы, которые могут понимать намерения пользователя, извлекать сущности из его запросов и генерировать адекватные ответы; Это было невероятно интересно – наблюдать, как машина ведет осмысленный диалог.

Суммаризация Текста

В мире, переполненном информацией, способность быстро извлекать суть из длинных текстов становится бесценной. Мы разрабатывали системы суммаризации текста, которые делятся на два основных типа:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их в краткое изложение. Для этого мы использовали алгоритмы вроде TextRank, который строит граф предложений и ранжирует их по важности.

- Абстрактивная суммаризация: Генерирует новое резюме, которое может содержать слова и фразы, не присутствующие в оригинальном тексте. Это гораздо более сложная задача, которую мы решали с помощью трансформерных моделей (например, на основе GPT), способных создавать связный и осмысленный пересказ.

Оба подхода имеют свои преимущества, и выбор зависит от конкретной задачи и требований к качеству суммаризации.

Тонкости и Нюансы: Продвинутые Методы и Визуализация

Мир NLP постоянно развивается, и мы всегда стремимся осваивать новые горизонты. Это включает в себя работу с более сложными аспектами языка и представление результатов анализа в наглядной форме.

Извлечение Ключевых Фраз и Анализ Стилистики

Помимо тематического моделирования, нам часто требовалось извлекать наиболее важные слова и фразы из текста. Для этого мы использовали такие инструменты, как RAKE (Rapid Automatic Keyword Extraction) и TextRank, которые позволяют автоматически идентифицировать ключевые слова и предложения. Это очень полезно для автоматической категоризации статей и создания тегов.

Мы также углублялись в анализ стилистики текстов, пытаясь определить авторский почерк, выявить особенности использования лексики и синтаксиса. Это позволяет нам, например, решать задачи определения авторства текста или анализа поведенческих паттернов в чатах. Работа с эмодзи и сленгом в современных текстах также стала важной частью нашего исследования, поскольку они несут существенную смысловую и эмоциональную нагрузку, которую нельзя игнорировать.

Визуализация Данных: Делаем Невидимое Видимым

Числа и графики могут быть сухими, но визуализация текстовых данных позволяет нам увидеть закономерности, которые иначе остались бы скрытыми. Мы активно используем различные инструменты для наглядного представления результатов:

- Облака слов (Word Clouds): Простой, но очень эффективный способ показать наиболее часто встречающиеся слова в тексте. Чем больше слово, тем чаще оно встречается.

- Тепловые карты (Heatmaps): Для визуализации матриц сходства документов или корреляции между темами.

- Графы: Для отображения взаимосвязей между сущностями в тексте или для анализа синтаксических зависимостей с помощью spaCy.

Инструменты вроде Sweetviz также помогают нам быстро анализировать текстовые данные и выявлять их характеристики. Визуализация – это не просто красивый способ подачи информации; это мощный инструмент для исследования и понимания данных.

Наши Вызовы и Взгляд в Будущее NLP

Несмотря на все успехи, наш путь в NLP не был лишен трудностей. Мы сталкивались с различными вызовами, которые требовали нестандартных решений и постоянного обучения.

Проблемы Данных: Неполнота, Ошибки и Предвзятость

Одной из самых больших проблем всегда была и остается работа с неполными и ошибочными данными. Реальный мир далек от идеальных датасетов. Опечатки, грамматические ошибки, отсутствие контекста, шум – все это может сильно снизить качество наших моделей. Мы разрабатывали инструменты для проверки грамматики и исправления орфографии, использовали библиотеки вроде Jellyfish для сравнения строк и поиска дубликатов.

Еще один критический аспект – это предвзятость (bias) в данных. Если наши обучающие данные содержат предвзятость, то и модель будет ее воспроизводить, что может привести к несправедливым или некорректным результатам. Это особенно актуально для задач, связанных с анализом тональности в социальных сетях, где предвзятость может проявляться в отношении определенных групп людей или тем. Мы учились критически оценивать наши данные и модели, стремясь к справедливости и этичности в разработке.

Масштаб и Производительность: Big Data NLP

Когда мы начали работать с по-настоящему большими текстовыми массивами (Big Data NLP), вопросы масштабирования и производительности вышли на первый план. Обработка миллионов документов требует эффективных алгоритмов и мощных вычислительных ресурсов. Мы использовали Gensim для работы с большими корпусами, применяли GPU-ускорение для обучения глубоких нейронных сетей и исследовали распределенные системы для параллельной обработки данных.

Некоторые из наших задач, требовавших серьезной производительности:

- Анализ лог-файлов для выявления аномалий.

- Обработка текста в режиме реального времени (Streaming NLP) для мониторинга социальных медиа.

- Создание словарей и тезаурусов для узкоспециализированных областей.

Эти вызовы заставляли нас постоянно искать новые, более эффективные подходы и инструменты.

Наше путешествие по миру NLP с Python было невероятно насыщенным и поучительным. Мы прошли путь от основ токенизации и стемминга до работы с передовыми трансформерными архитектурами, способными генерировать текст и отвечать на сложные вопросы. Мы увидели, как Python, с его богатой экосистемой библиотек – NLTK, spaCy, Gensim, Scikit-learn, Hugging Face, Beautiful Soup и многими другими – предоставляет беспрецедентные возможности для работы с человеческим языком.

Мы верим, что NLP – это не просто инструмент, а мощный катализатор для инноваций во многих областях: от улучшения взаимодействия с клиентами и автоматизации бизнес-процессов до научных исследований и социального анализа. Каждый проект, каждая новая модель, каждый извлеченный инсайт – это еще один шаг к тому, чтобы машины по-настоящему понимали нас, а мы, в свою очередь, глубже понимали самих себя через призму языка. Мы продолжим исследовать этот захватывающий мир, ведь язык – это живая, постоянно меняющаяся субстанция, и его машинное понимание всегда будет оставаться одним из самых интересных вызовов в мире искусственного интеллекта. Точка.

Подробнее

| NLTK основы | spaCy NER | Gensim LDA | Scikit-learn классификация | Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face | Разработка чат-ботов Rasa | Суммаризация текста | Beautiful Soup скрейпинг |