- Разгадывая язык машин: Наш увлекательный путь в мир NLP с Python

- Первые Шаги в Мир NLP: Фундаментальные Концепции и Инструменты

- Токенизация и Стемминг: Разбивая Текст на Атомы

- spaCy: Быстрый и Эффективный Инструмент для NLP

- От Слов к Смыслам: Векторизация и Тематическое Моделирование

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: Когда Слова Обретают Смысл

- Тематическое Моделирование: Раскрываем Скрытые Темы

- Эмоции, Смысл и Предсказания: Продвинутые Методы NLP

- Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

- Машинное Обучение и Глубокое Обучение для NLP

- Эра Трансформеров: Новый Уровень Понимания Языка

- Прикладные Аспекты NLP: От Веб-Скрейпинга до Чат-Ботов

- Извлечение Данных: Веб-Скрейпинг и Работа с PDF

- Разработка Интеллектуальных Систем: Чат-Боты и QA

- Многоязычный NLP и Специфические Задачи

- Вызовы и Будущее NLP: Куда Мы Движемся?

- Проблемы Реального Мира: Неидеальные Данные и Редкие Языки

- Масштабирование и Производительность: Big Data NLP

- Будущее: Генерация, Понимание и Человеко-Машинное Взаимодействие

Разгадывая язык машин: Наш увлекательный путь в мир NLP с Python

Приветствуем, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами историей нашего погружения в удивительный мир обработки естественного языка, или как его принято называть – NLP (Natural Language Processing)․ Это не просто набор инструментов или алгоритмов; это целая философия, позволяющая машинам понимать, интерпретировать и даже генерировать человеческую речь․ И, поверьте нам, это одно из самых захватывающих приключений, в которое можно отправиться, вооружившись лишь Python и жаждой знаний․

За годы работы с текстом мы накопили немалый опыт, сталкиваясь с различными задачами: от анализа пользовательских отзывов до разработки сложных вопросно-ответных систем․ Каждый проект был уникальным вызовом, открывавшим новые грани этой многогранной области․ И сегодня мы хотим провести вас по этому пути, рассказывая о ключевых инструментах и концепциях, которые стали нашими верными спутниками․ Приготовьтесь, ведь нас ждет глубокое погружение в то, как мы учим компьютеры "говорить" и "думать" на одном языке с нами․

Первые Шаги в Мир NLP: Фундаментальные Концепции и Инструменты

Любое большое путешествие начинается с первого шага, и в NLP этот шаг — понимание основ․ Прежде чем мы сможем научить машину анализировать сложные текстовые структуры, нам нужно научить ее "читать" текст, разбивать его на понятные единицы и приводить к базовым формам․ Именно здесь на сцену выходят такие гиганты, как NLTK и spaCy, ставшие нашими незаменимыми помощниками․

Мы всегда начинаем с предобработки текста, поскольку "мусор на входе" неизбежно приведет к "мусору на выходе"․ Это этап, на котором мы очищаем данные от лишних символов, приводим их к единообразному виду и подготавливаем к дальнейшему анализу․ Именно здесь мы активно используем регулярные выражения, которые, как острый хирургический скальпель, позволяют нам отсекать все ненужное и выделять то, что действительно важно․

Токенизация и Стемминг: Разбивая Текст на Атомы

Представьте, что вы хотите проанализировать текст книги․ Вы же не будете воспринимать ее как единый сплошной поток символов, верно? Вы будете читать слова, предложения, абзацы․ То же самое мы делаем и для машин, и первый шаг к этому, токенизация․ Это процесс разбиения текста на отдельные единицы, или "токены", которыми могут быть слова, знаки препинания или даже целые предложения․ NLTK предлагает нам целый арсенал токенизаторов, позволяющих гибко подходить к этой задаче․

После того как текст разбит на токены, мы часто сталкиваемся с проблемой вариативности слов: "бежать", "бежит", "бежал" — все это формы одного и того же глагола․ Для того чтобы машина понимала, что это одно и то же понятие, нам нужны процессы нормализации․ Здесь на помощь приходят стемминг и лемматизация․ Стемминг (например, с помощью PorterStemmer в NLTK) обрезает окончания слов, приводя их к "корню" (stem), который не всегда является осмысленным словом․ Лемматизация (с использованием WordNetLemmatizer в NLTK или более продвинутых моделей в spaCy) стремится привести слово к его словарной форме (лемме), что обычно дает более качественный результат, особенно для русского языка с его богатой морфологией․

Мы активно используем оба подхода, выбор зависит от конкретной задачи; Для быстрого и менее требовательного анализа стемминг вполне подойдет․ Но если нам нужна высокая точность и сохранение смысла, то лемматизация становится нашим фаворитом․ Например, в задаче анализа тональности, где каждое слово может иметь свой эмоциональный оттенок, корректная лемма критически важна․

spaCy: Быстрый и Эффективный Инструмент для NLP

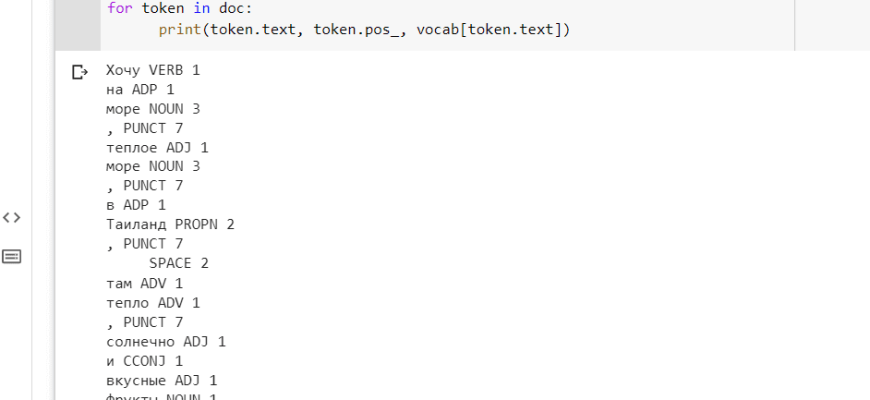

Если NLTK, это наша "швейцарская армия" для NLP, то spaCy — это высокоскоростной и оптимизированный "спецназ"․ Мы обнаружили, что spaCy значительно превосходит NLTK по скорости для многих стандартных задач, таких как токенизация, POS-теггинг (разметка частей речи) и, что особенно важно, распознавание именованных сущностей (NER)․ NER позволяет нам автоматически находить и классифицировать такие сущности, как имена людей, названия организаций, географические объекты, даты и т․д․․ Это невероятно полезно при работе с неструктурированным текстом, когда нам нужно быстро извлечь конкретную информацию․

Вот пример того, как мы обычно используем эти инструменты:

| Задача | Инструмент | Описание |

|---|---|---|

| Базовая токенизация | NLTK | Простая и гибкая разбивка текста на слова/предложения․ |

| Лемматизация | spaCy | Приведение слов к словарной форме, учитывая контекст и часть речи․ |

| Распознавание сущностей (NER) | spaCy / Flair | Идентификация имен, организаций, мест и т․д․ в тексте․ |

| Предобработка (очистка) | Регулярные выражения (re) | Удаление HTML-тегов, пунктуации, чисел, стоп-слов․ |

От Слов к Смыслам: Векторизация и Тематическое Моделирование

Итак, мы научились разбирать текст на атомы и даже извлекать из него именованные сущности․ Но как нам научить машину "понимать" смысл этих слов и документов в целом? Компьютеры оперируют числами, а не буквами․ Здесь на помощь приходит векторизация текста, процесс преобразования слов и документов в числовые векторы․ Это краеугольный камень современного NLP, открывающий двери для применения мощных алгоритмов машинного обучения․

Наш опыт показывает, что выбор правильного метода векторизации может кардинально повлиять на результат․ Начинали мы, как и многие, с классических подходов, которые до сих пор остаются актуальными для многих задач․

Классические Векторизаторы: CountVectorizer и TF-IDF

Первые инструменты, которые мы освоили для векторизации, были CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn․ CountVectorizer просто подсчитывает частоту появления каждого слова в документе․ Это, по сути, создание "мешка слов", где порядок слов игнорируется, но их количество имеет значение․ Мы использовали его для простых задач классификации, где контекст не играл решающей роли․

Однако вскоре мы поняли, что не все слова одинаково важны․ Например, предлоги или артикли встречаются очень часто, но не несут особого смыслового веса․ Здесь на помощь пришел TF-IDF (Term Frequency-Inverse Document Frequency)․ Этот метод не только учитывает частоту слова в документе (TF), но и придает ему меньший вес, если оно часто встречается во всем корпусе документов (IDF)․ Таким образом, редкие, но значимые слова получают больший вес․ Мы часто используем TF-IDF для извлечения ключевых слов и фраз, а также для классификации текстов, где нам нужно сфокусироваться на уникальной лексике․

Word Embeddings: Когда Слова Обретают Смысл

Революция в векторизации произошла с появлением Word Embeddings — векторных представлений слов, которые улавливают их семантический смысл и отношения․ Вместо того чтобы просто считать слова, мы теперь можем представлять их в многомерном пространстве так, что слова с похожим значением будут располагаться близко друг к другу․ Это открыло совершенно новые горизонты!

Мы активно работаем с Word2Vec и GloVe, используя библиотеку Gensim․ Word2Vec, предложенный Google, умеет улавливать контекст слова, обучаясь на больших корпусах текста․ Например, если вы обучите модель на достаточно большом корпусе, она сможет понять, что "король" относится к "мужчине" так же, как "королева" к "женщине"․ Это невероятно мощно! Мы применяли Word2Vec для задач рекомендательных систем, поиска похожих документов и улучшения качества классификации․

С развитием NLP появились и более сложные модели, способные векторизовать не только отдельные слова, но и целые предложения или документы․ Doc2Vec (расширение Word2Vec) и Sentence Transformers позволяют нам работать с более крупными единицами текста, что критически важно для задач суммаризации или анализа схожести документов․

Тематическое Моделирование: Раскрываем Скрытые Темы

После векторизации мы часто сталкиваемся с необходимостью понять, какие основные темы присутствуют в большом корпусе документов․ Вручную это сделать невозможно, но здесь на помощь приходят алгоритмы тематического моделирования․ Наши любимые инструменты для этого, LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing) из библиотеки Gensim․

LDA позволяет нам обнаружить скрытые тематические структуры в коллекции документов․ Мы можем сказать алгоритму, сколько тем мы хотим найти, и он постарается распределить слова по этим темам, а документы — по темам․ Это похоже на то, как если бы вы взяли огромную библиотеку и попросили машину автоматически рассортировать книги по жанрам, даже если они не были явно помечены․ Мы использовали LDA для анализа отзывов клиентов, чтобы выявить основные проблемы или преимущества продукта, а также для категоризации статей․

LSI, в свою очередь, использует сингулярное разложение для выявления скрытых семантических отношений между словами и документами․ Он также эффективен для уменьшения размерности и обнаружения тем․ Мы часто проводим сравнение LDA vs NMF (Non-negative Matrix Factorization) для тематического моделирования, выбирая тот, который лучше подходит для конкретного набора данных и нашей задачи, основываясь на метриках когерентности тем․

"Язык – это карта того, как мы думаем․ Он формирует наши мысли и влияет на то, как мы воспринимаем реальность․"

— Ноам Хомский

Эмоции, Смысл и Предсказания: Продвинутые Методы NLP

Понимание структуры текста и его основных тем — это только начало․ Настоящая магия начинается, когда мы пытаемся извлечь из текста более тонкие оттенки, такие как эмоции, намерения или даже предсказать поведение․ Здесь мы переходим к более продвинутым методам, включающим анализ тональности, машинное обучение и, конечно же, трансформеры․

Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

Одной из наиболее востребованных задач в NLP является анализ тональности, или сентимент-анализ․ Это процесс определения эмоциональной окраски текста: позитивная, негативная или нейтральная․ Мы использовали его для анализа отзывов клиентов, сообщений в социальных сетях, финансовых новостей и многого другого․

Наш первый опыт с сентимент-анализом был с VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK․ Это лексический анализатор, который отлично справляется с текстами из социальных сетей, поскольку учитывает такие явления, как смайлики, заглавные буквы и пунктуация для усиления эмоционального окраса․ Для более общего анализа мы также применяли TextBlob, который хоть и прост в использовании, но имеет свои ограничения, особенно для русского языка, где его точность может быть ниже․

Для более точного и контекстно-зависимого анализа тональности мы перешли к моделям машинного обучения․ Мы обучали классификаторы (например, SVM или наивный байесовский классификатор из Scikit-learn) на размеченных данных․ Это позволило нам значительно улучшить качество анализа, особенно в случаях, когда нужно учитывать сарказм или тонкие нюансы речи, которые не всегда улавливаются лексическими подходами․ Анализ тональности сообщений в социальных сетях с учетом сарказма — это отдельная сложная, но увлекательная задача, где мы экспериментировали с контекстными встраиваниями․

Машинное Обучение и Глубокое Обучение для NLP

Как только текст был преобразован в числовые векторы, открываются безграничные возможности для применения алгоритмов машинного обучения․ Мы активно используем Scikit-learn для классификации текстов: спам-фильтры, категоризация новостей, определение авторства, все это задачи, где линейные модели или SVM показывают отличные результаты, особенно с хорошо подобранными признаками (например, TF-IDF векторами или Word Embeddings)․

Однако для более сложных задач, требующих понимания долгосрочных зависимостей в тексте, мы обратились к глубокому обучению․ Использование PyTorch и TensorFlow для создания нейросетей, таких как LSTM (Long Short-Term Memory) или GRU (Gated Recurrent Unit), позволило нам добиться прорывов в задачах машинного перевода, генерации текста и более тонкого анализа тональности․ Эти сети способны "запоминать" контекст на протяжении длинных последовательностей слов, что делает их незаменимыми для работы с языком․

Эра Трансформеров: Новый Уровень Понимания Языка

Последние годы принесли настоящую революцию в NLP благодаря появлению архитектуры Трансформеров․ Такие модели, как BERT, GPT и T5, разработанные в рамках проекта Hugging Face, изменили все․ Они способны обрабатывать текст параллельно и улавливать контекст слова не только слева направо, но и справа налево, а также на очень больших расстояниях․ Это позволило нам достичь беспрецедентной точности во многих задачах․

Мы активно используем трансформеры для:

- Классификации: Тонкая настройка (fine-tuning) предварительно обученных моделей BERT для специфических задач классификации дает потрясающие результаты, превосходящие классические методы․

- Суммаризации текста: Как экстрактивной (выделение ключевых предложений), так и абстрактивной (генерация нового, краткого текста)․ Мы экспериментировали с Pegasus и BART для этой цели․

- Машинного перевода: Трансформеры являются основой для большинства современных систем перевода, и мы применяли их для создания собственных специализированных переводчиков․

- Генерации текста: С помощью GPT-подобных моделей мы можем создавать связные и осмысленные тексты, что открывает возможности для автоматического написания статей, ответов на вопросы и даже кода․

- Вопросно-ответных систем (QA): Трансформеры позволяют нам строить системы, которые могут не просто находить ответы в тексте, но и понимать вопрос, извлекать релевантную информацию и формировать связный ответ․

Работа с библиотекой Hugging Face Transformers стала для нас стандартом, так как она предоставляет удобный интерфейс для работы с сотнями предварительно обученных моделей и их тонкой настройки под наши нужды․ Это значительно сокращает время разработки и позволяет нам сосредоточиться на самой задаче, а не на архитектуре модели․

Прикладные Аспекты NLP: От Веб-Скрейпинга до Чат-Ботов

Теория и алгоритмы — это хорошо, но что нас всегда вдохновляло, так это возможность применять эти знания для решения реальных проблем․ За годы работы мы реализовали множество проектов, демонстрирующих практическую мощь NLP․ От автоматизации рутинных задач до создания интеллектуальных систем, возможности безграничны․

Извлечение Данных: Веб-Скрейпинг и Работа с PDF

Прежде чем мы сможем анализировать текст, его нужно где-то взять․ Часто это означает извлечение данных из различных источников․ Мы активно используем библиотеку Beautiful Soup для веб-скрейпинга текста․ Это позволяет нам собирать информацию с веб-страниц: новости, статьи, отзывы, данные для обучения моделей․ Однако важно помнить о этических и правовых аспектах скрейпинга․

Не менее часто мы сталкиваемся с необходимостью извлечения текста из PDF-документов․ Для этого мы применяем библиотеку PyMuPDF, которая позволяет эффективно работать с PDF, извлекая текст, изображения и даже анализируя структуру документа․ Это было крайне полезно при работе с юридическими или медицинскими документами, где информация часто содержится в PDF-файлах․

Разработка Интеллектуальных Систем: Чат-Боты и QA

Одной из наиболее захватывающих областей применения NLP для нас является разработка систем, которые могут взаимодействовать с человеком на естественном языке․ Мы много работали над созданием чат-ботов на Python, используя фреймворк Rasa․ Rasa позволяет нам строить контекстно-зависимые диалоговые системы, которые не просто отвечают на вопросы по ключевым словам, но и понимают намерения пользователя, отслеживают ход диалога и могут персонализировать ответы․

Помимо чат-ботов, мы разрабатывали системы вопросно-ответных систем (QA)․ Эти системы идут дальше простого поиска информации; они способны понимать заданный вопрос, находить релевантные фрагменты текста в большом корпусе документов и формулировать точный ответ․ Это критически важно для таких задач, как создание FAQ на основе документов или быстрого поиска информации в корпоративных базах знаний․

Многоязычный NLP и Специфические Задачи

Мир не ограничивается одним языком, и наши проекты тоже․ Мы активно работаем с многоязычными текстовыми корпусами, используя такие инструменты, как Polyglot и Stanza․ Polyglot отлично подходит для быстрого анализа многих языков, предоставляя токенизацию, NER, анализ тональности и другие функции․ Stanza (разработанная Stanford NLP Group) особенно полезна для языков с богатой морфологией, таких как русский, предлагая продвинутую лемматизацию и синтаксический парсинг․

Среди других интересных задач, с которыми мы сталкивались:

- Анализ стилистики текстов: Определение авторского почерка или выявление уникальных стилевых особенностей․

- Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг играют огромную роль, и их корректная обработка критически важна для понимания смысла․ Мы разрабатывали собственные инструменты для нормализации сленга․

- Разработка систем обнаружения плагиата: Используя методы сравнения строк (например, с библиотекой Jellyfish) и векторизации документов, мы строили системы для выявления схожести текстов․

- Анализ юридических и медицинских документов: Извлечение ключевых дат, сущностей, фактов и связей между ними из сложных и объемных текстов․

- Визуализация текстовых данных: Создание облаков слов (Word Clouds), тепловых карт частотности слов и других графиков для наглядного представления результатов анализа․

Вызовы и Будущее NLP: Куда Мы Движемся?

Путешествие в мир NLP никогда не заканчивается, ведь язык постоянно меняется, и вместе с ним развиваются и наши инструменты․ Мы постоянно сталкиваемся с новыми вызовами, которые требуют творческого подхода и глубокого понимания предметной области․

Проблемы Реального Мира: Неидеальные Данные и Редкие Языки

В реальном мире данные редко бывают идеальными․ Мы постоянно имеем дело с неполными и ошибочными данными, опечатками, грамматическими ошибками․ Разработка инструментов для проверки грамматики и исправления орфографии становится не просто полезной, а необходимой частью предобработки․ Сравнение библиотек для лемматизации (SpaCy vs NLTK) или токенизаторов часто сводится к выбору того, который лучше всего справляется с "грязными" данными конкретного языка․

Работа с нелатинскими алфавитами и редкими языками также представляет собой особый вызов․ Многие предварительно обученные модели и библиотеки лучше работают с английским языком․ Для русского и других языков нам часто приходится искать специализированные модели, обучать свои собственные или использовать библиотеки, такие как Stanza, которые имеют хорошую поддержку для морфологически богатых языков․

Масштабирование и Производительность: Big Data NLP

Когда речь заходит об обработке больших текстовых массивов (Big Data NLP), производительность становится критически важной․ Мы исследовали возможности GPU-ускорения для глубокого обучения и трансформаторных моделей, что значительно сокращает время обучения и инференса․ Использование библиотек, таких как Gensim, оптимизированных для работы с большими корпусами, позволяет нам эффективно обрабатывать терабайты текстовых данных․

Обработка текста в режиме реального времени (Streaming NLP) — еще одна задача, требующая оптимизации и эффективных архитектур․ Мы работали над системами, которые могут анализировать потоки сообщений в социальных сетях, выявляя тренды и аномалии на лету․

Будущее: Генерация, Понимание и Человеко-Машинное Взаимодействие

Будущее NLP обещает быть еще более захватывающим․ Мы видим, как Transformer-модели продолжают совершенствоваться в генерации текста, диалогов и даже кода․ Возможности для автоматической разметки данных, разработки инструментов для проверки фактов (Fact-Checking) и выявления связей между сущностями постоянно расширяются․ Мы также активно следим за развитием Graph Embeddings для анализа взаимосвязей в тексте, что открывает новые подходы к пониманию сложных отношений․

Наша миссия как блогеров и практиков NLP состоит в том, чтобы не только следовать за этими тенденциями, но и активно участвовать в их формировании, делясь нашим опытом и знаниями․ Мы верим, что Python с его богатой экосистемой библиотек останется ключевым инструментом в этом увлекательном путешествии․

Вот и подошло к концу наше путешествие по бескрайним просторам обработки естественного языка с Python․ Мы начали с самых основ — токенизации и стемминга, прошли через векторизацию слов и документов, погрузились в мир тематического моделирования и анализа тональности, и, наконец, достигли вершин глубокого обучения и трансформеров․

Каждый этап этого пути был полон открытий и вызовов․ Мы научились не просто обрабатывать текст, а извлекать из него смысл, эмоции и ценную информацию․ Python с его мощными библиотеками — NLTK, spaCy, Gensim, Scikit-learn, Hugging Face, PyTorch и TensorFlow, стал нашим универсальным инструментом, позволяющим воплощать самые смелые идеи в жизнь․

Мы надеемся, что наш опыт вдохновит вас на собственные исследования и проекты в области NLP․ Помните, что мир языка бесконечно сложен и удивителен, и каждый новый шаг приближает нас к тому, чтобы научить машины понимать нас так же хорошо, как мы понимаем друг друга․ И это только начало!

Подробнее

| Основы NLTK | Векторизация текста | Анализ тональности | Трансформеры NLP | Разработка чат-ботов |

| NER с SpaCy | Word Embeddings Python | Тематическое моделирование LDA | Суммаризация текста | Мультиязычный NLP |