- Разгадывая Язык: Наш Путь в Мир Обработки Естественного Языка на Python

- Первые Шаги: От Сырого Текста к Понятным Данным

- Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

- Регулярные Выражения и Очистка Данных: Наводим Порядок

- Представление Текста: Как Компьютер "Видит" Слова

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: От Слов к Смыслу

- Контекстные Встраивания: Революция Трансформеров

- Ключевые Задачи NLP: От Распознавания до Генерации

- Распознавание Именованных Сущностей (NER): Выделяем Главное

- Анализ Тональности (Sentiment Analysis): Понимаем Эмоции

- Тематическое Моделирование (Topic Modeling): Находим Скрытые Темы

- Классификация Текстов: Автоматическая Сортировка

- Суммаризация Текста: Извлекаем Суть

- Продвинутые Техники и Прикладные Задачи

- Трансформеры и Генерация Текста: Творчество Машин

- Работа с Неструктурированными Данными: От Веб-Скрейпинга до PDF

- Многоязычный NLP и Специфические Языки

- Разработка Систем: От Чат-ботов до Факт-чекинга

- Визуализация и Анализ: Делаем Данные Видимыми

- Вызовы и Перспективы: Куда Движется NLP

Разгадывая Язык: Наш Путь в Мир Обработки Естественного Языка на Python

Привет, друзья и коллеги по цифровому перу! Сегодня мы хотим поделиться с вами нашим захватывающим путешествием в одну из самых интригующих областей искусственного интеллекта — обработку естественного языка, или, как ее принято называть, NLP (Natural Language Processing)․ Это не просто набор алгоритмов и библиотек; для нас это целый мир, где машины учатся понимать, интерпретировать и даже генерировать человеческую речь; Представьте себе: мы можем заставить компьютер читать тысячи отзывов, извлекать из них суть, определять настроение клиентов или даже переводить тексты на лету․ Разве это не магия? Мы убеждены, что каждый, кто работает с данными, рано или поздно столкнется с необходимостью анализа текста, и именно Python предоставляет нам невероятно мощный и гибкий инструментарий для этого․

Наше приключение началось давно, когда мы впервые столкнулись с задачей анализа огромного массива пользовательских комментариев․ Тогда мы чувствовали себя первооткрывателями, блуждающими в лабиринте неструктурированных данных․ Но шаг за шагом, погружаясь в основы и осваивая новые инструменты, мы начали видеть закономерности, извлекать ценную информацию и, в конечном итоге, создавать системы, которые действительно помогают бизнесу и людям․ В этой статье мы хотим провести вас по этому пути, от самых азов до продвинутых концепций, используя наш личный опыт и делясь практическими советами․ Приготовьтесь, нас ждет увлекательное погружение в глубины текстовой аналитики!

Первые Шаги: От Сырого Текста к Понятным Данным

Когда мы только начинали свой путь в NLP, перед нами всегда стояла одна и та же задача: как превратить хаотичный поток слов в нечто, что компьютер может понять и обработать․ Ведь для машины текст, это всего лишь последовательность символов․ Именно здесь на помощь приходят базовые, но крайне важные операции, которые мы называем предобработкой текста․ Это фундамент, без которого любое дальнейшее построение будет неустойчивым․

Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

Первое, что мы делаем с текстом, — это разбиваем его на составные части, которые называются токенами․ Чаще всего токенами являются слова, но это могут быть и знаки препинания, числа или даже эмодзи․ Для нас это как процесс расчленения предложения на отдельные кирпичики, с которыми потом можно работать․ В Python для этого есть замечательные библиотеки․

NLTK (Natural Language Toolkit) — это наш старый добрый друг, с которого многие начинают․ Он предоставляет простые и эффективные функции для токенизации․ Мы помним, как впервые использовали word_tokenize и sent_tokenize и были поражены, насколько легко текст превращается в списки слов и предложений․ Но токенизация, это только начало․

После токенизации мы часто сталкиваемся с проблемой: одно и то же слово может иметь разные формы (например, "бежать", "бежит", "бегал")․ Для компьютера это разные токены, хотя смысл у них один․ Здесь на помощь приходят стемминг и лемматизация․ Стемминг — это грубое отсечение окончаний, чтобы привести слово к его "основе" (stem)․ Например, "running", "runs", "runner" могут быть приведены к "run"․ Это быстро, но не всегда корректно, так как может отсечь лишнее или создать несуществующее слово․

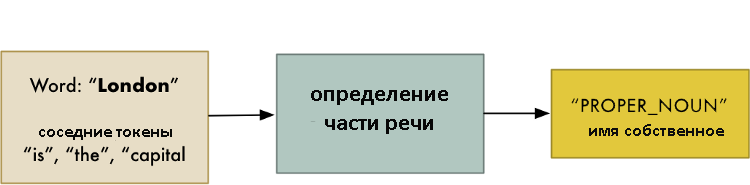

Лемматизация, в свою очередь, более интеллектуальный процесс․ Она приводит слово к его словарной форме (лемме) с учетом его части речи․ "Бежит" станет "бежать", "лучший" — "хороший"․ Это более точный, но и более ресурсоемкий подход․ Для лемматизации мы часто используем spaCy или Stanza, особенно когда работаем с языками, обладающими богатой морфологией, такими как русский․ Эти библиотеки предлагают не только лемматизацию, но и множество других функций для глубокого лингвистического анализа․

Мы часто сравниваем стемминг и лемматизацию с подходом к ремонту старого автомобиля․ Стемминг — это как быстрая замена поврежденных частей на что-то похожее, чтобы машина просто ехала․ Лемматизация же — это полноценный капитальный ремонт с заменой деталей на оригинальные или максимально подходящие, чтобы автомобиль функционировал идеально․

Регулярные Выражения и Очистка Данных: Наводим Порядок

Прежде чем погружаться в глубокий анализ, текст нуждается в тщательной очистке․ Мы неоднократно убеждались, что "мусор на входе — мусор на выходе"․ Это означает, что если мы не избавимся от ненужных символов, HTML-тегов, URL-адресов, чисел и прочего, наши модели будут работать некорректно․ Здесь неоценимую помощь оказывают регулярные выражения (re)․

С помощью re мы можем:

- Удалять HTML-теги, которые часто попадают к нам при веб-скрейпинге с помощью Beautiful Soup․

- Избавляться от знаков препинания, которые не несут смысловой нагрузки для нашей задачи․

- Удалять числа, если они не являются важными сущностями․

- Приводить текст к нижнему регистру для унификации․

- Обрабатывать эмодзи и сленг, что особенно актуально при анализе текстов из социальных сетей (Twitter/Reddit)․

Мы также создаем списки так называемых "стоп-слов" — это часто встречающиеся, но не несущие особого смысла слова, такие как "и", "в", "на", "он" и т․д․ Удаление стоп-слов значительно уменьшает размер корпуса и повышает эффективность последующих алгоритмов․ Наш опыт показывает, что грамотная предобработка может сэкономить часы, а то и дни отладки на более поздних этапах․

Представление Текста: Как Компьютер "Видит" Слова

После того как мы очистили и подготовили текст, возникает следующий вопрос: как преобразовать эти слова в числовой формат, понятный для алгоритмов машинного обучения? Ведь большинство моделей работают с числами, а не с текстовыми строками․ Здесь начинается увлекательный мир векторизации․

Классические Векторизаторы: CountVectorizer и TF-IDF

Наши первые шаги в векторизации были связаны с простыми, но очень эффективными методами․ Мы часто начинаем с CountVectorizer․ Он создает словарь всех уникальных слов в нашем корпусе и для каждого документа подсчитывает, сколько раз каждое слово встречается․ Результатом является матрица, где строки — это документы, а столбцы — слова, и на пересечении — количество вхождений․ Это просто и интуитивно понятно, но имеет один недостаток: очень частые слова (вроде "и", "в", "на") получают большой вес, хотя они не несут много информации․

Чтобы решить эту проблему, мы перешли к использованию TfidfVectorizer (Term Frequency-Inverse Document Frequency)․ Этот метод не только учитывает частоту слова в документе (TF), но и наказывает слова, которые встречаются во многих документах (IDF)․ Таким образом, слова, уникальные для конкретного документа, получают больший вес, что часто приводит к гораздо лучшим результатам в задачах классификации и тематического моделирования․ Мы часто используем его для извлечения ключевых фраз и слов, например, с помощью RAKE или просто анализируя слова с высоким TF-IDF․

Сравнение векторизаторов:

| Метод векторизации | Преимущества | Недостатки | Типичное применение |

|---|---|---|---|

| CountVectorizer | Простота, скорость, сохраняет частоту | Не учитывает важность слова, большая разреженность | Базовая классификация, построение языковых моделей на N-граммах |

| TfidfVectorizer | Учитывает важность слова, лучше для редких слов | Теряет информацию о порядке слов, большая разреженность | Тематическое моделирование, поиск информации, классификация |

Word Embeddings: От Слов к Смыслу

Классические векторизаторы имеют одно существенное ограничение: они не учитывают семантическую связь между словами․ То есть, для них "кошка" и "кот", это совершенно разные сущности, хотя мы-то понимаем, что они очень близки по смыслу․ Здесь на сцену выходят Word Embeddings — плотные векторные представления слов, которые улавливают их семантические и синтаксические отношения;

Мы были в восторге, когда впервые начали работать с Word2Vec (Skip-gram и CBOW) и GloVe с использованием библиотеки Gensim․ Эти модели учатся представлять слова в виде векторов в многомерном пространстве таким образом, что слова с похожим значением оказываются близко друг к другу․ Это открыло нам двери к гораздо более глубокому пониманию текста․ Например, мы могли выполнять "векторную арифметику": "король" ౼ "мужчина" + "женщина" ≈ "королева"․ Это было настоящее озарение!

Позднее мы освоили FastText, который полезен для работы с редкими словами и языками с богатой морфологией, так как он учитывает не только целые слова, но и их подслова (n-граммы символов)․ А для представления целых документов или даже предложений мы используем Doc2Vec и Sentence Transformers, которые позволяют получать векторы для более крупных текстовых единиц, сохраняя при этом их смысл․

Контекстные Встраивания: Революция Трансформеров

И все же, даже Word2Vec и GloVe имели свои ограничения․ Они создавали один и тот же вектор для слова, независимо от его контекста․ Например, слово "банк" в значении "финансовое учреждение" и "берег реки" получало один и тот же вектор․ Это было проблемой․ И тут на сцену вышли Трансформеры․

Для нас это стало настоящей революцией․ Модели, такие как BERT (Bidirectional Encoder Representations from Transformers), а затем и целое семейство моделей от Hugging Face, изменили наше представление о текстовых представлениях․ Они создают контекстные встраивания, то есть вектор слова зависит от окружающих его слов в предложении․ Это позволяет учитывать полисемию и получать гораздо более тонкие и точные представления смысла․

Мы используем трансформеры для широкого спектра задач: от классификации текстов до распознавания именованных сущностей и генерации диалогов․ Возможность тонкой настройки (Fine-tuning) предварительно обученных моделей под наши конкретные задачи делает их невероятно мощным инструментом․ Работа с PyTorch и TensorFlow для создания нейросетей NLP, особенно на базе трансформерных архитектур, стала для нас обыденностью․

Ключевые Задачи NLP: От Распознавания до Генерации

После того как мы освоили искусство предобработки и векторизации, перед нами открылся целый мир задач, которые можно решать с помощью NLP․ Мы собрали здесь самые интересные и полезные из них, с которыми мы работаем ежедневно․

Распознавание Именованных Сущностей (NER): Выделяем Главное

NER, это как поиск иголки в стоге сена, только вместо иголок — имена людей, названия организаций, географические объекты, даты и другие важные сущности․ Мы часто используем spaCy для быстрого и эффективного NER, особенно для английского языка․ Для более сложных задач и языков с богатой морфологией, таких как русский, мы обращаемся к Flair или даже к моделям на основе BERT, которые могут быть тонко настроены для нашей предметной области․ Мы также экспериментировали с CRF (Conditional Random Fields) для распознавания сущностей, особенно когда требовался более ручной контроль над признаками․

"Язык — это дорожная карта культуры․ Он говорит вам, откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

Эта цитата очень точно отражает наше отношение к языку и его анализу․ Каждый текст несет в себе не просто информацию, но и отпечаток культуры, контекста и эмоций․ Наша задача — научиться читать эти дорожные карты․

Анализ Тональности (Sentiment Analysis): Понимаем Эмоции

Понять, что чувствуют люди, читая их текст — это бесценно․ Анализ тональности позволяет нам определить эмоциональную окраску текста: позитивную, негативную или нейтральную․ Мы начинали с простых подходов, таких как VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично работает для английского языка и учитывает даже восклицательные знаки и заглавные буквы․ Для быстрого и простого анализа мы также используем TextBlob, хотя и понимаем его ограничения․

Когда речь заходит о более глубоком анализе, особенно в социальных сетях, где много сарказма, сленга и эмодзи, мы переходим к более продвинутым моделям на основе машинного обучения и глубоких нейронных сетей․ Мы обучаем собственные классификаторы, используя размеченные данные, и тонко настраиваем трансформеры для анализа тональности финансовых новостей, отзывов о продуктах или даже сообщений в политических дискуссиях․ Это позволяет нам отслеживать общественное мнение, выявлять тренды и реагировать на них․

Тематическое Моделирование (Topic Modeling): Находим Скрытые Темы

Представьте, что у вас есть тысячи документов, и вы хотите понять, о чем они․ Прочитать все — нереально․ Здесь на помощь приходит тематическое моделирование․ Мы используем библиотеку Gensim для таких алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Эти методы позволяют нам выявлять скрытые темы в большом корпусе текстов, группируя слова, которые часто встречаются вместе․

Мы неоднократно применяли тематическое моделирование для анализа отзывов клиентов, чтобы выявить основные проблемы или преимущества продуктов, а также для категоризации статей и новостей․ Сравнение моделей тематического моделирования (LDA vs NMF) показало нам, что выбор метода сильно зависит от характеристик данных и желаемой интерпретируемости результатов․

Классификация Текстов: Автоматическая Сортировка

Классификация текста — это одна из самых распространенных задач в NLP․ Мы используем ее для автоматической категоризации писем в спам/не спам, определения жанра статьи, классификации отзывов по категориям и многого другого․ Для этой задачи мы активно применяем Scikit-learn, начиная с классических алгоритмов, таких как SVM (Support Vector Machines) и наивный байесовский классификатор․ Они просты в реализации и часто дают отличные базовые результаты․

Когда данных становится больше, а задачи сложнее, мы переходим к глубокому обучению․ PyTorch и TensorFlow позволяют нам создавать мощные нейросетевые архитектуры, включая LSTM-сети, которые хорошо работают с последовательными данными, а также использовать BERT для задач классификации, получая на порядок лучшие результаты за счет контекстных встраиваний․

Суммаризация Текста: Извлекаем Суть

В мире переизбытка информации способность быстро извлекать ключевые моменты из длинного текста становится критически важной․ Суммаризация текста помогает нам в этом․ Мы различаем два основных подхода: экстрактивную и абстрактивную суммаризацию․

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из исходного текста и объединяем их в краткое изложение․ Для этого мы часто используем алгоритмы вроде TextRank, который строит граф предложений и ранжирует их по важности․ Это отличный способ для извлечения ключевых предложений и тем․

- Абстрактивная суммаризация: Этот подход гораздо сложнее, так как он требует от модели понимания текста и генерации новых предложений, которые передают его суть, но не обязательно присутствуют в оригинале․ Здесь на помощь приходят Transformer-модели (например, из семейства Hugging Face), специально обученные для генерации текста․ Они позволяют нам создавать более связные и читабельные резюме․

Продвинутые Техники и Прикладные Задачи

Мы не стоим на месте и постоянно исследуем новые горизонты в NLP․ Вот несколько направлений, которые стали для нас особенно интересными и полезными в последнее время․

Трансформеры и Генерация Текста: Творчество Машин

Возможности Transformer-моделей выходят далеко за рамки простого понимания текста․ Мы активно используем их для генерации текста (GPT-подобные модели), что открывает невероятные перспективы: от написания черновиков статей и маркетинговых текстов до создания диалогов для чат-ботов․ Мы также применяем их для более специфических задач, таких как генерация кода или автоматическое перефразирование․ Это поразительно, насколько машины научились имитировать человеческое творчество․

Работа с Неструктурированными Данными: От Веб-Скрейпинга до PDF

Текст редко приходит к нам в идеально чистом виде․ Часто нам приходится извлекать его из различных источников․ Для веб-скрейпинга мы полагаемся на Beautiful Soup, который позволяет нам парсить HTML-страницы и извлекать нужный контент․ А для работы с PDF-документами, например, для анализа юридических документов или финансовых отчетов, мы используем PyMuPDF, который эффективно извлекает текст, таблицы и изображения․

Многоязычный NLP и Специфические Языки

Наш мир многоязычен, и наши инструменты NLP должны это учитывать․ Мы работаем с Polyglot для мультиязычной обработки текста и Stanza (от Стэнфордского университета), которая отлично подходит для языков с богатой морфологией, включая русский․ Она предоставляет продвинутую лемматизацию, POS-теггинг и синтаксический парсинг, что крайне важно для глубокого анализа․

Разработка Систем: От Чат-ботов до Факт-чекинга

Накопленные знания позволяют нам создавать полноценные системы:

- Чат-боты: Мы используем фреймворк Rasa для разработки интеллектуальных чат-ботов, способных понимать естественный язык пользователя и поддерживать диалог․

- Вопросно-ответные системы (QA): С помощью трансформеров мы можем создавать системы, которые отвечают на вопросы по заданному тексту или корпусу документов․

- Обнаружение плагиата: Применение TextDistance и других методов сравнения строк и документов позволяет нам разрабатывать эффективные системы для выявления плагиата․

- Проверка грамматики и орфографии: Мы создаем инструменты для проверки грамматики и исправления орфографии, что особенно полезно в редакционных задачах․

- Автоматическая категоризация и тегирование контента: Используя классификацию текста, мы можем автоматически присваивать теги и категории статьям, новостям или отзывам․

- Анализ стилистики текстов (авторский почерк): Это увлекательная область, где мы пытаемся определить автора текста или его уникальный стиль, анализируя лексическое богатство, частотность n-грамм и другие характеристики․

Визуализация и Анализ: Делаем Данные Видимыми

Какой толк от анализа, если его результаты нельзя наглядно представить? Мы активно используем инструменты для визуализации текстовых данных, такие как Word Clouds для отображения частотности слов или Heatmaps для сравнения документов․ А для более глубокого анализа данных, включая текстовые, мы осваиваем Sweetviz, который помогает быстро генерировать отчеты о данных․

Вызовы и Перспективы: Куда Движется NLP

Наш путь в NLP полон не только успехов, но и вызовов․ Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных, необходимостью разметки больших объемов данных для обучения моделей, а также с этическими вопросами, связанными с генерацией текста и анализом настроений․ Но каждый такой вызов — это возможность для роста и совершенствования․

Мы видим, как NLP стремительно развивается, и каждый день появляются новые, более мощные модели и подходы․ Интеграция с другими областями ИИ, такими как компьютерное зрение (например, в мультимодальных моделях), открывает совершенно новые горизонты․ Мы верим, что в ближайшем будущем NLP станет еще более интуитивным, мощным и доступным, позволяя нам создавать системы, которые смогут действительно понимать и взаимодействовать с человеческим языком на уровне, который сегодня кажется фантастикой․ Наш опыт показывает, что нет предела совершенству, и мы всегда готовы к новым открытиям в этом удивительном мире!

На этом наша статья заканчивается․ Мы надеемся, что наш рассказ о пути в NLP вдохновил вас и дал ценные ориентиры для ваших собственных исследований и проектов․ Помните, что мир обработки естественного языка огромен и постоянно меняется, но с Python в руках и жаждой знаний мы всегда будем на шаг впереди․ Удачи в ваших приключениях с текстом!

Подробнее: LSI Запросы

| Основы токенизации Python | Сравнение лемматизации NLTK spaCy | Векторизация текста TF-IDF | Применение BERT для NER | Gensim тематическое моделирование LDA |

| Анализ тональности VADER | Трансформеры Hugging Face NLP | Разработка чат-ботов Rasa | Извлечение текста из PDF Python | Word Embeddings Word2Vec GloVe |