- Разгадывая Язык: Наш Путеводитель по Магии Обработки Естественного Языка в Python

- Основы Предобработки Текста: Первые Шаги к Пониманию

- Токенизация и Стемминг: Разбираем Текст на Элементы

- Регулярные Выражения (re) и Очистка Текста: Наводим Порядок

- Лемматизация: Глубокое Понимание Форм Слов

- Работа с Многоязычными Текстами: Преодолевая Языковые Барьеры

- Извлечение Смысла: От Слов к Пониманию

- Распознавание Именованных Сущностей (NER): Имена, Места, Даты

- Тематическое Моделирование: Выявление Скрытых Темы

- Извлечение Ключевых Фраз и Предложений: Самое Важное

- Анализ Частотности Слов и N-грамм: Что Говорят Цифры

- Анализ Стилистики Текстов: За Гранью Слов

- Анализ Тональности (Sentiment Analysis): Чувства в Тексте

- Векторизация Текста: Превращение Слов в Числа

- Разработка Собственных Векторизаторов: Базовые Подходы

- Word Embeddings: Глубокое Представление Слов

- Векторизация Предложений и Документов: От Слов к Смыслу Целого

- Контекстное Встраивание и BERT для Векторизации

- Машинное Обучение для NLP: Классификация и Не Только

- Классификация Текстов: Распределение по Категориям

- Кластеризация Текстов: Поиск Групп Без Разметки

- Трансформеры в NLP: Новая Эра Глубокого Обучения

- Продвинутые Приложения NLP: От Чат-ботов до Фактчекинга

- Суммаризация Текста: Получаем Суть

- Разработка Чат-ботов: Интеллектуальные Собеседники

- Вопросно-ответные Системы (QA): Ответы по Требованию

- Машинный Перевод: Разрушая Языковые Барьеры

- Системы Обнаружения Плагиата: Защита Оригинальности

- Инструменты для Проверки Грамматики и Орфографии: Совершенствуем Текст

- Анализ Юридических Документов, Лог-файлов, Медицинских Записей: NLP в Специфических Областях

- Инструменты и Библиотеки: Наш Арсенал

- NLTK: Первый Шаг в Мир NLP

- spaCy: Скорость и Точность

- Gensim: Моделирование Тем и Эмбеддинги

- Scikit-learn: Классика Машинного Обучения

- TextBlob, Textacy, Pattern: Для Быстрых Решений

- Hugging Face Transformers, PyTorch/TensorFlow: Глубокое Обучение

- Beautiful Soup, PyMuPDF: Извлечение Текста

- Stanza, Flair, Polyglot: Для Продвинутых и Многоязычных Моделей

Разгадывая Язык: Наш Путеводитель по Магии Обработки Естественного Языка в Python

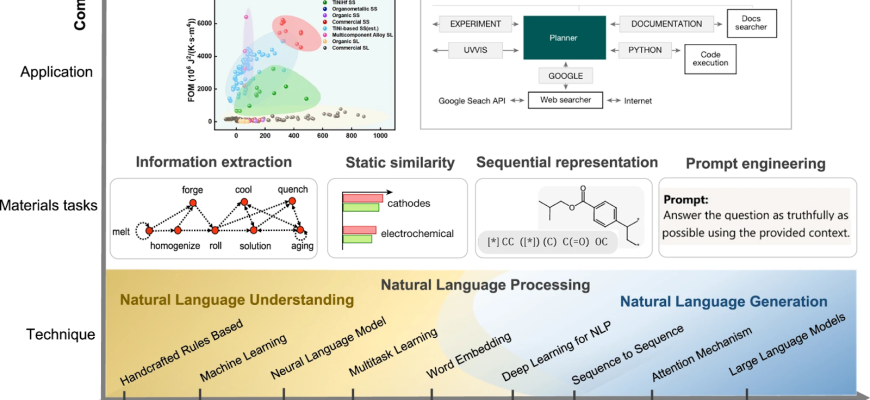

Привет, дорогие читатели и коллеги-энтузиасты технологий! Сегодня мы с вами отправимся в увлекательное путешествие по миру, где машины начинают понимать наш человеческий язык. Этот мир называется Обработка Естественного Языка, или NLP (Natural Language Processing), и он стремительно меняет то, как мы взаимодействуем с технологиями. От голосовых помощников, которые отвечают на наши вопросы, до систем, способных анализировать огромные массивы текстовых данных, NLP открывает безграничные возможности.

За последние годы мы стали свидетелями невероятного прорыва в этой области, во многом благодаря появлению мощных библиотек и фреймворков на Python. Именно Python стал де-факто стандартом для разработки NLP-приложений благодаря своей простоте, гибкости и богатой экосистеме. В этой статье мы хотим поделиться с вами нашим опытом и глубокими знаниями, которые мы накопили, работая с текстами, строя модели и решая реальные задачи. Мы раскроем самые важные концепции и инструменты, которые позволят вам не просто разобраться в NLP, но и начать создавать свои собственные проекты. Приготовьтесь, ведь мы погрузимся в самые интересные уголки этой захватывающей дисциплины!

Основы Предобработки Текста: Первые Шаги к Пониманию

Прежде чем машина сможет "понять" текст, его необходимо подготовить. Человеческий язык полон нюансов, неоднозначностей и неструктурированных данных. Мы, как блогеры, знаем, как важна чистота и ясность изложения. Точно так же и для алгоритмов NLP критически важна предобработка текста. Этот этап закладывает фундамент для всех последующих аналитических задач, превращая хаотичный поток слов в структурированные данные, с которыми уже можно работать.

Токенизация и Стемминг: Разбираем Текст на Элементы

Первое, что мы делаем, когда начинаем работать с сырым текстом, это токенизация. Этот процесс заключается в разделении текста на более мелкие единицы, называемые токенами. Токенами могут быть слова, пунктуационные знаки, цифры или даже символы. Представьте, что мы берем предложение и разбиваем его на отдельные кирпичики. Например, "Изучаем NLP на Python" превращается в ["Изучаем", "NLP", "на", "Python"]. Для этой задачи мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает различные токенизаторы, включая токенизаторы по словам и по предложениям.

После токенизации часто возникает необходимость привести слова к их базовой форме. Здесь на помощь приходят стемминг и лемматизация. Стемминг, это процесс удаления суффиксов и окончаний из слов, чтобы получить их "корень" или основу (стем). Например, слова "бегу", "бежать", "бежал" могут быть приведены к "бег". Это быстрый, но иногда грубый метод, поскольку он не всегда учитывает контекст и может приводить к несуществующим словам. Тем не менее, для многих задач, особенно когда важна скорость, стемминг оказывается весьма эффективным.

Регулярные Выражения (re) и Очистка Текста: Наводим Порядок

Наш мир наполнен текстами из самых разных источников: веб-страницы, PDF-документы, социальные сети. Каждый из этих источников добавляет свои "шумы" – HTML-теги, специальные символы, ссылки, нерелевантную пунктуацию. Чтобы справиться с этим хаосом, мы активно используем регулярные выражения (модуль `re` в Python). Это мощный инструмент для поиска и манипулирования текстовыми шаблонами. С их помощью мы можем легко удалять HTML-теги, очищать текст от ненужных символов, извлекать email-адреса или номера телефонов.

Например, чтобы удалить HTML-теги, мы можем использовать что-то вроде re.sub(r'<.*?>', '', text). Это позволяет нам получить чистый текст, готовый к дальнейшей обработке. Также на этом этапе мы часто удаляем стоп-слова – часто встречающиеся, но малоинформативные слова (например, "и", "в", "на", "он", "она"), которые могут мешать анализу, особенно при подсчете частотности слов или тематическом моделировании. Библиотеки NLTK и spaCy предоставляют списки стоп-слов для различных языков, которые мы можем использовать или расширять по своему усмотрению.

Очистка данных – это не просто удаление мусора; это также нормализация текста. Мы приводим весь текст к нижнему регистру, стандартизируем написание, обрабатываем эмодзи и сленг в современных текстах, что особенно актуально при анализе социальных сетей. Это кропотливая, но абсолютно необходимая работа, которая напрямую влияет на качество последующих результатов. Если входные данные грязные, то и результаты анализа будут сомнительными. Поэтому мы всегда уделяем этому этапу пристальное внимание, стараясь максимально улучшить качество наших данных.

Лемматизация: Глубокое Понимание Форм Слов

В отличие от стемминга, лемматизация — это более интеллектуальный процесс, который приводит слово к его словарной (канонической) форме, называемой леммой; Например, слова "бегу", "бежать", "бежал" будут приведены к "бежать", а не к "бег". Это достигается за счет использования морфологических словарей и правил языка. Лемматизация более ресурсоемка, но дает более точные результаты, что крайне важно для задач, где сохранение семантики слова имеет первостепенное значение.

Мы часто используем spaCy для лемматизации, поскольку эта библиотека предлагает быстрые и точные модели для многих языков, включая русский. NLTK также имеет свои лемматизаторы, но spaCy часто демонстрирует лучшую производительность и интеграцию с другими NLP-задачами. Для языков с богатой морфологией, таких как русский, мы также обращаем внимание на Stanza (разработанную Stanford NLP Group), которая предоставляет продвинутые инструменты для морфологического анализа и лемматизации, учитывая сложные правила словоизменения.

| Метод | Описание | Пример (из "бежал") | Преимущества | Недостатки |

|---|---|---|---|---|

| Стемминг | Удаление суффиксов для получения корня слова. | беж | Быстрый, прост в реализации. | Может создавать несуществующие слова, игнорирует контекст. |

| Лемматизация | Приведение слова к его словарной форме (лемме). | бежать | Более точный, сохраняет семантику, учитывает морфологию. | Более медленный, требует морфологических словарей. |

Работа с Многоязычными Текстами: Преодолевая Языковые Барьеры

Мир не ограничивается одним языком, и в нашей практике мы часто сталкиваемся с необходимостью обработки многоязычных текстовых корпусов. Python предлагает несколько отличных библиотек для этой задачи. Polyglot, одна из них, позволяющая работать с широким спектром языков для таких задач, как определение языка, токенизация, NER и морфологический анализ. Однако, для более глубокого анализа, особенно для языков со сложной морфологией, мы часто обращаемся к Stanza. Эта библиотека, разработанная Stanford NLP Group, предоставляет универсальные модели для различных языков, включая высокоточные инструменты для токенизации, POS-теггинга, лемматизации и синтаксического парсинга.

При работе с мультиязычными данными важно учитывать специфику каждого языка. Например, правила токенизации или определения стоп-слов могут сильно различаться. Мы всегда стараемся использовать языковые модели, специально обученные для нужного языка, чтобы обеспечить максимальную точность. Это позволяет нам эффективно анализировать тексты на разных языках, будь то анализ отзывов клиентов со всего мира или сравнение новостных статей из различных стран. Мы даже работали над системами машинного перевода на Python, хотя это и гораздо более сложная задача, требующая глубокого обучения и больших корпусов данных.

Извлечение Смысла: От Слов к Пониманию

После того как текст очищен и подготовлен, наступает самая интересная часть – извлечение из него смысла. Наша цель – не просто обработать слова, но и понять, о чем идет речь, какие сущности упоминаются, какие темы обсуждаются, и каково общее настроение текста. Это похоже на чтение между строк, но с помощью алгоритмов.

Распознавание Именованных Сущностей (NER): Имена, Места, Даты

Одной из фундаментальных задач в NLP является Распознавание Именованных Сущностей (NER). Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, организации, географические местоположения, даты, валюты и многое другое. Например, в предложении "Илон Маск посетил Берлин 10 августа 2023 года" NER может выделить "Илон Маск" как PERSON, "Берлин" как GPE (геополитическая сущность) и "10 августа 2023 года" как DATE.

Для быстрого и точного NER мы активно используем spaCy. Эта библиотека известна своей производительностью и предлагает высококачественные предварительно обученные модели для различных языков. Мы также работаем с Flair, которая предоставляет state-of-the-art модели для NER, часто дающие очень хорошие результаты, особенно для более сложных языков. В некоторых случаях, когда требуется более тонкая настройка или работа с небольшими размеченными данными, мы применяем CRF (Conditional Random Fields) – классический метод машинного обучения для задач последовательной разметки. С появлением трансформерных моделей, таких как BERT, NER стал еще более точным, поскольку эти модели способны учитывать контекст слова в предложении, что критически важно для корректного распознавания сущностей. Мы часто используем BERT для задач NER, когда требуется высокая точность и есть доступ к достаточным вычислительным ресурсам.

Тематическое Моделирование: Выявление Скрытых Темы

Представьте, что у вас есть огромная коллекция документов – тысячи статей, отзывов или новостей. Как понять, о чем они? Тематическое моделирование — это метод машинного обучения без учителя, который позволяет автоматически выявлять скрытые темы в большом корпусе текстов. Наиболее популярными алгоритмами являются LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

Мы часто используем библиотеку Gensim для тематического моделирования. Gensim предоставляет эффективные реализации LDA и LSI, позволяя нам обрабатывать большие объемы текстовых данных. LDA хорош тем, что присваивает каждому документу распределение по темам, а каждой теме – распределение по словам. Это позволяет нам не только понять, какие темы присутствуют в корпусе, но и определить, насколько сильно каждая тема представлена в конкретном документе. Мы также сравниваем модели тематического моделирования, такие как LDA и NMF (Non-negative Matrix Factorization), выбирая ту, которая лучше подходит для конкретной задачи и структуры данных. Например, для анализа текстов отзывов клиентов тематическое моделирование помогает выявить основные проблемы или преимущества продукта, о которых говорят пользователи.

Извлечение Ключевых Фраз и Предложений: Самое Важное

В больших текстах найти главное бывает непросто. Извлечение ключевых фраз и ключевых предложений (суммаризация) – это задача, которая помогает нам выделить наиболее важную информацию из документа. Для извлечения ключевых слов мы часто используем алгоритм RAKE (Rapid Automatic Keyword Extraction), который основан на частотности слов и их встречаемости с другими словами. Это простой, но эффективный метод для быстрого получения списка ключевых терминов.

Для извлечения ключевых предложений, то есть для создания экстрактивной суммаризации, мы используем алгоритм TextRank. TextRank — это алгоритм, основанный на PageRank, который ранжирует предложения в тексте на основе их важности и связей с другими предложениями. Это позволяет нам автоматически генерировать краткие выжимки из длинных текстов, что незаменимо для быстрого ознакомления с содержанием. Библиотека Textacy также предоставляет полезные инструменты для извлечения информации, включая n-граммы и именованные сущности, что дополняет наш арсенал.

Анализ Частотности Слов и N-грамм: Что Говорят Цифры

Простой, но мощный способ анализа текста – это подсчет частотности слов и N-грамм. N-грамма – это последовательность из N слов. Например, для предложения "Изучаем NLP на Python" 2-граммы (биграммы) будут ["Изучаем NLP", "NLP на", "на Python"]. Анализ частотности слов помогает нам понять, какие термины являются наиболее важными или часто используемыми в данном корпусе. Это может быть полезно для создания облаков слов или для выявления основных тем.

Анализ N-грамм позволяет нам увидеть, какие словосочетания или фразы встречаются чаще всего. Это особенно ценно для понимания контекста и выявления устойчивых выражений. Например, в отзывах о продукте частотность "плохой сервис" как 2-граммы может указывать на конкретную проблему. Мы используем этот метод для анализа поведенческих паттернов в чатах, изучения пользовательских запросов или выявления сезонности в текстовых данных, когда определенные фразы становятся популярными в определенные периоды.

Анализ Стилистики Текстов: За Гранью Слов

Помимо содержания, текст несет в себе информацию о своем авторе, его манере изложения, тоне. Анализ стилистики текстов позволяет нам выявлять авторский почерк, сравнивать тексты разных авторов или определять, насколько текст соответствует определенному стилю (например, формальному или разговорному). Это включает в себя анализ длины предложений, разнообразия словарного запаса (лексического богатства), использования определенных частей речи или синтаксических конструкций.

Мы используем различные метрики для оценки лексической сложности текстов, такие как индекс Флеша или показатель удобочитаемости Колман-Лиау. Разработка системы для определения авторства текста – это сложная, но крайне интересная задача, которая находит применение в криминалистике или при анализе литературных произведений. Это позволяет нам не только понять, "что" говорится, но и "как" это говорится, открывая новые грани в понимании текста.

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

Понимание эмоций и мнений, выраженных в тексте, является одной из самых востребованных задач NLP. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли текст положительным, отрицательным или нейтральным. Это бесценно для анализа отзывов клиентов, мониторинга социальных сетей, финансовых новостей или политических дискуссий.

Для базового анализа тональности мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner), которая хорошо работает с текстами из социальных сетей и учитывает использование эмодзи, сленга и пунктуации для усиления или ослабления эмоциональной окраски. TextBlob также предлагает простой и быстрый способ определения тональности, хотя его точность может быть ниже для сложных или специфических текстов.

"Язык, это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Для более продвинутых задач, таких как анализ тональности финансовых новостей или сообщений в социальных сетях с учетом сарказма, мы часто обучаем собственные модели машинного обучения или используем предварительно обученные трансформерные модели. Выявление сарказма – это особенно сложная задача, поскольку она требует глубокого контекстуального понимания и часто противоречит прямому значению слов. Мы всегда помним, что точность анализа тональности сильно зависит от качества обучающих данных и специфики предметной области. Например, слово "высокий" в контексте "высокие цены" имеет отрицательную коннотацию, тогда как в "высокое качество" – положительную. Поэтому настройка моделей под конкретные задачи является нашим приоритетом.

Векторизация Текста: Превращение Слов в Числа

Компьютеры не "понимают" слова в том смысле, в каком это делаем мы. Для них текст – это просто последовательность символов. Чтобы машины могли работать с текстом, его необходимо преобразовать в числовой формат. Этот процесс называется векторизацией текста или встраиванием слов (Word Embeddings), и он является ключевым этапом в любом NLP-проекте. Мы переводим слова и предложения в векторы чисел, которые затем могут быть использованы алгоритмами машинного обучения.

Разработка Собственных Векторизаторов: Базовые Подходы

Начнем с классических методов. CountVectorizer и TfidfVectorizer – это два фундаментальных инструмента в нашем арсенале для векторизации текста.

- CountVectorizer: Этот метод просто подсчитывает частоту встречаемости каждого слова в документе. Для каждого документа создается вектор, где каждое измерение соответствует уникальному слову в корпусе, а значение – количеству его вхождений. Просто, но эффективно для многих задач.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Это более продвинутый метод, который не только учитывает частоту слова в документе (TF), но и его важность, снижая вес слов, которые часто встречаются во всем корпусе (IDF). Таким образом, слова, уникальные для конкретного документа, получают больший вес. Мы часто используем TF-IDF для задач классификации текстов и извлечения ключевых слов, так как он хорошо выделяет наиболее значимые термины.

Эти векторизаторы создают разреженные матрицы, что означает, что большинство значений в них равны нулю. Для больших корпусов это может приводить к очень большим векторам, но они остаются основой для понимания того, как текст преобразуется в числовое представление. Мы постоянно сравниваем различные методы векторизации, такие как TF-IDF и Word2Vec, чтобы выбрать оптимальный для конкретной задачи, учитывая баланс между простотой, скоростью и точностью.

Word Embeddings: Глубокое Представление Слов

Классические векторизаторы не учитывают семантические отношения между словами. Здесь на помощь приходят Word Embeddings – векторные представления слов, которые улавливают их смысловое значение и контекст. Слова с похожим значением будут расположены близко друг к другу в многомерном векторном пространстве.

Наиболее известные модели Word Embeddings:

- Word2Vec: Разработанный Google, Word2Vec использует нейронные сети для обучения векторных представлений слов. Он имеет два основных архитектуры:

- Skip-gram: Предсказывает окружающие слова (контекст) по текущему слову.

- CBOW (Continuous Bag of Words): Предсказывает текущее слово по его контексту.

- GloVe (Global Vectors for Word Representation): Разработанный Stanford University, GloVe сочетает в себе статистические методы глобальной матричной факторизации и локальные контекстные окна Word2Vec. Он также создает векторные представления, которые хорошо улавливают семантику.

- FastText: Расширение Word2Vec от Facebook, FastText учитывает субсловесные единицы (символьные N-граммы). Это позволяет ему лучше работать с редкими словами, словами с опечатками и языками с богатой морфологией, где одно слово может иметь множество форм. Мы часто применяем FastText, когда сталкиваемся с проблемами редких слов или необходимостью работы с большим словарным запасом.

Мы используем библиотеку Gensim для эффективной работы с Word2Vec, позволяя нам обучать собственные модели на наших данных или использовать предварительно обученные.

Сравнение моделей Word2Vec (Skip-gram vs CBOW) показывает, что Skip-gram обычно лучше работает с небольшими обучающими данными и редкими словами, тогда как CBOW быстрее обучается. Выбор зависит от размера нашего корпуса и специфики задачи.

Векторизация Предложений и Документов: От Слов к Смыслу Целого

Когда нам нужно представить не отдельное слово, а целое предложение или документ в виде вектора, мы переходим к более сложным методам. Doc2Vec (расширение Word2Vec) позволяет нам создавать векторные представления для целых документов. Это очень полезно для задач, таких как поиск похожих документов или кластеризация.

Современные подходы, такие как Sentence Transformers, позволяют генерировать высококачественные эмбеддинги предложений, которые сохраняют их семантический смысл. Эти модели часто основаны на архитектурах трансформеров и демонстрируют отличные результаты в задачах сравнения сходства предложений, поиска релевантной информации или суммаризации. Мы также используем векторизацию с учётом контекста (контекстное встраивание), которая стала возможной благодаря появлению трансформерных моделей.

Контекстное Встраивание и BERT для Векторизации

Революция в NLP произошла с появлением архитектуры Трансформеров и таких моделей, как BERT (Bidirectional Encoder Representations from Transformers). Главное отличие BERT и других трансформерных моделей от Word2Vec или GloVe заключается в том, что они генерируют контекстно-зависимые эмбеддинги. Это означает, что одно и то же слово может иметь разные векторные представления в зависимости от контекста, в котором оно используется. Например, слово "банк" в предложении "пойти в банк" и "берег реки банк" будет иметь совершенно разные векторы.

Мы активно используем BERT для векторизации предложений и документов, так как это позволяет нам получать гораздо более богатые и информативные представления. Эти векторы затем могут быть использованы для широкого спектра задач: от классификации текстов и NER до вопросно-ответных систем и анализа тональности. Fine-tuning предварительно обученных моделей BERT на наших специфических данных позволяет нам достигать еще более высоких результатов, адаптируя модель под уникальные особенности нашей предметной области.

Машинное Обучение для NLP: Классификация и Не Только

После того как текст преобразован в числовые векторы, мы можем применять мощные алгоритмы машинного обучения для решения самых разнообразных задач. Это позволяет нам обучать машины принимать решения на основе текстовых данных, будь то категоризация статей, предсказание тональности или ответы на вопросы.

Классификация Текстов: Распределение по Категориям

Классификация текстов – это одна из самых распространенных задач в NLP. Мы используем ее для автоматической категоризации статей, фильтрации спама, маршрутизации запросов клиентов или определения жанра документа. Для этих целей мы часто обращаемся к библиотеке Scikit-learn, которая предоставляет широкий спектр классификаторов:

- SVM (Support Vector Machines): Мощный алгоритм, который хорошо работает с текстовыми данными, особенно когда они представлены в виде высокоразмерных векторов.

- Наивный Байесовский Классификатор (Naive Bayes): Простой, но часто очень эффективный алгоритм, основанный на теореме Байеса. Особенно хорошо подходит для больших наборов данных.

- Логистическая регрессия, Деревья решений, Случайный лес и другие.

Для более сложных задач, где требуется улавливать тонкие контекстуальные зависимости, мы переходим к нейронным сетям. С использованием PyTorch или TensorFlow мы создаем и обучаем LSTM-сети (Long Short-Term Memory). LSTM-сети – это разновидность рекуррентных нейронных сетей, которые особенно хорошо подходят для обработки последовательных данных, таких как текст, так как они способны "запоминать" информацию на протяжении длинных последовательностей. Они позволяют нам достигать высокой точности в задачах, где важен порядок слов и долгосрочные зависимости.

Кластеризация Текстов: Поиск Групп Без Разметки

В отличие от классификации, где мы имеем заранее определенные категории, кластеризация текстов – это метод машинного обучения без учителя, который позволяет нам находить естественные группы или кластеры в наборе документов без предварительной разметки. Это полезно, когда мы не знаем, какие категории существуют, и хотим обнаружить скрытые структуры в данных.

Мы используем алгоритмы K-Means и DBSCAN, доступные в Scikit-learn, для группировки похожих документов. Например, мы можем кластеризовать отзывы о продуктах по категориям или сгруппировать новостные статьи по темам, которые модель обнаруживает самостоятельно. Сравнение алгоритмов кластеризации (K-Means vs DBSCAN) показывает, что K-Means лучше подходит для сферических кластеров с одинаковым размером, тогда как DBSCAN может обнаруживать кластеры произвольной формы и хорошо справляется с шумом. Выбор алгоритма зависит от предполагаемой структуры данных и наших целей.

Трансформеры в NLP: Новая Эра Глубокого Обучения

Архитектура трансформеров, представленная в статье "Attention Is All You Need", произвела революцию в NLP. Это позволило нам преодолеть многие ограничения рекуррентных нейронных сетей и достичь беспрецедентной производительности в широком спектре задач. Библиотека Hugging Face Transformers стала нашим незаменимым инструментом для работы с этими моделями. Она предоставляет доступ к сотням предварительно обученных моделей, таких как BERT, GPT, T5, RoBERTa и многим другим.

Трансформеры используются для:

- Сложных задач NLP: NER, классификация, суммаризация, вопросно-ответные системы.

- Генерации текста: Модели, такие как GPT (Generative Pre-trained Transformer), способны генерировать связный и осмысленный текст на основе заданного начала. Мы используем их для создания контента, генерации диалогов для чат-ботов или даже для написания кода.

- Машинного перевода: Трансформерные модели стали стандартом в машинном переводе, обеспечивая значительно более высокое качество по сравнению с предыдущими подходами.

- Тонкой настройки (Fine-tuning): Мы берем предварительно обученную на огромных массивах данных модель и дообучаем ее на небольшом, специфическом для нашей задачи наборе данных. Это позволяет нам адаптировать мощь больших моделей к нашим уникальным потребностям.

- Вопросно-ответных систем (QA): Трансформеры отлично справляются с поиском ответов на вопросы в тексте, что является основой для создания продвинутых QA-систем;

BERT, в частности, зарекомендовал себя как мощный инструмент для задач классификации и NER благодаря своей способности создавать глубокие контекстуальные представления слов. Мы также исследуем применение трансформеров для анализа кода и его сжатия, что открывает новые возможности в области программной инженерии.

Продвинутые Приложения NLP: От Чат-ботов до Фактчекинга

NLP – это не только теоретические концепции, но и практические приложения, которые меняют нашу повседневную жизнь и бизнес-процессы. Мы активно участвуем в разработке таких систем, которые автоматизируют рутинные задачи, улучшают взаимодействие с пользователями и помогают извлекать ценные инсайты из неструктурированных данных.

Суммаризация Текста: Получаем Суть

В мире, перегруженном информацией, способность быстро извлекать суть из длинных документов становится критически важной. Суммаризация текста позволяет нам автоматически создавать краткие выжимки. Существует два основных подхода:

- Экстрактивная суммаризация (Extractive Summarization): Извлекает наиболее важные предложения из исходного текста и объединяет их в краткое изложение. Это то, что мы делаем с TextRank.

- Абстрактивная суммаризация (Abstractive Summarization): Генерирует новое изложение, которое может содержать слова и фразы, не присутствующие в оригинальном тексте, подобно тому, как человек пересказывает текст своими словами. Это более сложная задача, которая часто решается с использованием Transformer-моделей (например, T5, BART).

Мы разрабатываем системы суммаризации текста, которые помогают нашим клиентам быстро ориентироваться в больших объемах информации – от новостных лент до юридических документов. Сравнение моделей суммирования: экстрактивная и абстрактная, показывает, что экстрактивные методы быстрее и проще в реализации, но абстрактивные предлагают более связные и естественные резюме, хотя и требуют более сложных моделей и больших вычислительных ресурсов.

Разработка Чат-ботов: Интеллектуальные Собеседники

Чат-боты стали неотъемлемой частью клиентского сервиса и взаимодействия с пользователями. Мы активно занимаемся разработкой чат-ботов на Python, используя такие фреймворки, как Rasa. Rasa – это мощный опенсорсный фреймворк, который позволяет создавать контекстно-зависимых, многофункциональных чат-ботов с возможностью понимания естественного языка (NLU) и управления диалогами (Dialogue Management).

Мы обучаем ботов понимать намерения пользователей, извлекать сущности из их запросов и вести осмысленные диалоги. Это включает в себя не только обработку запросов, но и работу с эмодзи и сленгом в современных текстах, чтобы бот звучал естественно и эффективно решал задачи пользователя. Разработка чат-ботов требует глубокого понимания NLP, машинного обучения и умения проектировать пользовательские диалоги.

Вопросно-ответные Системы (QA): Ответы по Требованию

Представьте систему, которая может прочитать большой документ и ответить на любой вопрос, связанный с его содержанием. Это и есть вопросно-ответные системы (QA). С появлением трансформерных моделей, таких как BERT, QA-системы достигли впечатляющих результатов. Мы используем эти модели для разработки систем, которые могут извлекать точные ответы из текста, будь то FAQ на основе документов или поиск информации в обширной базе знаний.

Разработка таких систем требует тонкой настройки моделей и тщательной подготовки данных, но результат – это значительное сокращение времени на поиск информации и повышение удовлетворенности пользователей.

Машинный Перевод: Разрушая Языковые Барьеры

Хотя создание собственных систем машинного перевода с нуля – это колоссальная задача, с использованием Transformer-моделей и библиотек, таких как Hugging Face, мы можем применять или тонко настраивать уже существующие мощные модели для решения специфических задач. Например, для автоматического перевода узкоспециализированных текстов, где стандартные переводчики могут давать неточные результаты.

Мы работаем с обработкой многоязычных текстовых корпусов, и машинный перевод является логическим продолжением этой работы. Это позволяет нам автоматизировать процесс перевода, делая информацию доступной для более широкой аудитории.

Системы Обнаружения Плагиата: Защита Оригинальности

В академической и издательской сферах обнаружение плагиата является критически важной задачей. Мы используем методы NLP и библиотеки, такие как TextDistance, для измерения сходства между документами и выявления потенциальных случаев плагиата. TextDistance предоставляет различные алгоритмы для сравнения строк и текстов, такие как Левенштейн, Джаро-Винклер, Косинусное сходство и другие.

Разработка таких систем требует не только сравнения текстов, но и понимания семантического сходства, чтобы обнаруживать перефразированный контент.

Инструменты для Проверки Грамматики и Орфографии: Совершенствуем Текст

Качество текста напрямую влияет на его восприятие. Мы разрабатываем инструменты для проверки грамматики и орфографии, используя различные NLP-методы. Это включает в себя не только обнаружение опечаток, но и исправление орфографии, проверку синтаксиса и стилистики.

Для исправления орфографии мы можем использовать алгоритмы расстояния Левенштейна в сочетании со словарями. Для грамматики – более сложные синтаксические парсеры и модели, обученные на больших корпусах корректного текста. Эти инструменты помогают нам и нашим пользователям создавать более качественный и профессиональный контент.

Анализ Юридических Документов, Лог-файлов, Медицинских Записей: NLP в Специфических Областях

NLP находит применение не только в общих задачах, но и в узкоспециализированных областях. Мы работаем над анализом юридических документов, лог-файлов и медицинских записей.

- Юридические документы: Извлечение дат, имен сторон, ключевых положений, анализ текстов в юридических контрактах, автоматическая категоризация.

- Лог-файлы: Анализ текста для выявления аномалий, ошибок, паттернов поведения систем.

- Медицинские записи: Извлечение информации о симптомах, диагнозах, препаратах, разработка инструментов для автоматической разметки данных.

Эти задачи требуют не только общих знаний NLP, но и глубокого понимания специфики предметной области, а также тщательной настройки моделей под уникальный жаргон и структуру данных. Часто это связано с обработкой неполных и ошибочных данных, что представляет собой отдельную проблему. Для извлечения текста из PDF-документов, которые часто встречаются в этих областях, мы используем библиотеку PyMuPDF.

Инструменты и Библиотеки: Наш Арсенал

Мы уже упоминали многие библиотеки по ходу статьи, но давайте соберем их вместе, чтобы у вас было полное представление о нашем инструментарии. Python предлагает богатую экосистему для NLP, и выбор правильного инструмента для задачи – это половина успеха.

NLTK: Первый Шаг в Мир NLP

NLTK (Natural Language Toolkit) – это, пожалуй, самая известная и старейшая библиотека для NLP в Python. Мы часто начинаем с нее, когда погружаемся в основы. NLTK предоставляет широкий спектр инструментов для:

- Токенизации (word_tokenize, sent_tokenize).

- Стемминга (PorterStemmer, SnowballStemmer).

- Лемматизации (WordNetLemmatizer).

- POS-теггинга (разметка частей речи).

- Работы со стоп-словами, корпусами и словарями.

- Проведения морфологического анализа.

NLTK отлично подходит для обучения и экспериментов, но для продакшн-систем мы часто переходим к более производительным решениям.

spaCy: Скорость и Точность

spaCy – это современная, производительная и эффективная библиотека для NLP. Она оптимизирована для работы с большими объемами текста и часто используется в промышленных решениях. Мы выбираем spaCy для:

- Быстрого NER (Распознавание именованных сущностей).

- Продвинутой лемматизации.

- Синтаксического парсинга (анализ зависимостей).

- POS-теггинга.

- Токенизации.

- Работы с векторными представлениями слов (Word Vectors).

spaCy предлагает предварительно обученные модели для различных языков, что значительно упрощает разработку. Разработка систем для определения авторства текста часто выигрывает от использования синтаксического парсинга spaCy.

Gensim: Моделирование Тем и Эмбеддинги

Gensim – это библиотека, специализирующаяся на моделировании тем и векторных представлениях слов. Мы используем Gensim для:

- Тематического моделирования (LDA, LSI).

- Обучения и работы с Word Embeddings (Word2Vec, Doc2Vec, FastText).

- Анализа больших текстовых массивов (Big Data NLP) благодаря своей эффективности.

Gensim идеально подходит для задач, где нам нужно извлечь скрытые темы из текста или получить векторные представления для слов и документов.

Scikit-learn: Классика Машинного Обучения

Scikit-learn – это наш основной инструмент для классического машинного обучения, который прекрасно интегрируется с NLP-пайплайнами. Мы используем его для:

- Классификации текстов (SVM, Наивный Байесовский Классификатор, Логистическая регрессия).

- Кластеризации текстов (K-Means, DBSCAN).

- Разработки собственных векторизаторов (CountVectorizer, TfidfVectorizer).

Scikit-learn позволяет нам быстро прототипировать и сравнивать различные модели машинного обучения для NLP задач.

TextBlob, Textacy, Pattern: Для Быстрых Решений

Для более простых задач или быстрого прототипирования мы обращаемся к следующим библиотекам:

- TextBlob: Предоставляет простой API для общих задач NLP, таких как POS-теггинг, извлечение существительных, анализ тональности и определение языка. Мы используем TextBlob для простого NLP, но также знаем о его ограничениях и альтернативах для более сложных сценариев.

- Textacy: Построенная на spaCy, Textacy предоставляет высокоуровневые инструменты для извлечения информации, нормализации текста, анализа зависимостей и многого другого.

- Pattern: Это веб-майнинговая библиотека для Python с инструментами для NLP, машинного обучения, веб-скрапинга. Мы используем Pattern для анализа социальных сетей, тональности и работы с глаголами/существительными.

Hugging Face Transformers, PyTorch/TensorFlow: Глубокое Обучение

Для передовых задач и глубокого обучения наш выбор падает на:

- Hugging Face Transformers: Эта библиотека стала золотым стандартом для работы с трансформерными моделями (BERT, GPT, T5 и др.). Мы используем ее для всего – от классификации и NER до генерации текста и машинного перевода.

- PyTorch/TensorFlow: Фундаментальные фреймворки для создания нейросетей NLP. Мы применяем их для создания LSTM-сетей, тонкой настройки трансформеров и разработки собственных моделей глубокого обучения.

Beautiful Soup, PyMuPDF: Извлечение Текста

Прежде чем анализировать текст, его нужно получить.

- Beautiful Soup: Наш основной инструмент для веб-скрейпинга текста. Он позволяет нам легко парсить HTML и XML документы, извлекая нужную информацию с веб-страниц.

- PyMuPDF: Для извлечения текста из PDF-документов, особенно когда нужно работать со сложной структурой или большим объемом файлов.

Stanza, Flair, Polyglot: Для Продвинутых и Многоязычных Моделей

Когда стандартных решений недостаточно, мы обращаемся к специализированным библиотекам:

- Stanza: Для языков с богатой морфологией (например, русский) Stanza предлагает высокоточные модели для токенизации, лемматизации, POS-теггинга и синтаксического парсинга.

- Flair: Известна своими state-of-the-art моделями для NER, POS-теггинга и векторизации предложений, часто обеспечивая высокую точность.

- Polyglot: Для мультиязычности, особенно для анализа редких языков, Polyglot предоставляет широкий спектр функций.

Конечно, наш арсенал не ограничивается только этими инструментами. Мы постоянно исследуем новые библиотеки, такие как Sweetviz для анализа текстовых данных, Jellyfish для сравнения строк, Gentle для распознавания речи (Speech-to-Text) и многие другие, чтобы всегда быть на острие технологий и предлагать наиболее эффективные решения. Мы также активно используем инструменты для визуализации текстовых данных (Word Clouds, Heatmaps) для наглядного представления результатов анализа.

Мы с вами прошли долгий, но, надеемся, увлекательный путь по необъятному миру Обработки Естественного Языка в Python. От основ предобработки текста, таких как токенизация и лемматизация, до сложных трансформерных моделей и их применения в чат-ботах и вопросно-ответных системах – мы постарались охватить самые важные аспекты этой динамично развивающейся области. Мы увидели, как Python, с его богатой экосистемой библиотек, таких как NLTK, spaCy, Gensim, Scikit-learn и Hugging Face Transformers, становится настоящим швейцарским армейским ножом для любого NLP-специалиста.

Наш опыт показывает, что ключ к успеху в NLP лежит не только в знании алгоритмов и инструментов, но и в глубоком понимании самого языка, его нюансов и контекстов. Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных, с необходимостью адаптировать модели под специфические языки или предметные области. Но именно эти вызовы делают нашу работу такой интересной и значимой.

Будущее NLP обещает еще больше инноваций. Мы видим, как модели становятся все более умными, способными не только понимать, но и генерировать текст, адаптироваться к новым задачам с минимальным количеством данных, и даже проявлять зачатки "здравого смысла". Мы убеждены, что каждый из вас, вооружившись знаниями и инструментами, о которых мы рассказали, сможет внести свой вклад в эту захватывающую область. Начните экспериментировать, создавайте свои проекты, и вы увидите, как магия NLP оживает в ваших руках. Мир текста ждет своих исследователей, и мы надеемся, что эта статья вдохновила вас на новые открытия!

Подробнее

| Ключевые Запросы | Ключевые Запросы | Ключевые Запросы | Ключевые Запросы | Ключевые Запросы |

|---|---|---|---|---|

| Основы NLTK и токенизация | Использование spaCy для NER | Тематическое моделирование LDA Gensim | Классификация текстов Scikit-learn | Word2Vec и GloVe Python |

| Анализ тональности VADER Python | Разработка векторизаторов текста | Трансформеры Hugging Face NLP | Суммаризация текста Abstractive Extractive | Разработка чат-ботов Rasa |