- Разгадывая Тайны Человеческого Языка: Наш Путь в Мир NLP с Python

- Первые шаги: NLTK и spaCy – наши верные спутники

- Глубже в Текст: Векторизация и Тематическое Моделирование

- Превращаем слова в числа: Векторизаторы Scikit-learn и Word Embeddings

- Поиск скрытых смыслов: Библиотека Gensim для тематического моделирования

- Практическое Применение NLP: От Анализа Тональности до Классификации

- Распознавание Эмоций: Анализ тональности (Sentiment Analysis)

- Категоризация и Классификация Текстов

- Извлечение Информации: Ключевые Фразы и Сущности

- Погружение в Глубины: Нейронные Сети и Трансформеры в NLP

- Эра Нейронных Сетей: PyTorch/TensorFlow и LSTM

- Революция Трансформеров: Hugging Face, BERT и GPT

- Расширяя Горизонты: От Веб-Скрейпинга до Мультиязычности

- Сбор и Очистка Текстовых Данных

- Мультиязычный NLP

- Специализированные Задачи и Продвинутые Применения

- Автоматизация и Интеллектуальные Системы

- Специфические Инструменты и Вызовы

- Экосистема Python для NLP: Обзор Библиотек и Инструментов

- Основные Библиотеки, Которые Мы Использовали

- Менее Известные, но Полезные Инструменты

Разгадывая Тайны Человеческого Языка: Наш Путь в Мир NLP с Python

Добро пожаловать, дорогие читатели, в увлекательное путешествие по безграничным просторам обработки естественного языка (NLP) с использованием мощи Python! Мы, как опытные исследователи и энтузиасты, уже не один год погружаемся в этот мир, где машины учатся понимать, интерпретировать и даже генерировать человеческую речь. Это не просто набор алгоритмов и библиотек; это целая философия взаимодействия человека и компьютера, открывающая невиданные ранее возможности. Представьте себе: миллиарды слов, ежедневно генерируемых по всему миру, скрывают в себе бесценные инсайты, тенденции, эмоции и знания. И наша задача — научить наши системы находить эти сокровища, извлекать их и использовать на благо.

Наш опыт показал, что освоение NLP — это непрерывный процесс, полный открытий и вызовов. От простых задач, таких как подсчет слов, до создания сложных нейросетевых моделей, способных вести осмысленный диалог, каждый шаг углубляет наше понимание того, как язык структурирует наше мышление и взаимодействие. Мы приглашаем вас присоединиться к нам и узнать, какие инструменты и методы мы используем, чтобы превратить хаотичный поток текста в упорядоченную и ценную информацию. Приготовьтесь к погружению в мир токенизации, стемминга, лемматизации, тематического моделирования и многого другого, что делает NLP такой захватывающей областью.

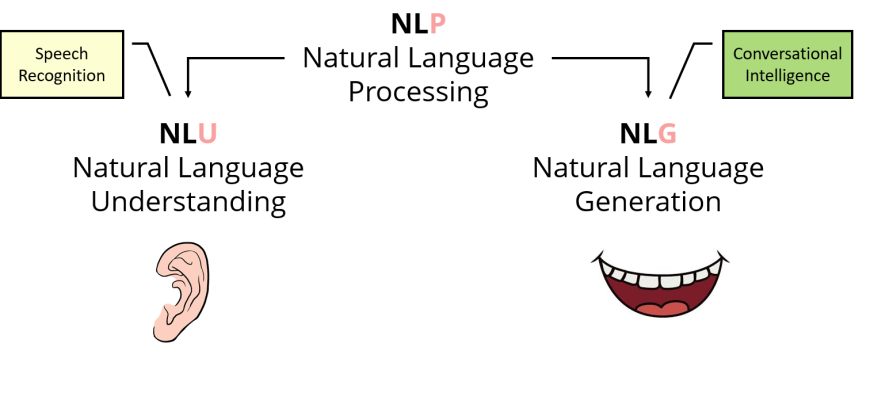

Обработка естественного языка, или NLP, это область искусственного интеллекта, которая занимается взаимодействием компьютеров и человеческого (естественного) языка. Основная цель — дать машинам способность читать, понимать и генерировать человеческий язык так, как это делают люди. Почему это так важно в современном мире? Ответ прост: большая часть информации, которую мы производим и потребляем, представлена в текстовом виде. От электронных писем и сообщений в социальных сетях до научных статей и юридических документов — текст везде. Без NLP мы бы тонули в океане неструктурированных данных, неспособные извлечь из них смысл.

Мы начали свой путь с осознания огромного потенциала NLP. Мы видели, как компании борются с анализом отзывов клиентов, как журналисты пытаются найти ключевые факты в потоке новостей, как разработчики мечтают о чат-ботах, способных вести диалог без скриптов. Эти реальные проблемы вдохновили нас на изучение инструментов и методов, которые могли бы помочь. Мы быстро поняли, что Python с его богатой экосистемой библиотек является идеальным выбором для этой задачи. Он предоставляет как высокоуровневые, готовые к использованию решения, так и низкоуровневые инструменты для тонкой настройки и экспериментов.

Первые шаги: NLTK и spaCy – наши верные спутники

Наши первые шаги в мире NLP были тесно связаны с двумя фундаментальными библиотеками: NLTK (Natural Language Toolkit) и spaCy. NLTK стал для нас своего рода университетским курсом в миниатюре, предоставив обширный набор алгоритмов и данных для изучения основ. Он научил нас таким базовым операциям, как токенизация и стемминг, без которых невозможно представить какую-либо серьезную работу с текстом.

Основы NLTK: Токенизация и стемминг

Мы быстро освоили NLTK для выполнения таких задач:

- Токенизация: Это процесс разбиения текста на отдельные слова или предложения. Например, фраза "Привет, мир!" будет разбита на токены ["Привет", ",", "мир", "!"]. Мы использовали различные токенизаторы из NLTK, такие как `word_tokenize` и `sent_tokenize`, в зависимости от наших задач.

- Стемминг: Это процесс приведения слов к их корневой форме путем отсечения суффиксов. Например, слова "бежать", "бежит", "бежал" могут быть приведены к "беж". Мы экспериментировали со стеммерами Портера и Сноуболла, понимая, что они не всегда сохраняют лингвистическую корректность, но часто достаточны для информационного поиска.

- Лемматизация: В отличие от стемминга, лемматизация приводит слова к их словарной (нормальной) форме с учетом морфологии языка. "Бежать", "бежит", "бежал" станут "бежать". Мы поняли, что это более трудоемкий, но и более точный процесс, особенно важный для анализа тональности или тематического моделирования.

Использование spaCy для быстрого NER

Вскоре мы поняли, что для более сложных и производительных задач нам нужен инструмент помощнее, и так мы открыли для себя spaCy. Эта библиотека поразила нас своей скоростью и точностью, особенно в задачах распознавания именованных сущностей (NER). NER позволяет нам автоматически находить в тексте имена людей, организаций, географические названия, даты и другие важные сущности.

| Функционал | NLTK | spaCy |

| Токенизация | Гибкая, много алгоритмов | Быстрая, предустановленная |

| Стемминг/Лемматизация | Стеммеры (Porter, Snowball), WordNetLemmatizer | Встроенная высококачественная лемматизация |

| Распознавание сущностей (NER) | Требует настройки, не так развито | Высокопроизводительное, предустановленные модели |

| Зависимостный парсинг | Есть, но менее эффективно | Быстрый и точный |

| Поддержка языков | Много языков, но часто требует ручных ресурсов | Оптимизированные модели для многих языков |

Мы обнаружили, что spaCy идеально подходит для производственных систем, где важна скорость и точность. Его предобученные модели позволяют начать работу с NER практически мгновенно, что значительно ускоряет процесс разработки. Мы использовали spaCy для извлечения информации из новостных статей, автоматизации заполнения форм и даже для анализа медицинских записей, где точность в распознавании сущностей критически важна.

Глубже в Текст: Векторизация и Тематическое Моделирование

После того как мы научились разбивать текст на части и извлекать базовые сущности, перед нами встала следующая задача: как заставить компьютер "понимать" смысл слов и документов? Человеческий язык богат нюансами, синонимами и контекстом, которые машины изначально не видят. Здесь на помощь приходят методы векторизации текста и тематического моделирования, позволяющие преобразовать слова в числовые векторы и выявить скрытые темы.

Превращаем слова в числа: Векторизаторы Scikit-learn и Word Embeddings

Компьютеры работают с числами, поэтому для анализа текста нам необходимо преобразовать слова и документы в числовые представления. Мы использовали несколько подходов, каждый из которых имеет свои преимущества.

Разработка собственных векторизаторов текста (CountVectorizer, TfidfVectorizer)

Наши первые эксперименты с векторизацией начались с библиотеки Scikit-learn, которая предлагает удобные и эффективные инструменты:

- CountVectorizer: Этот векторизатор создает матрицу, где каждая строка представляет документ, а каждый столбец — уникальное слово из всего корпуса. Значение в ячейке — это количество вхождений слова в документ. Это простой, но эффективный метод для задач, где частота слова является важным показателем.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF — это более продвинутый подход, который не просто считает слова, но и взвешивает их значимость. Он учитывает, насколько часто слово встречается в конкретном документе (TF) и насколько редко оно встречается во всем корпусе документов (IDF). Таким образом, слова, уникальные для данного документа, получают больший вес, что помогает нам выявлять более релевантную информацию.

Мы часто использовали TF-IDF для классификации текстов и извлечения ключевых фраз, так как он отлично справляется с задачей выделения наиболее информативных слов.

Word Embeddings: Word2Vec и GloVe с использованием Gensim

Хотя CountVectorizer и TF-IDF хороши для многих задач, они не учитывают семантическую связь между словами. То есть, слова "король" и "королева" воспринимаются как совершенно разные, хотя интуитивно мы понимаем их родство. Здесь на сцену выходят Word Embeddings (векторные представления слов).

Мы активно работали с библиотекой Gensim, которая предоставила нам инструменты для создания и использования Word2Vec и GloVe моделей. Эти модели учатся представлять слова в виде многомерных векторов таким образом, что слова с похожим значением или контекстом располагаются близко друг к другу в векторном пространстве.

Например, в векторном пространстве:

- Вектор("король") ⏤ Вектор("мужчина") + Вектор("женщина") ≈ Вектор("королева")

Это открыло для нас совершенно новые возможности в задачах поиска синонимов, рекомендательных систем и анализа сходства документов.

Поиск скрытых смыслов: Библиотека Gensim для тематического моделирования

Текстовые данные часто содержат скрытые темы, которые не всегда очевидны при беглом просмотре. Тематическое моделирование позволяет нам автоматически обнаруживать эти темы в больших коллекциях документов. Мы активно использовали Gensim для этого.

LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)

Мы применяли два основных алгоритма тематического моделирования:

- LSI (Latent Semantic Indexing): Один из старейших, но все еще эффективных методов. Он использует сингулярное разложение (SVD) для выявления скрытых семантических структур в тексте. LSI помогает нам понять, какие слова часто встречаются вместе и формируют определенные концепции.

- LDA (Latent Dirichlet Allocation): Более современный и популярный метод, основанный на вероятностных моделях. LDA предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема, в свою очередь, является смесью слов. Мы использовали LDA для анализа больших объемов новостей, отзывов клиентов и научных статей, чтобы выявить основные обсуждаемые темы.

Сравнение моделей тематического моделирования (LDA vs NMF) также стало частью нашего опыта. Мы обнаружили, что NMF (Non-negative Matrix Factorization) иногда дает более интерпретируемые темы, особенно когда мы хотим, чтобы все веса были положительными. Выбор метода часто зависел от специфики данных и наших задач.

"Язык – это дорожная карта культуры. Он показывает, откуда пришли ее люди и куда они идут."

– Рита Мэй Браун

Практическое Применение NLP: От Анализа Тональности до Классификации

После освоения основ предобработки и векторизации текста, мы перешли к более практическим задачам, которые позволяют извлекать конкретную ценность из текстовых данных. Именно здесь NLP раскрывается во всей своей красе, помогая решать реальные бизнес-проблемы.

Распознавание Эмоций: Анализ тональности (Sentiment Analysis)

Одной из самых востребованных задач в NLP является анализ тональности, или сентимент-анализ. Он позволяет нам определить эмоциональную окраску текста, является ли он позитивным, негативным или нейтральным; Это бесценный инструмент для понимания общественного мнения, анализа отзывов клиентов и мониторинга социальных сетей.

Анализ тональности (Sentiment Analysis) с VADER

Для английского языка мы часто использовали VADER (Valence Aware Dictionary and sEntiment Reasoner) из библиотеки NLTK. VADER — это правило-основанный сентимент-анализатор, который отлично справляется с текстами из социальных медиа благодаря своему словарю, включающему сленг, эмодзи и акронимы. Мы оценили его скорость и способность учитывать интенсификаторы (например, "очень хорошо" против "хорошо") и отрицания.

Мы также разрабатывали собственные модели анализа тональности, применяя машинное обучение с Scikit-learn. Для этого мы:

- Собирали размеченные данные (тексты с метками "позитивный", "негативный", "нейтральный").

- Векторизовали текст с помощью TF-IDF.

- Обучали классификаторы, такие как SVM или Наивный Байес.

Такой подход позволял нам адаптироваться к специфике конкретных предметных областей, например, анализу тональности финансовых новостей или отзывов о продуктах по категориям. Мы даже сталкивались с проблемой анализа тональности сообщений в социальных сетях с учетом сарказма, что является одной из сложнейших задач в NLP.

Категоризация и Классификация Текстов

Классификация текста — это задача присвоения тексту одной или нескольких предопределенных категорий. Это фундаментальная задача NLP, имеющая множество применений, от спам-фильтров до автоматической категоризации статей.

Применение Scikit-learn для классификации текстов

Scikit-learn стал нашим основным инструментом для построения моделей классификации. После векторизации текста (чаще всего с TF-IDF или Word Embeddings), мы применяли различные алгоритмы машинного обучения:

- Наивный Байесовский классификатор: Отлично подходит для текстовых данных, прост в реализации и часто дает хорошие результаты.

- Методы опорных векторов (SVM): Мощный алгоритм, эффективный в пространствах высокой размерности, что характерно для текстовых данных. Мы часто использовали его для задач, где требовалась высокая точность.

- Логистическая регрессия: Еще один надежный алгоритм для бинарной и мультиклассовой классификации.

Мы использовали эти методы для автоматической категоризации новостей, определения авторства текста и даже для анализа стилистики текстов.

Извлечение Информации: Ключевые Фразы и Сущности

Помимо классификации, часто возникает необходимость извлекать конкретные фрагменты информации из текста.

Анализ текста для извлечения ключевых фраз и применение RAKE

Для извлечения ключевых фраз мы использовали как статистические методы, так и более продвинутые алгоритмы. RAKE (Rapid Automatic Keyword Extraction) — один из таких алгоритмов, который мы применяли для быстрого извлечения ключевых слов из неструктурированного текста. Он работает на основе частотности слов и их co-occurrence.

Мы также использовали библиотеку TextRank (аналог PageRank для текста), которая помогает не только извлекать ключевые слова, но и суммировать тексты, выбирая наиболее важные предложения.

Распознавание именованных сущностей (NER) с spaCy и Flair

Мы уже упоминали spaCy для NER, но для более продвинутых задач и языков с богатой морфологией мы также обращались к библиотеке Flair. Flair предлагает современные, мощные модели на основе нейронных сетей, которые показывают отличные результаты в NER, особенно для русского языка и других языков, где морфология играет большую роль. Разработка систем для автоматической разметки сущностей стала для нас отдельным проектом, где мы тонко настраивали эти модели под наши специфические задачи.

Погружение в Глубины: Нейронные Сети и Трансформеры в NLP

С приходом глубокого обучения и появлением архитектур-трансформеров, мир NLP пережил настоящую революцию. Мы, конечно же, не остались в стороне и активно исследовали эти передовые технологии, которые позволяют достигать беспрецедентной точности и гибкости в работе с языком.

Эра Нейронных Сетей: PyTorch/TensorFlow и LSTM

Прежде чем трансформеры заняли центральное место, рекуррентные нейронные сети (RNN) и их разновидности, такие как LSTM (Long Short-Term Memory), были краеугольным камнем глубокого обучения в NLP. Мы применяли PyTorch и TensorFlow для создания нейросетей NLP, используя эти архитектуры.

Применение PyTorch/TensorFlow для создания нейросетей NLP

Мы учились строить свои собственные архитектуры для:

- Классификации текста: Обучали LSTM-сети для определения тональности или категории документа.

- Генерации текста: Экспериментировали с простыми генеративными моделями, которые могли бы продолжать предложения.

- Распознавания именованных сущностей: Создавали Bi-LSTM-CRF модели, которые учитывают контекст в обе стороны и улучшают точность NER.

Этот этап был невероятно важен для понимания фундаментальных принципов глубокого обучения и того, как последовательные данные, такие как текст, обрабатываются нейронными сетями.

Революция Трансформеров: Hugging Face, BERT и GPT

Трансформеры кардинально изменили ландшафт NLP. Их способность обрабатывать контекст слова, учитывая все остальные слова в предложении одновременно, открыла двери для невероятных достижений. Библиотека Hugging Face Transformers стала нашим основным инструментом для работы с этими моделями.

Трансформеры (Hugging Face) для сложных задач NLP

Мы активно используем предобученные модели из Hugging Face для широкого круга задач:

- BERT (Bidirectional Encoder Representations from Transformers): Эта модель произвела фурор своей способностью понимать контекст слова, читая текст в обоих направлениях. Мы применяли BERT для задач классификации, NER, вопросно-ответных систем и извлечения информации. Тонкая настройка (Fine-tuning) предварительно обученных моделей BERT под наши специфические датасеты стала обычной практикой, позволяя достигать state-of-the-art результатов.

- GPT (Generative Pre-trained Transformer): Модели семейства GPT, такие как GPT-2 и GPT-3 (и их открытые аналоги), показали невероятные способности в генерации текста. Мы экспериментировали с использованием Transformer-моделей для генерации текста, диалогов и даже кода, удивляясь их креативности и связности.

- Sentence Transformers: Для векторизации предложений и документов мы активно используем Sentence Transformers, которые позволяют получать высококачественные эмбеддинги для сравнения сходства предложений или поиска релевантных документов.

Эти модели значительно сократили время разработки и повысили качество наших NLP-решений, позволяя нам сосредоточиться на более сложных аспектах задачи, а не на базовых представлениях текста.

Расширяя Горизонты: От Веб-Скрейпинга до Мультиязычности

Мир текста не ограничивается чистыми датасетами. Нам часто приходится работать с данными, разбросанными по интернету, или с текстами на разных языках. Мы освоили инструменты, которые помогают нам собирать, очищать и обрабатывать эти разнообразные источники.

Сбор и Очистка Текстовых Данных

Прежде чем приступать к анализу, текст нужно получить и подготовить; Это часто является самым трудоемким этапом.

Библиотека Beautiful Soup для веб-скрейпинга текста

Для получения текстовых данных из веб-страниц мы активно используем Beautiful Soup. Эта библиотека позволяет нам парсить HTML и XML документы, легко извлекая нужные нам фрагменты текста. Мы применяли ее для сбора новостных статей, отзывов с сайтов и даже для создания собственных корпусов данных.

Обработка неструктурированного текста: Очистка данных и регулярные выражения

Сырой текст, полученный из интернета или других источников, редко бывает идеально чистым. Он может содержать HTML-теги, специальные символы, лишние пробелы, пунктуацию и стоп-слова. Мы разработали целый арсенал инструментов для очистки текста:

- Регулярные выражения (re): Наш незаменимый инструмент для поиска и замены паттернов в тексте. Мы использовали их для удаления HTML-тегов, очистки текста от пунктуации, извлечения дат и чисел, а также для нормализации сленга и эмодзи.

- Удаление стоп-слов: Слова, такие как "и", "в", "на", "он", которые часто встречаются, но не несут существенного смыслового значения, обычно удаляются. Мы использовали списки стоп-слов из NLTK или создавали свои собственные.

- Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг играют важную роль. Мы разрабатывали инструменты для их нормализации или учета в анализе тональности.

Мультиязычный NLP

Мир не ограничивается одним языком, и наши NLP-системы должны это учитывать. Мы работали с многоязычными текстовыми корпусами, сталкиваясь с уникальными вызовами.

Обработка многоязычных текстовых корпусов и использование Polyglot, Stanza

Для работы с разными языками мы использовали специализированные библиотеки:

- Polyglot: Эта библиотека предоставляет широкий спектр функций для многоязычного NLP, включая распознавание языка, токенизацию, NER, анализ тональности и перевод. Мы применяли ее для анализа редких языков и обработки текстов, где требовалась мультиязычность.

- Stanza (от Stanford NLP Group): Для языков с богатой морфологией, таких как русский, Stanza оказалась очень мощным инструментом. Она предоставляет предобученные модели для токенизации, POS-теггинга, лемматизации и зависимостного парсинга, показывая высокую точность.

Разработка систем машинного перевода на Python, хотя и является сложной задачей, также входит в сферу наших интересов, и мы экспериментировали с Transformer-моделями для машинного перевода.

Специализированные Задачи и Продвинутые Применения

По мере углубления в NLP, мы начали решать более специфические и сложные задачи, которые требуют комбинации различных техник и инструментов;

Автоматизация и Интеллектуальные Системы

Мы стремимся к созданию систем, которые могут самостоятельно выполнять сложные лингвистические задачи.

Разработка систем вопросно-ответных систем (QA)

Создание QA-систем — это одна из самых захватывающих областей NLP. Мы работали над моделями, которые могут принимать вопрос на естественном языке и находить точный ответ в большом корпусе документов. Это включает в себя:

- Понимание вопроса (NER, синтаксический парсинг).

- Поиск релевантных документов (информационный поиск).

- Извлечение точного ответа из найденных документов (модели на основе трансформеров, таких как BERT).

Это требует глубокого понимания контекста и семантики, и мы видели, как Transformer-модели значительно улучшили качество таких систем.

Разработка чат-ботов на Python (Rasa framework)

Чат-боты стали повсеместными, и мы имели опыт их разработки. Мы использовали фреймворк Rasa, который предоставляет полный набор инструментов для создания диалоговых ИИ:

- Распознавание намерений пользователя.

- Извлечение сущностей из запросов.

- Управление диалогом.

Rasa позволяет нам создавать гибких и интеллектуальных чат-ботов, способных обрабатывать сложные сценарии и вести осмысленные беседы.

Разработка системы суммаризации текста (Abstractive vs Extractive)

Суммаризация текста — это процесс автоматического создания краткого изложения длинного документа. Мы исследовали два основных подхода:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их. Мы использовали TextRank для этого.

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают суть оригинального текста. Это гораздо более сложная задача, требующая генеративных моделей, таких как Transformer-модели для суммаризации (например, T5, BART).

Сравнение моделей суммирования: экстрактивная и абстрактная, показало нам, что абстрактивные модели предлагают более человечное и связное изложение, но требуют гораздо больше вычислительных ресурсов и сложнее в разработке.

Специфические Инструменты и Вызовы

В нашей работе мы сталкивались с разнообразными задачами, требующими специфических решений.

Анализ юридических документов, медицинских записей и финансовых отчетов

Работа с узкоспециализированными текстами, такими как юридические контракты, медицинские записи или финансовые отчеты, представляет собой особый вызов. Эти тексты часто содержат сложную терминологию, специфическую структуру и требуют высокой точности в извлечении информации. Мы использовали Python для анализа юридических документов, разрабатывали системы для извлечения дат и чисел, а также применяли BERT для задач NER в этих областях. Анализ тональности финансовых новостей также стал важной задачей, так как она напрямую влияет на экономические решения.

Разработка систем обнаружения плагиата и проверки фактов (Fact-Checking)

В эпоху информационного шума актуальность проверки подлинности информации растет. Мы исследовали методы для разработки систем обнаружения плагиата, используя алгоритмы сравнения строк (например, с библиотекой Jellyfish или Textdistance) и векторизацию документов. Разработка инструмента для проверки фактов (Fact-Checking) — это еще более сложная задача, требующая сопоставления утверждений из текста с базами знаний и надежными источниками, часто с использованием продвинутых методов NLP и поиска информации.

Экосистема Python для NLP: Обзор Библиотек и Инструментов

Наш путь в NLP был бы невозможен без богатой и постоянно развивающейся экосистемы Python. Мы использовали множество библиотек, каждая из которых вносила свой вклад в решение наших задач.

Основные Библиотеки, Которые Мы Использовали

Мы уже упоминали многие из них, но стоит еще раз подчеркнуть их роль:

- NLTK: Основа для изучения, предоставляющая множество алгоритмов для предобработки, POS-теггинга, морфологического анализа.

- spaCy: Высокопроизводительная библиотека для "промышленного" NLP, особенно сильна в NER, зависимостном парсинге и лемматизации.

- Gensim: Наш выбор для тематического моделирования (LDA, LSI) и работы с Word Embeddings (Word2Vec, Doc2Vec).

- Scikit-learn: Универсальный инструмент для машинного обучения, который мы использовали для классификации, кластеризации и создания векторизаторов текста (CountVectorizer, TfidfVectorizer).

- Hugging Face Transformers: Неоспоримый лидер в работе с современными трансформерными моделями (BERT, GPT, T5 и др.).

- PyTorch/TensorFlow: Фреймворки глубокого обучения для создания пользовательских нейросетевых архитектур.

Менее Известные, но Полезные Инструменты

Помимо гигантов, есть и другие библиотеки, которые мы находили весьма полезными:

- TextBlob: Простая в использовании библиотека для быстрого анализа текста, включая анализ тональности и POS-теггинг, особенно полезна для прототипирования. Мы также изучали ограничения TextBlob и альтернативы, когда требовалась большая точность.

- Textacy: Расширенная библиотека для NLP, построенная поверх spaCy, предоставляющая дополнительные функции для извлечения информации, нормализации текста и работы с зависимостями.

- Sweetviz: Хотя это не чисто NLP-библиотека, мы использовали ее для анализа текстовых данных, чтобы быстро получить обзор статистик и распределений.

- Jellyfish, Textdistance: Эти библиотеки незаменимы для измерения сходства строк, что критично при поиске дубликатов, обнаружении плагиата или работе с неполными и ошибочными данными.

- Pattern: Многофункциональная библиотека для веб-майнинга, NLP и машинного обучения, которая иногда использовалась нами для анализа социальных сетей и тональности.

- PyMuPDF: Для извлечения текста из PDF-документов, что является частой задачей при работе с неструктурированными данными.

- Gentle: Для распознавания речи (Speech-to-Text), когда нам требовалось преобразовать аудио в текст для дальнейшего анализа.

Наш путь в мире обработки естественного языка был полон открытий, вызовов и непрерывного обучения. От первых шагов с NLTK до освоения мощных трансформерных архитектур, мы видели, как NLP преобразилось из нишевой академической дисциплины в одну из самых динамичных и влиятельных областей искусственного интеллекта. Мы научились не только "чистить" и "считать" слова, но и заставлять машины понимать их смысл, извлекать ценную информацию, генерировать связный текст и даже вести диалог.

Мы продолжаем исследовать новые горизонты: от работы с нелатинскими алфавитами и анализа стилистики текста до обработки больших текстовых массивов (Big Data NLP) и создания инструментов для автоматической разметки данных. Проблемы обработки неполных и ошибочных данных, а также постоянная потребность в тонкой настройке моделей под специфические задачи, держат нас в тонусе и мотивируют к дальнейшим исследованиям.

Этот блог – это наш способ поделиться нашими знаниями и опытом. Мы надеемся, что наше путешествие вдохновит вас на собственные исследования и поможет вам в ваших проектах. Мир NLP огромен и постоянно меняется, но с правильными инструментами и подходом, мы можем продолжать разгадывать тайны человеческого языка, делая взаимодействие между человеком и машиной более интуитивным, эффективным и, что самое главное, осмысленным.

Подробнее

| Анализ тональности | Машинное обучение для NLP | Word Embeddings | Генерация текста GPT | Распознавание именованных сущностей |

| Тематическое моделирование LDA | Очистка текстовых данных | Разработка чат-ботов | Суммаризация текста | Мультиязычный NLP |