- Разгадывая Тайны Языка: Наш Путь в Мире NLP с Python

- Первые Шаги: Подготовка Текста к Анализу

- Основы NLTK: Токенизация и Стемминг

- Продвинутая Лемматизация и Стемминг: Шаг к Точности

- Регулярные Выражения (re) в Предобработке Текста

- Инструменты Мастера: Ключевые Библиотеки NLP

- Использование spaCy для Быстрого NER

- Библиотека Gensim для Тематического Моделирования (LDA, LSI)

- Применение Scikit-learn для Классификации Текстов

- Использование TextBlob для Простого NLP

- Как Машины "Слышат" Слова: Векторизация Текста

- Разработка Собственных Векторизаторов Текста (CountVectorizer, TfidfVectorizer)

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Векторизация Предложений и Документов (Doc2Vec, Sentence Transformers)

- Основные Задачи NLP: От Смысла к Действию

- Анализ Тональности (Sentiment Analysis) с VADER

- Извлечение Ключевых Фраз и Суммаризация Текста

- Разработка Систем Вопросно-Ответных Систем (QA)

- Эра Трансформеров: Глубокое Обучение в NLP

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Тонкая Настройка (Fine-tuning) Предварительно Обученных Моделей

- Специализированные Задачи и Продвинутые Применения

- Обработка Многоязычных Текстовых Корпусов и Машинный Перевод

- Разработка Чат-ботов на Python (Rasa Framework)

- Анализ Текста для Извлечения Ключевых Фактов и Сущностей

- Работа с Неполными и Ошибочными Данными: Очистка и Нормализация

- Визуализация и Оценка: Делаем NLP Понятным

- Инструменты для Визуализации Текстовых Данных (Word Clouds, Heatmaps)

- Оценка Качества Моделей (F1-score, Precision, Recall)

- Перспективы и Будущее NLP: Куда Мы Движемся

- Использование Transformer-моделей для Генерации Текста (GPT) и Кода

- Обработка Больших Текстовых Массивов (Big Data NLP)

- Разработка Систем Обнаружения Плагиата и Проверки Фактов

Разгадывая Тайны Языка: Наш Путь в Мире NLP с Python

Приветствуем вас, дорогие читатели, в нашем увлекательном путешествии по бескрайним просторам Обработки Естественного Языка (NLP) с использованием мощи Python! Мы, команда энтузиастов и практиков, накопили значительный опыт в этой захватывающей области и с радостью делимся им с вами. Нам посчастливилось быть свидетелями и активными участниками того, как машины учатся понимать, интерпретировать и даже генерировать человеческий язык, открывая перед нами совершенно новые горизонты. Сегодня мы хотим провести вас по основным вехам этого пути, от самых азов до передовых технологий, которые меняют мир.

В современном мире, где объемы текстовых данных растут экспоненциально каждую секунду, способность автоматизировать их анализ становится не просто удобством, а критически важной необходимостью. От отзывов клиентов и новостных лент до медицинских записей и юридических документов — везде скрыта информация, которую вручную обработать невозможно. Именно здесь на помощь приходит NLP, вооружая нас инструментами для извлечения смысла из хаоса слов. Мы убеждены, что каждый, кто работает с данными, должен хотя бы базово разбираться в этих методиках, ведь они открывают дверь к пониманию миллионов неструктурированных текстовых записей.

Первые Шаги: Подготовка Текста к Анализу

Прежде чем машина сможет "понять" текст, его необходимо подготовить. Это похоже на то, как мы сначала учимся читать по слогам, а уже потом постигаем глубокий смысл предложений. В NLP этот процесс называется предобработкой, и он является краеугольным камнем любой успешной задачи. Мы всегда начинаем именно с этого этапа, поскольку качество последующего анализа напрямую зависит от того, насколько хорошо мы "очистили" и "нормализовали" наши данные.

Основы NLTK: Токенизация и Стемминг

Наш путь в мир NLP часто начинается с NLTK (Natural Language Toolkit) — мощной и гибкой библиотеки, которая является своего рода "швейцарским ножом" для текстовой обработки. Мы обнаружили, что NLTK идеально подходит для изучения базовых концепций благодаря своей обширной документации и большому количеству встроенных модулей. Первые операции, которые мы осваиваем, это токенизация и стемминг.

Токенизация — это процесс разбиения текста на отдельные единицы, называемые токенами. Токенами могут быть слова, пунктуация или даже целые предложения. Мы часто сталкиваемся с необходимостью разделить текст на слова для дальнейшего анализа. Например, предложение "Машины учатся понимать язык." после токенизации может превратиться в список [‘Машины’, ‘учатся’, ‘понимать’, ‘язык’, ‘.’]. Это кажется простым, но выбор правильного токенизатора критически важен, особенно для языков со сложной морфологией.

Стемминг — это процесс уменьшения словоформ до их корневой основы (стеммы), даже если эта основа не является морфологически правильным словом. Цель стемминга — сгруппировать различные формы одного и того же слова, чтобы они обрабатывались как одна сущность. Например, слова "бегать", "бегает", "бежали" могут быть сведены к "бег". Мы используем стемминг, когда нужно быстро получить приблизительную форму слова, не заботясь о его грамматической корректности. Это бывает полезно в задачах информационного поиска или кластеризации, где скорость и агрегация важнее лингвистической точности.

Продвинутая Лемматизация и Стемминг: Шаг к Точности

Хотя стемминг полезен, он часто жертвует точностью ради простоты. Именно поэтому мы переходим к лемматизации, когда требуется более глубокое и лингвистически корректное преобразование. Лемматизация приводит слова к их словарной (канонической) форме, называемой леммой, учитывая морфологию и часть речи. Например, "бегать", "бегает", "бежали" будут сведены к "бегать". Это существенно улучшает качество анализа, поскольку мы работаем с реальными словами, а не с их усеченными версиями.

Мы часто сравниваем различные библиотеки для лемматизации и стемминга, чтобы выбрать наиболее подходящий инструмент для конкретной задачи. Вот краткая таблица, которая поможет вам понять их различия:

| Метод | Описание | Преимущества | Недостатки | Примеры библиотек/инструментов |

|---|---|---|---|---|

| Стемминг | Удаление суффиксов и префиксов для получения корневой формы, которая может не быть настоящим словом. | Быстрый, простой в реализации, подходит для задач с большим объемом данных, где важна скорость. | Может приводить к неграмматическим словам, теряется часть информации о морфологии. | NLTK (PorterStemmer, SnowballStemmer) |

| Лемматизация | Приведение слова к его словарной форме (лемме) с учетом части речи и контекста. | Лингвистически корректно, сохраняет смысл слова, улучшает качество семантического анализа. | Медленнее стемминга, требует словарей и морфологических правил, сложнее в реализации. | NLTK (WordNetLemmatizer), spaCy, Stanza, Mystem |

Мы видим, что выбор между стеммингом и лемматизацией зависит от конкретных требований проекта. Для быстрого прототипа или информационного поиска стемминг может быть достаточен, но для задач, где важна точность понимания смысла, лемматизация незаменима.

Регулярные Выражения (re) в Предобработке Текста

Наряду с токенизацией и лемматизацией, мы активно используем регулярные выражения (re) для тонкой настройки предобработки текста. Это мощный инструмент для поиска и манипулирования строками, который позволяет нам решать множество задач: от удаления HTML-тегов, чисел и пунктуации до извлечения специфических паттернов (например, email-адресов или телефонных номеров). Мы постоянно разрабатываем инструменты для очистки текста от HTML-тегов, нормализации пунктуации и даже удаления стоп-слов, используя re.

Например, чтобы удалить все HTML-теги из текста, мы можем использовать что-то вроде re.sub(r'<.*?>', '', text). Это позволяет нам быстро избавиться от "шума", который мешает анализу. Мы также применяем регулярные выражения для маркировки стоп-слов, если нам нужно создать собственный список, или для нормализации сленга и эмодзи, что особенно актуально при анализе текстов из социальных сетей.

Инструменты Мастера: Ключевые Библиотеки NLP

После того как мы освоили основы предобработки, пришло время познакомиться с основными библиотеками, которые станут нашими верными спутниками в мире NLP. Каждая из них имеет свои сильные стороны и предназначена для решения определенных типов задач. Мы не ограничиваемся одной, а стараемся комбинировать их возможности для достижения наилучших результатов.

Использование spaCy для Быстрого NER

spaCy, это высокопроизводительная библиотека для NLP на Python, которая особенно хороша для продакшн-систем. Она предоставляет предварительно обученные модели для различных языков, что значительно ускоряет разработку. Одной из ключевых возможностей spaCy, которую мы активно используем, является NER (Named Entity Recognition) — распознавание именованных сущностей. NER позволяет автоматически находить и классифицировать такие объекты, как имена людей, организации, географические названия, даты и т.д.

Мы часто применяем spaCy для анализа новостных статей, чтобы быстро извлечь ключевые фигуры и места событий, или для анализа юридических документов, чтобы идентифицировать стороны контракта и даты. Скорость и точность spaCy в задачах NER делают ее незаменимым инструментом в нашем арсенале. Мы также используем spaCy для реализации синтаксического парсинга, который помогает нам понять грамматическую структуру предложений и взаимосвязи между словами.

Библиотека Gensim для Тематического Моделирования (LDA, LSI)

Когда нам нужно разобраться в скрытых темах, присутствующих в больших коллекциях документов, мы обращаемся к Gensim. Эта библиотека специализируется на работе с большими текстовыми массивами и эффективной реализации алгоритмов тематического моделирования, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

Тематическое моделирование позволяет нам автоматически обнаруживать абстрактные "темы" в коллекции текстов. Например, если мы анализируем отзывы о продуктах, LDA может выявить темы, связанные с "качеством обслуживания", "ценой", "функциональностью" или "дизайном". Мы применяем это для анализа отзывов клиентов, постов на форумах, чтобы понять, какие аспекты продукта или услуги наиболее обсуждаемы, или для выявления скрытых тем в научных статьях; Gensim также является отличным инструментом для анализа частотности слов и N-грамм, что помогает нам выявлять наиболее релевантные термины в тексте.

Применение Scikit-learn для Классификации Текстов

Scikit-learn — это золотой стандарт для машинного обучения в Python, и, конечно же, он находит широкое применение в NLP. Мы используем Scikit-learn для решения задач классификации текстов, таких как определение спама, категоризация статей по темам, или анализ тональности. Комбинируя его с векторизаторами, такими как CountVectorizer и TfidfVectorizer, мы можем обучать мощные модели классификации.

Например, мы можем создать систему для автоматической категоризации новостей по рубрикам (спорт, политика, экономика) или для определения, является ли отзыв о продукте положительным, отрицательным или нейтральным. Простота использования и широкий выбор алгоритмов (SVM, наивный байесовский классификатор, логистическая регрессия) делают Scikit-learn незаменимым инструментом для любого проекта NLP, связанного с классификацией. Мы также применяем его для кластеризации текстов, когда нам нужно сгруппировать похожие документы без предварительной разметки.

Использование TextBlob для Простого NLP

Для быстрых прототипов или простых задач, где не требуется высокая производительность или глубокая кастомизация, мы часто обращаемся к TextBlob. Эта библиотека построена поверх NLTK и предоставляет удобный API для выполнения многих стандартных операций NLP, таких как токенизация, POS-теггинг (определение части речи), извлечение N-грамм и, что особенно важно, анализ тональности и определение языка.

Мы находим TextBlob очень полезным для быстрого определения настроения коротких текстов, например, комментариев в социальных сетях, или для проверки грамматики в небольших фрагментах. Однако важно помнить о ее ограничениях: для больших объемов данных или задач, требующих высокой точности, мы обычно переходим к более специализированным и производительным библиотекам. Тем не менее, для "быстрых и грязных" решений TextBlob, отличный выбор.

Как Машины "Слышат" Слова: Векторизация Текста

Компьютеры не понимают слова в том же смысле, что и люди. Для них текст — это просто последовательность символов. Чтобы машины могли работать с текстом, его необходимо преобразовать в числовой формат — векторы. Этот процесс называется векторизацией, и он является одним из фундаментальных шагов в любом проекте NLP. Мы постоянно экспериментируем с различными методами векторизации, чтобы найти тот, который лучше всего подходит для конкретной задачи.

Разработка Собственных Векторизаторов Текста (CountVectorizer, TfidfVectorizer)

Самые простые, но при этом очень эффективные методы векторизации, с которых мы начинаем, это CountVectorizer и TfidfVectorizer из Scikit-learn.

- CountVectorizer просто подсчитывает частоту каждого слова в документе. Он создает матрицу, где строки соответствуют документам, а столбцы — уникальным словам в корпусе, а значения — количеству вхождений слова в документ. Это отличный способ получить представление о том, какие слова чаще всего встречаются в каждом документе;

- TfidfVectorizer (Term Frequency-Inverse Document Frequency) идет дальше. Он не только учитывает частоту слова в документе (TF), но и придает больший вес словам, которые являются уникальными для данного документа и редко встречаются в других документах корпуса (IDF). Это помогает выделить ключевые слова, которые действительно характеризуют документ, а не просто являются частотными "шумовыми" словами, такими как "и", "в", "на". Мы всегда используем TF-IDF, когда нам нужно найти наиболее значимые слова в тексте.

Оба этих метода являются основой для многих задач классификации и кластеризации текстов, и мы часто сравниваем их эффективность в различных сценариях.

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

CountVectorizer и TfidfVectorizer хороши, но у них есть серьезный недостаток: они не учитывают семантические отношения между словами. Слова "король" и "царь" будут рассматриваться как совершенно разные, хотя они близки по смыслу. Здесь на сцену выходят Word Embeddings — векторные представления слов, которые захватывают их семантические и синтаксические свойства.

Мы активно используем такие модели, как Word2Vec и GloVe, часто реализуя их с помощью библиотеки Gensim. Эти модели обучаются на больших корпусах текстов и создают плотные векторы, где слова с похожим смыслом располагаются близко друг к другу в многомерном пространстве. Например, в Word2Vec мы можем обнаружить знаменитые аналогии, такие как "король ⎯ мужчина + женщина = королева". Это открывает совершенно новые возможности для понимания текста.

Применение Word Embeddings значительно улучшает качество таких задач, как извлечение ключевых фраз, анализ тональности и даже машинный перевод, поскольку модели теперь "понимают" контекст и смысл слов, а не просто их частоту.

Векторизация Предложений и Документов (Doc2Vec, Sentence Transformers)

Помимо векторизации отдельных слов, нам часто требуется получить векторное представление для целых предложений или даже документов. Для этого мы используем такие подходы, как Doc2Vec (расширение Word2Vec от Gensim) и современные Sentence Transformers.

- Doc2Vec позволяет нам создавать плотные векторы для документов любой длины, сохраняя при этом семантику. Это крайне полезно для поиска схожих документов, кластеризации или построения рекомендательных систем.

- Sentence Transformers — это более современный подход, основанный на архитектурах трансформеров, который создает высококачественные эмбеддинги для предложений и документов. Мы находим их невероятно эффективными для задач сравнения строк, поиска дубликатов, измерения сходства документов и даже для систем вопросно-ответных систем, где нужно найти наиболее релевантный ответ на вопрос.

Эти методы позволяют нам "сжать" сложный текстовый контент в компактные числовые представления, с которыми легко работать алгоритмам машинного обучения.

Основные Задачи NLP: От Смысла к Действию

После того как текст подготовлен и векторизован, мы можем приступать к решению более сложных задач, которые позволяют нам извлекать конкретные инсайты и автоматизировать процессы.

Анализ Тональности (Sentiment Analysis) с VADER

Понимание эмоциональной окраски текста — одна из самых востребованных задач NLP. Мы регулярно проводим анализ тональности (Sentiment Analysis), чтобы определить, является ли текст позитивным, негативным или нейтральным. Это критически важно для анализа отзывов клиентов о продуктах, сообщений в социальных сетях, финансовых новостей или даже политических постов.

Для англоязычных текстов мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), лексический и основанный на правилах анализатор тональности, который специально обучен для работы с текстами из социальных медиа. Он хорошо справляется с сарказмом и сленгом. Для русскоязычных текстов мы либо строим собственные модели на основе Scikit-learn, либо используем специализированные библиотеки, либо адаптируем трансформерные модели. Мы также разрабатываем системы для анализа тональности сообщений в социальных сетях с учетом сарказма, что является непростой, но очень интересной задачей.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Извлечение Ключевых Фраз и Суммаризация Текста

В огромном потоке информации нам часто нужно быстро получить самую суть документа. Для этого мы применяем методы извлечения ключевых фраз и суммаризации текста.

- Извлечение ключевых фраз: Мы используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) или TextRank, чтобы автоматически выделить наиболее важные слова и фразы, которые наилучшим образом описывают содержание документа. Это помогает нам быстро понять основную идею текста или создать теги для контента.

- Суммаризация текста: Это более сложная задача, которая может быть двух типов:

- Экстрактивная суммаризация: Мы извлекаем наиболее важные предложения из исходного текста и объединяем их в краткое резюме. Это похоже на выделение главных мыслей в тексте. Мы применяем TextRank для этой цели.

- Абстрактивная суммаризация: Здесь модель генерирует совершенно новые предложения, которые передают смысл исходного текста, но не обязательно являются его прямыми цитатами. Это гораздо сложнее и требует использования продвинутых нейросетевых моделей, таких как трансформеры. Мы активно работаем над разработкой систем суммаризации текста, сравнивая различные подходы.

Обе эти техники значительно экономят время, позволяя быстро ознакомиться с содержанием объемных документов.

Разработка Систем Вопросно-Ответных Систем (QA)

Возможность задать вопрос и получить точный ответ из большого корпуса документов — это мечта многих пользователей. Мы активно занимаемся разработкой систем вопросно-ответных систем (QA). Эти системы могут быть двух типов:

- Извлечение ответов: Система находит точный фрагмент текста в документе, который содержит ответ на вопрос.

- Генерация ответов: Система генерирует новый ответ на основе информации, полученной из документов.

Для создания QA систем мы используем комбинацию техник: от векторизации предложений для поиска релевантных фрагментов до сложных моделей трансформеров (например, из Hugging Face) для понимания вопроса и извлечения или генерации ответа. Это очень сложная, но невероятно полезная область, особенно в корпоративной среде для поиска информации в базах знаний или для автоматизации поддержки клиентов.

Эра Трансформеров: Глубокое Обучение в NLP

Последние несколько лет стали настоящей революцией в NLP благодаря появлению архитектуры Трансформеров; Эти модели, основанные на механизме внимания, кардинально изменили наш подход к обработке языка, позволив достичь беспрецедентной точности во многих задачах. Мы погрузились в эту область с головой и видим, как она меняет ландшафт NLP.

Трансформеры (Hugging Face) для Сложных Задач NLP

Библиотека Hugging Face Transformers стала де-факто стандартом для работы с моделями на основе трансформеров, такими как BERT, GPT, RoBERTa и многими другими. Она предоставляет простой и унифицированный интерфейс для сотен предварительно обученных моделей, позволяя нам решать широкий спектр задач: от классификации текста и распознавания именованных сущностей до машинного перевода и суммаризации.

Мы используем трансформеры для самых сложных задач NLP, где требуется глубокое понимание контекста и семантики. Например, для распознавания эмоций в тексте, для выявления связей между сущностями (например, кто работает в какой компании), или для анализа стилистики текстов, чтобы определить авторский почерк. Эти модели способны улавливать тончайшие нюансы языка, которые были недоступны для более ранних подходов.

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Хотя Hugging Face упрощает использование предварительно обученных трансформеров, иногда нам требуется полная гибкость для создания собственных нейросетевых архитектур или для тонкой настройки (fine-tuning) существующих моделей. В таких случаях мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow (или его высокоуровневому API Keras).

Мы применяем PyTorch/TensorFlow для создания LSTM-сетей, когда важна последовательность слов, или для разработки моделей для генерации диалогов в чат-ботах. Эти фреймворки дают нам полный контроль над архитектурой модели, процессом обучения и оптимизацией, что критически важно для исследовательских проектов или когда стандартные решения не обеспечивают нужного качества. Мы также используем их для обработки текста с использованием GPU-ускорения, что позволяет значительно сократить время обучения больших моделей.

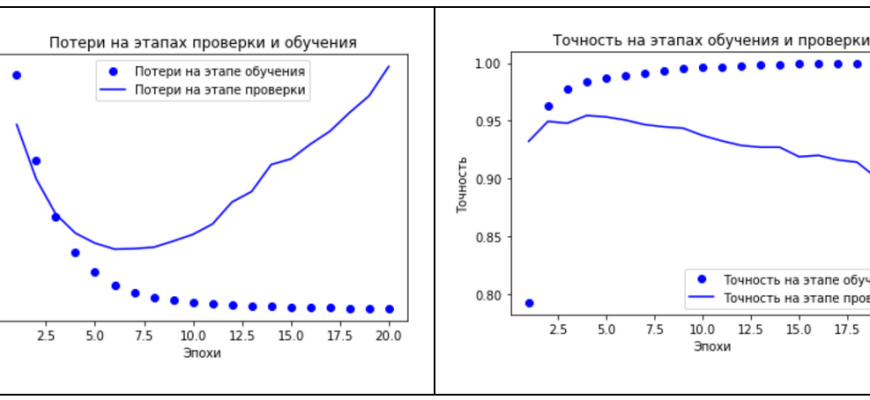

Тонкая Настройка (Fine-tuning) Предварительно Обученных Моделей

Одно из величайших преимуществ трансформеров заключается в возможности их тонкой настройки (fine-tuning). Это означает, что мы можем взять предварительно обученную на огромном корпусе текста модель (например, BERT) и дообучить ее на небольшом специализированном наборе данных для конкретной задачи. Например, модель, обученная на общих текстах, может быть дообучена для анализа тональности финансовых новостей, что значительно повысит ее точность в этой узкой области.

Мы постоянно используем fine-tuning для адаптации моделей под наши специфические нужды. Это позволяет нам добиваться результатов, которые были бы недостижимы при обучении модели с нуля на ограниченном объеме данных. Fine-tuning значительно сокращает время и ресурсы, необходимые для разработки высокопроизводительных NLP-решений.

Специализированные Задачи и Продвинутые Применения

Мир NLP огромен, и помимо основных задач, существует множество специализированных применений, которые решают конкретные проблемы в различных областях. Мы постоянно расширяем наш инструментарий и опыт, осваивая новые горизонты.

Обработка Многоязычных Текстовых Корпусов и Машинный Перевод

Глобализация требует от нас умения работать с текстами на разных языках. Мы активно занимаемся обработкой многоязычных текстовых корпусов. Для этого мы используем такие библиотеки, как TextBlob для определения языка, или более мощные инструменты, такие как Polyglot и Stanza, которые поддерживают языки с богатой морфологией, такие как русский.

Разработка систем машинного перевода на Python — это одна из самых сложных и интересных задач. Мы используем трансформерные модели для машинного перевода, которые демонстрируют впечатляющие результаты. Мы также работаем над разработкой систем для автоматического перевода узкоспециализированных текстов, что требует особого внимания к терминологии и контексту.

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты стали неотъемлемой частью современного онлайн-взаимодействия. Мы имеем опыт в разработке чат-ботов на Python, часто используя для этого фреймворк Rasa. Rasa предоставляет полный стек для создания контекстных ассистентов, включая понимание естественного языка (NLU) и управление диалогами.

Мы разрабатываем чат-боты для различных целей: от автоматизации поддержки клиентов и ответов на часто задаваемые вопросы до создания интерактивных помощников. Это включает в себя не только обработку пользовательских запросов, но и разработку инструментов для нормализации сленга и работы с эмодзи, чтобы бот мог адекватно реагировать на современный язык общения.

Анализ Текста для Извлечения Ключевых Фактов и Сущностей

Извлечение конкретных фактов и сущностей из неструктурированного текста — это мощный инструмент для автоматизации сбора информации. Мы работаем над разработкой систем для извлечения дат и чисел из текста, а также для автоматической разметки сущностей, что является основой для построения баз знаний.

Например, мы можем извлекать имена сторон, суммы и даты из юридических документов, или ключевые события и даты из новостных лент. Для этого мы используем комбинацию регулярных выражений, правил на основе шаблонов и, конечно же, продвинутые модели NER, такие как те, что предоставляются spaCy или Flair. Мы также разрабатываем системы для извлечения фактов из новостей, что позволяет нам автоматизировать процесс мониторинга информации.

Работа с Неполными и Ошибочными Данными: Очистка и Нормализация

Реальные данные редко бывают идеальными. Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных. От опечаток и грамматических ошибок до отсутствующих значений и неконсистентного форматирования — все это требует тщательной предобработки.

Мы разрабатываем инструменты для проверки грамматики и исправления орфографии, используем библиотеки, такие как Jellyfish для сравнения строк и поиска дубликатов, а также создаем словари и тезаурусы для нормализации терминологии. Очистка данных — это не просто технический этап, это искусство, которое требует внимания к деталям и глубокого понимания предметной области. Без качественной очистки даже самые продвинутые модели не смогут дать адекватных результатов.

Визуализация и Оценка: Делаем NLP Понятным

Создание моделей NLP — это только половина дела. Важно уметь интерпретировать их результаты, визуализировать данные и, конечно же, объективно оценивать качество нашей работы. Мы всегда уделяем этому этапу должное внимание.

Инструменты для Визуализации Текстовых Данных (Word Clouds, Heatmaps)

Для быстрого понимания основных тем и частотности слов мы используем различные инструменты визуализации текстовых данных.

- Облака слов (Word Clouds): Это отличный способ наглядно показать наиболее часто встречающиеся слова в корпусе текста. Чем больше слово, тем чаще оно встречается. Мы часто используем их для презентаций или для первого знакомства с новыми данными.

- Тепловые карты (Heatmaps): Полезны для визуализации матриц сходства, например, между документами или темами. Они помогают нам увидеть кластеры похожих текстов или взаимосвязи между различными сущностями.

Мы также можем использовать специализированные библиотеки, такие как Sweetviz для более глубокого анализа текстовых данных и выявления паттернов. Визуализация делает сложные результаты NLP доступными и понятными для неспециалистов.

Оценка Качества Моделей (F1-score, Precision, Recall)

В NLP, как и в любом машинном обучении, оценка качества моделей является критически важным шагом. Мы не можем просто сказать, что модель "работает хорошо" — нам нужны объективные метрики. Для оценки классификационных моделей (например, для NER или классификации тональности) мы используем такие метрики, как:

- Точность (Precision): Доля правильно предсказанных положительных случаев из всех предсказанных положительных.

- Полнота (Recall): Доля правильно предсказанных положительных случаев из всех фактически положительных.

- F1-мера (F1-score): Гармоническое среднее точности и полноты, которое дает сбалансированную оценку, особенно когда классы несбалансированы.

Мы всегда сравниваем различные методы машинного обучения для NLP, такие как SVM, наивный байесовский классификатор, и трансформерные модели, используя эти метрики, чтобы выбрать наиболее эффективное решение для конкретной задачи. Без строгой оценки невозможно понять, насколько наша модель действительно полезна.

Перспективы и Будущее NLP: Куда Мы Движемся

Мир NLP развивается с невероятной скоростью. То, что еще вчера казалось фантастикой, сегодня становится реальностью. Мы с нетерпением следим за новыми достижениями и активно внедряем их в нашу практику.

Использование Transformer-моделей для Генерации Текста (GPT) и Кода

Одним из самых захватывающих направлений является генерация текста с использованием трансформерных моделей, таких как GPT (Generative Pre-trained Transformer). Эти модели способны генерировать связный, грамматически правильный и даже творческий текст на основе заданного начального фрагмента. Мы экспериментируем с их использованием для создания контента, генерации диалогов для чат-ботов и даже для автоматического перефразирования текстов.

Более того, трансформеры находят применение даже в генерации кода, что открывает новые возможности для автоматизации разработки программного обеспечения. Мы видим огромный потенциал в этих технологиях для создания более умных и автономных систем.

Обработка Больших Текстовых Массивов (Big Data NLP)

По мере роста объемов данных, мы сталкиваемся с необходимостью обработки больших текстовых массивов (Big Data NLP). Это требует не только эффективных алгоритмов, но и масштабируемых архитектур. Мы используем библиотеки, такие как Gensim, который хорошо оптимизирован для работы с большими корпусами, и применяем распределенные вычисления для ускорения процессов. Анализ лог-файлов, анализ текстов в финансовых отчетах или в медицинских записях — все это задачи, где Big Data NLP играет ключевую роль.

Разработка Систем Обнаружения Плагиата и Проверки Фактов

В эпоху информации, где контент создается и распространяется со скоростью света, разработка систем обнаружения плагиата и проверки фактов (Fact-Checking) становится все более актуальной. Мы используем методы сравнения строк, анализа сходства документов (например, с помощью TextDistance или Doc2Vec) и выявления аномалий для обнаружения заимствований и недостоверной информации. Это критически важно для поддержания целостности контента и борьбы с дезинформацией.

Наш путь в мире NLP — это непрерывное обучение и исследование. Мы постоянно осваиваем новые инструменты, тестируем новые гипотезы и делимся своими открытиями. Мы верим, что возможности NLP только начинают раскрываться, и впереди нас ждут еще более удивительные открытия и применения.

Мы надеемся, что это погружение в мир NLP с Python оказалось для вас таким же увлекательным, как и для нас; Это поле, где логика программирования встречается с тонкостями человеческого языка, и каждый день приносит что-то новое и интересное. Если у вас есть вопросы или вы хотите поделиться своим опытом, мы всегда рады общению.

Подробнее

| Основы токенизации NLTK | NER с spaCy | Тематическое моделирование LDA | Классификация текста Scikit-learn | Векторизация Word2Vec |

| Анализ тональности VADER | Трансформеры Hugging Face | Разработка чат-ботов Rasa | Суммаризация текста TextRank | Python для NLP |