- Разгадывая Тайны Языка: Наш Путеводитель по Миру NLP с Python

- Начало Пути: Как Компьютер "Видит" Слова

- Очистка Данных: Делаем Текст Пригодным для Анализа

- Превращаем Слова в Числа: Векторизация и Встраивания

- Классические Методы Векторизации

- Революция Встраиваний Слов (Word Embeddings)

- Контекстуальные Встраивания и Векторизация Предложений

- Основные Задачи NLP: От Распознавания до Классификации

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Глубокое Погружение: Нейросети и Трансформеры

- Эра Трансформеров (Hugging Face)

- Продвинутые Приложения и Специализированные Инструменты

- Работа с Многоязычными Корпусами

- Извлечение Информации и Знаний

- Анализ Стилистики и Авторства

- Инструменты для Визуализации и Автоматизации

- Работа с Неструктурированным Текстом из Различных Источников

- Вызовы и Перспективы: Будущее NLP

Разгадывая Тайны Языка: Наш Путеводитель по Миру NLP с Python

Привет, друзья-энтузиасты и просто любознательные умы! Сегодня мы отправляемся в увлекательное путешествие по одной из самых динамично развивающихся областей искусственного интеллекта – обработке естественного языка, или NLP (Natural Language Processing). Мы, как опытные исследователи и страстные блогеры, уже не первый год погружены в этот мир, где слова и смыслы превращаются в данные, а данные – в интеллект. И, поверьте, это путешествие полно удивительных открытий и невероятных возможностей.

В этой статье мы не просто расскажем о теории. Мы поделимся нашим практическим опытом, покажем, как с помощью Python и его мощнейших библиотек можно заглянуть "под капот" человеческого языка, понять его структуру, извлечь ценные инсайты и даже научить машины общаться с нами. Мы пройдем путь от самых азов — вроде того, как компьютер вообще начинает "понимать" текст, — до вершин современных нейросетевых моделей, способных творить чудеса. Приготовьтесь, будет интересно и, главное, очень познавательно!

Начало Пути: Как Компьютер "Видит" Слова

Прежде чем мы научим машину анализировать эмоции в твитах или переводить сложные тексты, ей нужно сначала "прочитать" и "понять" отдельные части нашего языка. Для нас, людей, это происходит интуитивно, но для компьютера каждый текст — это просто последовательность символов. Наша задача – разбить эту последовательность на осмысленные единицы и привести их к стандартному виду. Это фундамент всего NLP.

Мы начинаем с самого базового, но критически важного этапа – токенизации. Представьте, что у нас есть предложение. Как разделить его на слова? Или на предложения? Это и есть токенизация. Мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает множество токенизаторов для разных языков и задач. Например, для русского языка NLTK отлично справляется с разбиением на слова и предложения, учитывая особенности пунктуации.

После того как мы получили токены, возникает новая проблема: одно и то же слово может иметь разные формы (бежать, бежит, бежал). Для многих задач NLP нам нужно привести эти формы к одной основе. Здесь на помощь приходят стемминг и лемматизация. Стемминг – это более простой и быстрый процесс "отрезания" окончаний, чтобы получить корень слова (например, "бежал" → "бежа"). Лемматизация же более умна: она приводит слово к его начальной словарной форме, учитывая морфологию (например, "бежал" → "бежать"). Мы предпочитаем лемматизацию с использованием spaCy или продвинутых методов NLTK, так как она дает более точные и осмысленные результаты, особенно для языков с богатой морфологией, таких как русский.

Очистка Данных: Делаем Текст Пригодным для Анализа

Сырые текстовые данные редко бывают идеальными. Они полны шума: HTML-теги из веб-страниц, пунктуация, стоп-слова (вроде "и", "в", "на"), эмодзи, сленг, опечатки, а иногда и вовсе нелатинские символы, которые могут быть не нужны для конкретной задачи. Мы разработали целый набор инструментов для очистки текста, которые обязательно включаем в каждый проект.

Например, регулярные выражения (библиотека re в Python) – наши незаменимые помощники для удаления HTML-тегов, ссылок, специальных символов или приведения текста к нижнему регистру. Для удаления стоп-слов мы обычно используем готовые списки из NLTK или SpaCy, но часто дополняем их собственными, специфичными для домена стоп-словами. Когда дело доходит до работы с эмодзи и сленгом, особенно в анализе социальных сетей (Twitter, Reddit), мы применяем специальные словари и методы нормализации, чтобы сохранить или преобразовать их смысл.

Построение качественных словарей и тезаурусов также играет ключевую роль в предобработке. Мы создаем собственные словари терминов для узкоспециализированных областей, что позволяет нам более точно обрабатывать юридические документы, финансовую отчетность или медицинские записи. А для сравнения строк и поиска опечаток мы активно используем библиотеку Jellyfish, которая предлагает различные метрики сходства.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

Превращаем Слова в Числа: Векторизация и Встраивания

Компьютеры отлично работают с числами, но не с текстом напрямую. Поэтому следующим критическим шагом в NLP является преобразование текстовых данных в числовые векторы. Этот процесс называется векторизацией или встраиванием (embeddings).

Классические Методы Векторизации

Мы начинали с классических методов, которые до сих пор остаются актуальными для многих задач. CountVectorizer из Scikit-learn просто подсчитывает частоту каждого слова в документе. Он создает матрицу, где строки – это документы, а столбцы – слова, и каждая ячейка содержит количество вхождений слова в документ. Это просто, но не учитывает важность слова. TfidfVectorizer (Term Frequency-Inverse Document Frequency) решает эту проблему, присваивая словам веса, которые отражают их важность как в конкретном документе, так и во всем корпусе текстов. Слова, которые часто встречаются во многих документах (например, "и", "в"), получают меньший вес, а уникальные и информативные слова – больший. Сравнение этих методов часто является первым шагом в нашем анализе.

| Метод | Описание | Преимущества | Недостатки |

|---|---|---|---|

| CountVectorizer | Считает количество вхождений каждого слова. | Прост в использовании, быстр. | Не учитывает важность слов, не справляется с синонимами. |

| TfidfVectorizer | Присваивает вес слову на основе его частотности в документе и редкости во всем корпусе. | Учитывает важность слов, лучше для классификации. | Все еще не понимает семантику, размерность вектора может быть большой. |

Революция Встраиваний Слов (Word Embeddings)

Настоящий прорыв произошел с появлением Word Embeddings. Эти методы, такие как Word2Vec и GloVe (часто используем их с библиотекой Gensim), учатся представлять слова в виде плотных векторов, где слова с похожим значением расположены близко друг к другу в многомерном пространстве. Это позволяет моделям улавливать семантические связи между словами. Мы видели, как это кардинально улучшило качество многих задач, от классификации до тематического моделирования. Gensim также предлагает Doc2Vec, который позволяет создавать векторы для целых документов, что невероятно полезно для поиска похожих статей или анализа больших текстовых массивов.

Мы также активно используем FastText, особенно когда работаем с редкими словами или языками с богатой морфологией. FastText способен создавать векторы не только для слов, но и для их подсловных единиц (n-грамм символов), что позволяет ему генерировать адекватные встраивания даже для слов, которые он никогда не видел в процессе обучения. Это значительно повышает устойчивость моделей.

Контекстуальные Встраивания и Векторизация Предложений

Современные методы пошли еще дальше, предложив контекстуальные встраивания. Вместо одного вектора для каждого слова, эти модели генерируют вектор слова в зависимости от его контекста в предложении. Это позволяет различать значения омонимов (например, "коса" как инструмент и "коса" как прическа). Здесь на сцену выходят Sentence Transformers и, конечно же, архитектуры на основе Transformer-моделей. Мы используем их для векторизации целых предложений и документов, что дает поразительные результаты в задачах сравнения документов, поиска дубликатов или анализа сходства. Это позволяет нам улавливать тонкие нюансы смысла, которые были недоступны более ранним подходам.

Основные Задачи NLP: От Распознавания до Классификации

Вооружившись методами предобработки и векторизации, мы можем приступать к решению более сложных и прикладных задач NLP. Здесь мы рассмотрим наиболее распространенные из них, которые мы регулярно решаем в наших проектах.

Распознавание Именованных Сущностей (NER)

NER – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, организации, местоположения, даты и т.д. Это крайне полезно для извлечения структурированной информации из неструктурированного текста. Мы часто используем spaCy для быстрого NER, так как он предлагает высокопроизводительные предобученные модели для многих языков, включая русский. Для более специфичных или сложных задач, где требуется очень высокая точность, мы обращаемся к библиотеке Flair, которая славится своими state-of-the-art моделями, или даже к более классическим методам, таким как CRF (Conditional Random Fields), когда данных для обучения глубоких моделей недостаточно. Оценка качества NER-моделей (F1-score, Precision, Recall) всегда является обязательным этапом в нашей работе.

Анализ Тональности (Sentiment Analysis)

Понимание эмоций и мнений, выраженных в тексте, – одна из самых востребованных задач. Мы используем анализ тональности для обработки отзывов клиентов, сообщений в социальных сетях (Twitter, Reddit), анализа финансовых новостей и даже для выявления скрытых тем в больших массивах текста. VADER (Valence Aware Dictionary and sEntiment Reasoner) – отличный инструмент для быстрого и эффективного анализа тональности, особенно для англоязычных текстов, так как он разработан с учетом эмотиконов, акронимов и сленга. Для более глубокого анализа и работы с русским языком мы часто строим собственные модели на базе Scikit-learn или Transformer-архитектур, учитывая при этом особенности сарказма и иронии, что является одной из самых сложных задач в sentiment analysis.

Тематическое Моделирование (Topic Modeling)

Когда у нас есть большой корпус текстов, и мы хотим понять, о чем они, тематическое моделирование приходит на помощь. Оно позволяет автоматически выявлять скрытые темы в коллекциях документов. Мы активно используем библиотеку Gensim для тематического моделирования, в частности, алгоритмы LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Они невероятно эффективны для анализа отзывов, новостных статей или блогов, помогая нам понять основные направления дискуссий или интересов аудитории. Мы также сравниваем LDA с NMF (Non-negative Matrix Factorization), чтобы выбрать наиболее подходящую модель для конкретной задачи, иногда даже применяя методы машинного обучения без учителя, такие как кластеризация, для выявления тем.

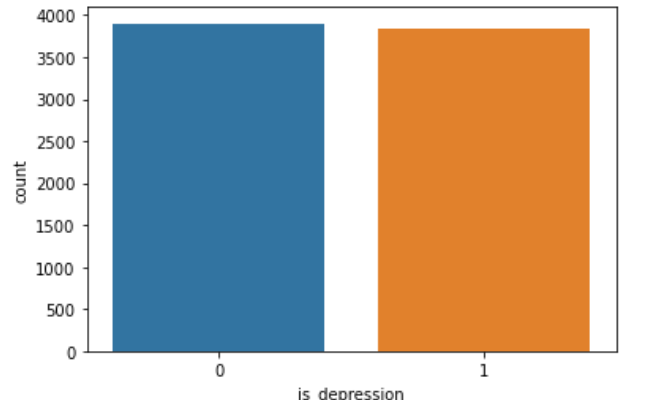

Классификация Текстов

Задача классификации текстов – это присвоение текстам одной или нескольких категорий. Это может быть категоризация новостей, спам-фильтрация, определение жанра, или анализ отзывов о продуктах по категориям. Мы часто используем Scikit-learn для классификации текстов, экспериментируя с различными алгоритмами: от наивного байесовского классификатора и SVM (Support Vector Machines) до более сложных моделей. Для получения наилучших результатов мы всегда сравниваем множество методов машинного обучения, а в последнее время все чаще обращаемся к глубокому обучению, используя PyTorch или TensorFlow для создания LSTM-сетей или применению BERT для задач классификации. Это позволяет нам достигать впечатляющей точности, особенно на больших и разнообразных наборах данных.

Глубокое Погружение: Нейросети и Трансформеры

Последние годы ознаменовались революцией в NLP благодаря глубокому обучению. Нейронные сети и, в особенности, архитектуры-трансформеры, кардинально изменили подходы к обработке языка, позволив создавать модели, способные понимать контекст и генерировать человекоподобный текст с беспрецедентной точностью.

Мы начинали с классических рекуррентных нейронных сетей (RNN), таких как LSTM, которые хорошо справляются с последовательными данными, такими как текст. Применение PyTorch или TensorFlow для создания этих нейросетей для NLP стало для нас следующим этапом после традиционных ML-моделей. Мы учились работать с эмбеддингами слов как входными данными и строить архитектуры для различных задач, от классификации до генерации простых последовательностей.

Эра Трансформеров (Hugging Face)

Но настоящий прорыв произошел с появлением архитектуры Transformer. Благодаря библиотеке Hugging Face Transformers, мы получили доступ к огромному количеству предварительно обученных моделей, таких как BERT, GPT, RoBERTa и многие другие. Эти модели способны улавливать сложнейшие зависимости в тексте на больших расстояниях. Мы используем их для самых разнообразных задач:

- Тонкая настройка (Fine-tuning) предварительно обученных моделей для специфических задач классификации, NER или анализа тональности, что дает значительно лучшие результаты, чем обучение с нуля.

- Применение BERT для задачи NER и классификации, достигая SOTA-результатов.

- Использование Transformer-моделей для генерации текста (GPT), что позволяет нам создавать инструменты для автоматического перефразирования, генерации диалогов для чат-ботов, и даже (с осторожностью) генерации кода.

- Разработка систем вопросно-ответных систем (QA), где трансформеры могут находить точные ответы на вопросы в больших текстовых корпусах.

- Суммаризация текста: как экстрактивная (извлечение ключевых предложений), так и абстрактная (генерация нового текста, передающего суть). Transformer-модели здесь показывают себя очень эффективно.

Работа с Transformer-моделями для анализа кода (например, для сжатия кода или его понимания) также открывает новые перспективы, демонстрируя универсальность этих архитектур.

Продвинутые Приложения и Специализированные Инструменты

Мир NLP не ограничивается базовыми задачами. Существует множество специализированных библиотек и прикладных задач, которые мы активно исследуем и внедряем в наших проектах.

Работа с Многоязычными Корпусами

Мы часто сталкиваемся с необходимостью обработки текстов на разных языках. Библиотека Polyglot является отличным инструментом для мультиязычности, предлагая широкий спектр функций для анализа редких языков. Stanza, разработанная Стэнфордским университетом, особенно полезна для языков с богатой морфологией, таких как русский, предоставляя продвинутую лемматизацию, POS-теггинг и синтаксический парсинг. Мы также разрабатываем системы машинного перевода на Python, используя трансформерные модели для автоматического перевода узкоспециализированных текстов.

Извлечение Информации и Знаний

Помимо NER, существует множество других методов для извлечения ценной информации:

- Анализ текста для извлечения ключевых фраз: Мы используем RAKE (Rapid Automatic Keyword Extraction) для быстрого извлечения ключевых слов и TextRank для извлечения ключевых предложений и выявления тем.

- Синтаксический парсинг: С помощью spaCy мы можем строить деревья зависимостей, что помогает нам понять грамматическую структуру предложений и выявлять связи между сущностями.

- Извлечение дат и чисел: Мы разрабатываем специализированные инструменты для автоматического извлечения этих сущностей из текста, что особенно важно для анализа юридических и финансовых документов.

- Создание FAQ и чат-ботов: На основе извлеченных фактов и связей мы строим системы для автоматического создания FAQ и разрабатываем чат-ботов на Python, часто используя фреймворк Rasa для более сложных диалоговых систем.

Анализ Стилистики и Авторства

Иногда нам нужно понять не только что сказано, но и как; Анализ стилистики текстов (авторский почерк) позволяет нам определить автора, выявить плагиат или оценить читабельность текста. Мы разрабатываем системы для определения авторства текста, используя метрики лексического богатства, частотности n-грамм и специфические паттерны. Для обнаружения плагиата мы применяем различные алгоритмы сравнения строк и документов, включая библиотеку Textdistance, которая предлагает множество метрик сходства.

Инструменты для Визуализации и Автоматизации

Визуализация текстовых данных помогает нам лучше понять результаты анализа. Мы используем Word Clouds для отображения частотности слов, Heatmaps для визуализации матриц сходства или корреляций. Библиотека Sweetviz также может быть полезна для быстрого анализа текстовых данных.

Для автоматизации рутинных задач мы разрабатываем инструменты для проверки грамматики и орфографии, нормализации сленга и пунктуации, а также для автоматической разметки данных и создания тезаурусов. TextBlob, хоть и прост, позволяет выполнять быстрые операции вроде определения языка или POS-теггинга для прототипирования.

Работа с Неструктурированным Текстом из Различных Источников

Мир полон неструктурированных данных, и мы научились извлекать текст из самых разных источников:

- Beautiful Soup для веб-скрейпинга текста: наш незаменимый инструмент для извлечения контента с веб-страниц.

- PyMuPDF для извлечения текста из PDF: позволяет нам работать с юридическими документами, отчетами и другими PDF-файлами.

- Анализ лог-файлов: мы применяем NLP для извлечения значимой информации из логов, выявления аномалий и паттернов.

Вызовы и Перспективы: Будущее NLP

Несмотря на все достижения, в мире NLP остаются серьезные вызовы. Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных, необходимостью тонкой настройки моделей для специфических доменов, а также с потребностью в GPU-ускорении для обработки больших текстовых массивов (Big Data NLP) и работы в режиме реального времени (Streaming NLP).

Мы видим будущее NLP в еще более умных и адаптивных моделях, способных к обучению с меньшим количеством размеченных данных, лучшему пониманию здравого смысла и еще более естественному взаимодействию с человеком. Разработка инструментов для автоматической разметки данных, дальнейшее развитие трансформерных архитектур для генерации диалогов и кода, а также глубокий анализ временных рядов в текстовых данных – все это направления, в которых мы активно работаем и которые обещают принести еще больше удивительных результатов.

Наш опыт показывает, что ключ к успеху в NLP лежит в постоянном обучении, экспериментировании и глубоком понимании как лингвистических принципов, так и технических возможностей Python. Мы надеемся, что этот обзор вдохновит вас на собственные исследования и поможет вам ориентироваться в этом захватывающем мире.

Подробнее

| Основы NLTK | NER с spaCy | Word2Vec Gensim | Анализ тональности VADER | Трансформеры Hugging Face |

| Классификация текста Scikit-learn | Лемматизация и стемминг | Векторизация Doc2Vec | Тематическое моделирование LDA | Разработка чат-ботов Rasa |