- Разгадывая Тайны Слов: Наш Путь в Мир Обработки Естественного Языка с Python

- Наши Первые Шаги: Строим Фундамент NLP

- Токенизация и Стемминг: Разбираем Текст на Части

- Лемматизация: К Корню с Умом

- Регулярные Выражения (re): Наш Щвейцарский Нож для Текста

- NLTK, spaCy и TextBlob: Наши Основные Инструменты

- Превращаем Слова в Числа: Векторизация Текста

- Классические Методы: CountVectorizer и TF-IDF

- Векторные Представления Слов (Word Embeddings): Word2Vec и GloVe

- От Слов к Документам: Doc2Vec и Sentence Transformers

- Основные Задачи NLP: От Распознавания до Анализа Тональности

- Распознавание Именованных Сущностей (NER) с spaCy и Flair

- Тематическое Моделирование (LDA, LSI) с Gensim

- Анализ Тональности (Sentiment Analysis)

- Классификация Текстов со Scikit-learn

- Глубокое Погружение: Нейросети и Трансформеры

- Трансформеры (Hugging Face): Мощность в Ваших Руках

- PyTorch/TensorFlow: Создаем Свои Нейросети для NLP

- Практические Применения и Нишевые Задачи

- Веб-Скрейпинг и Очистка Данных: Подготовка Почвы

- Работа с Многоязычными Текстовыми Корпусами

- Чат-боты и Вопросно-ответные Системы

- Анализ Стилистики и Обнаружение Плагиата

- Обработка Неструктурированного Текста и Больших Данных

- Визуализация Текстовых Данных

Разгадывая Тайны Слов: Наш Путь в Мир Обработки Естественного Языка с Python

Привет, друзья и коллеги-энтузиасты технологий! Сегодня мы хотим погрузиться в одну из самых увлекательных и быстро развивающихся областей современного программирования – Обработку Естественного Языка, или NLP (Natural Language Processing). Мы, как команда блогеров, всегда ищем новые горизонты и делимся своим личным опытом, и наш путь в NLP с использованием Python оказался невероятно познавательным и полным открытий. Мы увидели, как машины начинают "понимать" человеческий язык, и хотим поделиться с вами этим захватывающим приключением, раскрывая его основы и самые продвинутые концепции.

Представьте себе мир, где компьютеры не просто обрабатывают информацию, а действительно взаимодействуют с нами, понимая нюансы наших слов, интонации, даже юмора. Это уже не фантастика, а реальность, которую мы строим каждый день с помощью NLP. От банального автозаполнения текста до сложных систем машинного перевода и чат-ботов, способных поддерживать осмысленный диалог – все это стало возможным благодаря прорывам в обработке естественного языка. Мы уверены, что каждый, кто работает с данными или стремится создавать интеллектуальные системы, должен хотя бы поверхностно ознакомиться с этой сферой.

Наши Первые Шаги: Строим Фундамент NLP

Любое большое путешествие начинается с первого шага, и в NLP этим шагом является предобработка текста. Это критически важный этап, который готовит сырой текстовый материал к дальнейшему анализу. Без тщательной предобработки, наши модели будут работать с "шумом", что значительно снизит их эффективность и точность. Мы всегда уделяем этому этапу особое внимание, ведь именно здесь закладывается основа для успешного проекта.

Токенизация и Стемминг: Разбираем Текст на Части

Наш путь в NLP начался с изучения основ, и одними из первых концепций, с которыми мы столкнулись, были токенизация и стемминг. Токенизация – это процесс разбиения текста на отдельные слова или фразы, которые называются токенами. Представьте, что у вас есть длинное предложение, и вам нужно понять, из каких слов оно состоит. Токенизация делает именно это! Мы используем для этого такие библиотеки, как NLTK (Natural Language Toolkit), которая предлагает различные токенизаторы, например, для слов и предложений.

import nltk

from nltk.tokenize import word_tokenize, sent_tokenize

text = "Привет, мир! Мы изучаем NLTK. Это очень интересно."

words = word_tokenize(text)

sentences = sent_tokenize(text)

print(f"Слова: {words}")

print(f"Предложения: {sentences}")

После того как мы разбили текст на токены, часто возникает необходимость привести слова к их базовой форме. Здесь на помощь приходит стемминг – процесс отсечения суффиксов и окончаний от слов, чтобы получить их корень (стем). Например, слова "бежать", "бежит", "бежал" будут приведены к "беж". Это помогает нам считать все эти формы как одно и то же слово, что важно для анализа частотности и тематического моделирования. Однако у стемминга есть свой недостаток: иногда он может создавать корни, которые не являются реальными словами.

Лемматизация: К Корню с Умом

Осознав ограничения стемминга, мы быстро перешли к лемматизации. В отличие от стемминга, лемматизация приводит слова к их словарной (канонической) форме, называемой леммой, и при этом учитывает морфологию языка. Например, слова "бежать", "бежит", "бежал" будут приведены к "бежать". Это гораздо точнее, поскольку результат всегда является корректным словом. Мы активно используем для этого как NLTK с его WordNetLemmatizer, так и spaCy, который встроенную лемматизацию на основе синтаксического анализа.

Регулярные Выражения (re): Наш Щвейцарский Нож для Текста

Невозможно говорить о предобработке текста без упоминания регулярных выражений (модуль `re` в Python). Это мощнейший инструмент для поиска, замены и извлечения паттернов в строках. Нужна ли нам удалить HTML-теги, убрать пунктуацию, найти все email-адреса или номера телефонов? Регулярные выражения – это наш ответ. Мы обнаружили, что освоение `re` значительно ускоряет и упрощает множество задач по очистке и структурированию текстовых данных.

import re

text_with_html = "Это текст с <b>жирным</b> шрифтом и email: test@example.com."

clean_text = re.sub(r'<.*?>', '', text_with_html) # Удаляем HTML-теги

emails = re.findall(r'[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+.[A-Z|a-z]{2,}', text_with_html) # Находим email-адреса

print(f"Текст без HTML: {clean_text}")

print(f"Найденные email-адреса: {emails}")

NLTK, spaCy и TextBlob: Наши Основные Инструменты

Когда мы говорим о базовых библиотеках для NLP в Python, на ум сразу приходят три гиганта:

- NLTK (Natural Language Toolkit): Это наша "рабочая лошадка" для академических исследований и обучения. Она содержит множество модулей для токенизации, стемминга, лемматизации, POS-теггинга (разметки частей речи) и многого другого. Мы часто используем NLTK, когда нужно быстро протестировать новую идею или исследовать конкретный аспект языка.

- spaCy: Если NLTK – это набор инструментов, то spaCy – это высокопроизводительный конвейер для продакшн-ready NLP. Мы ценим spaCy за его скорость, эффективность и преднастроенные модели, которые позволяют выполнять такие задачи, как NER (Распознавание Именованных Сущностей) и синтаксический парсинг, прямо "из коробки". Он также отлично подходит для работы с многоязычными корпусами, включая русский язык.

- TextBlob: Для более простых задач и быстрого прототипирования мы часто обращаемся к TextBlob. Это удобная библиотека, построенная поверх NLTK, которая предоставляет простой API для анализа тональности, POS-теггинга, извлечения n-грамм и даже перевода. Она идеальна, когда нам нужно быстро получить представление о тексте без глубокой настройки.

Превращаем Слова в Числа: Векторизация Текста

Компьютеры, в отличие от людей, не понимают значения слов напрямую. Для них текст – это просто последовательность символов. Чтобы машины могли обрабатывать и анализировать естественный язык, нам нужно перевести слова в числовой формат, или векторы. Этот процесс называется векторизацией текста, и он является ключевым шагом для применения алгоритмов машинного обучения к текстовым данным. Мы перепробовали множество подходов и готовы поделиться нашим опытом.

Классические Методы: CountVectorizer и TF-IDF

Начали мы с самых простых, но эффективных методов. CountVectorizer из Scikit-learn позволяет нам создать матрицу, где каждая строка представляет документ, а каждый столбец – уникальное слово из всего корпуса текстов. Значение в ячейке – это просто количество вхождений слова в документ. Это отличный способ получить представление о частотности слов, но у него есть недостаток: он не учитывает важность слов.

from sklearn.feature_extraction.text import CountVectorizer

corpus = ["Этот документ очень интересный.", "Документ содержит интересные факты."]

vectorizer = CountVectorizer

X = vectorizer.fit_transform(corpus)

print(vectorizer.get_feature_names_out)

print(X.toarray)

Чтобы решить проблему важности слов, мы перешли к TfidfVectorizer (Term Frequency-Inverse Document Frequency). Этот метод не просто считает слова, но и взвешивает их: чем чаще слово встречается в конкретном документе, но реже в других документах корпуса, тем выше его вес TF-IDF. Это помогает нам выделить ключевые слова, которые действительно характеризуют документ, а не просто являются частотными (например, "и", "в", "на").

Векторные Представления Слов (Word Embeddings): Word2Vec и GloVe

По мере углубления в NLP, мы поняли, что классические методы имеют ограничения – они не улавливают семантические связи между словами. Именно здесь на сцену вышли Word Embeddings. Word2Vec и GloVe стали для нас настоящим откровением. Эти модели учатся представлять слова в виде плотных векторов в многомерном пространстве таким образом, что слова с похожим значением оказываются близко друг к другу.

Мы активно используем библиотеку Gensim для работы с Word2Vec. Она позволяет нам обучать собственные модели на больших корпусах текста или использовать уже предобученные модели. Это открыло нам двери к задачам, где понимание смысла слова критически важно, например, для поиска синонимов или определения тематической близости документов.

from gensim.models import Word2Vec

from nltk.tokenize import word_tokenize

sentences = [word_tokenize("Этот документ очень интересный"),

word_tokenize("Документ содержит интересные факты"),

word_tokenize("Машина очень быстрая")]

model = Word2Vec(sentences, vector_size=100, window=5, min_count=1, workers=4)

vector_интересный = model.wv['интересный']

similar_words = model.wv.most_similar('интересный')

print(f"Вектор для 'интересный': {vector_интересный[:5]}...")

print(f"Слова, похожие на 'интересный': {similar_words}")

GloVe (Global Vectors for Word Representation) – еще один мощный метод, который мы используем. В отличие от Word2Vec, GloVe основан на глобальной статистике совместной встречаемости слов, что позволяет ему более эффективно использовать информацию о структуре всего корпуса.

От Слов к Документам: Doc2Vec и Sentence Transformers

После освоения Word Embeddings, естественным следующим шагом для нас стало представление не только отдельных слов, но и целых предложений или документов в виде векторов. Doc2Vec (расширение Word2Vec) позволяет нам это сделать. Он учится создавать векторы для каждого документа, учитывая контекст слов внутри него.

В последние годы мы все чаще обращаемся к Sentence Transformers. Это современные модели, основанные на архитектуре трансформеров, которые позволяют нам получать высококачественные векторные представления для предложений и даже целых параграфов. Они доказали свою эффективность в задачах поиска семантически похожих текстов, кластеризации и даже в системах рекомендаций.

Основные Задачи NLP: От Распознавания до Анализа Тональности

С освоенными инструментами предобработки и векторизации мы были готовы решать реальные задачи. Мир NLP огромен, и каждый новый проект приносит новые вызовы и возможности для применения наших знаний. Мы сосредоточились на самых востребованных направлениях, которые приносят наибольшую практическую пользу.

Распознавание Именованных Сущностей (NER) с spaCy и Flair

Одна из самых полезных задач, с которой мы постоянно работаем, это NER (Named Entity Recognition). Суть NER заключается в извлечении из текста именованных сущностей, таких как имена людей, названия организаций, географические объекты, даты, денежные суммы и т.д. Это невероятно ценно для структурирования неструктурированного текста.

Мы в восторге от того, насколько хорошо spaCy справляется с NER "из коробки". Его предобученные модели позволяют нам быстро и точно извлекать сущности на разных языках. Для более сложных и современных задач мы используем библиотеку Flair, которая предлагает state-of-the-art модели для NER, основанные на глубоких нейронных сетях и контекстных встраиваниях. Flair часто дает нам лучшие результаты, особенно когда речь идет о нюансах и специфических сущностях.

import spacy

Загружаем модель для русского языка

!python -m spacy download ru_core_news_sm

nlp = spacy.load("ru_core_news_sm")

text = "Лев Толстой родился в Тульской губернии в 1828 году."

doc = nlp(text)

print("Найденные сущности:")

for ent in doc.ents:

print(f" {ent.text} ({ent.label_})")

Тематическое Моделирование (LDA, LSI) с Gensim

Как понять, о чем говорят тысячи документов, не читая каждый из них? Здесь на помощь приходит тематическое моделирование. Мы используем библиотеку Gensim для реализации алгоритмов, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Эти методы позволяют нам автоматически выявлять скрытые темы в больших коллекциях текстов.

Например, анализируя отзывы клиентов, мы можем обнаружить темы, связанные с "качеством обслуживания", "ценой продукта", "удобством использования" и т;д.. Это дает нам ценные инсайты для бизнеса. Мы часто сравниваем LDA и NMF (Non-negative Matrix Factorization), чтобы понять, какой метод лучше подходит для конкретного набора данных и нашей задачи.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Анализ Тональности (Sentiment Analysis)

В современном мире, где каждый оставляет отзывы и комментарии, понимание эмоций, стоящих за текстом, становится критически важным; Анализ тональности позволяет нам определить эмоциональную окраску текста: позитивную, негативную или нейтральную. Мы применяем различные подходы:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Отлично подходит для анализа тональности в социальных сетях, так как специально разработан для работы со сленгом, эмодзи и акронимами. Он быстрый и не требует обучения.

- TextBlob: Предоставляет простой интерфейс для анализа тональности, что удобно для быстрого прототипирования.

- Модели на основе машинного обучения: Для более сложных задач мы обучаем собственные классификаторы, используя Scikit-learn (SVM, Наивный Байес) или даже глубокие нейронные сети (LSTM, трансформеры) с PyTorch/TensorFlow. Это позволяет нам адаптировать модели под специфику предметной области (например, анализ тональности финансовых новостей или медицинских записей).

Особое внимание мы уделяем анализу тональности в социальных сетях, где сарказм и ирония могут сильно исказить результаты. Это одна из тех областей, где наши модели постоянно совершенствуются.

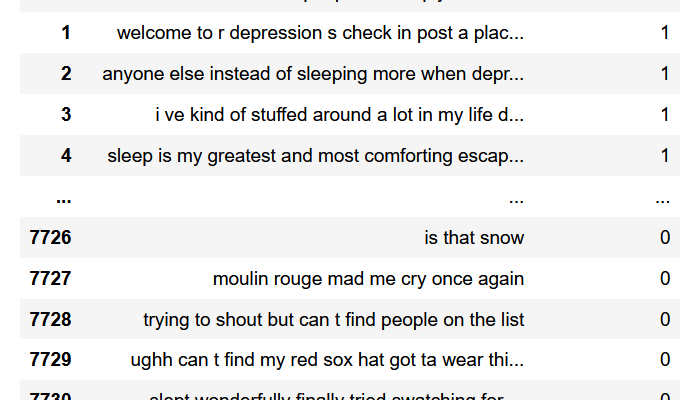

Классификация Текстов со Scikit-learn

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Мы использовали ее для автоматической категоризации статей, фильтрации спама, маршрутизации обращений клиентов и многого другого. Scikit-learn – наша основная библиотека для этих целей.

Мы начинаем с векторизации текста (чаще всего TF-IDF), а затем применяем различные алгоритмы машинного обучения:

- Наивный Байесовский Классификатор (Naive Bayes): Прост, быстр и часто удивительно эффективен.

- Метод Опорных Векторов (SVM): Отлично работает с высокоразмерными данными, такими как текстовые векторы, и часто дает очень хорошие результаты.

- Логистическая Регрессия (Logistic Regression): Надежный базовый классификатор, который хорошо интерпретируется.

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.svm import SVC

from sklearn.pipeline import make_pipeline

Пример данных

texts = ["Отличный сервис, очень доволен.", "Ужасный продукт, не рекомендую.", "Все в порядке, нейтрально;"]

labels = ["позитивный", "негативный", "нейтральный"]

Создаем пайплайн для векторизации и классификации

model = make_pipeline(TfidfVectorizer, SVC)

model.fit(texts, labels)

Прогнозируем для нового текста

new_text = "Сервис был быстрым и эффективным."

prediction = model.predict([new_text])

print(f"Текст '{new_text}' классифицирован как: {prediction[0]}")

Мы всегда проводим тщательную оценку качества наших моделей, используя метрики, такие как F1-score, Precision и Recall, чтобы убедиться в их надежности.

Глубокое Погружение: Нейросети и Трансформеры

Когда задачи стали сложнее, а объемы данных – больше, мы поняли, что пора осваивать глубокое обучение. Нейронные сети, особенно трансформерные архитектуры, произвели революцию в NLP, позволив нам решать задачи, которые раньше казались невозможными.

Трансформеры (Hugging Face): Мощность в Ваших Руках

Библиотека Hugging Face Transformers стала для нас настоящим открытием. Она предоставляет легкий доступ к сотням предварительно обученных моделей, таких как BERT, GPT, RoBERTa и многих других. Эти модели обучены на огромных объемах текста и способны выполнять широкий спектр задач: от классификации и NER до генерации текста и машинного перевода.

Мы используем трансформеры для:

- Сложных задач NER: Для извлечения сущностей в узкоспециализированных текстах.

- Вопросно-ответных систем (QA): Позволяя моделям находить ответы на вопросы в больших текстовых корпусах.

- Суммаризации текста: Как экстрактивной (выделение ключевых предложений), так и абстрактивной (генерация нового, краткого текста).

- Машинного перевода: Создавая системы, способные переводить тексты с высокой точностью.

- Генерации текста: Создавая осмысленный и связный контент.

Возможность тонкой настройки (fine-tuning) этих предварительно обученных моделей на наших собственных данных позволяет нам достигать впечатляющих результатов даже с ограниченным объемом специфических данных.

PyTorch/TensorFlow: Создаем Свои Нейросети для NLP

Когда готовых решений недостаточно, или нам нужно максимальное количество контроля над архитектурой, мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow/Keras. Мы использовали их для создания LSTM-сетей для классификации последовательностей, а также для реализации более сложных архитектур, когда требовалось глубокое понимание контекста и структуры языка. Это позволяет нам не только использовать существующие модели, но и разрабатывать совершенно новые подходы к решению NLP-задач.

Практические Применения и Нишевые Задачи

NLP – это не только теоретические модели, но и огромный спектр практических применений, с которыми мы сталкиваемся ежедневно. Наши проекты часто выходят за рамки базовых задач, требуя творческого подхода и комбинирования различных инструментов.

Веб-Скрейпинг и Очистка Данных: Подготовка Почвы

Прежде чем мы можем анализировать текст, его нужно где-то взять. Часто это означает извлечение данных из интернета. Библиотека Beautiful Soup стала нашим надежным помощником для веб-скрейпинга. Мы используем ее для парсинга HTML-страниц и извлечения текстового контента, который затем передаем в наш NLP-конвейер.

Но сырой текст из интернета редко бывает чистым. Он содержит HTML-теги, скрипты, рекламу, лишние пробелы и прочий "мусор". Мы разработали целый набор инструментов для очистки данных, используя регулярные выражения, удаление стоп-слов, нормализацию пунктуации и приведение к нижнему регистру. Это критически важный этап, поскольку качество входных данных напрямую влияет на качество конечного анализа.

Работа с Многоязычными Текстовыми Корпусами

Мир не ограничивается одним языком, и наши проекты тоже. Мы часто работаем с многоязычными текстовыми корпусами. Для этого мы используем:

- spaCy: Поддерживает множество языков, предлагая предобученные модели для токенизации, POS-теггинга и NER.

- Stanza (от Stanford NLP Group): Особенно полезна для языков с богатой морфологией (как русский), предоставляя углубленный морфологический анализ и синтаксический парсинг.

- Polyglot: Еще одна отличная библиотека для мультиязычности, позволяющая работать с широким спектром языков для токенизации, NER и определения языка.

Это позволяет нам проводить анализ текста на нескольких языках без необходимости создавать отдельные конвейеры для каждого из них.

Чат-боты и Вопросно-ответные Системы

Создание интеллектуальных чат-ботов и вопросно-ответных систем (QA) – это одна из самых захватывающих областей NLP. Мы экспериментировали с фреймворком Rasa для разработки разговорных AI, который позволяет нам строить контекстно-зависимые чат-боты. Для QA-систем мы часто используем трансформеры, которые могут находить точные ответы на вопросы в больших базах знаний.

Анализ Стилистики и Обнаружение Плагиата

Иногда нам нужно понять не что сказано, а как сказано. Анализ стилистики текстов (например, для определения авторского почерка) включает в себя анализ лексического богатства, частотности n-грамм, использования пунктуации и других стилистических маркеров. Это также тесно связано с разработкой систем обнаружения плагиата, где мы сравниваем документы на предмет текстового сходства, используя такие метрики, как TextDistance или Doc2Vec.

Мы составили таблицу, чтобы наглядно показать некоторые области применения и соответствующие инструменты:

| Задача NLP | Ключевые Методы/Инструменты | Примеры Применения |

|---|---|---|

| Предобработка текста | Токенизация, Стемминг, Лемматизация, Регулярные выражения (NLTK, spaCy, `re`) | Очистка данных, подготовка для анализа |

| Векторизация текста | TF-IDF, Word2Vec, GloVe, Doc2Vec, Sentence Transformers (Scikit-learn, Gensim, Hugging Face) | Преобразование текста для машинного обучения |

| Распознавание именованных сущностей (NER) | spaCy, Flair, CRF, Трансформеры | Извлечение информации (имена, даты, локации) |

| Анализ тональности | VADER, TextBlob, ML-классификаторы, Трансформеры | Анализ отзывов, мониторинг соцсетей |

| Тематическое моделирование | LDA, LSI, NMF (Gensim) | Выявление скрытых тем в больших текстах |

| Классификация текстов | SVM, Наивный Байес, Трансформеры (Scikit-learn, PyTorch/TensorFlow) | Категоризация документов, фильтрация спама |

| Генерация и суммаризация | Трансформеры (GPT, BERT), TextRank | Автоматическое создание контента, краткое изложение |

| Машинный перевод | Трансформеры (Hugging Face) | Автоматический перевод текстов |

Обработка Неструктурированного Текста и Больших Данных

Работа с "грязными" и неполными данными – это реальность большинства NLP-проектов. Мы постоянно сталкиваемся с проблемами обработки неструктурированного текста, который может содержать ошибки, опечатки, сленг, эмодзи, сокращения. Для этого мы разрабатываем инструменты для проверки грамматики и орфографии, нормализации сленга, а также используем библиотеки для сравнения строк (например, Jellyfish) для поиска похожих, но неидентичных записей.

Когда речь идет об обработке больших текстовых массивов (Big Data NLP), мы используем оптимизированные библиотеки, такие как Gensim, для эффективного тематического моделирования или Spark NLP для распределенной обработки. Иногда для ускорения работы мы прибегаем к GPU-ускорению, особенно при работе с трансформерами и глубокими нейронными сетями.

Визуализация Текстовых Данных

Визуализация – это не просто красивая картинка, это мощный инструмент для понимания данных. Мы активно используем такие инструменты, как Word Clouds (облака слов) для быстрого представления наиболее частотных терминов, и Heatmaps (тепловые карты) для визуализации матриц сходства или корреляции тем. Это помогает нам быстро получать инсайты и наглядно демонстрировать результаты нашей работы.

Наш путь в мире NLP с Python был и остается захватывающим приключением. Мы видели, как простые скрипты для подсчета слов превращаются в сложные нейросетевые модели, способные генерировать осмысленный текст и переводить языки. Мы научились не только использовать готовые инструменты, но и создавать собственные, адаптируя их под уникальные задачи.

Мы верим, что будущее NLP за еще более умными и адаптивными моделями, способными понимать контекст, эмоции и даже скрытые значения с беспрецедентной точностью. С развитием трансформерных архитектур и увеличением вычислительных мощностей, мы ожидаем появления систем, которые будут еще теснее интегрированы в нашу повседневную жизнь, делая взаимодействие с технологиями еще более естественным и интуитивным.

Если вы только начинаете свой путь в NLP, помните: главное – начать с основ, постепенно углубляясь в более сложные концепции. Python предоставляет невероятно богатую экосистему инструментов и библиотек, которые делают этот путь доступным и увлекательным. Мы надеемся, что наш опыт вдохновит вас на собственные исследования и открытия в этом удивительном мире слов и данных.

Подробнее

| Основы токенизации NLTK | Применение spaCy для NER | Сравнение Word2Vec TF-IDF | Анализ тональности VADER | Тематическое моделирование LDA |

| Трансформеры Hugging Face | Разработка чат-ботов Python | Обработка больших текстов | Извлечение ключевых фраз | Лемматизация vs Стемминг |