- Разгадывая Тайны Текста: Наш Путь в Мире NLP с Python

- Основы Основания: Подготовка Текста к Анализу

- Токенизация и Стемминг: Разбираем Текст на Части

- Регулярные Выражения: Ваш Швейцарский Нож в Предобработке

- Очистка Неструктурированного Текста: От HTML до Пунктуации

- Извлечение Смысла: От Слов к Сущностям

- Векторизация Текста: От TF-IDF к Word Embeddings

- Распознавание Именованных Сущностей (NER) с SpaCy и Трансформерами

- Глубокий Анализ и Моделирование

- Тематическое Моделирование с Gensim (LDA, LSI, NMF)

- Классификация Текстов: Scikit-learn и Нейросети

- Анализ Тональности: VADER и Контекстные Модели

- Продвинутые Методики и Современные Тренды

- Трансформеры (Hugging Face): Новый Горизонт NLP

- Разработка QA-Систем и Чат-ботов

- Многоязычность и Редкие Языки

- NLP в Действии: От Бизнеса до Науки

- Веб-Скрейпинг и Извлечение Информации (Beautiful Soup, Textacy)

- Анализ Больших Текстовых Массивов (Big Data NLP)

- Проблемы и Решения: Неполные Данные, Ошибки, Сленг

Разгадывая Тайны Текста: Наш Путь в Мире NLP с Python

Привет, друзья! Сегодня мы хотим поделится с вами нашим захватывающим путешествием в мир Обработки Естественного Языка (NLP) с использованием Python. Это не просто технический гайд, а скорее рассказ о том, как мы, шаг за шагом, осваивали инструменты, преодолевали сложности и открывали для себя удивительные возможности, которые скрыты в обычных словах. Текст — это не просто набор символов; это сокровищница информации, эмоций и знаний, и NLP помогает нам эту сокровищницу открыть.

За годы работы с текстовыми данными мы убедились: Python — это настоящий волшебный ключ в мире NLP. Его экосистема богата библиотеками, которые делают даже самые сложные задачи доступными и увлекательными. От базовой предобработки до создания интеллектуальных систем, способных понимать и генерировать человеческую речь, Python предлагает нам все необходимое. Мы приглашаем вас присоединиться к нам в этом увлекательном приключении, где мы разберем основные концепции, покажем практические примеры и поделимся нашим личным опытом.

В этой статье мы не будем просто перечислять библиотеки. Мы покажем, как эти инструменты работают вместе, создавая мощные решения для анализа, понимания и даже генерации текста. Мы поговорим о том, как начать, какие шаги предпринять, чтобы ваш проект NLP был успешным, и как избежать типичных ошибок. Приготовьтесь к погружению в мир, где машины начинают "говорить" и "понимать" так же, как и мы.

Основы Основания: Подготовка Текста к Анализу

Прежде чем мы сможем заставить машину "понять" текст, нам необходимо его подготовить. Этот этап, известный как предобработка, является фундаментом любого проекта NLP. Представьте себе сырой алмаз – чтобы он засиял, его нужно отшлифовать. Точно так же и с текстом: без должной обработки он останется хаотичным набором символов, бесполезным для алгоритмов машинного обучения. Мы обнаружили, что пренебрежение этим этапом часто приводит к неточным результатам и разочарованию.

В нашем арсенале для предобработки текста есть несколько мощных инструментов, каждый из которых выполняет свою уникальную функцию. Мы научились виртуозно жонглировать ими, чтобы добиться наилучшего качества данных. Главными помощниками на этом этапе для нас стали библиотеки NLTK и SpaCy, а также старые добрые регулярные выражения.

Токенизация и Стемминг: Разбираем Текст на Части

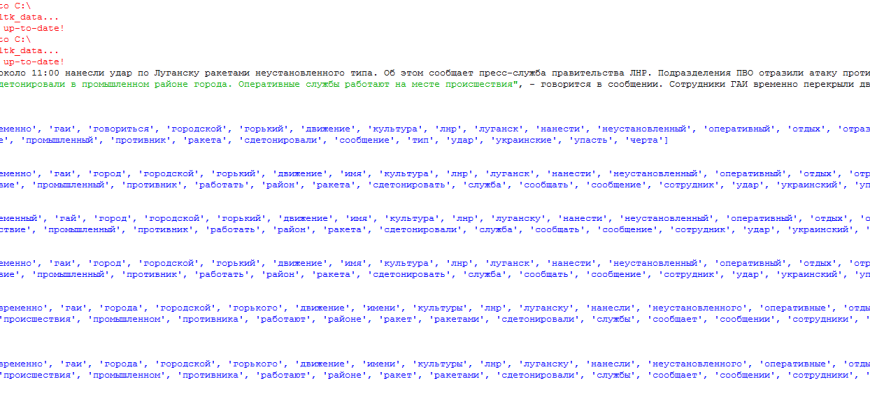

Первый и, пожалуй, самый важный шаг — это токенизация. Мы разбиваем текст на мельчайшие значимые единицы — токены. Чаще всего это слова, но могут быть и предложения, знаки пунктуации или даже части слов. NLTK (Natural Language Toolkit) и SpaCy предлагают нам отличные инструменты для этого. NLTK, например, предоставляет функции для токенизации предложений и слов, учитывая особенности различных языков.

После токенизации мы сталкиваемся с проблемой вариативности слов: "бежать", "бежит", "бегал" — все это формы одного и того же глагола. Здесь на помощь приходят стемминг и лемматизация. Стемминг обрезает слово до его основы (корня), не обязательно являющейся морфологически корректным словом (например, "бежал" -> "беж"). Лемматизация же более интеллектуальна: она приводит слово к его начальной форме (лемме) с учетом его части речи (например, "бежал" -> "бежать"). Мы предпочитаем лемматизацию, поскольку она сохраняет больше лингвистической информации, хотя и является более ресурсоемкой.

Наш опыт показывает, что выбор между стеммингом и лемматизацией зависит от задачи. Для быстрого анализа больших объемов данных стемминг может быть достаточным, но для задач, требующих глубокого понимания семантики, лемматизация незаменима.

Регулярные Выражения: Ваш Швейцарский Нож в Предобработке

Иногда текст содержит лишние символы, ссылки, HTML-теги или специфические паттерны, которые мешают анализу. В таких случаях мы обращаемся к регулярным выражениям (модуль `re` в Python). Это невероятно мощный инструмент для поиска и замены текстовых шаблонов. С их помощью мы можем легко удалять нежелательные элементы, извлекать нужную информацию или приводить текст к стандартному виду. Например, удаление всех HTML-тегов из веб-страницы — задача на одну строку с `re`.

Мы используем регулярные выражения для:

- Удаления HTML-тегов: часто при скрейпинге данных мы получаем текст, смешанный с разметкой.

- Очистки от пунктуации и специальных символов: оставляем только буквы и цифры.

- Нормализации пробелов: заменяем несколько пробелов одним.

- Извлечения специфических сущностей: например, номера телефонов, email-адреса, даты.

Освоение регулярных выражений требует практики, но это инвестиция, которая окупается сторицей в любом проекте, связанном с текстом. Мы неоднократно убеждались в их незаменимости.

Очистка Неструктурированного Текста: От HTML до Пунктуации

Реальный мир полон "грязных" данных. Текст может быть взят из PDF-документов, веб-страниц, социальных сетей, и каждый источник имеет свои особенности. Мы часто сталкиваемся с необходимостью удаления стоп-слов (артиклей, предлогов, союзов), которые не несут смысловой нагрузки, но увеличивают объем данных и шум. NLTK предлагает готовые списки стоп-слов для многих языков, которые мы активно используем.

Кроме того, мы работаем с TextBlob для простых задач NLP, таких как определение языка или базовый анализ тональности, что иногда помогает на ранних этапах очистки. Для более сложных сценариев, таких как извлечение текста из PDF, мы используем PyMuPDF, а для веб-скрейпинга — Beautiful Soup. Эти инструменты позволяют нам получить чистый, структурированный текст, готовый к дальнейшему анализу.

Вот таблица, демонстрирующая основные этапы предобработки текста, которые мы обычно проходим:

| Этап Предобработки | Описание | Используемые Инструменты/Методы | Пример |

|---|---|---|---|

| Извлечение | Получение текста из исходного источника (веб, PDF, БД). | Beautiful Soup, PyMuPDF, базы данных. | Скрейпинг статьи с веб-сайта. |

| Очистка | Удаление шума: HTML-тегов, спецсимволов, лишних пробелов. | Регулярные выражения (`re`). | <p>Текст.</p> -> Текст. |

| Токенизация | Разбиение текста на слова и предложения. | NLTK (`word_tokenize`, `sent_tokenize`), SpaCy. | "Привет, мир!" -> ['Привет', ',', 'мир', '!'] |

| Нормализация | Приведение слов к базовой форме (лемматизация/стемминг), приведение к нижнему регистру. | NLTK (`WordNetLemmatizer`), SpaCy (`doc.lemma_`). | "бежал" -> "бежать" |

| Удаление стоп-слов | Удаление часто встречающихся, но неинформативных слов. | NLTK (`stopwords`); | "Я хочу есть." -> "хочу есть." |

Извлечение Смысла: От Слов к Сущностям

Когда текст тщательно очищен и подготовлен, мы переходим к более увлекательной части — извлечению из него смысла. На этом этапе мы стремимся не просто понять, какие слова используются, но и что они означают в контексте, как они связаны друг с другом и какие сущности они представляют. Это ключ к построению интеллектуальных систем, способных по-настоящему взаимодействовать с человеческим языком. Наш опыт показывает, что именно здесь начинаются настоящие чудеса NLP.

Векторизация Текста: От TF-IDF к Word Embeddings

Машины не понимают слов; они понимают числа. Поэтому одним из фундаментальных шагов в NLP является векторизация текста, преобразование слов и документов в числовые векторы. Мы начинали с простых методов, таких как CountVectorizer, который просто подсчитывает частоту слов, и TfidfVectorizer, который учитывает важность слова в документе относительно всего корпуса текстов. Эти методы просты, но удивительно эффективны для многих задач классификации.

Однако вскоре мы поняли, что TF-IDF не учитывает семантику слов. "Король" и "королева" могут быть далеки друг от друга в векторном пространстве, хотя семантически они очень близки. Здесь на сцену выходят Word Embeddings (векторные представления слов) — такие модели, как Word2Vec и GloVe, реализованные в библиотеке Gensim. Они обучаются на больших корпусах текста и размещают семантически похожие слова близко друг к другу в многомерном пространстве. Это позволяет алгоритмам улавливать тонкие смысловые связи, что значительно улучшает качество моделей. Мы были поражены, обнаружив, что "король" ⏤ "мужчина" + "женщина" = "королева" работает на практике!

Для представления целых документов или даже предложений в виде векторов мы используем Doc2Vec (расширение Word2Vec) и более современные Sentence Transformers. Последние особенно мощны, поскольку они создают контекстно-зависимые эмбеддинги, что важно для понимания значения предложений целиком.

Распознавание Именованных Сущностей (NER) с SpaCy и Трансформерами

Представьте, что вам нужно быстро найти все имена людей, названия организаций или географические объекты в большом тексте. Это задача для Распознавания Именованных Сущностей (NER). Для нас SpaCy стал незаменимым инструментом для быстрого и точного NER. Его предобученные модели позволяют нам с минимальными усилиями извлекать такие сущности, как PERSON, ORG, GPE (геополитические объекты), DATE и многие другие.

Когда же требуются более высокие точность и гибкость, особенно для специфических доменов, мы обращаемся к трансформерам от Hugging Face и библиотеке Flair. Эти современные архитектуры позволяют создавать контекстно-зависимые эмбеддинги и достигать state-of-the-art результатов в NER. Мы даже экспериментировали с использованием условных случайных полей (CRF) в сочетании с другими признаками для NER, что давало хорошие результаты на небольших, специфических наборах данных.

Вот сравнение ключевых методов векторизации, с которыми мы работали:

| Метод Векторизации | Основа | Преимущества | Недостатки | Типичные Задачи |

|---|---|---|---|---|

| CountVectorizer | Частота слов | Простота, скорость. | Не учитывает семантику, размерность растет с словарем. | Классификация коротких текстов. |

| TfidfVectorizer | TF-IDF (важность слова) | Учитывает важность, уменьшает влияние частых слов. | Не учитывает семантику, разреженные матрицы. | Классификация, поиск релевантности. |

| Word2Vec/GloVe | Представление слов векторами | Учитывает семантику, компактные векторы. | Не учитывает контекст слова в предложении, требует больших данных. | Семантический поиск, аналогий. |

| Doc2Vec | Векторное представление документов | Представляет целые документы, учитывает порядок слов. | Требует настройки, может быть медленным на больших корпусах. | Классификация документов, поиск похожих статей. |

| Sentence Transformers | Контекстно-зависимые эмбеддинги предложений | Высокая семантическая точность, понимание контекста. | Вычислительно затратно, требует мощных моделей. | Поиск семантически похожих предложений, QA. |

Глубокий Анализ и Моделирование

Сырые данные превращены в осмысленные векторы, а сущности успешно извлечены. Теперь мы готовы к следующему этапу: погружению в глубокий анализ и моделирование. На этом уровне мы начинаем строить системы, которые могут не только идентифицировать элементы текста, но и делать выводы, классифицировать его по темам, предсказывать тональность и находить скрытые структуры. Это то, что делает NLP по-настоящему мощным инструментом для бизнеса и исследований. Мы обнаружили, что именно здесь раскрывается потенциал машинного обучения в полной мере.

Тематическое Моделирование с Gensim (LDA, LSI, NMF)

Часто перед нами встает задача понять, о чем идет речь в большом корпусе текстов, не читая каждый документ по отдельности. Здесь нам на помощь приходит тематическое моделирование. Библиотека Gensim — наш верный спутник в этом деле. Мы активно используем такие алгоритмы, как LDA (Латентное Размещение Дирихле), LSI (Латентное Семантическое Индексирование) и NMF (Неотрицательная Факторизация Матриц).

LDA позволяет нам выявить скрытые "темы" в коллекции документов, представляя каждый документ как смесь тем, а каждую тему, как смесь слов. LSI похож, но использует сингулярное разложение для выявления паттернов. NMF, в свою очередь, разлагает матрицу "документ-слово" на две матрицы, которые можно интерпретировать как "документ-тема" и "тема-слово". Мы обнаружили, что выбор метода сильно зависит от характера данных и желаемой интерпретируемости результатов. LDA часто дает более читаемые темы, а NMF может быть эффективен для коротких текстов.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Классификация Текстов: Scikit-learn и Нейросети

Классификация текстов — одна из самых распространенных задач в NLP, от фильтрации спама до категоризации новостных статей. Начинали мы с классических алгоритмов машинного обучения из библиотеки Scikit-learn. SVM (метод опорных векторов) и Наивный Байесовский классификатор показали себя как надежные и эффективные решения для многих задач. Они относительно просты в понимании и настройке, что делает их отличным стартом.

Однако с ростом сложности задач и объемов данных мы перешли к более мощным инструментам, нейронным сетям, используя фреймворки PyTorch и TensorFlow. Мы строили LSTM-сети для анализа последовательностей и, конечно же, активно применяли BERT и другие трансформерные модели для задач классификации. Трансформеры, с их способностью улавливать глубокие контекстные зависимости, значительно превзошли традиционные методы по точности, особенно на больших и разнообразных наборах данных.

Анализ Тональности: VADER и Контекстные Модели

Понимание эмоций и мнений, выраженных в тексте, является критически важным для анализа отзывов клиентов, мониторинга социальных сетей и многих других бизнес-задач. Это задача анализа тональности (Sentiment Analysis). Для быстрого и простого анализа мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner). Он основан на правилах и словарях, хорошо работает с текстами из социальных сетей и способен улавливать нюансы, такие как использование смайликов и акронимов.

Однако для более глубокого и контекстно-зависимого анализа, особенно с учетом сарказма или сложных эмоциональных оттенков, мы обращаемся к предобученным трансформерным моделям. Тонкая настройка (fine-tuning) этих моделей на специфических для нашей задачи данных позволяет нам достигать впечатляющей точности в определении тональности, даже в сообщениях в социальных сетях с их уникальным языком. Мы также используем TextBlob для определения тональности, когда нужна быстрая оценка без глубокой настройки.

Вот таблица, сравнивающая некоторые модели тематического моделирования:

| Модель | Принцип Работы | Преимущества | Недостатки | Идеально для |

|---|---|---|---|---|

| LDA (Gensim) | Вероятностная модель, каждый документ — смесь тем, каждая тема — смесь слов. | Хорошая интерпретируемость тем, хорошо работает с большими корпусами. | Требует настройки гиперпараметров, чувствителен к предобработке. | Выявление общих тем в новостях, научных статьях. |

| LSI (Gensim) | Основан на сингулярном разложении (SVD) матрицы "терм-документ". | Простота реализации, эффективен для поиска похожих документов. | Темы могут быть менее интерпретируемыми, чем в LDA. | Информационный поиск, поиск схожих документов. |

| NMF (Scikit-learn) | Разложение матрицы "терм-документ" на две неотрицательные матрицы. | Хорошо работает с разреженными данными, темы часто хорошо интерпретируемы. | Чувствителен к инициализации, может быть медленным для очень больших данных. | Анализ коротких текстов, извлечение ключевых фраз. |

Продвинутые Методики и Современные Тренды

Мир NLP развивается с невероятной скоростью, и то, что вчера казалось фантастикой, сегодня становится стандартом. Мы постоянно отслеживаем новые тенденции и интегрируем передовые методики в нашу работу, чтобы оставаться на гребне волны. Особенно ярко это проявляется в области трансформеров и генеративного ИИ, которые открыли совершенно новые горизонты для понимания и создания текста. Это направление, которое полностью изменило наш подход к решению сложных задач NLP.

Трансформеры (Hugging Face): Новый Горизонт NLP

Появление архитектуры Трансформеров стало настоящей революцией в NLP. Модели, такие как BERT, GPT, T5, основанные на этой архитектуре, демонстрируют беспрецедентные способности к пониманию контекста и генерации текста. Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет доступ к сотням предобученных моделей и удобные инструменты для их тонкой настройки (fine-tuning) под конкретные задачи. Это позволило нам значительно улучшить результаты в таких областях, как:

- Классификация текста: достижение высокой точности даже на сложных наборах данных.

- Распознавание именованных сущностей (NER): извлечение сущностей с учетом глубокого контекста.

- Суммаризация текста: создание кратких, но информативных пересказов (как экстрактивная, так и абстрактивная).

- Машинный перевод: построение систем, способных переводить тексты с высокой точностью.

- Генерация текста (GPT): создание связных и осмысленных текстов, ответов на вопросы и даже кода.

Мы видим, что трансформеры не просто улучшают существующие решения, но и позволяют решать задачи, которые ранее казались невозможными, например, анализ стилистики текстов или выявление связей между сущностями на основе огромных объемов информации.

Разработка QA-Систем и Чат-ботов

Способность компьютера отвечать на вопросы, заданные на естественном языке, или вести диалог, одна из самых амбициозных целей NLP. Мы активно работаем над разработкой систем вопросно-ответных систем (QA), где трансформеры играют ключевую роль. Они позволяют находить наиболее релевантные ответы в больших массивах документов или даже генерировать их с нуля. Это открывает двери для создания интеллектуальных помощников и систем поддержки.

Параллельно мы занимаемся разработкой чат-ботов на Python, используя фреймворк Rasa. Rasa предоставляет полный набор инструментов для создания диалоговых ИИ, включая NLU (понимание естественного языка), управление диалогом и интеграцию с различными каналами. Мы научились создавать ботов, которые не просто отвечают по шаблону, но и понимают намерения пользователя, запоминают контекст диалога и могут выполнять сложные задачи.

Многоязычность и Редкие Языки

Мир не ограничивается английским языком, и мы часто сталкиваемся с необходимостью обработки многоязычных текстовых корпусов. Для языков с богатой морфологией, таких как русский, мы активно используем библиотеку Stanza (разработанную Stanford NLP Group), которая предоставляет высококачественные модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга. Она демонстрирует отличные результаты для русского языка, превосходя NLTK в некоторых аспектах.

Для работы с мультиязычностью и даже редкими языками мы применяем библиотеку Polyglot. Она позволяет нам выполнять такие задачи, как определение языка, токенизация, NER и анализ тональности для широкого спектра языков. Мы также экспериментируем с трансформерными моделями, специально обученными на многоязычных данных, что значительно упрощает обработку текста на разных языках в рамках одного проекта.

Вот краткий обзор применения трансформерных моделей:

- Генерация текста (GPT-подобные модели): создание связных статей, ответов, диалогов.

- Суммаризация (BART, T5): автоматическое сокращение длинных текстов, сохраняя основную суть.

- Машинный перевод (MarianMT, M2M100): перевод текста между языками с высокой точностью.

- QA-системы (BERT, RoBERTa): поиск точных ответов на вопросы в документах.

- Анализ тональности и эмоций: более глубокое понимание эмоционального контекста.

- NER и извлечение информации: точное извлечение сущностей и фактов.

- Анализ кода (CodeBERT): понимание и генерация программного кода.

NLP в Действии: От Бизнеса до Науки

Наш путь в NLP — это не только изучение теорий и алгоритмов, но и их применение для решения реальных задач. Мы видели, как NLP преобразует бизнес-процессы, помогает ученым анализировать огромные массивы данных и обогащает нашу повседневную жизнь. От извлечения ценной информации из веб-страниц до анализа поведенческих паттернов в чатах — возможности безграничны. Мы делимся нашими наблюдениями о том, как эти технологии воплощаются в жизнь.

Веб-Скрейпинг и Извлечение Информации (Beautiful Soup, Textacy)

Для многих проектов NLP требуется огромное количество текстовых данных, и часто эти данные находятся в интернете. Мы активно используем Beautiful Soup для веб-скрейпинга, позволяя нам извлекать текст с веб-страниц, очищать его от HTML-тегов и подготавливать для дальнейшего анализа. Это первый шаг к превращению хаотичного интернета в структурированный источник информации.

После извлечения текста нам часто нужно выделить из него самое важное. Для извлечения ключевых фраз мы используем алгоритмы типа RAKE (Rapid Automatic Keyword Extraction) и TextRank. TextRank также отлично подходит для извлечения ключевых предложений, что является основой для экстрактивной суммаризации текста. Библиотека Textacy предоставляет нам широкий набор инструментов для более сложного извлечения информации, включая синтаксический анализ зависимостей и извлечение N-грамм.

Анализ Больших Текстовых Массивов (Big Data NLP)

Работа с большими текстовыми массивами (Big Data NLP) ставит перед нами особые вызовы. Стандартные подходы могут быть слишком медленными или требовать слишком много памяти. Мы научились оптимизировать наши пайплайны, использовать распределенные вычисления и эффективно работать с библиотеками, такими как Gensim, которая хорошо масштабируется для тематического моделирования на больших данных. Обработка текста в режиме реального времени (Streaming NLP) также становится все более актуальной, например, для анализа потоков сообщений в социальных сетях.

Для анализа частотности слов и N-грамм в больших корпусах мы используем специализированные структуры данных и методы, которые позволяют эффективно подсчитывать и хранить эти показатели. Визуализация текстовых данных, например, с помощью облаков слов (Word Clouds) или тепловых карт (Heatmaps), помогает нам быстро получить представление о содержимом больших массивов.

Проблемы и Решения: Неполные Данные, Ошибки, Сленг

Реальные текстовые данные редко бывают идеальными. Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных, опечаток, использования сленга и эмодзи. Для исправления орфографии мы используем различные алгоритмы и словари. Для нормализации сленга и обработки эмодзи мы создаем собственные словари и правила, а также используем предобученные модели, которые учитывают эти особенности.

В работе с юридическими и медицинскими документами, где точность критически важна, мы применяем специализированные словари и правила, а также обучаем модели на размеченных данных. Разработка инструментов для проверки грамматики и синтаксиса, а также систем обнаружения плагиата, также является частью нашей практики. Для сравнения строк и поиска дубликатов мы используем библиотеку Textdistance, которая предлагает различные метрики сходства.

Вот таблица с общими вызовами в NLP и нашими подходами к их решению:

| Вызов | Описание | Наши Решения/Подходы | Используемые Инструменты |

|---|---|---|---|

| "Грязные" данные | Шум, HTML-теги, спецсимволы, опечатки. | Тщательная предобработка, нормализация. | `re`, NLTK, SpaCy. |

| Многоязычность | Обработка текстов на разных языках. | Использование мультиязычных моделей и библиотек. | Stanza, Polyglot, мультиязычные трансформеры. |

| Сленг и эмодзи | Неформальный язык, смайлики в социальных сетях. | Специальные словари, тонкая настройка моделей. | Пользовательские словари, трансформеры. |

| Неполные/ошибочные данные | Пропуски, грамматические ошибки, опечатки. | Алгоритмы исправления орфографии, эвристики. | Jellyfish (для сравнения строк), Textdistance. |

| Масштабируемость | Обработка очень больших объемов текста. | Оптимизация кода, распределенные вычисления. | Gensim, Dask, Spark. |

| Контекст | Понимание смысла слов в зависимости от окружения. | Использование контекстных эмбеддингов. | Word2Vec (частично), BERT, Sentence Transformers. |

Вот и подошло к концу наше путешествие по удивительному миру Обработки Естественного Языка с Python. Мы начали с самых основ — предобработки текста, которая является краеугольным камнем любого успешного проекта. Затем мы углубились в методы извлечения смысла, такие как векторизация и распознавание именованных сущностей, которые позволяют машинам "видеть" структуру и значения в человеческой речи. Мы исследовали, как тематическое моделирование и классификация помогают нам понять большие объемы информации, и как анализ тональности раскрывает скрытые эмоции.

Наконец, мы коснулись передовых технологий, таких как трансформеры от Hugging Face, которые кардинально изменили ландшафт NLP, открыв двери для создания систем, способных не только понимать, но и генерировать текст с поразительной связностью. Мы увидели, как эти технологии применяются в разработке QA-систем, чат-ботов и как они справляются с вызовами многоязычности и "грязных" данных. Наш опыт показывает, что Python, с его богатой экосистемой библиотек, является идеальным выбором для любого, кто хочет погрузиться в эту увлекательную область.

Будущее NLP обещает быть еще более захватывающим. Мы ожидаем дальнейшего развития генеративных моделей, способных создавать еще более креативные и контекстно-осмысленные тексты, а также улучшения в области мультимодального NLP, где текст будет анализироваться в сочетании с изображениями, видео и звуком. Этика и предвзятость в моделях ИИ также будут оставатся в центре внимания, требуя от нас постоянного совершенствования и ответственного подхода к разработке.

Мы надеемся, что наш рассказ вдохновил вас на собственные эксперименты и открытия в мире NLP. Помните, что каждый шаг, будь то изучение новой библиотеки или решение сложной задачи, приближает вас к пониманию того, как машины могут взаимодействовать с самым удивительным творением человечества — языком. Удачи вам в этом захватывающем пути!

Подробнее

| NLTK токенизация стемминг | SpaCy NER Python | Gensim тематическое моделирование | Scikit-learn классификация текстов | Word2Vec GloVe embeddings |

| Анализ тональности VADER | Трансформеры Hugging Face NLP | Разработка QA систем | Извлечение ключевых фраз | Предобработка текста регулярные выражения |