- Разгадывая Тайны Текста: Наш Увлекательный Путь в Мире NLP с Python

- Строим Фундамент: От Сырого Текста к Значимым Данным

- Токенизация: Разбиваем Текст на Атомы Смысла

- Стемминг и Лемматизация: Приводим Слова к Единому Знаменателю

- Как Машины "Видят" Слова: От Частот к Смыслу

- Простые, но Эффективные: CountVectorizer и TF-IDF

- Word Embeddings: Погружение в Смысл с Word2Vec и GloVe

- Находим Имена и Факты: Распознавание Именованных Сущностей (NER)

- Поиск Глубинных Смыслов: Тематическое Моделирование и Анализ Тональности

- Тематическое Моделирование: LDA и LSI с Gensim

- Анализ Тональности: От VADER до Глубокого Обучения

- Машинное Обучение и Глубокие Нейросети для Текста

- Классификация Текстов: Scikit-learn и Глубокие Сети

- Революция Трансформеров: Hugging Face для Всего

- NLP в Действии: От Анализа Отзывов до Чат-ботов

- Сбор и Извлечение: Веб-Скрейпинг и Ключевые Фразы

- Строим Умных Собеседников: Разработка Чат-ботов

- От Длинного к Краткому: Суммаризация Текста

- Преодолевая Языковые Барьеры: Мультиязычный NLP

- Наш Арсенал: Ключевые Библиотеки Python для NLP

- Наши Вызовы и Взгляд в Будущее NLP

Разгадывая Тайны Текста: Наш Увлекательный Путь в Мире NLP с Python

Приветствуем, дорогие читатели и коллеги-энтузиасты! В нашем современном мире мы ежедневно сталкиваемся с колоссальными объемами текстовой информации. От электронных писем и сообщений в социальных сетях до научных статей и юридических документов – текст повсюду. Ирония заключается в том, что для человека понимание и интерпретация этого текста часто является интуитивным процессом, но для машины это до недавнего времени было огромным вызовом. Именно здесь на сцену выходит Обработка Естественного Языка, или NLP (Natural Language Processing), и именно здесь мы, вооружившись мощью Python, начинаем наше захватывающее приключение.

Мы, как опытные блогеры и практикующие специалисты, не раз убеждались в том, что NLP, это не просто набор сложных алгоритмов, а целый мир возможностей, позволяющий компьютерам понимать, интерпретировать и даже генерировать человеческий язык. Это как дать машине уши и голос, а затем научить ее читать между строк. За последние годы мы видели невероятный прорыв в этой области, и Python стал де-факто стандартом для каждого, кто хочет погрузиться в этот мир. Сегодня мы хотим поделиться нашим опытом, проведя вас по основным этапам и инструментам, которые помогут вам освоить эту увлекательную дисциплину.

Строим Фундамент: От Сырого Текста к Значимым Данным

Прежде чем мы сможем заставить машину "понять" текст, нам необходимо его подготовить. Представьте, что вы хотите испечь пирог: сначала нужно подготовить ингредиенты – очистить, нарезать, взвесить. С текстом похожая история. Это этап, который часто недооценивают, но именно он закладывает основу для успешного анализа.

Токенизация: Разбиваем Текст на Атомы Смысла

Первый шаг в предобработке – это токенизация. Это процесс разбиения текста на более мелкие единицы, называемые токенами. Токенами могут быть слова, пунктуация, числа. Мы используем этот метод, чтобы превратить непрерывный поток символов в дискретные элементы, которые затем можно анализировать. Например, предложение "Мы любим NLP!" превратится в токены ["Мы", "любим", "NLP", "!"].

Для токенизации мы часто обращаемся к таким библиотекам, как NLTK (Natural Language Toolkit) и spaCy. NLTK предлагает широкий спектр токенизаторов, подходящих для различных языков и задач, включая токенизацию слов и предложений. SpaCy же славится своей скоростью и уже обученными моделями, что делает его отличным выбором для продакшн-систем.

Стемминг и Лемматизация: Приводим Слова к Единому Знаменателю

После токенизации мы сталкиваемся с проблемой: одно и то же слово может иметь разные формы (бегать, бегущий, бежал). Чтобы машина понимала, что это варианты одного и того же корня, мы применяем стемминг или лемматизацию. Стемминг – это грубый метод, который отсекает суффиксы и префиксы, приводя слово к его "корню" (например, "running", "runs", "ran" -> "run"). Он быстр, но иногда создает несуществующие слова.

Лемматизация, в свою очередь, более интеллектуальный процесс. Она использует морфологический анализ для приведения слова к его базовой словарной форме (лемме), которая всегда является реальным словом (например, "лучший" -> "хороший"). Для лемматизации текста мы часто используем spaCy или NLTK (WordNetLemmatizer). А для языков с богатой морфологией, таких как русский, библиотека Stanza предлагает более продвинутые и точные решения.

| Признак | Стемминг (NLTK PorterStemmer) | Лемматизация (spaCy) |

|---|---|---|

| Цель | Отсечение окончаний для получения "корня" слова. | Приведение слова к словарной форме (лемме). |

| Точность | Ниже, может создавать несуществующие слова. | Выше, всегда создает существующие слова. |

| Скорость | Выше, так как менее сложен. | Ниже, требует морфологического анализа. |

| Пример | "история", "истории", "исторический" -> "истори" | "история", "истории", "исторический" -> "история" |

| Использование | Для быстрого поиска, где точное слово не критично. | Для глубокого анализа текста, семантики. |

Как Машины "Видят" Слова: От Частот к Смыслу

Компьютеры не понимают слова в том виде, в каком их понимаем мы. Им нужны числа. Векторизация текста – это процесс преобразования текстовых данных в числовые векторы. Это критически важный шаг, который позволяет нам применять математические и статистические методы машинного обучения к тексту.

Простые, но Эффективные: CountVectorizer и TF-IDF

Начнем с классики. Модель "мешка слов" (Bag of Words) игнорирует порядок слов, фокусируясь только на их частотности; CountVectorizer из Scikit-learn просто подсчитывает, сколько раз каждое слово встречается в документе, создавая разреженную матрицу. Это отличная отправная точка, но она не учитывает важность слов.

Именно здесь на помощь приходит TF-IDF (Term Frequency-Inverse Document Frequency). Этот метод не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе документов (IDF). Таким образом, общие слова, такие как "и", "в", "на", получают низкий вес, а уникальные и информативные слова – высокий. Векторизация текста TF-IDF является мощным инструментом для классификации и кластеризации текстов, и мы часто используем его, когда нужно быстро получить сильные числовые представления.

Word Embeddings: Погружение в Смысл с Word2Vec и GloVe

Если TF-IDF все еще имеет дело с отдельными словами, не учитывая их семантические связи, то Word Embeddings (векторы слов) совершили революцию. Они представляют слова в виде плотных векторов в многомерном пространстве, где слова со схожим значением расположены близко друг к другу. Это позволяет улавливать семантические и синтаксические отношения между словами.

Мы активно используем Word2Vec и GloVe. Word2Vec, разработанный Google, предлагает два архитектурных подхода: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). Word Embeddings с Word2Vec стали стандартом для многих задач. GloVe (Global Vectors for Word Representation) от Стэнфордского университета, в свою очередь, объединяет глобальную статистику корпуса с локальными оконными методами. Для их реализации мы часто обращаемся к библиотеке Gensim, которая позволяет легко обучать свои модели или загружать предобученные.

Помимо отдельных слов, существуют методы для векторизации целых предложений и документов:

- Doc2Vec: Расширение Word2Vec, которое позволяет генерировать векторы для целых документов.

- Sentence Transformers: Библиотека, предоставляющая предобученные модели для создания семантически значимых векторов предложений.

- FastText: Разработанный Facebook AI, он расширяет Word2Vec, учитывая подслова (n-граммы символов), что особенно полезно для работы с редкими словами и морфологически богатыми языками.

Находим Имена и Факты: Распознавание Именованных Сущностей (NER)

Представьте, что вы читаете огромный текст и вам нужно быстро найти все имена людей, названия организаций, географические места или даты. Вот для чего существует NER (Named Entity Recognition). Это задача выделения и классификации именованных сущностей в тексте в заранее определенные категории.

Для нас spaCy является краеугольным камнем для распознавания именованных сущностей spaCy. Его предварительно обученные модели отличаются высокой скоростью и точностью, что делает его идеальным для быстрого прототипирования и продакшн-использования. Мы также часто используем библиотеку Flair, которая предлагает современные подходы к NER, основанные на рекуррентных нейронных сетях и контекстуальных встраиваниях, что часто дает еще более высокую точность, особенно на нестандартных данных.

"Язык – это дорожная карта культуры. Он говорит нам, откуда пришли его люди и куда они идут." – Рита Мэй Браун.

Эта цитата прекрасно отражает суть NLP – через язык мы пытаемся понять не только слова, но и стоящие за ними смыслы, намерения и культурные контексты; Мы стремимся научить машины читать эти "дорожные карты".

Поиск Глубинных Смыслов: Тематическое Моделирование и Анализ Тональности

Когда мы работаем с большими массивами текста, нам часто нужно понять, о чем в целом идет речь, какие скрытые темы присутствуют, или каково общее настроение авторов. Здесь нам на помощь приходят методы тематического моделирования и анализа тональности.

Тематическое Моделирование: LDA и LSI с Gensim

Тематическое моделирование – это способ обнаружения абстрактных "тем" в коллекции документов. Оно помогает нам понять основные идеи, пронизывающие большой объем текста, без предварительной разметки данных. Мы часто используем его для анализа отзывов клиентов, новостных статей или научных публикаций.

Для тематического моделирования LDA Gensim (Латентное Размещение Дирихле) и LSI (Латентное Семантическое Индексирование) являются нашими основными инструментами, реализованными в библиотеке Gensim. LDA предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема, в свою очередь, характеризуется распределением слов. LSI использует сингулярное разложение для уменьшения размерности, выявляя скрытые семантические связи. Мы также экспериментируем с NMF (Неотрицательная Матричная Факторизация), которая предлагает альтернативный подход и часто дает хорошие результаты, особенно при работе с разреженными данными.

Анализ Тональности: От VADER до Глубокого Обучения

Понять эмоциональную окраску текста – позитивную, негативную или нейтральную – это задача анализа тональности (Sentiment Analysis). Это критически важно для анализа отзывов клиентов, мониторинга социальных сетей или оценки реакции на продукт.

Для быстрого и эффективного анализа тональности мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner). VADER специально обучен на текстах из социальных сетей и хорошо справляется с эмодзи, сленгом и восклицательными знаками, что делает его отличным выбором для анализа тональности сообщений в социальных сетях. Для более простых случаев и быстрой оценки мы также обращаемся к TextBlob, которая предоставляет интуитивно понятный API для определения тональности и субъективности текста. Анализ тональности VADER дает нам быстрые инсайты, но для глубокого понимания контекста и улавливания сарказма или иронии, мы переходим к моделям на основе глубокого обучения.

Машинное Обучение и Глубокие Нейросети для Текста

После того как текст подготовлен и векторизован, мы можем применить к нему мощные алгоритмы машинного обучения для решения самых разнообразных задач – от классификации до генерации.

Классификация Текстов: Scikit-learn и Глубокие Сети

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Это может быть спам-фильтр, категоризация новостных статей или определение языка текста. Для нас Scikit-learn является основной библиотекой для реализации классических алгоритмов машинного обучения, таких как SVM (Метод опорных векторов), Наивный Байесовский классификатор, Логистическая регрессия. Мы часто используем его, когда у нас есть хорошо размеченные данные и мы хотим быстро построить надежную модель.

Однако, когда задачи становятся более сложными, а объемы данных – большими, мы переходим к глубокому обучению. PyTorch и TensorFlow – это наши основные фреймворки для создания нейронных сетей, способных улавливать более сложные паттерны в текстовых данных. Мы используем LSTM (Долгая краткосрочная память) для последовательной обработки текста и, конечно же, трансформеры.

Революция Трансформеров: Hugging Face для Всего

Ни один разговор о современном NLP не обходится без упоминания трансформеров. Эти архитектуры, появившиеся с моделью "Attention Is All You Need", полностью изменили ландшафт NLP. Они позволяют моделям обрабатывать слова в контексте всего предложения, улавливая сложные зависимости, которые были недоступны предыдущим архитектурам.

Библиотека Hugging Face Transformers стала для нас незаменимым инструментом. Она предоставляет доступ к сотням предобученных моделей, таких как BERT, GPT, T5, RoBERTa и многим другим. Мы используем трансформеры Hugging Face для широкого спектра задач: от классификации текста и NER до суммаризации и генерации текста. Возможность тонкой настройки (fine-tuning) этих моделей на наших собственных данных позволяет нам достигать состояния искусства в самых разных предметных областях.

NLP в Действии: От Анализа Отзывов до Чат-ботов

Теория – это хорошо, но настоящий азарт начинается, когда мы применяем эти знания для решения реальных проблем. Наш опыт показывает, что NLP можно использовать практически везде, где есть текст.

Сбор и Извлечение: Веб-Скрейпинг и Ключевые Фразы

Прежде чем анализировать текст, его нужно откуда-то взять. Часто это означает сбор данных с веб-сайтов. Библиотека Beautiful Soup является нашим надежным спутником для веб-скрейпинга, позволяя нам извлекать текстовый контент из HTML-страниц. После того как текст собран, мы приступаем к извлечению ключевых фраз и предложений. Для этого мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) для быстрого извлечения ключевых слов или TextRank для выявления наиболее важных предложений в тексте, что является основой для экстрактивной суммаризации.

Строим Умных Собеседников: Разработка Чат-ботов

Чат-боты стали неотъемлемой частью современного клиентского сервиса и взаимодействия. Их разработка – это комплексная задача, включающая понимание намерений пользователя, извлечение сущностей и генерацию осмысленных ответов. Мы активно работаем с фреймворком Rasa, который предоставляет полный стек для создания контекстных чат-ботов. С его помощью мы можем разрабатывать ботов, способных не просто отвечать на вопросы, но и вести диалог, помнить предыдущие реплики и даже выполнять действия. Разработка чат-ботов Rasa позволяет нам создавать очень гибкие и мощные системы.

От Длинного к Краткому: Суммаризация Текста

В мире информационного перегруза способность быстро получать суть длинного документа бесценна. Суммаризация текста делится на два основных типа:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их. Это как выделить ключевые моменты маркером. Мы используем TextRank или другие статистические методы для этого.

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают смысл оригинала, но не обязательно присутствуют в нем. Это более сложная задача, часто требующая использования трансформерных моделей (например, T5, BART) для генерации связного и грамматически правильного текста.

Обе задачи – это активная область наших исследований и разработок, поскольку они напрямую помогают повысить эффективность работы с информацией.

Преодолевая Языковые Барьеры: Мультиязычный NLP

В глобальном мире нам часто приходится работать с текстами на разных языках. Обработка многоязычных текстовых корпусов представляет свои уникальные вызовы, связанные с морфологией, синтаксисом и семантикой каждого языка. Мы используем библиотеки Polyglot и Stanza (разработанную Stanford NLP Group) для работы с языками, отличными от английского, особенно для тех, что имеют богатую морфологию, таких как русский, немецкий или арабский. Stanza, в частности, предоставляет полный пайплайн NLP для многих языков, включая токенизацию, POS-теггинг, лемматизацию и синтаксический парсинг;

Наш Арсенал: Ключевые Библиотеки Python для NLP

Наш путь в NLP был бы невозможен без богатой экосистемы Python-библиотек. Каждая из них занимает свое место в нашем инструментарии.

| Библиотека | Основные Функции | Наши Примеры Использования | Особенности |

|---|---|---|---|

| NLTK | Токенизация, стемминг, лемматизация, POS-теггинг, грамматики. | Основы токенизации, морфологический анализ, образовательные проекты. | Старейшая и самая полная библиотека, отлична для исследований и обучения. |

| spaCy | Токенизация, NER, синтаксический парсинг, Word Embeddings, лемматизация. | Быстрый NER, анализ зависимостей, предобработка текста в продакшн. | Высокая производительность, предобученные модели, удобный API. |

| Gensim | Тематическое моделирование (LDA, LSI), Word2Vec, Doc2Vec. | Анализ скрытых тем в отзывах, создание пользовательских Word Embeddings. | Оптимизирован для больших корпусов, фокусировка на неконтролируемом обучении. |

| Scikit-learn | Векторизаторы (CountVectorizer, TF-IDF), классификаторы (SVM, Naive Bayes). | Классификация текстов по категориям, кластеризация документов. | Стандарт для машинного обучения, прост в использовании, хорошо документирован. |

| Hugging Face Transformers | Доступ к моделям-трансформерам (BERT, GPT, T5), Fine-tuning. | Генерация текста, продвинутый NER, суммаризация, вопросно-ответные системы. | Состояние искусства в NLP, огромная коллекция предобученных моделей. |

| TextBlob | Анализ тональности, POS-теггинг, извлечение фраз, перевод. | Быстрый анализ тональности, прототипирование простых NLP-задач. | Простота использования, подходит для начинающих и простых задач. |

| Beautiful Soup | Парсинг HTML/XML, извлечение данных с веб-страниц. | Веб-скрейпинг текстовых данных для дальнейшего анализа. | Легкий в освоении, мощный для извлечения структурированных данных. |

Наши Вызовы и Взгляд в Будущее NLP

Мир NLP динамичен, и мы постоянно сталкиваемся с новыми вызовами и видим захватывающие перспективы. Работа с реальными данными всегда связана с трудностями: неполные и ошибочные данные, сленг, сарказм, многоязычность. Мы постоянно ищем способы улучшить качество предобработки, используя продвинутые методы очистки текста от HTML-тегов, нормализации сленга и работы с эмодзи. Разработка инструментов для проверки грамматики и исправления орфографии также является важным направлением, поскольку чистота данных напрямую влияет на качество моделей.

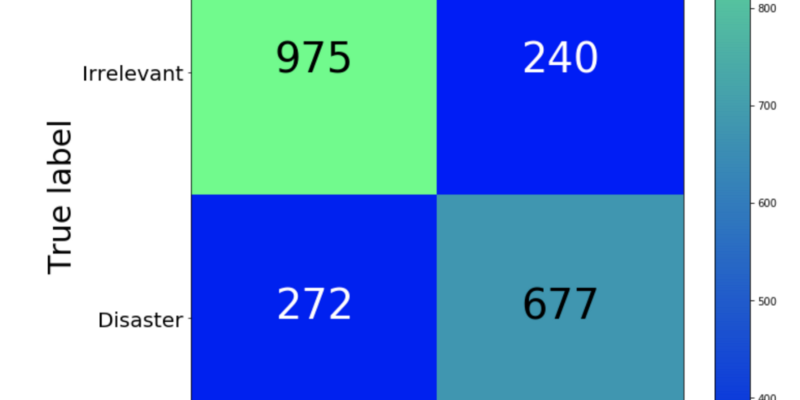

Оценка качества наших моделей – это еще один критический аспект. Мы тщательно отслеживаем метрики, такие как F1-score, Precision и Recall, чтобы убедиться, что наши решения действительно эффективны. Тонкая настройка предобученных моделей (Fine-tuning) на специфических доменах данных позволяет нам значительно повысить их производительность для конкретных задач, будь то анализ финансовых новостей или юридических документов.

Векторизация предложений и документов с учетом контекста, использование трансформерных архитектур для распознавания эмоций, разработка систем для автоматического перевода узкоспециализированных текстов – это лишь малая часть того, над чем мы активно работаем. Будущее NLP кажется безграничным, с потенциалом для создания еще более умных чат-ботов, систем вопросно-ответных систем, автоматической суммаризации и даже генерации сложного, связного текста. Мы видим огромный потенциал в развитии систем обнаружения плагиата, анализа стилистики текстов и даже создания инструментов для автоматической разметки данных, что значительно упростит процесс обучения новых моделей.

Мы уверены, что Python останется краеугольным камнем в этом развитии, предоставляя нам гибкость, мощь и доступ к огромному сообществу разработчиков и исследователей. Наш путь в мире NLP – это постоянное обучение, эксперименты и стремление к тому, чтобы машины не просто обрабатывали слова, но и по-настоящему понимали их смысл, помогая нам ориентироваться в бескрайнем океане информации.

Присоединяйтесь к нам в этом увлекательном путешествии, и вместе мы продолжим разгадывать тайны текста, открывая новые горизонты возможностей. точка..

Подробнее

| Основы токенизации NLTK | Распознавание именованных сущностей spaCy | Тематическое моделирование LDA Gensim | Анализ тональности VADER | Word Embeddings с Word2Vec |

| Векторизация текста TF-IDF | Трансформеры Hugging Face | Лемматизация текста Python | Разработка чат-ботов Rasa | Извлечение ключевых фраз TextRank |