- Разгадывая Тайны Текста: Наше Путешествие в Мир NLP на Python

- Первые Шаги: От Сырого Текста к Понятным Блокам

- Токенизация и Стемминг/Лемматизация: Разбираем Слова по Косточкам

- Регулярные Выражения (re) и Очистка Текста: Устраняем Шум

- Как Машины "Читают": Текстовое Представление

- Векторизаторы: От Слов к Числам

- Word Embeddings: Смысл в Векторах

- Контекстуальные Встраивания (Transformers): Революция в Понимании

- Практические Задачи NLP: От Смысла к Действию

- Распознавание Именованных Сущностей (NER): Выделяем Главное

- Тематическое Моделирование: Находим Скрытые Темы

- Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

- Классификация Текстов: Автоматическая Сортировка

- Суммаризация Текста: Из Большого в Малое

- Продвинутые Техники и Инструменты: Заглядывая в Будущее

- Трансформеры и Глубокое Обучение: Новая Эра

- Многоязычная Обработка: Стираем Языковые Барьеры

- Специализированные Инструменты и Сценарии

- Измерение Успеха и Будущие Направления

- Непрерывное Развитие: Что Дальше?

- Полезные Запросы для Погружения в NLP

Разгадывая Тайны Текста: Наше Путешествие в Мир NLP на Python

Привет, дорогие читатели и коллеги по цеху! Мы — команда энтузиастов, увлеченных миром данных, и сегодня мы хотим поделиться с вами нашим глубоким погружением в одну из самых захватывающих областей искусственного интеллекта – обработку естественного языка, или NLP (Natural Language Processing). За последние годы мы прошли путь от новичков, робко осваивающих первые шаги в Python, до создания сложных систем, способных понимать, анализировать и даже генерировать текст. Этот путь был полон открытий, вызовов и, конечно же, невероятного удовольствия от того, как код оживает и начинает "читать" между строк.

Мир вокруг нас пронизан текстом: социальные сети, электронные письма, статьи, книги, отзывы, юридические документы, логи систем. Представьте, сколько информации скрыто в этих терабайтах символов! Именно NLP позволяет нам извлекать эту информацию, находить скрытые смыслы, автоматизировать рутину и создавать совершенно новые, интеллектуальные продукты. Мы убеждены, что каждый, кто работает с данными, должен хотя бы поверхностно ознакомиться с основами NLP, ведь это открывает двери к безграничным возможностям.

В этой статье мы хотим провести вас по основным этапам работы с текстом на Python, поделиться нашими любимыми инструментами и подходами. Это будет не просто сухой технический обзор, а скорее рассказ о том, как мы применяли эти знания на практике, какие задачи решали и какие выводы сделали. Пристегните ремни, наше путешествие в глубины текстового анализа начинается!

Первые Шаги: От Сырого Текста к Понятным Блокам

Прежде чем компьютер сможет "понять" человеческий язык, текст необходимо подготовить. Это похоже на то, как мы, люди, сначала слушаем слова, а потом уже начинаем осмысливать предложение. Для машин этот процесс гораздо более структурирован и требует целого ряда предобработки.

Токенизация и Стемминг/Лемматизация: Разбираем Слова по Косточкам

Наше первое знакомство с предобработкой текста началось с токенизации. Это процесс разбиения текста на отдельные единицы, называемые токенами. Чаще всего токенами являются слова или знаки препинания. Мы помним, как были впечатлены простотой и мощью библиотеки NLTK (Natural Language Toolkit) для этой задачи. Один вызов функции, и вот уже длинный параграф превращается в аккуратный список слов.

Но просто разбить текст на слова недостаточно. Если мы хотим, чтобы "бегать", "бежал", "бегущий" рассматривались как одна и та же лексическая единица "бег", нам нужны стемминг или лемматизация. Стемминг — это более грубый процесс, отсекающий окончания слов (например, "running" -> "run"). Лемматизация же более умна: она приводит слово к его базовой словарной форме (лемме), учитывая морфологию (например, "лучшие" -> "хороший"). Мы часто использовали лемматизацию с NLTK и spaCy, особенно когда точность была критически важна, например, при анализе юридических документов, где каждое слово имеет вес.

Наш опыт показал, что для русского языка spaCy часто даёт более качественные результаты лемматизации по сравнению с базовыми стеммерами NLTK, особенно если использовать предобученные модели. Это стало для нас важным уроком: выбор инструмента часто зависит от специфики языка и требований к точности;

Регулярные Выражения (re) и Очистка Текста: Устраняем Шум

Текстовые данные редко бывают идеально чистыми. HTML-теги, случайные символы, множественные пробелы, ссылки, эмодзи, сленг — всё это "шум", который может помешать нашим моделям. Здесь на сцену выходят регулярные выражения (re). Мы часами оттачивали мастерство их использования, создавая паттерны для удаления всего лишнего. Это немного похоже на разгадывание головоломок, но когда ваш регулярное выражение наконец-то идеально очищает текст, это приносит настоящее удовлетворение.

Например, для очистки текста от HTML-тегов мы использовали такой подход:

import re

text_with_html = "<p>Это <b>очень</b> важный текст.</p><a href='#'>Ссылка</a>"

cleaned_text = re.sub(r'<.*?>', '', text_with_html)

Кроме того, мы разрабатывали инструменты для нормализации сленга, работы с эмодзи, удаления стоп-слов (артиклей, предлогов, союзов, которые не несут смысловой нагрузки) и пунктуации. Это крайне важный этап, поскольку качество предобработки напрямую влияет на результат всех последующих анализов. Мы поняли, что даже небольшие ошибки здесь могут привести к совершенно неверным выводам в дальнейшем.

Как Машины "Читают": Текстовое Представление

После того как текст очищен и разбит на токены, нам нужно преобразовать его в числовой формат, который могут обрабатывать алгоритмы машинного обучения. Это один из самых фундаментальных и креативных аспектов NLP.

Векторизаторы: От Слов к Числам

Наш путь в мир числового представления текста начался с классических векторизаторов. Мы активно использовали CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту вхождения каждого слова в документе, создавая вектор. TfidfVectorizer идёт дальше, учитывая не только частоту слова в документе, но и его редкость во всём корпусе текстов. Это помогает выделить слова, которые действительно важны для конкретного документа, а не просто часто встречаются везде.

Вот пример, который мы часто использовали для демонстрации:

| Метод векторизации | Принцип работы | Когда применять |

|---|---|---|

| CountVectorizer | Подсчет частоты слов | Для простых задач, когда важна абсолютная частота |

| TfidfVectorizer | Взвешенная частота слов с учетом их редкости | Для большинства задач классификации и поиска, где важна значимость слова |

Мы также экспериментировали с разработкой собственных векторизаторов, что позволило нам глубже понять их внутреннюю механику и адаптировать под специфические задачи, например, с учетом морфологических особенностей или предметной области.

Word Embeddings: Смысл в Векторах

Классические векторизаторы не учитывают семантическую близость слов. То есть, "король" и "королева" для них так же далеки, как "король" и "бутылка". И тут на помощь приходят Word Embeddings – векторные представления слов, которые улавливают их семантические отношения. Мы были поражены, когда впервые увидели, как Word2Vec и GloVe, реализованные в библиотеке Gensim, могут представить слова в многомерном пространстве таким образом, что похожие по смыслу слова оказываются близко друг к другу. Это открыло нам совершенно новые горизонты для анализа текста.

Мы использовали Word2Vec для анализа текстов отзывов клиентов, чтобы понять, какие слова часто встречаются рядом и формируют определенные ассоциации. А Doc2Vec позволил нам расширить эту концепцию на целые документы, представляя их в виде векторов, что было крайне полезно для поиска схожих статей или кластеризации.

Контекстуальные Встраивания (Transformers): Революция в Понимании

Если Word Embeddings стали прорывом, то появление трансформерных моделей (BERT, GPT, T5 и др.) и их контекстуальных встраиваний стало настоящей революцией. Эти модели не просто присваивают каждому слову один вектор, а генерируют векторное представление слова, учитывая его контекст в предложении. Это значит, что слово "банк" будет иметь разные векторы в предложениях "я иду в банк" и "берег реки был крутой, как банк".

Мы глубоко погрузились в работу с библиотекой Hugging Face Transformers, которая сделала эти мощные модели доступными для широкого круга разработчиков. Тонкая настройка (fine-tuning) предварительно обученных моделей под наши специфические задачи, будь то классификация или распознавание сущностей, дала нам беспрецедентные результаты. Это был момент, когда мы почувствовали, что машины действительно начинают "понимать" нюансы человеческого языка.

Практические Задачи NLP: От Смысла к Действию

Теперь, когда мы умеем подготавливать текст и преобразовывать его в числа, давайте посмотрим, какие реальные задачи мы можем решать с помощью NLP. Это то, где магия начинает проявляться в полную силу.

Распознавание Именованных Сущностей (NER): Выделяем Главное

Одной из первых задач, которая по-настоящему увлекла нас, было Распознавание Именованных Сущностей (NER). Это процесс автоматического выделения из текста именованных сущностей, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т.д.. Представьте, как это полезно для анализа новостных статей, медицинских записей или юридических документов!

Мы активно использовали spaCy для быстрого и достаточно точного NER, особенно для английского языка. Для более сложных задач или языков с богатой морфологией, таких как русский, мы обращались к библиотеке Flair, которая показала отличные результаты, а также к моделям на основе CRF (Conditional Random Fields) для задач, где требовалось больше контроля над признаками. Оценка качества NER-моделей (F1-score, Precision, Recall) стала для нас рутиной, позволяющей постоянно улучшать наши системы.

Тематическое Моделирование: Находим Скрытые Темы

Как понять, о чем говорят тысячи или миллионы документов, не читая каждый из них? Здесь на помощь приходит тематическое моделирование. Мы применяли алгоритмы LDA (Латентное размещение Дирихле) и LSI (Латентное семантическое индексирование) из библиотеки Gensim для анализа больших корпусов текстов, например, отзывов клиентов или научных статей. Это позволяло нам автоматически выявлять скрытые темы и тренды, что было невероятно ценно для бизнеса.

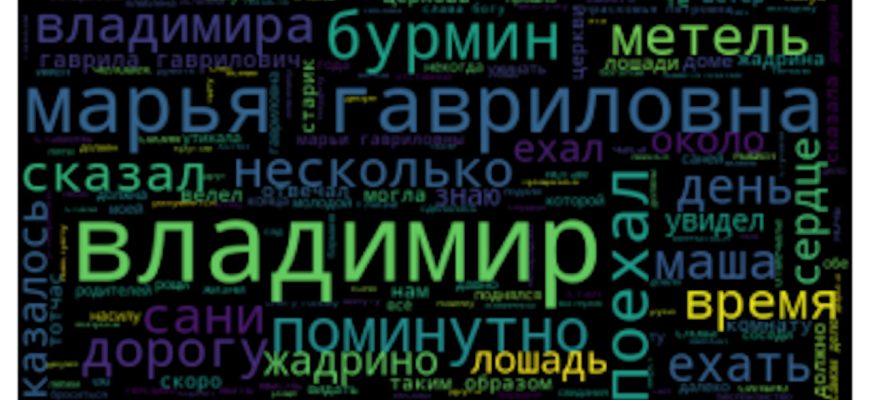

Сравнение моделей тематического моделирования, таких как LDA и NMF, показало нам, что выбор оптимального подхода часто зависит от структуры данных и желаемого уровня детализации. Мы также использовали инструменты для визуализации текстовых данных, такие как Word Clouds, чтобы наглядно представить выявленные темы и ключевые слова.

"Я не боюсь компьютеров. Я боюсь их отсутствия."

— Айзек Азимов

Эта цитата Азимова всегда напоминает нам о том, насколько технологии стали неотъемлемой частью нашей жизни, и как важно уметь их использовать для решения сложных задач, таких как понимание человеческого языка.

Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

Понять эмоциональную окраску текста, положительную, отрицательную или нейтральную — это бесценно для бизнеса, который хочет знать, что клиенты думают о его продуктах или услугах. Мы активно занимались анализом тональности (Sentiment Analysis). Начинали с простых правил и словарей, затем перешли к таким инструментам, как VADER для английского языка, который очень хорошо справляется с текстами из социальных сетей.

Для более сложных случаев, особенно с русским языком и учетом сарказма или сленга, мы использовали модели машинного обучения (SVM, наивный байесовский классификатор) и даже глубокие нейронные сети на PyTorch/TensorFlow. Анализ тональности сообщений в социальных сетях (Twitter/Reddit) или отзывов о фильмах и продуктах стал для нас рутиной, позволяющей выявлять настроения и быстро реагировать на изменения.

Классификация Текстов: Автоматическая Сортировка

Представьте, что вам нужно автоматически распределить тысячи статей по категориям, отфильтровать спам или определить тематику новостей. Классификация текстов — это именно то, что нужно. Мы использовали Scikit-learn для обучения моделей на основе различных методов машинного обучения, таких как SVM, логистическая регрессия или наивный байесовский классификатор. Для более сложных задач и больших объемов данных мы переходили к использованию PyTorch/TensorFlow для создания нейросетей, включая LSTM-сети.

Мы работали над системами автоматической категоризации статей, новостей, а также над анализом финансовых новостей для выявления потенциальных рисков или возможностей. Это был один из самых "прикладных" аспектов нашей работы, где мы видели непосредственную пользу от наших усилий.

Суммаризация Текста: Из Большого в Малое

В мире перегрузки информацией способность быстро получить суть длинного документа бесценна. Суммаризация текста бывает двух видов: экстрактивная (извлечение наиболее важных предложений из оригинального текста) и абстрактивная (генерация нового, краткого текста, который передает основной смысл). Мы начинали с экстрактивной суммаризации, используя алгоритмы вроде TextRank для извлечения ключевых предложений.

С появлением трансформерных моделей, таких как BART или T5, мы смогли реализовать абстрактивную суммаризацию, которая создает более связные и естественные резюме. Это было особенно полезно при работе с длинными отчетами или новостными лентами, позволяя нам быстро уловить главное.

Продвинутые Техники и Инструменты: Заглядывая в Будущее

Мир NLP развивается стремительными темпами. То, что вчера казалось фантастикой, сегодня становится стандартом. Мы постоянно учимся и осваиваем новые подходы.

Трансформеры и Глубокое Обучение: Новая Эра

Как мы уже упоминали, трансформерные архитектуры изменили все. Мы активно используем их не только для контекстуальных встраиваний, но и для генерации текста (например, с GPT-подобными моделями), машинного перевода, генерации диалогов и даже для анализа кода. Возможности этих моделей поражают воображение, и мы постоянно ищем новые способы их применения.

Разработка систем вопросно-ответных систем (QA) и чат-ботов на Python с использованием фреймворков типа Rasa стала гораздо более эффективной благодаря трансформерам. Мы видим, как они помогают создавать более "умных" и адаптивных ботов, способных вести осмысленные диалоги.

Многоязычная Обработка: Стираем Языковые Барьеры

В современном мире тексты часто встречаются на разных языках. Нам приходилось работать с многоязычными текстовыми корпусами, и здесь неоценимую помощь оказывали библиотеки вроде Polyglot и Stanza, особенно для языков с богатой морфологией, как русский или арабский. Stanza, разработанная в Стэнфорде, предоставляет мощные инструменты для токенизации, POS-теггинга, лемматизации и синтаксического парсинга для множества языков.

Мы также занимались разработкой систем машинного перевода на Python, используя как классические методы, так и современные трансформерные модели. Это позволяет нам не только переводить тексты, но и проводить кросс-языковой анализ тональности или тематики.

Специализированные Инструменты и Сценарии

Наш опыт включает и работу с более специфическими задачами:

- Веб-скрейпинг текста: С помощью Beautiful Soup мы извлекали текстовые данные с веб-сайтов для последующего анализа.

- Извлечение текста из PDF: Библиотека PyMuPDF стала нашим незаменимым помощником, когда нужно было работать с неструктурированными данными в PDF-файлах.

- Анализ стилистики текстов: Мы даже пытались определить авторский почерк и выявлять плагиат, используя метрики лексического богатства и сравнения строк с Jellyfish.

- Работа с неполными и ошибочными данными: Это постоянный вызов в NLP. Мы разрабатывали инструменты для проверки грамматики и исправления орфографии, чтобы повысить качество входных данных.

- Анализ юридических документов и лог-файлов: Здесь требуются специализированные подходы к извлечению информации, дат, чисел и связей между сущностями.

Каждая из этих задач требовала уникального подхода и комбинации различных инструментов и техник, что делало наше путешествие по миру NLP таким захватывающим.

Измерение Успеха и Будущие Направления

Любой проект в области машинного обучения немыслим без оценки его эффективности. Мы всегда уделяли особое внимание метрикам, чтобы понимать, насколько хорошо работают наши модели и что можно улучшить.

Мы использовали стандартные метрики, такие как Precision, Recall, F1-score для задач классификации и NER, чтобы объективно оценивать производительность наших моделей. Сравнение различных методов машинного обучения для NLP, будь то SVM против наивного байесовского классификатора или LDA против NMF, всегда основывалось на строгих метриках и кросс-валидации.

Для лучшего понимания данных и результатов мы активно применяли инструменты для визуализации текстовых данных: от простых Word Clouds, показывающих частотность слов, до тепловых карт для анализа корреляций. Библиотека Sweetviz также оказалась полезной для быстрого EDA (Exploratory Data Analysis) текстовых данных.

Непрерывное Развитие: Что Дальше?

Мир NLP не стоит на месте. Мы постоянно следим за новейшими исследованиями и технологиями. Работа с большими текстовыми массивами (Big Data NLP), использование GPU-ускорения для обработки текста, развитие систем обнаружения плагиата с использованием Doc2Vec, анализ временных рядов в текстовых данных для выявления сезонности, разработка моделей для выявления связей между сущностями — все это направления, в которых мы продолжаем развиваться.

Мы также активно экспериментируем с Graph Embeddings для анализа взаимосвязей в тексте и разрабатываем инструменты для автоматической разметки данных, что является одним из самых трудоемких этапов в создании высококачественных NLP-моделей.

Наше путешествие в мир обработки естественного языка на Python было и остается невероятно увлекательным. От простых задач токенизации до создания сложных трансформерных моделей, способных понимать и генерировать человеческий текст, мы прошли долгий путь. Мы увидели, как Python-библиотеки, такие как NLTK, spaCy, Gensim, Scikit-learn и Hugging Face, демократизировали доступ к мощным NLP-инструментам, позволив нам, энтузиастам, решать реальные мировые проблемы.

Мы верим, что NLP — это не просто набор алгоритмов, а мост между миром людей и миром машин, позволяющий нам лучше понимать друг друга и эффективнее работать с огромными объемами информации. Если вы только начинаете свой путь в этой области, не бойтесь экспериментировать, задавать вопросы и, конечно же, писать код. Возможности безграничны, и мы с нетерпением ждем, какие новые горизонты откроет для нас следующее поколение NLP-технологий. До новых встреч на страницах нашего блога!

Полезные Запросы для Погружения в NLP

Подробнее

| Python NLP библиотеки | Машинное обучение текста | Анализ естественного языка | Токенизация и лемматизация | Распознавание именованных сущностей |

| Тематическое моделирование LDA | Векторизация слов Word2Vec | Анализ тональности Python | Трансформеры Hugging Face | Создание чат-ботов на Python |