- Разговор с Машинами: Как Мы Открываем Тайны Текста с Помощью Python и NLP

- Предобработка Текста: Первый Шаг к Пониманию

- Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

- Очистка Текста: Избавляемся от Шума

- Векторизация Текста: Превращаем Слова в Числа

- Классические Методы: CountVectorizer и TF-IDF

- Word Embeddings: Погружение в Смысл

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Контекстное Встраивание: Эра Трансформеров

- Основные Задачи NLP и Инструменты

- Распознавание Именованных Сущностей (NER): Ищем Смысловые Блоки

- Тематическое Моделирование: Открываем Скрытые Темы

- Анализ Тональности: Понимаем Эмоции

- Классификация Текстов: Сортируем и Категоризируем

- Суммаризация Текста: Сжимаем Информацию

- Вопросно-ответные Системы (QA) и Генерация Текста

- Продвинутые Темы и Применение

- Многоязычный NLP: Преодолеваем Языковые Барьеры

- Работа с Различными Источниками Данных

- Визуализация Текстовых Данных

- Особые Вызовы и Решения

- Наши Рекомендации и Будущее NLP

Разговор с Машинами: Как Мы Открываем Тайны Текста с Помощью Python и NLP

Добро пожаловать, дорогие читатели, в увлекательный мир, где машины начинают понимать наш человеческий язык! Мы, как опытные путешественники по просторам данных, можем с уверенностью сказать: текст — это один из самых богатых и в то же время самых сложных источников информации. Он полон нюансов, эмоций, скрытых смыслов и бесчисленных паттернов, которые человеческий мозг улавливает интуитивно, но для компьютера остаются терра инкогнита. Именно здесь на сцену выходит Обработка Естественного Языка, или NLP (Natural Language Processing), и наш верный спутник — Python.

За последние несколько лет мы стали свидетелями невероятного прорыва в области NLP. То, что раньше казалось научной фантастикой — машины, способные отвечать на вопросы, переводить языки, генерировать осмысленный текст и даже улавливать тончайшие оттенки человеческих эмоций, — сегодня стало реальностью, доступной каждому, кто готов погрузиться в мир кода. Наша цель в этой статье — не просто рассказать о технических терминах, но провести вас по этому захватывающему пути, показать, как мы сами применяем эти инструменты в своей работе, и вдохновить вас на собственные открытия. Приготовьтесь, нас ждет глубокое погружение в арсенал современного NLP, где каждый инструмент — это ключ к новому пониманию.

Предобработка Текста: Первый Шаг к Пониманию

Прежде чем мы сможем извлечь ценные инсайты из текстовых данных, нам необходимо подготовить их. Представьте, что вы собираетесь приготовить изысканное блюдо: сначала нужно очистить, нарезать и подготовить ингредиенты. В мире NLP этот процесс называется предобработкой, и он является одним из самых критически важных этапов. От качества предобработки зависит успех всех последующих шагов, будь то классификация, анализ тональности или тематическое моделирование. Мы всегда уделяем этому этапу особое внимание, ведь "мусор на входе — мусор на выходе" — это золотое правило работы с данными.

Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

Начнем с самого фундаментального: токенизация. Это процесс разделения текста на отдельные смысловые единицы, называемые токенами. Чаще всего токенами являются слова, но это могут быть и пунктуационные знаки, цифры или даже подслова. Представьте предложение "Мы любим NLP!". Токенизатор разобьет его на ["Мы", "любим", "NLP", "!"]. Для этого мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает множество готовых токенизаторов, например, `word_tokenize` для слов или `sent_tokenize` для предложений.

Однако, просто разбить текст на слова недостаточно. Слова могут иметь разные формы: "бежать", "бежит", "бежал". Для машины это три разных слова, хотя смысл у них один. Здесь нам на помощь приходят стемминг и лемматизация.

Стемминг, это процесс сокращения слова до его корневой формы (стема), часто путем отсечения окончаний. Например, "бежать", "бежит", "бежал" могут быть сокращены до "беж". Стеммеры, такие как PorterStemmer или SnowballStemmer в NLTK, работают по набору эвристических правил и не всегда дают лингвистически корректные слова.

Лемматизация же более сложный и точный процесс. Она приводит слово к его базовой словарной форме (лемме), используя морфологический анализ и словарь. Так, "бежать", "бежит", "бежал" все будут приведены к "бежать". Для лемматизации мы часто обращаемся к spaCy, которая обеспечивает высокую производительность и точность, особенно для русского языка, где морфология довольно сложна.

Мы часто сравниваем эти методы:

| Характеристика | Стемминг | Лемматизация |

|---|---|---|

| Подход | Эвристические правила, отсечение окончаний | Морфологический анализ, использование словаря |

| Результат | Стем (может не быть реальным словом) | Лемма (базовая словарная форма) |

| Точность | Ниже, возможны ошибки | Выше, лингвистически корректна |

| Скорость | Выше | Ниже (требует больше ресурсов) |

| Примеры библиотек | NLTK (PorterStemmer, SnowballStemmer) | NLTK (WordNetLemmatizer), spaCy, Stanza |

Очистка Текста: Избавляемся от Шума

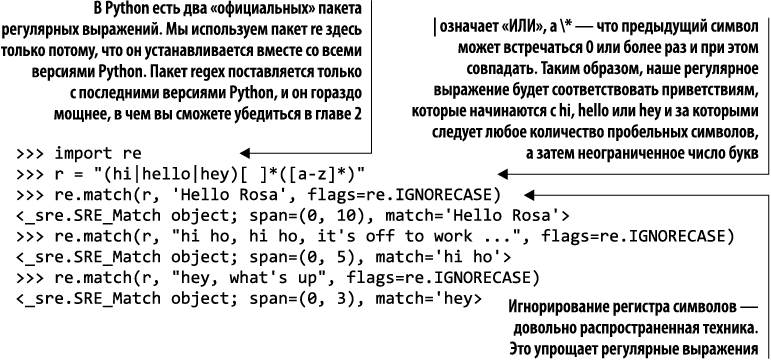

После токенизации и нормализации форм слов, мы приступаем к очистке от "шума". Это включает в себя удаление стоп-слов (артиклей, предлогов, союзов, которые не несут основной смысловой нагрузки, например, "и", "в", "на"), пунктуации, чисел, а также специальных символов и HTML-тегов, если текст был получен, например, путем веб-скрейпинга. Для этого мы активно используем регулярные выражения (библиотека `re` в Python). Они позволяют нам гибко определять паттерны, которые нужно найти и удалить или заменить.

Мы также сталкиваемся с необходимостью обрабатывать неполные и ошибочные данные, которые часто встречаются в реальных текстовых корпусах. Это могут быть опечатки, сокращения, специфический сленг или даже эмодзи. Для нормализации сленга или работы с эмодзи мы разрабатываем собственные инструменты или используем специализированные библиотеки. Например, для сравнения строк и выявления похожих, но неидентичных слов, нам помогает библиотека Jellyfish.

Векторизация Текста: Превращаем Слова в Числа

Компьютеры понимают только числа. Чтобы они могли работать с текстом, мы должны преобразовать слова и предложения в числовые векторы. Этот процесс, называемый векторизацией, является краеугольным камнем современного NLP. Мы постоянно ищем наиболее эффективные способы представления текста, поскольку от этого напрямую зависит производительность наших моделей.

Классические Методы: CountVectorizer и TF-IDF

Одними из первых и до сих пор широко используемых методов являются CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn.

CountVectorizer создает матрицу, где каждая строка представляет документ, а каждый столбец — уникальное слово из всего корпуса. Значение в ячейке, это просто частота появления слова в документе.

TfidfVectorizer (Term Frequency-Inverse Document Frequency) идет дальше. Он не только учитывает, как часто слово появляется в документе (TF), но и как часто оно встречается во всем корпусе документов (IDF). Идея в том, что слова, которые часто встречаются во многих документах (например, "и", "в", "на"), менее важны, чем слова, которые характерны для конкретного документа; Таким образом, TF-IDF придает больший вес редким, но важным словам;

Мы часто используем эти методы для задач классификации текста, поскольку они просты в понимании и достаточно эффективны для многих сценариев.

Word Embeddings: Погружение в Смысл

Классические методы, такие как TF-IDF, имеют один существенный недостаток: они не улавливают семантические связи между словами. "Король" и "королева" могут иметь совершенно разные векторные представления, хотя они тесно связаны по смыслу. Здесь на помощь приходят Word Embeddings, плотные векторные представления слов, где слова с похожим значением расположены близко друг к другу в многомерном пространстве.

Мы активно работаем с Word2Vec и GloVe, обычно используя библиотеку Gensim.

Word2Vec (представленный Google) обучается на огромных текстовых корпусах и может быть реализован в двух архитектурах: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту).

GloVe (Global Vectors for Word Representation), разработанный в Стэнфорде, использует глобальную статистику совместной встречаемости слов для создания векторных представлений.

Эти модели позволяют нам видеть удивительные вещи: например, если взять вектор "король", вычесть "мужчина" и прибавить "женщина", мы получим вектор, очень близкий к "королева". Это открывает двери для гораздо более глубокого понимания текста.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Если нам нужно получить векторное представление не отдельного слова, а целого предложения или документа, мы обращаемся к Doc2Vec (также известному как Paragraph Vectors) от Gensim. Он расширяет идеи Word2Vec на уровень абзацев или документов, позволяя нам сравнивать целые тексты по их смысловому содержанию.

В последнее время мы все чаще используем Sentence Transformers, которые основаны на архитектурах трансформеров и позволяют создавать высококачественные векторные представления предложений и документов; Они особенно полезны для задач поиска семантически похожих текстов, кластеризации и суммаризации.

Контекстное Встраивание: Эра Трансформеров

Самым большим прорывом в векторизации стало появление трансформерных моделей, таких как BERT (Bidirectional Encoder Representations from Transformers) и их наследников (RoBERTa, GPT-n и др.). В отличие от традиционных Word Embeddings, которые присваивают одно и то же векторное представление слову, независимо от контекста ("банк" как финансовое учреждение или берег реки), трансформеры создают контекстные встраивания. Это означает, что вектор слова "банк" будет разным в зависимости от окружающих его слов.

Мы используем библиотеку Hugging Face Transformers для работы с этими моделями. Они позволяют нам решать самые сложные задачи NLP, от тонкой настройки для классификации до генерации текста и машинного перевода. Возможность тонкой настройки (fine-tuning) предварительно обученных моделей под наши специфические задачи значительно сокращает время и ресурсы, необходимые для достижения высокого качества.

Основные Задачи NLP и Инструменты

Теперь, когда мы умеем подготавливать текст и превращать его в числа, давайте рассмотрим, какие задачи мы можем решать с помощью NLP и какие инструменты нам в этом помогают.

Распознавание Именованных Сущностей (NER): Ищем Смысловые Блоки

Распознавание именованных сущностей (NER) — это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты и т.д. Например, в предложении "Иван Иванов, CEO компании ‘Рога и Копыта’, посетил Москву 15 мая", NER должен выделить:

- Человек: "Иван Иванов"

- Организация: "’Рога и Копыта’"

- Место: "Москва"

Для быстрого и эффективного NER мы часто используем spaCy. Она поставляется с предварительно обученными моделями для различных языков, которые очень хорошо справляются с этой задачей. Для более сложных сценариев или языков с богатой морфологией (как русский) мы можем обратиться к Flair или использовать BERT-модели, тонко настроенные для NER. Мы также экспериментируем с CRF (Conditional Random Fields) для распознавания сущностей, когда требуется высокая точность и возможность внедрения специфических правил.

Оценка качества NER-моделей (Precision, Recall, F1-score) является обязательной частью нашей работы, чтобы убедиться, что наши системы работают корректно и эффективно.

Тематическое Моделирование: Открываем Скрытые Темы

Представьте, что у вас есть огромный архив документов, статей или отзывов. Как понять, о чем они? Тематическое моделирование — это набор алгоритмов, которые позволяют нам автоматически обнаруживать скрытые "темы" в большом корпусе текстов. Каждая тема представляет собой набор слов, которые часто встречаются вместе.

Мы регулярно используем библиотеку Gensim для реализации таких моделей, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

LDA — это вероятностная модель, которая предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема, в свою очередь, представляет собой смесь слов.

LSI (или LSA) использует сингулярное разложение (SVD) для выявления скрытых семантических структур в тексте.

Мы также работаем с NMF (Non-negative Matrix Factorization), которая является альтернативным методом тематического моделирования. Выбор между LDA и NMF часто зависит от характера данных и конкретной задачи.

"Язык, это карта нашего мира. Когда мы учим машины читать эту карту, мы даем им возможность понять реальность, которую мы создаем."

Анализ Тональности: Понимаем Эмоции

Один из самых востребованных аспектов NLP — это анализ тональности (Sentiment Analysis), то есть определение эмоциональной окраски текста: позитивной, негативной или нейтральной. Это критически важно для анализа отзывов клиентов, мониторинга социальных сетей, финансовых новостей и многого другого.

Для быстрого старта мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK, который хорошо работает с текстами из социальных сетей и учитывает такие нюансы, как использование заглавных букв или восклицательных знаков. Для более общего анализа тональности или определения языка мы обращаемся к TextBlob, которая предлагает простой API для многих NLP-задач.

Однако, анализ тональности не всегда прямолинеен. Мы сталкиваемся с такими вызовами, как сарказм, ирония, двойные отрицания. Для решения этих проблем мы используем более продвинутые модели, включая трансформеры, тонко настроенные на специфические наборы данных с разметкой сарказма или контекста. Анализ тональности сообщений в социальных сетях (Twitter/Reddit) с учетом сленга и эмодзи требует особого подхода и специализированных словарей.

Классификация Текстов: Сортируем и Категоризируем

Классификация текстов — это задача присвоения тексту одной или нескольких предопределенных категорий или меток. Примеры: спам/не спам, позитивный/негативный отзыв, новость о спорте/политике/экономике. Мы используем классификацию для автоматической категоризации статей, фильтрации контента, маршрутизации запросов клиентов и многого другого.

Для классификации мы активно применяем библиотеку Scikit-learn, используя такие алгоритмы машинного обучения, как SVM (Support Vector Machines) и Наивный Байесовский классификатор. Они отлично работают с TF-IDF векторами.

Для более сложных задач, где требуется улавливать глубокие семантические зависимости, мы переходим к нейронным сетям. Мы строим модели с использованием PyTorch и TensorFlow, включая архитектуры LSTM (Long Short-Term Memory) для последовательной обработки текста, а также используем BERT для задач классификации, добиваясь выдающихся результатов за счет его способности понимать контекст.

Суммаризация Текста: Сжимаем Информацию

В мире избытка информации способность быстро извлекать суть из длинных текстов становится бесценной. Суммаризация текста — это процесс создания краткого, но информативного изложения исходного документа или набора документов. Мы различаем два основных подхода:

Экстрактивная суммаризация: выбирает наиболее важные предложения или фразы из исходного текста и объединяет их в краткое изложение. Для этого мы часто используем алгоритм TextRank, который основан на алгоритме PageRank и ранжирует предложения по их важности.

Абстрактивная суммаризация: генерирует новые предложения, которые передают основной смысл текста, но могут не присутствовать буквально в оригинале. Это гораздо более сложная задача, которая требует глубокого понимания текста и способностей к генерации языка. Для абстрактивной суммаризации мы используем передовые Transformer-модели (например, T5, BART) из Hugging Face.

Вопросно-ответные Системы (QA) и Генерация Текста

Разработка вопросно-ответных систем (QA) — одна из самых захватывающих областей NLP. Такие системы могут понимать вопросы, заданные на естественном языке, и находить или генерировать соответствующие ответы из заданного корпуса документов. Для этого мы используем сложные архитектуры на основе трансформеров, которые способны сопоставлять вопрос с релевантными частями текста.

Помимо QA, мы активно работаем с генерацией текста. Transformer-модели, такие как GPT (Generative Pre-trained Transformer) и его последующие версии, изменили ландшафт генеративного NLP. Они могут создавать связные и осмысленные тексты на самые разные темы, от новостных статей до художественной прозы и даже кода. Мы используем их для:

- Генерации диалогов (для чат-ботов).

- Автоматического создания тегов и заголовков.

- Перефразирования текстов.

- Разработки чат-ботов на Python (например, с использованием Rasa framework).

Продвинутые Темы и Применение

Мир NLP постоянно развивается, и мы постоянно осваиваем новые подходы и инструменты, чтобы решать все более сложные и интересные задачи.

Многоязычный NLP: Преодолеваем Языковые Барьеры

Работа с текстами на разных языках представляет свои уникальные вызовы. Мы используем библиотеки, такие как Polyglot для мультиязычности, которая поддерживает множество языков для токенизации, NER и определения языка. Для языков с богатой морфологией, таких как русский, мы часто обращаемся к Stanza, разработанной Стэнфордским университетом, которая предоставляет комплексный набор инструментов для морфологического анализа, POS-теггинга и синтаксического парсинга.

Разработка систем машинного перевода также является важной частью нашей работы. Современные подходы в этой области почти полностью основаны на Transformer-моделях, способных переводить тексты с высокой точностью, даже для узкоспециализированных областей после соответствующего дообучения.

Работа с Различными Источниками Данных

Текст может поступать из самых разных источников, и каждый из них требует своего подхода:

Веб-скрейпинг: Для извлечения текстовых данных с веб-страниц мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML и XML, извлекая нужные блоки текста.

Извлечение из PDF: Работа с PDF-документами, особенно с нетекстовыми слоями, может быть сложной. Для этого мы применяем PyMuPDF (Fitz), которая позволяет эффективно извлекать текст, изображения и метаданные из PDF-файлов.

Анализ специализированных документов: Мы работали с анализом юридических документов для извлечения фактов и дат, медицинских записей для поиска ключевых фраз, а также лог-файлов для выявления паттернов и аномалий. Каждый из этих доменов требует специфической предобработки и словарей.

Визуализация Текстовых Данных

Визуализация помогает нам лучше понять структуру и содержание текстовых данных. Мы часто используем:

Облака слов (Word Clouds): Для быстрого выявления наиболее часто встречающихся слов.

Тепловые карты (Heatmaps): Для визуализации матриц совместной встречаемости слов или тематических распределений.

- А также различные графики для анализа частотности слов, n-грамм и распределения тональности.

Для более глубокого и быстрого анализа текстовых данных мы экспериментируем с такими инструментами, как Sweetviz, которая может автоматически генерировать красивые и информативные отчеты.

Особые Вызовы и Решения

Мы постоянно сталкиваемся с задачами, которые выходят за рамки стандартных алгоритмов:

Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг несут важную смысловую нагрузку. Мы разрабатываем специальные словари и правила для их обработки и включения в анализ тональности или тематического моделирования.

Проверка грамматики и орфографии: Для создания инструментов проверки грамматики и исправления орфографии мы используем комбинацию правил, словарей и моделей машинного обучения.

Обнаружение плагиата: Сравнение документов на предмет сходства, используя такие метрики, как TextDistance, помогает нам выявлять дубликаты и плагиат.

Анализ стилистики текстов (авторский почерк): Эта задача включает в себя анализ лексического богатства, частотности n-грамм, использования пунктуации и других стилистических признаков для определения авторства или сравнения стилей.

Обработка больших текстовых массивов (Big Data NLP): Когда данные исчисляются терабайтами, мы переходим к распределенным вычислениям и оптимизированным библиотекам, таким как Gensim, которые могут эффективно работать с большими корпусами.

Наши Рекомендации и Будущее NLP

Путешествие в мир NLP — это непрерывный процесс обучения и экспериментов. Мы видели, как быстро эта область развивается, и знаем, что за углом всегда ждут новые открытия.

Если вы только начинаете, мы рекомендуем:

- Начните с NLTK и spaCy. Это отличные библиотеки для освоения основ токенизации, стемминга, лемматизации и NER.

- Изучите Scikit-learn для классификации и векторизации (CountVectorizer, TF-IDF).

- Освойте Gensim для Word Embeddings (Word2Vec, GloVe) и тематического моделирования (LDA, LSI).

- Когда будете готовы к более продвинутым задачам, погрузитесь в мир Hugging Face Transformers. Это изменит ваше представление о возможностях NLP.

- Практикуйтесь! Берите реальные наборы данных (например, с Kaggle), ставьте себе задачи и решайте их, используя полученные знания.

Будущее NLP обещает еще более впечатляющие достижения. Мы видим развитие в области мультимодального NLP (обработка текста, изображений и звука одновременно), улучшение понимания контекста и причинно-следственных связей, а также создание еще более универсальных и адаптивных моделей, способных к обучению с меньшим количеством данных. Возможности, которые открывает перед нами NLP, безграничны, и мы с нетерпением ждем, что принесет нам следующий этап этого захватывающего развития.

Мы прошли долгий путь, исследуя основы и продвинутые концепции обработки естественного языка с помощью Python. От элементарной токенизации до сложных трансформерных моделей, от анализа тональности до генерации текста — каждый инструмент в нашем арсенале открывает новые возможности для понимания и взаимодействия с человеческим языком. Наш опыт показывает, что NLP, это не просто набор алгоритмов, а мощный мост между человеческим миром слов и цифровым миром машин, позволяющий нам извлекать знания, автоматизировать процессы и создавать интеллектуальные системы, которые раньше казались невозможными.

Мы надеемся, что этот обзор вдохновил вас на собственные исследования и эксперименты. Помните, что ключ к успеху в NLP — это постоянное обучение, любопытство и готовность пробовать новое. Начните с малого, постепенно усложняйте задачи, и вы увидите, как текст, который раньше был просто набором символов, начнет раскрывать перед вами свои тайны. Успехов вам в этом увлекательном путешествии!

Подробнее

| Основы NLTK Python | SpaCy NER анализ | Тематическое моделирование Gensim | Word Embeddings Word2Vec | Анализ тональности VADER |

| Классификация текстов Scikit-learn | Hugging Face Transformers | Разработка чат-ботов Python | Обработка PDF PyMuPDF | Векторизация Doc2Vec |