- Разговор с Машинами: Наш Путеводитель по Захватывающему Миру NLP на Python

- Фундамент Понимания: Первые Шаги в Обработке Текста

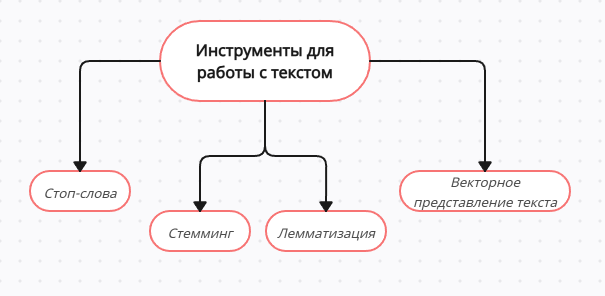

- Превращаем Слова в Данные: Токенизация, Стемминг и Лемматизация

- Очистка и Подготовка: Регулярные Выражения и Стоп-слова

- Простота и Скорость: TextBlob и ее Возможности

- Как Машины Видят Слова: Векторизация и Встраивания

- Классические Подходы: CountVectorizer и TF-IDF

- Глубокое Понимание: Word Embeddings (Word2Vec, GloVe, FastText)

- Контекст Имеет Значение: Doc2Vec, Sentence Transformers и Контекстные Встраивания

- Решение Задач Реального Мира: Основные Приложения NLP

- Распознавание Сущностей: NER с spaCy и Flair

- Заглядывая в Эмоции: Анализ Тональности (Sentiment Analysis)

- Ищем Скрытые Смыслы: Тематическое Моделирование (LDA, LSI, NMF)

- Классификация Текстов: От Спама до Категорий Новостей

- Сокращаем и Отвечаем: Суммаризация и QA Системы

- Преодолевая Языковые Барьеры: Машинный Перевод

- Продвинутые Инструменты и Фреймворки: Наш Арсенал

- Мощь Трансформеров: Hugging Face и GPT

- Специализированные Библиотеки: Stanza, Textacy, Polyglot

- Веб-Скрейпинг и Данные: Beautiful Soup и PDF

- Строим Интеллектуальные Системы: Чат-боты с Rasa

- Нюансы и Тонкости: Глубокий Дайв в Проблематику NLP

- Работа с "Грязными" Данными: Очистка и Нормализация

- Оценка и Сравнение Моделей: Как Понять, Что Работает Лучше

- Мультиязычность и Редкие Языки: Вызовы и Решения

- Извлечение Смысла: Ключевые Фразы, N-граммы и Зависимости

- Будущее Уже Здесь: Перспективы и Последние Тренды

- От Автоматической Разметки до Проверки Фактов

- NLP в Больших Данных и Real-time

- Стилистика, Авторство и Юридические Документы

Разговор с Машинами: Наш Путеводитель по Захватывающему Миру NLP на Python

Приветствуем вас, дорогие читатели и коллеги по цеху! Мы, как опытные путешественники по бескрайним просторам данных, сегодня хотим пригласить вас в одно из самых увлекательных приключений последних десятилетий – в мир обработки естественного языка, или NLP (Natural Language Processing). Представьте: каждый день миллиарды людей обмениваются сообщениями, пишут статьи, оставляют отзывы, создают документы. И за всей этой лавиной текста скрываются сокровища информации, которые ждут, чтобы их извлекли, проанализировали и поняли. Именно этим и занимается NLP – оно учит машины "читать" и "понимать" наш человеческий язык.

За последние годы мы стали свидетелями невероятного прорыва в этой области. От простых задач по поиску ключевых слов до создания интеллектуальных чат-ботов и систем машинного перевода, способных передавать тончайшие нюансы смысла, NLP изменило наше взаимодействие с технологиями. И что особенно приятно, Python стал де-факто языком для всех, кто хочет окунуться в этот мир. Благодаря богатейшей экосистеме библиотек, интуитивному синтаксису и активному сообществу, мы можем решать самые сложные задачи, не изобретая велосипед каждый раз. В этой статье мы шаг за шагом проведем вас через основные концепции, инструменты и методы, которые мы сами используем в нашей повседневной практике, делясь нашими наработками и секретами.

Фундамент Понимания: Первые Шаги в Обработке Текста

Прежде чем мы научим машину "понимать" сложные предложения или целый абзац, нам нужно научить ее "видеть" текст в удобном для обработки формате. Это как разложить сложную конструкцию на мелкие, понятные детали. Эти первые, но критически важные шаги формируют основу для всех последующих, более сложных аналитических задач. Без качественной предобработки любой, даже самый продвинутый алгоритм, будет работать неэффективно или давать ошибочные результаты.

Превращаем Слова в Данные: Токенизация, Стемминг и Лемматизация

Первое, что мы делаем с сырым текстом, это токенизация. Это процесс разбиения текста на отдельные единицы, называемые токенами. Токенами могут быть слова, пунктуационные знаки, цифры или даже целые фразы. NLTK (Natural Language Toolkit) предоставляет нам прекрасные инструменты для этого, например, word_tokenize для слов и sent_tokenize для предложений. Правильная токенизация критически важна, ведь от нее зависит, как наш алгоритм будет воспринимать текст.

После токенизации часто возникает следующая проблема: одно и то же слово может иметь разные формы (например, "бегать", "бегал", "бегущий"). Чтобы привести их к одной основе, мы используем стемминг и лемматизацию. Стемминг, как правило, отсекает окончания, пытаясь найти "корень" слова, что часто приводит к не всегда существующим в языке словам (например, "красив" из "красивый"). Лемматизация же более умный процесс: она стремится привести слово к его словарной форме (лемме), используя морфологический анализ языка. Это значит, что "бегал", "бегущий" и "бегать" будут приведены к "бегать". Мы обычно предпочитаем лемматизацию, особенно с такими библиотеками, как spaCy или Stanza, которые предоставляют более точные результаты для русского языка, где морфология значительно богаче, чем в английском.

Очистка и Подготовка: Регулярные Выражения и Стоп-слова

Сырой текст редко бывает идеально чистым. В нем могут содержаться HTML-теги, случайные символы, цифры, которые не несут смысловой нагрузки для нашей задачи, или просто избыточная пунктуация. Здесь на помощь приходят регулярные выражения (модуль re в Python). Мы используем их для поиска и замены определенных паттернов в тексте, эффективно удаляя все лишнее. Например, мы можем легко очистить текст от всех URL-адресов или специальных символов, которые могут мешать дальнейшему анализу.

Еще один важный этап – удаление стоп-слов. Это слова, которые очень часто встречаются в языке (например, "и", "в", "на", "он") и обычно не несут существенной смысловой нагрузки для большинства задач NLP. Их удаление помогает уменьшить размер нашего корпуса данных и сосредоточиться на более значимых словах. NLTK и spaCy предлагают готовые списки стоп-слов для разных языков, но мы часто адаптируем их, добавляя или удаляя слова в зависимости от специфики нашей задачи или предметной области.

Простота и Скорость: TextBlob и ее Возможности

Иногда нам не нужны глубокие морфологические анализы или сложные модели. Для быстрых и простых задач, особенно на начальном этапе изучения или для прототипирования, мы часто обращаемся к библиотеке TextBlob. Она построена на базе NLTK и предлагает очень удобный интерфейс для базовых операций, таких как токенизация, POS-теггинг (разметка частей речи) и даже простейший анализ тональности. Для новичков это отличный способ начать, не погружаясь сразу в дебри сложных алгоритмов. Однако для продакшн-систем или более точного анализа, мы, конечно, используем более мощные инструменты.

Как Машины Видят Слова: Векторизация и Встраивания

После того как мы очистили и подготовили наш текст, перед нами встает фундаментальная задача: как представить слова и предложения в виде, понятном для компьютера? Машины не понимают слов в их лингвистическом значении; они работают с числами. Поэтому нам необходимо перевести текст в числовые векторы. Этот процесс называется векторизацией, и он является ключевым для применения любых алгоритмов машинного обучения к текстовым данным. От того, насколько хорошо мы векторизуем текст, напрямую зависит качество наших моделей.

Классические Подходы: CountVectorizer и TF-IDF

Начнем с классики. Одним из простейших методов векторизации является CountVectorizer. Он просто подсчитывает частоту каждого слова в документе и создает вектор, где каждое измерение соответствует уникальному слову в нашем корпусе, а значение – количеству его вхождений в документ. Это отличный старт, но у него есть свои недостатки: он не учитывает важность слова в контексте всего корпуса и может быть слишком чувствителен к очень частым словам.

Для решения этих проблем мы используем TF-IDF (Term Frequency-Inverse Document Frequency). Этот подход не только учитывает, как часто слово встречается в конкретном документе (TF), но и насколько оно уникально для этого документа по сравнению со всем корпусом (IDF). Слова, которые встречаются часто в одном документе, но редко в других, получают более высокий вес. Это позволяет нам выделить по-настоящему важные слова. В Scikit-learn есть прекрасные реализации обоих векторизаторов, которыми мы активно пользуемся.

| Метод Векторизации | Преимущества | Недостатки | Типичные Задачи |

|---|---|---|---|

| CountVectorizer | Простота реализации, высокая скорость, интерпретируемость. | Не учитывает важность слов, создает разреженные векторы, игнорирует семантику. | Классификация спама, подсчет частотности слов. |

| TF-IDF Vectorizer | Учитывает важность слова в документе и корпусе, улучшает качество для многих задач. | Все еще создает разреженные векторы, не учитывает порядок слов и семантику. | Поиск информации, тематическое моделирование, классификация документов. |

Глубокое Понимание: Word Embeddings (Word2Vec, GloVe, FastText)

Классические методы векторизации страдают от "проклятия размерности" и не способны улавливать семантические связи между словами. Революцию в этой области произвели Word Embeddings (векторные представления слов). Идея проста, но гениальна: каждое слово представляется в виде плотного вектора небольшой размерности, где слова со схожим значением располагаются близко друг к другу в многомерном пространстве. Мы активно используем Gensim для работы с моделями Word2Vec и GloVe. Word2Vec, например, позволяет нам уловить такие отношения, как "король ー мужчина + женщина = королева".

FastText, разработанный Facebook AI Research, является расширением Word2Vec, которое учитывает подсловные единицы (n-граммы символов). Это делает его особенно эффективным для языков с богатой морфологией (как русский) и для работы с редкими словами, которые могут не встречаться в обучающем корпусе целиком. Мы обнаружили, что FastText часто дает лучшие результаты, когда нам нужно работать с обширным словарем или текстами, содержащими много опечаток и сокращений.

Контекст Имеет Значение: Doc2Vec, Sentence Transformers и Контекстные Встраивания

Если Word Embeddings прекрасно справляются с представлением отдельных слов, то что делать, если нам нужно получить векторное представление для целого предложения или документа? Здесь на помощь приходит Doc2Vec (расширение Word2Vec), которое позволяет обучать плотные векторные представления для целых документов. Это очень полезно для задач, где нам нужно сравнивать документы по смыслу, например, для поиска похожих статей или кластеризации.

Еще более продвинутым шагом стали Sentence Transformers и контекстные встраивания. В отличие от Word2Vec, где каждое слово имеет один фиксированный вектор, контекстные встраивания (например, в основе таких моделей, как BERT, GPT) генерируют вектор слова в зависимости от его контекста в предложении. Это позволяет улавливать тончайшие семантические нюансы и полисемию. Sentence Transformers, в свою очередь, позволяют эффективно создавать векторные представления целых предложений, сохраняя их семантическую близость. Мы используем эти мощные инструменты, особенно когда нам нужна высокая точность для задач сравнения предложений, семантического поиска или даже для разработки вопросно-ответных систем.

Решение Задач Реального Мира: Основные Приложения NLP

После того как мы научились готовить текст и представлять его в числовом виде, мы можем перейти к решению конкретных и очень востребованных задач. Именно здесь NLP показывает свою истинную силу, позволяя автоматизировать процессы, извлекать ценную информацию и улучшать взаимодействие с пользователями. Мы постоянно используем эти методы в нашей работе, превращая неструктурированный текст в ценные инсайты.

Распознавание Сущностей: NER с spaCy и Flair

Одной из наиболее фундаментальных и полезных задач в NLP является Распознавание Именованных Сущностей (NER ⎯ Named Entity Recognition). Наша цель – найти и классифицировать именованные сущности в тексте, такие как имена людей, названия организаций, географические местоположения, даты и денежные суммы. Это чрезвычайно важно для извлечения структурированной информации из неструктурированного текста.

Мы часто полагаемся на spaCy для задач NER благодаря его впечатляющей скорости и точности. Он предоставляет готовые предобученные модели, которые отлично справляются с большинством стандартных сущностей. Для более сложных или специализированных задач, где требуется высокая точность или работа с языками с богатой морфологией, мы обращаемся к Flair. Flair позволяет легко создавать и тонко настраивать модели NER, используя мощные контекстные встраивания. Также мы иногда используем CRF (Conditional Random Fields), когда нам нужен более прозрачный и контролируемый подход, особенно для специфических доменов с ограниченным объемом размеченных данных.

Заглядывая в Эмоции: Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – это то, что отличает машину от простого парсера. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв положительным, отрицательным или нейтральным. Это бесценно для анализа отзывов клиентов, мониторинга социальных сетей или финансовых новостей.

Для быстрого и простого анализа тональности английского текста мы часто начинаем с VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично работает с текстами из социальных сетей и учитывает сленг и смайлики. Однако, для более глубокого и точного анализа, особенно на русском языке или с учетом специфики домена (например, анализ тональности финансовых новостей или медицинских записей), мы переходим к моделям машинного обучения и глубокого обучения. Мы обучаем классификаторы на размеченных данных, используя Scikit-learn или даже трансформеры из Hugging Face, чтобы улавливать тонкие нюансы, сарказм и специфический сленг, что является серьезным вызовом в этой области.

Ищем Скрытые Смыслы: Тематическое Моделирование (LDA, LSI, NMF)

Представьте, что у вас есть огромный корпус документов, и вы хотите понять, о каких основных темах они говорят, не читая каждый из них вручную. Здесь на помощь приходит Тематическое Моделирование. Это метод без учителя, который автоматически обнаруживает абстрактные "темы" в коллекции текстовых документов. Каждая тема представлена набором слов, которые часто встречаются вместе, а каждый документ может быть описан как смесь этих тем.

Мы используем библиотеку Gensim для реализации таких алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing); LDA – это вероятностная модель, которая предполагает, что темы существуют априори, и документы генерируются путем выбора тем, а затем слов из этих тем. LSI, в свою очередь, использует сингулярное разложение для выявления скрытых семантических структур. Мы также экспериментируем с NMF (Non-negative Matrix Factorization), который часто дает более интерпретируемые темы. Выбор метода зависит от характеристик данных и требуемой интерпретируемости результатов.

| Метод | Принцип Работы | Преимущества | Недостатки |

|---|---|---|---|

| LDA | Вероятностная модель, каждый документ – смесь тем, каждая тема – смесь слов. | Хорошо интерпретируемые темы, гибкость. | Требует настройки гиперпараметров (число тем), медленнее на больших данных. |

| NMF | Разложение матрицы на две неотрицательные матрицы, одна из которых представляет темы. | Часто более четкие и интерпретируемые темы, быстрее, чем LDA. | Чувствителен к инициализации, может быть менее гибким. |

Классификация Текстов: От Спама до Категорий Новостей

Классификация текстов – это задача присвоения документу одной или нескольких предопределенных категорий или меток. Мы используем ее повсеместно: от фильтрации спама и категоризации новостных статей до анализа отзывов клиентов по категориям продуктов. Это одна из самых распространенных и важных задач в NLP.

Для решения этой задачи мы часто обращаемся к Scikit-learn, который предоставляет широкий спектр алгоритмов машинного обучения, таких как SVM (Support Vector Machines), Наивный Байесовский классификатор и Логистическая Регрессия. Мы также активно используем PyTorch и TensorFlow для создания нейронных сетей, таких как LSTM, которые способны улавливать последовательную природу текста, а в последнее время все чаще применяем BERT и другие трансформерные модели для задач классификации, так как они демонстрируют превосходные результаты, особенно на больших и сложных датасетах.

"Язык ⎯ это карта дорог, по которым движется наше сознание. Он формирует наши мысли и определяет наше восприятие мира."

— Бенджамин Ли Уорф

Сокращаем и Отвечаем: Суммаризация и QA Системы

В мире, переполненном информацией, способность быстро извлекать суть из длинных текстов становится критически важной. Суммаризация текста позволяет нам создавать краткие, но информативные изложения документов. Мы различаем два основных подхода: экстрактивную суммаризацию, которая выбирает наиболее важные предложения из исходного текста, и абстрактивную суммаризацию, которая генерирует новые предложения, передающие смысл оригинала. Для экстрактивной суммаризации мы можем использовать алгоритмы вроде TextRank, а для абстрактивной – мощь трансформеров из Hugging Face, которые способны создавать очень качественные и связные резюме.

Суммаризация тесно связана с Вопросно-Ответными (QA) Системами. Цель QA систем – найти точный ответ на вопрос пользователя в заданном корпусе документов. Это сложная задача, требующая глубокого понимания текста и способности извлекать конкретные фрагменты информации. С появлением трансформеров, таких как BERT и его модификаций, разработка QA систем стала намного более эффективной. Мы активно используем эти модели, чтобы создавать системы, способные не просто искать ключевые слова, а понимать семантику вопроса и находить релевантные ответы даже в больших массивах данных.

Преодолевая Языковые Барьеры: Машинный Перевод

Машинный перевод – это, пожалуй, одна из самых амбициозных задач в NLP, и прогресс в этой области за последние годы был ошеломляющим. От систем, основанных на правилах и статистике, мы пришли к нейронным сетям, способным генерировать перевод, практически неотличимый от человеческого. Трансформеры (в частности, архитектуры Encoder-Decoder) стали золотым стандартом в машинном переводе, позволяя нам обрабатывать многоязычные текстовые корпусы и разрабатывать системы, которые не просто переводят слова, но и улавливают грамматические структуры и культурные нюансы.

Мы используем фреймворки, такие как PyTorch и TensorFlow, в сочетании с библиотекой Hugging Face Transformers, для создания и тонкой настройки моделей машинного перевода. Особый интерес для нас представляет разработка систем автоматического перевода узкоспециализированных текстов, где требуется не только языковая точность, но и знание специфической терминологии, например, в юридической или медицинской сфере. Это сложная, но невероятно важная область, открывающая новые горизонты для глобальной коммуникации.

Продвинутые Инструменты и Фреймворки: Наш Арсенал

По мере того как задачи NLP становятся все более сложными и требовательными, наш инструментарий постоянно расширяется. Мы больше не ограничиваемся базовыми библиотеками, а активно осваиваем и применяем мощные фреймворки и специализированные инструменты, которые позволяют нам решать задачи на передовом уровне. Этот раздел посвящен тем "тяжеловесам", которые составляют основу нашего продвинутого арсенала.

Мощь Трансформеров: Hugging Face и GPT

Без преувеличения можно сказать, что архитектура Трансформеров изменила ландшафт NLP. Это не просто еще один алгоритм, это новая парадигма, которая позволила достичь беспрецедентных результатов в самых разных задачах – от машинного перевода до генерации текста. Библиотека Hugging Face Transformers стала для нас незаменимым инструментом. Она предоставляет доступ к сотням предобученных моделей (BERT, GPT, RoBERTa, T5 и многие другие), обученных на огромных текстовых корпусах. Это позволяет нам не начинать с нуля, а использовать эти мощные модели как основу для наших собственных задач, проводя тонкую настройку (Fine-tuning) на наших специфических данных.

Мы активно используем трансформерные модели для генерации текста (например, с помощью GPT-подобных моделей), создания диалоговых систем, суммаризации, а также для получения высококачественных контекстных встраиваний. Способность этих моделей понимать и генерировать человеческий язык на таком уровне открывает двери для создания по-настоящему интеллектуальных приложений, которые еще несколько лет назад казались фантастикой.

Специализированные Библиотеки: Stanza, Textacy, Polyglot

Хотя основные библиотеки, такие как NLTK и spaCy, являются отличной отправной точкой, для специфических задач мы обращаемся к более специализированным инструментам:

- Stanza: Разработанная Stanford NLP Group, эта библиотека особенно ценна для нас при работе с языками с богатой морфологией, такими как русский. Stanza предоставляет комплексный пайплайн для анализа текста, включая токенизацию, многословные токены, POS-теггинг, лемматизацию, анализ зависимостей и NER, и все это на основе нейронных сетей. Ее точность для русского языка часто превосходит другие библиотеки.

- Textacy: Это мощная библиотека для продвинутой обработки текста и извлечения информации. Она построена на базе spaCy и предоставляет высокоуровневые API для таких задач, как извлечение ключевых фраз (с использованием TextRank), поиск n-грамм, анализ читабельности, сравнение документов и многое другое. Мы используем Textacy, когда нам нужно быстро выполнить сложный анализ текста без необходимости писать много низкоуровневого кода.

- Polyglot: Когда речь заходит о мультиязычности и работе с редкими языками, Polyglot становится нашим выбором. Она поддерживает огромное количество языков для таких задач, как определение языка, токенизация, NER, анализ тональности и морфологический анализ. Хотя она может быть не такой глубокой, как Stanza для некоторых языков, ее широкая поддержка языков делает ее бесценной для проектов с глобальным охватом.

Веб-Скрейпинг и Данные: Beautiful Soup и PDF

Прежде чем мы сможем анализировать текст, нам часто нужно его получить. И здесь в игру вступает веб-скрейпинг. Библиотека Beautiful Soup в связке с requests или selenium – это наш основной инструмент для извлечения текста с веб-страниц. Мы используем ее для сбора данных с блогов, форумов, новостных сайтов, чтобы формировать наши текстовые корпуса для анализа.

Помимо веб-страниц, огромное количество ценной информации содержится в PDF-документах. Извлечение текста из PDF может быть непростой задачей, но с библиотекой PyMuPDF (или pdfminer.six) мы можем эффективно извлекать текстовое содержимое, а затем применять к нему весь наш арсенал NLP-инструментов. Это особенно актуально для анализа юридических документов, финансовых отчетов или научных статей.

Строим Интеллектуальные Системы: Чат-боты с Rasa

Чат-боты и диалоговые системы – это одно из самых наглядных и интерактивных применений NLP. Мы используем Rasa framework для разработки сложных, контекстно-ориентированных чат-ботов. Rasa позволяет нам не только распознавать намерения пользователя и извлекать сущности из его запросов (NLU – Natural Language Understanding), но и управлять диалогом (Core – Dialogue Management), что критически важно для создания естественного и полезного взаимодействия. С Rasa мы можем строить чат-ботов, которые учатся на реальных разговорах и могут быть легко интегрированы в различные платформы.

Нюансы и Тонкости: Глубокий Дайв в Проблематику NLP

Мир NLP – это не только готовые модели и простые решения. По мере углубления в проекты мы сталкиваемся с множеством нюансов и проблем, которые требуют более тонкого подхода. Эти "подводные камни" могут серьезно повлиять на качество и надежность наших систем, и мы научились уделять им особое внимание.

Работа с "Грязными" Данными: Очистка и Нормализация

В реальном мире тексты редко бывают идеальными. Мы постоянно имеем дело с неполными и ошибочными данными, опечатками, грамматическими ошибками, специфическим сленгом, эмодзи и сокращениями, особенно в текстах из социальных сетей. Это требует от нас дополнительных этапов предобработки:

- Нормализация сленга и эмодзи: Мы разрабатываем собственные словари и правила для приведения сленговых выражений и эмодзи к стандартизированному виду или их замены на эквивалентные текстовые описания.

- Проверка грамматики и орфографии: Хотя полное исправление ошибок – это сложная задача, мы используем инструменты (например, на основе

TextBlobдля английского или более специализированные для русского) для выявления и, по возможности, исправления опечаток и базовых грамматических ошибок, которые могут исказить смысл. - Удаление пунктуации и стоп-слов: На этом этапе мы не просто удаляем, а нормализуем. Например, несколько восклицательных знаков могут нести большую эмоциональную нагрузку, чем один, и мы можем решить сохранить эту информацию.

Библиотеки вроде Jellyfish помогают нам в сравнении строк и поиске схожих слов, что полезно для нормализации и сопоставления.

Оценка и Сравнение Моделей: Как Понять, Что Работает Лучше

Разработка NLP-модели – это только полдела. Критически важно уметь объективно оценивать ее производительность и сравнивать различные подходы. Для задач NER, классификации и других, где есть размеченные данные, мы используем стандартные метрики:

- Precision (Точность): Доля правильных предсказаний среди всех предсказаний данной категории.

- Recall (Полнота): Доля правильных предсказаний среди всех истинных экземпляров данной категории.

- F1-score: Гармоническое среднее между Precision и Recall, часто используемое для агрегированной оценки.

Мы также проводим сравнение различных методов векторизации (TF-IDF vs Word2Vec vs BERT-embeddings), моделей тематического моделирования (LDA vs NMF) и алгоритмов кластеризации (K-Means vs DBSCAN), чтобы выбрать наиболее подходящий для конкретной задачи. Для этого мы часто используем визуализацию данных, например, с помощью Sweetviz для анализа текстовых данных, чтобы получить глубокое понимание распределения и характеристик нашего корпуса.

Мультиязычность и Редкие Языки: Вызовы и Решения

Работа с многоязычными текстовыми корпусами и особенно с редкими языками представляет собой особый вызов. Большинство предобученных моделей и ресурсов ориентированы на английский язык. Для русского языка, как мы уже упоминали, Stanza является отличным решением. Для других языков мы исследуем возможности Polyglot, который предоставляет базовую поддержку для широкого спектра языков. Мы также активно используем трансформерные модели, предобученные на многоязычных корпусах (например, mBERT или XLM-R), которые демонстрируют впечатляющие результаты даже для языков с ограниченными ресурсами. Это позволяет нам развивать системы, которые не ограничиваются одним языком, а работают в глобальном масштабе.

Извлечение Смысла: Ключевые Фразы, N-граммы и Зависимости

Помимо простого понимания слов, нам часто нужно извлекать более глубокий смысл из текста. Для этого мы используем:

- Извлечение ключевых фраз: Методы, такие как

RAKE (Rapid Automatic Keyword Extraction)илиTextRank(реализованный вTextacy), помогают нам автоматически определять наиболее важные слова и фразы в документе. Это полезно для тегирования контента или краткого изложения. - Анализ частотности слов и n-грамм: Подсчет частоты отдельных слов и последовательностей слов (n-грамм) позволяет нам выявлять популярные темы, устойчивые выражения и поведенческие паттерны в текстовых данных (например, в пользовательских запросах или чатах).

- Синтаксический парсинг и анализ зависимостей: С помощью

spaCyмы можем выполнять синтаксический парсинг, который определяет грамматическую структуру предложения и выявляет отношения между словами (например, кто является подлежащим, кто – сказуемым). Это позволяет нам разрабатывать модели для выявления связей между сущностями и создавать более сложные вопросно-ответные системы.

Будущее Уже Здесь: Перспективы и Последние Тренды

Мир NLP развивается с ошеломляющей скоростью, и то, что вчера казалось фантастикой, сегодня уже становится реальностью. Мы постоянно следим за новыми трендами и технологиями, интегрируя их в нашу практику, чтобы оставаться на переднем крае инноваций. Сейчас мы видим несколько ключевых направлений, которые будут определять будущее обработки естественного языка.

От Автоматической Разметки до Проверки Фактов

Одной из самых трудоемких задач в NLP является разметка данных – процесс ручной аннотации текстов для обучения моделей. Мы активно разрабатываем инструменты для автоматической разметки данных, использующие полуавтоматические подходы и активное обучение, чтобы значительно сократить время и ресурсы, необходимые для создания высококачественных обучающих выборок. Это критически важно для масштабирования наших решений.

Другое перспективное направление – разработка систем для проверки фактов (Fact-Checking). В эпоху распространения фейковых новостей способность автоматически проверять достоверность утверждений в тексте становится бесценной. Мы исследуем, как трансформерные модели и базы знаний могут быть объединены для создания инструментов, способных оценивать правдивость текстовой информации.

NLP в Больших Данных и Real-time

Обработка больших текстовых массивов (Big Data NLP) требует особых подходов и оптимизации. Мы используем распределенные вычисления и GPU-ускорение (с PyTorch/TensorFlow) для эффективной обработки огромных объемов данных. Кроме того, все большую актуальность приобретает обработка текста в режиме реального времени (Streaming NLP), например, для анализа сообщений в социальных сетях или лог-файлов. Мы разрабатываем системы, способные мгновенно реагировать на новую текстовую информацию, извлекать из нее ключевые сущности, анализировать тональность или категоризировать, что критически важно для мониторинга и быстрого реагирования.

Стилистика, Авторство и Юридические Документы

NLP находит применение и в таких тонких областях, как анализ стилистики текстов и определение авторства. Мы можем анализировать лексическое богатство, частотность определенных конструкций, использование пунктуации, чтобы выявить уникальный "почерк" автора. Это имеет практическое применение в криминалистике, литературоведении и для обнаружения плагиата.

Особое внимание мы уделяем анализу текста в юридических документах и контрактах. Извлечение ключевых дат, имен, обязательств, условий из этих объемных и сложных текстов позволяет значительно ускорить работу юристов и снизить риск ошибок. Мы создаем специализированные словари терминов и используем трансформерные модели, настроенные на юридическую лексику, для этих целей.

Наконец, продолжается развитие генеративных моделей, таких как GPT, которые уже способны создавать связные и осмысленные тексты, писать код и даже участвовать в диалогах. Мы видим огромный потенциал в использовании этих моделей для автоматического создания FAQ на основе документов, генерации контента и даже автоматического перефразирования текста. Эти технологии открывают беспрецедентные возможности для автоматизации и повышения креативности.

Вот мы и совершили наше увлекательное путешествие по миру NLP на Python. От основ токенизации до самых передовых трансформерных моделей – мы увидели, насколько многогранной и мощной может быть обработка естественного языка. Мы убеждены, что каждый, кто освоит эти инструменты, получит ключ к разгадке огромных массивов текстовых данных, которые окружают нас каждый день. Продолжайте экспериментировать, учится и применять эти знания – будущее NLP формируется прямо сейчас, и мы в нем активно участвуем!

Подробнее

| Python для обработки естественного языка | Библиотеки NLP в Python | Токенизация и лемматизация | Анализ тональности Python | Распознавание именованных сущностей (NER) |

| Тематическое моделирование LDA Gensim | Word Embeddings Word2Vec GloVe | Трансформеры Hugging Face NLP | Классификация текстов Scikit-learn | Создание чат-ботов Python |