- Разговор с машиной: Как Python открывает нам мир обработки естественного языка (NLP)

- Первые шаги: Основы предобработки текста

- Токенизация и стемминг с NLTK

- Продвинутая лемматизация и синтаксический парсинг со spaCy

- Регулярные выражения и очистка текста

- Понимание смысла: От слов к векторам

- Классические векторизаторы: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Gensim

- Контекстные встраивания и трансформеры (Hugging Face)

- Задачи NLP: От простого к сложному

- Распознавание именованных сущностей (NER)

- Тематическое моделирование (LDA‚ LSI) с Gensim

- Анализ тональности (Sentiment Analysis)

- Классификация текстов со Scikit-learn и PyTorch/TensorFlow

- Разработка систем суммаризации текста

- Расширенные возможности и прикладные области

- Создание чат-ботов и вопросно-ответных систем

- Анализ текста для извлечения информации

- Работа с многоязычными текстовыми корпусами

- Анализ стилистики и авторского почерка

- Инструменты и экосистема Python для NLP

- Вызовы и перспективы NLP

Разговор с машиной: Как Python открывает нам мир обработки естественного языка (NLP)

Добро пожаловать‚ дорогие читатели‚ в увлекательный мир‚ где машины начинают не просто слышать‚ но и по-настоящему понимать наш язык․ Мир‚ где потоки текста превращаются в ценные инсайты‚ а рутинные операции с данными автоматизируются до немыслимых пределов․ Мы говорим об Обработке Естественного Языка‚ или NLP (Natural Language Processing) – области искусственного интеллекта‚ которая позволяет компьютерам взаимодействовать с человеческим языком․ И если вы когда-либо задавались вопросом‚ как работают голосовые помощники‚ спам-фильтры или системы рекомендаций‚ то эта статья для вас․

На протяжении многих лет мы‚ как человечество‚ стремились научить машины понимать нас․ Это было сродни попытке научить рыбу летать – сложно‚ не всегда интуитивно‚ но невероятно заманчиво․ Python‚ со своей богатой экосистемой библиотек и простотой синтаксиса‚ стал нашим верным спутником в этом путешествии․ Именно благодаря ему мы получили мощные инструменты‚ которые позволяют нам буквально "разговаривать" с текстом‚ извлекая из него смысл‚ эмоции и структуру․

Мы пройдем путь от самых основ – как разбить текст на слова‚ до вершин современных технологий‚ таких как трансформеры‚ способные генерировать связные и осмысленные тексты․ Наша цель – не просто перечислить библиотеки и алгоритмы‚ а показать‚ как они работают вместе‚ открывая новые возможности для бизнеса‚ науки и повседневной жизни․ Приготовьтесь‚ это будет захватывающее погружение в мир‚ где слова обретают цифровое измерение․

Первые шаги: Основы предобработки текста

Прежде чем машина сможет "понять" текст‚ его необходимо подготовить․ Это похоже на то‚ как мы сначала очищаем и нарезаем ингредиенты‚ прежде чем начать готовить сложное блюдо․ В NLP этот процесс называется предобработкой‚ и он является краеугольным камнем любой успешной задачи․ Мы начинаем с самых базовых операций‚ которые‚ несмотря на свою простоту‚ играют критически важную роль․

Токенизация и стемминг с NLTK

Первое‚ что мы делаем‚ это токенизация – процесс разбиения текста на отдельные слова или фразы‚ которые мы называем токенами․ Представьте себе предложение: "Мы любим изучать NLP"․ NLTK (Natural Language Toolkit) легко превратит его в список `[‘Мы’‚ ‘любим’‚ ‘изучать’‚ ‘NLP’]`; Это кажется очевидным‚ но токенизация может быть сложной для языков с иероглифами или составными словами․ NLTK предлагает различные токенизаторы‚ включая `word_tokenize` и `sent_tokenize` для разбиения на слова и предложения соответственно․

После токенизации часто возникает необходимость привести слова к их базовой форме․ Здесь на помощь приходит стемминг – процесс усечения слов до их корня (стеммы)․ Например‚ слова "бежать"‚ "бежит"‚ "бежал" могут быть сведены к "беж"․ Это помогает уменьшить количество уникальных слов и сосредоточиться на их основном значении․ NLTK предоставляет несколько стеммеров‚ таких как `PorterStemmer` и `SnowballStemmer`․ Однако стемминг не всегда идеален‚ так как он может приводить к несловарным корням․ Мы обнаружили‚ что для многих задач этого достаточно‚ но для других требуется более продвинутый подход․

Продвинутая лемматизация и синтаксический парсинг со spaCy

Когда стемминг оказывается слишком грубым‚ мы обращаемся к лемматизации․ В отличие от стемминга‚ лемматизация приводит слова к их словарной (канонической) форме‚ называемой леммой‚ с учетом их морфологии и части речи․ Например‚ "бежал" превратится в "бежать"‚ а не в "беж"․ Это гораздо более точный процесс‚ требующий глубокого понимания грамматики языка․

Здесь в игру вступает spaCy – высокопроизводительная библиотека для промышленного NLP․ spaCy не только отлично справляется с лемматизацией‚ но и предоставляет мощные возможности для синтаксического парсинга‚ то есть анализа грамматической структуры предложения․ Мы можем легко определить части речи (POS-теггинг)‚ зависимости между словами и даже построить дерево синтаксического разбора․ Это открывает нам двери к пониманию не только отдельных слов‚ но и их взаимосвязей в предложении‚ что критически важно для более сложных задач․

| Операция | Описание | Пример (слово "бежали") | Используемая библиотека |

|---|---|---|---|

| Стемминг | Усечение слова до его корневой формы‚ часто без учета грамматики․ Может давать несловарные формы․ | беж | NLTK (PorterStemmer‚ SnowballStemmer) |

| Лемматизация | Приведение слова к его словарной форме (лемме) с учетом части речи и морфологии․ | бежать | spaCy‚ NLTK (WordNetLemmatizer) |

Регулярные выражения и очистка текста

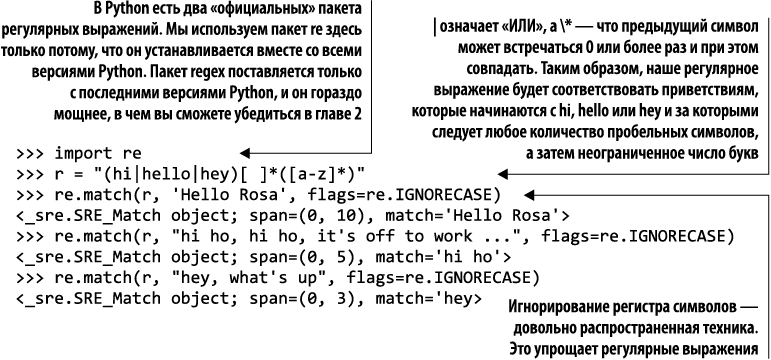

Помимо токенизации и лемматизации‚ часто требуется удалить из текста "шум": HTML-теги‚ пунктуацию‚ цифры‚ символы эмодзи или специфический сленг․ Мы активно используем регулярные выражения (модуль `re` в Python) для этих целей․ Они позволяют нам находить и заменять паттерны в тексте‚ будь то удаление всех ссылок или приведение к нижнему регистру․ Очистка данных – это итеративный процесс‚ где мы постоянно адаптируем наши правила в зависимости от специфики данных․

- Очистка от HTML-тегов: Удаляем все теги‚ которые могут быть в тексте‚ полученном из веб-источников․

- Нормализация пунктуации: Заменяем множественные пробелы на один‚ удаляем лишние знаки препинания или приводим их к единому стилю․

- Работа с эмодзи и сленгом: В современных текстах‚ особенно из социальных сетей‚ это становится критически важным․ Мы либо удаляем их‚ либо пытаемся нормализовать до текстового описания․

- Удаление стоп-слов: Слова вроде "и"‚ "в"‚ "на"‚ "он" не несут значимой смысловой нагрузки и часто удаляются‚ чтобы сократить размер данных и улучшить производительность моделей․

Библиотека `Textacy` предлагает более высокоуровневые инструменты для очистки и нормализации текста‚ что позволяет нам более эффективно управлять этим сложным процессом․ Мы также можем использовать `PyMuPDF` для извлечения текста из PDF-документов‚ что является частой задачей при работе с неструктурированными данными․

Понимание смысла: От слов к векторам

После того как текст очищен и предобработан‚ возникает новая задача: как представить слова таким образом‚ чтобы машина могла с ними работать? Компьютеры понимают числа‚ а не слова․ Здесь мы переходим к векторизации – процессу превращения текстовых данных в числовые векторы․

Классические векторизаторы: CountVectorizer и TfidfVectorizer

Начали мы с простых‚ но эффективных методов․ `CountVectorizer` из Scikit-learn создает матрицу‚ где каждая строка – это документ‚ каждый столбец – уникальное слово из всего корпуса‚ а значение в ячейке – количество вхождений этого слова в документ․ Это простая частотная модель․

Однако простое количество слов не всегда отражает их важность․ Слово "вода" может часто встречаться в статьях о биологии‚ но это не делает его ключевым․ Здесь на помощь приходит `TfidfVectorizer` (Term Frequency-Inverse Document Frequency)․ TF-IDF учитывает не только частоту слова в документе (TF)‚ но и его редкость во всем корпусе документов (IDF)․ Чем реже слово встречается в других документах‚ тем выше его важность․ Мы активно применяем TF-IDF для задач классификации и извлечения ключевых фраз‚ поскольку он прекрасно улавливает уникальность терминов для каждого документа․

Word Embeddings: Word2Vec и GloVe с Gensim

Классические методы векторизации имеют один существенный недостаток: они не улавливают семантические связи между словами․ Слова "король" и "царь" будут для них так же далеки‚ как "король" и "стол"․ Революцию здесь произвели Word Embeddings – векторные представления слов‚ которые отображают их семантическое и синтаксическое сходство․

Мы активно используем библиотеку Gensim для работы с Word2Vec и GloVe․ Word2Vec‚ предложенный Google‚ учится представлять слова в виде плотных векторов таким образом‚ что слова со схожим контекстом располагаются близко друг к другу в многомерном пространстве․ Это позволяет нам выполнять арифметические операции со словами‚ например‚ "король" ⏤ "мужчина" + "женщина" ≈ "королева"․ GloVe (Global Vectors for Word Representation) – еще один популярный метод‚ который сочетает в себе глобальную статистику со статистикой локального контекста․

Эти эмбеддинги стали основой для многих наших проектов‚ значительно улучшив качество моделей в задачах‚ где понимание смысла слов имеет первостепенное значение; Gensim также предлагает Doc2Vec для векторизации целых документов‚ что позволяет нам сравнивать документы на основе их смыслового содержания․ FastText‚ расширение Word2Vec‚ способен работать с редкими словами и даже с теми‚ которых не было в обучающем корпусе‚ разбивая слова на символьные n-граммы․

Контекстные встраивания и трансформеры (Hugging Face)

Несмотря на все преимущества‚ Word Embeddings имеют одно ограничение: каждое слово имеет одно фиксированное векторное представление‚ независимо от контекста․ Слово "банк" будет иметь один и тот же вектор в предложениях "сидеть на берегу банка" и "взять кредит в банке"․

Здесь на сцену вышли трансформеры и контекстные встраивания․ Такие модели‚ как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer)‚ разработанные‚ в частности‚ Google и OpenAI‚ изменили правила игры․ С помощью библиотеки Hugging Face Transformers мы можем легко загружать и использовать предварительно обученные модели‚ которые генерируют векторные представления слов‚ учитывающие их контекст в предложении․ Это означает‚ что слово "банк" будет иметь разные векторы в зависимости от его значения․

"Язык – это карта‚ а не территория․ Он ведет нас к пониманию‚ но сам по себе не является реальностью․"

Мы используем трансформеры для самых сложных задач: от классификации текста с высокой точностью до распознавания именованных сущностей и даже генерации текста․ Тонкая настройка (Fine-tuning) этих моделей на наших собственных данных позволяет достигать результатов‚ которые еще несколько лет назад казались фантастикой․ Sentence Transformers позволяют нам векторизовать целые предложения и документы‚ сохраняя при этом семантику․

Задачи NLP: От простого к сложному

Теперь‚ когда мы умеем подготавливать текст и представлять его в числовом виде‚ перед нами открывается целый спектр задач‚ которые можно решать с помощью NLP․

Распознавание именованных сущностей (NER)

NER – это задача по извлечению и классификации именованных сущностей из текста‚ таких как имена людей‚ организаций‚ географические названия‚ даты и т․д․ Например‚ в предложении "Илон Маск посетил Берлин 15 мая"‚ NER выделит "Илон Маск" как PERSON‚ "Берлин" как GPE (геополитическая сущность) и "15 мая" как DATE․

Мы используем spaCy для быстрого NER‚ так как оно поставляется с предварительно обученными моделями‚ которые работают очень эффективно․ Для более сложных случаев или языков с богатой морфологией мы обращаемся к Flair и Stanza․ Flair известен своими мощными контекстными эмбеддингами‚ которые значительно улучшают качество NER․ Для русского языка Stanza от Stanford NLP – наш выбор‚ поскольку он предоставляет глубокий морфологический и синтаксический анализ․ Мы также исследуем применение CRF (Conditional Random Fields) для распознавания сущностей‚ особенно в случаях‚ когда данных для обучения глубоких нейросетей недостаточно․

Тематическое моделирование (LDA‚ LSI) с Gensim

Часто нам нужно понять‚ о чем говорят большие объемы текста‚ выявить скрытые темы и паттерны․ Здесь на помощь приходит тематическое моделирование․ Мы используем библиотеку Gensim для реализации LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․

LDA – это генеративная статистическая модель‚ которая предполагает‚ что каждый документ является смесью нескольких тем‚ а каждая тема – это смесь слов․ Это позволяет нам не только обнаружить основные темы в корпусе документов‚ но и понять‚ какие слова наиболее характерны для каждой темы․ LSI‚ с другой стороны‚ использует метод сингулярного разложения для выявления скрытых семантических связей между словами и документами․

- Подготовка данных: Токенизация‚ удаление стоп-слов‚ лемматизация․

- Создание словаря: Сопоставление каждого уникального слова с уникальным ID․

- Векторизация: Преобразование документов в формат "мешка слов" (Bag-of-Words) или TF-IDF․

- Обучение модели: Применение LDA или LSI к векторизованным данным․

- Анализ результатов: Интерпретация тем и их ключевых слов‚ присвоение тем документам․

Мы часто сравниваем модели тематического моделирования‚ такие как LDA и NMF (Non-negative Matrix Factorization)‚ чтобы выбрать наиболее подходящую для конкретной задачи‚ будь то анализ текстов отзывов клиентов или финансовых новостей․

Анализ тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – крайне важная задача для бизнеса и социальных наук․ Мы стремимся определить‚ является ли отзыв положительным‚ отрицательным или нейтральным․ Для этого мы используем несколько подходов:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это лексический инструмент‚ который отлично подходит для анализа тональности в социальных сетях (Twitter‚ Reddit)‚ так как он учитывает сленг‚ эмодзи и акронимы․ Мы используем его для быстрого и эффективного анализа тональности сообщений․

- TextBlob: Для более простого NLP и быстрого прототипирования TextBlob предлагает удобный интерфейс для определения полярности и субъективности текста․

- Машинное обучение: Для более точного анализа мы обучаем собственные модели классификации с использованием Scikit-learn (SVM‚ Наивный Байес) или глубоких нейросетей (PyTorch/TensorFlow) с трансформерами․ Это позволяет нам адаптироваться к специфике доменной области‚ например‚ анализу тональности финансовых новостей‚ где лексика может быть весьма специфичной․

Мы также работаем над более сложными задачами‚ такими как анализ тональности с учетом сарказма‚ что представляет собой одну из самых трудных проблем в NLP․

Классификация текстов со Scikit-learn и PyTorch/TensorFlow

Классификация текста – это задача присвоения тексту одной или нескольких предопределенных категорий или меток․ Будь то спам-фильтр‚ категоризация новостных статей или маршрутизация обращений клиентов‚ классификация – это то‚ с чем мы сталкиваемся ежедневно․

Мы начинаем с классических методов машинного обучения из Scikit-learn‚ таких как SVM (Support Vector Machines) и наивный байесовский классификатор․ Они требуют хорошо векторизованных данных (например‚ TF-IDF или Word2Vec) и часто дают отличные результаты‚ особенно на средних объемах данных․

Для более сложных задач и больших объемов данных мы переходим к глубокому обучению‚ используя PyTorch или TensorFlow․ Мы строим LSTM-сети (Long Short-Term Memory) для обработки последовательностей‚ а также активно применяем BERT для задач классификации‚ поскольку он дает state-of-the-art результаты за счет своего контекстного понимания языка․ Тонкая настройка предварительно обученных моделей BERT на наших специфических данных позволяет нам достигать впечатляющей точности․

Разработка систем суммаризации текста

В современном мире информации‚ где каждый день мы сталкиваемся с огромными объемами текста‚ автоматическая суммаризация становиться бесценным инструментом․ Мы работаем над двумя основными типами суммаризации:

- Экстрактивная суммаризация: Это когда система выбирает наиболее важные предложения из исходного текста и объединяет их для создания краткого обзора․ Мы используем алгоритмы вроде TextRank (реализованные‚ например‚ в библиотеке Textacy или Gensim)‚ который строит граф предложений и ранжирует их по важности․

- Абстрактивная суммаризация: Это более сложный подход‚ при котором система генерирует новые предложения‚ которые могут не присутствовать в исходном тексте‚ но передают его основной смысл․ Здесь мы полагаемся на трансформерные модели (Hugging Face)‚ которые обучаются генерировать связный и краткий текст․

Сравнение моделей суммирования показывает‚ что абстрактивные методы‚ хотя и сложнее в реализации‚ предлагают более человекоподобные и краткие резюме‚ особенно для больших текстов․

Расширенные возможности и прикладные области

NLP не ограничивается только анализом слов и предложений․ Мы используем его для решения широкого круга прикладных задач‚ которые трансформируют целые индустрии․

Создание чат-ботов и вопросно-ответных систем

Разработка чат-ботов – это одно из самых популярных применений NLP․ Мы используем фреймворк Rasa‚ который позволяет нам создавать контекстно-зависимых‚ интерактивных чат-ботов․ Rasa сочетает в себе понимание естественного языка (NLU) и управление диалогом‚ что позволяет ботам не просто отвечать на вопросы‚ но и вести осмысленные беседы․

Вопросно-ответные системы (QA) – это еще более сложная задача‚ где система должна не просто понять вопрос‚ но и найти точный ответ в большом корпусе документов․ Здесь мы активно применяем трансформерные модели‚ такие как BERT‚ которые могут быть тонко настроены для извлечения ответов из текста․ Разработка систем для создания FAQ на основе документов также является смежной задачей‚ которую мы решаем с помощью суммаризации и извлечения ключевых фраз․

Анализ текста для извлечения информации

Извлечение ключевых фраз‚ терминов и фактов из текста – это фундаментальная задача для многих приложений․ Мы используем различные методы:

- N-граммы: Анализ частотности n-грамм (последовательностей из N слов) помогает выявить устойчивые словосочетания и фразы․

- RAKE (Rapid Automatic Keyword Extraction): Это алгоритм для извлечения ключевых слов и фраз на основе их частотности и встречаемости в пределах одного предложения․

- TextRank: Помимо суммаризации‚ TextRank также эффективно извлекает ключевые фразы‚ ранжируя их по важности в тексте․

- Извлечение дат и чисел: С помощью регулярных выражений и специализированных библиотек мы можем точно извлекать временные сущности и числовые данные․

Мы также работаем над разработкой моделей для выявления связей между сущностями (например‚ кто кому принадлежит‚ или кто что сделал)‚ что является следующим уровнем извлечения информации․

Работа с многоязычными текстовыми корпусами

Мир не ограничивается одним языком‚ и наши NLP-решения тоже․ Мы активно работаем с многоязычными текстовыми корпусами‚ используя такие библиотеки‚ как Polyglot и Stanza․ Polyglot предоставляет широкий спектр функций для многих языков‚ включая токенизацию‚ распознавание языка‚ NER и POS-теггинг․ Stanza‚ как уже упоминалось‚ особенно хорош для языков с богатой морфологией‚ таких как русский‚ предлагая глубокий лингвистический анализ․

| Библиотека | Основные возможности | Преимущества |

|---|---|---|

| Polyglot | Распознавание языка‚ токенизация‚ NER‚ морфологический анализ для многих языков․ | Широкая поддержка языков‚ простота использования для базовых задач․ |

| Stanza | Токенизация‚ POS-теггинг‚ лемматизация‚ синтаксический анализ‚ NER для 70+ языков‚ включая русский․ | Глубокий лингвистический анализ‚ высокая точность‚ особенно для морфологически богатых языков․ |

| Hugging Face Transformers | Многоязычные трансформерные модели (mBERT‚ XLM-R) для различных задач․ | State-of-the-art результаты‚ контекстное понимание языка‚ возможность тонкой настройки․ |

Разработка систем машинного перевода на Python‚ особенно с использованием трансформерных моделей‚ также является одним из наших направлений․ Мы стремимся создавать системы для автоматического перевода узкоспециализированных текстов‚ где требуется высокая точность и сохранение специфической терминологии․

Анализ стилистики и авторского почерка

Иногда нам нужно не просто понять содержание‚ но и определить‚ кто написал текст или каков его стиль․ Это область стилометрии․ Мы анализируем лексическое богатство‚ частотность функциональных слов‚ длину предложений и другие метрики‚ чтобы построить "отпечаток" автора․ Это может быть полезно для:

- Определения авторства текста: В юридических и исторических исследованиях․

- Обнаружения плагиата: Сравнение документов с использованием метрик сходства (TextDistance‚ Jellyfish)․

- Анализа поведенческих паттернов: В чатах или отзывах‚ чтобы понять‚ как меняется стиль коммуникации․

Мы также используем Textdistance для измерения сходства между строками и документами‚ что критически важно для поиска дубликатов и плагиата․

Инструменты и экосистема Python для NLP

За нашим успехом в NLP стоит мощная и постоянно развивающаяся экосистема Python․ Мы используем множество библиотек‚ каждая из которых решает свои уникальные задачи․

- NLTK: Наш стартовый набор для обучения и базовой предобработки – токенизация‚ стемминг‚ POS-теггинг‚ морфологический анализ․

- spaCy: Наша "рабочая лошадка" для промышленного NLP – быстрый NER‚ синтаксический парсинг‚ лемматизация․

- Gensim: Незаменим для тематического моделирования (LDA‚ LSI) и работы с Word Embeddings (Word2Vec‚ GloVe‚ Doc2Vec)․

- Scikit-learn: Основа для классификации текстов‚ кластеризации и разработки собственных векторизаторов (CountVectorizer‚ TfidfVectorizer)․

- Hugging Face Transformers: Наш выбор для state-of-the-art решений на основе трансформерных моделей – NER‚ классификация‚ суммаризация‚ генерация текста․

- PyTorch/TensorFlow/Keras: Для создания нейронных сетей‚ тонкой настройки глубоких моделей‚ реализации LSTM-сетей и других сложных архитектур․

- TextBlob: Для быстрого прототипирования и простого анализа тональности и языка․

- Beautiful Soup: Для веб-скрейпинга текста‚ когда данные нужно собрать из интернета․

- Stanza: Специализированный инструмент для глубокого лингвистического анализа‚ особенно для языков с богатой морфологией․

- Polyglot: Для мультиязычной обработки и анализа редких языков․

- VADER: Для специфического анализа тональности в социальных сетях․

- Textacy: Расширенный набор инструментов для предобработки‚ извлечения информации и работы с зависимостями․

- Sweetviz: Для быстрого анализа текстовых данных и их визуализации․

- Jellyfish/TextDistance: Для сравнения строк‚ поиска дубликатов и измерения сходства․

- PyMuPDF: Для извлечения текста из PDF-документов․

- Rasa: Для разработки диалоговых систем и чат-ботов․

- Flair: Для современного NER и контекстных эмбеддингов․

- Gentle: Для распознавания речи (Speech-to-Text)‚ когда нам нужно перевести аудио в текст для дальнейшей обработки․

Мы также используем инструменты для визуализации текстовых данных‚ такие как Word Clouds для анализа частотности слов и Heatmaps для визуализации матриц сходства‚ что помогает нам лучше понять наши данные․

Вызовы и перспективы NLP

Несмотря на впечатляющие достижения‚ мир NLP полон вызовов․ Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных‚ сарказма‚ иронии и других нюансов человеческого языка‚ которые сложно формализовать․

- Неполные и ошибочные данные: Орфографические ошибки‚ опечатки‚ сокращения – все это требует надежных инструментов для исправления орфографии и нормализации текста․

- Сарказм и эмоции: Анализ тональности сообщений в социальных сетях с учетом сарказма и сложных эмоций остается активной областью исследований․ Мы используем трансформерные архитектуры для распознавания эмоций‚ но это все еще сложная задача․

- Многоязычность и редкие языки: Хотя инструменты развиваются‚ работа с языками‚ для которых мало обучающих данных‚ все еще является серьезным барьером․

- Реальное время: Обработка текста в режиме реального времени (Streaming NLP) требует оптимизации алгоритмов и использования GPU-ускорения․

- Автоматическая разметка данных: Создание высококачественных размеченных корпусов данных для обучения моделей часто является трудоемким процессом․ Мы работаем над инструментами для автоматической разметки данных и сущностей․

Будущее NLP обещает еще больше прорывов․ Мы видим‚ как трансформерные модели продолжают совершенствоваться‚ открывая новые горизонты для генерации текста (от статей до кода)‚ создания более интеллектуальных диалоговых систем и глубокого анализа сложной информации‚ такой как юридические документы или медицинские записи․ Тонкая настройка предварительно обученных моделей и разработка более эффективных архитектур для работы с большими текстовыми массивами (Big Data NLP) – это те направления‚ где мы ожидаем наибольшего прогресса․

Итак‚ мы совершили увлекательное путешествие по миру обработки естественного языка‚ от первых шагов токенизации до сложнейших нейросетевых архитектур․ Мы увидели‚ как Python‚ с его обширной коллекцией библиотек‚ стал незаменимым инструментом для каждого‚ кто хочет научить машину понимать человеческий язык․ От анализа тональности отзывов клиентов до создания умных чат-ботов и систем машинного перевода – возможности NLP безграничны․

Мы‚ как блогеры и исследователи‚ продолжаем экспериментировать‚ учиться и делиться своим опытом‚ потому что верим‚ что ключ к будущему лежит в способности машин и людей эффективно взаимодействовать․ И этот диалог с текстом‚ который мы ведем с помощью Python‚ только начинается․ Присоединяйтесь к нам‚ ведь впереди еще много интересного!

Подробнее: LSI Запросы

| Python NLTK основы | spaCy NER туториал | Gensim LDA Word2Vec | Scikit-learn классификация текста | Hugging Face Transformers применение |

| Анализ тональности Python | Word Embeddings сравнение | Разработка чат-ботов Rasa | Извлечение ключевых фраз NLP | Лемматизация vs Стемминг |