- Разговор с Машиной: Наш Глубокий Дайв в Мир NLP с Python

- Первые Шаги: Основы NLTK и spaCy

- Глубже в Токенизацию и Стемминг

- Магия Смысла: Тематическое Моделирование и Векторные Представления

- Gensim: Открывая Скрытые Темы

- Word Embeddings: Слово как Вектор

- Преобразование Текста в Данные: Векторизаторы и Регулярные Выражения

- Собственные Векторизаторы: От Частот до Значимости

- Регулярные Выражения (re) для Идеальной Чистоты

- Классификация и Анализ: Scikit-learn и Анализ Тональности

- Scikit-learn: Наш Выбор для Классификации

- Анализ Тональности (Sentiment Analysis): Понимая Эмоции

- Передовые Методы: Трансформеры и Глубокое Обучение

- Hugging Face и Трансформеры: Новая Эра NLP

- PyTorch/TensorFlow для Нейросетей NLP

- Практическое Применение и Специализированные Инструменты

- Извлечение Информации: От Веб-страниц до PDF

- Многоязычность и Сложная Морфология

- Суммаризация и Извлечение Ключевых Фраз

- Чат-боты и Диалоговые Системы

- Визуализация, Оценка и Будущее NLP

- Инструменты для Визуализации Текстовых Данных

- Оценка Качества Моделей

- Что Дальше?

Разговор с Машиной: Наш Глубокий Дайв в Мир NLP с Python

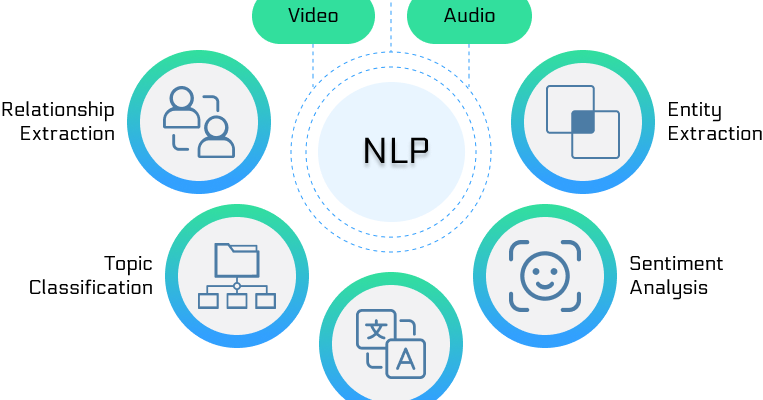

Приветствуем вас, дорогие читатели и коллеги-энтузиасты! Сегодня мы отправляемся в увлекательное путешествие по миру Обработки Естественного Языка (NLP), той самой области, где машины учатся понимать, интерпретировать и даже генерировать человеческую речь․ В нашей практике мы убедились, что это не просто набор сложных алгоритмов, а целый инструментарий, способный преобразить множество сфер, от клиентской поддержки до глубокого анализа данных․ Мы расскажем вам о том, как Python стал нашим верным спутником в освоении этого безграничного пространства, и поделимся личным опытом работы с ключевыми библиотеками и методами, которые изменили наш подход к тексту․

Погружение в NLP всегда казалось нам чем-то вроде освоения нового языка — языка, на котором говорят данные․ С каждым новым проектом мы открывали для себя удивительные возможности: как из хаотичного потока слов извлечь ценные идеи, как научить компьютер "читать между строк", как автоматизировать рутинные задачи, связанные с текстом․ Эта статья — наш путеводитель, основанный на практическом применении и многолетнем опыте, который поможет вам уверенно ориентироваться в этом захватывающем направлении․ Приготовьтесь, будет интересно!

Первые Шаги: Основы NLTK и spaCy

Наш путь в мир NLP начался с фундаментальных библиотек, которые по праву считаются краеугольными камнями в арсенале любого специалиста․ Мы говорим, конечно же, о NLTK (Natural Language Toolkit) и spaCy․ Эти инструменты позволили нам понять самые базовые, но при этом крайне важные операции, без которых не обходится ни один проект по обработке текста․ Мы увидели, как сырой текст превращается в структурированные данные, готовые к дальнейшему анализу․

NLTK, с его обширным набором алгоритмов и корпусов, стал для нас своего рода университетским курсом по NLP․ Именно здесь мы впервые столкнулись с понятиями токенизации и стемминга․ Токенизация — это процесс разбиения текста на отдельные слова или предложения, а стемминг — приведение слов к их базовой форме путём отсечения суффиксов и окончаний․ Несмотря на свою простоту, эти операции заложили основу для всего, что мы делали в дальнейшем․ Мы научились различать слова, понимать их количество и распределение, что было критически важно для первых экспериментов․

Затем в нашу жизнь ворвалась библиотека spaCy, которая сразу же покорила нас своей скоростью и элегантностью․ Если NLTK мы использовали для изучения основ и проведения экспериментов, то spaCy стал нашим выбором для проектов, требующих высокой производительности․ Одной из самых впечатляющих возможностей spaCy, которую мы активно применяли, является Распознавание Именованных Сущностей (NER)․ Это позволяет автоматически находить и классифицировать в тексте такие объекты, как имена людей, названия организаций, географические положения, даты и многое другое․ Представьте, сколько времени это экономит при анализе больших объёков данных!

Давайте посмотрим на основные различия и сферы применения этих двух гигантов:

| Характеристика | NLTK | spaCy |

|---|---|---|

| Назначение | Исследования, обучение, широкий спектр алгоритмов | Производственные системы, скорость, готовые модели |

| Скорость | Относительно медленный | Очень быстрый |

| Модели | Требует загрузки отдельных корпусов и моделей | Поставляется с готовыми, оптимизированными моделями |

| Основные функции | Токенизация, стемминг, лемматизация, синтаксический анализ | NER, синтаксический анализ, лемматизация, векторные представления |

| Гибкость | Высокая, для детального контроля | Хорошая, но с упором на производительность |

Глубже в Токенизацию и Стемминг

Токенизация — это не просто разделение текста пробелами․ Мы быстро поняли, что существует множество нюансов: как обрабатывать пунктуацию, числа, сокращения, хештеги или смайлики․ NLTK предлагает различные токенизаторы, например, для предложений или слов, учитывающие особенности языка․ Это позволяет нам получать более чистые и осмысленные единицы для дальнейшего анализа․ Стемминг же, хотя и прост в реализации, имеет свои ограничения: он может обрезать слова слишком сильно, теряя при этом их первоначальный смысл или превращая их в несуществующие слова․ Например, "универсальный" и "универсальность" могут быть сведены к "универсальн"․

Поэтому в нашей практике мы часто переходили от простого стемминга к лемматизации, особенно когда требовалась высокая точность․ Лемматизация, в отличие от стемминга, приводит слово к его словарной (нормальной) форме, используя морфологический анализ․ Так, "бегу", "бежал", "бежит" будут приведены к "бежать"․ Это значительно улучшает качество анализа, особенно в задачах, где важен точный смысл слова․ Мы использовали как возможности NLTK, так и более продвинутые лемматизаторы, предоставляемые spaCy и Stanza, особенно для языков с богатой морфологией, таких как русский․

Магия Смысла: Тематическое Моделирование и Векторные Представления

После того как мы научились разбирать текст на части, следующим логичным шагом стало понимание его глубинного смысла․ Как найти скрытые темы в огромном массиве документов? Как научить компьютер понимать, что слова "автомобиль" и "машина" близки по смыслу, а "банк" в значении финансовой организации отличается от "банка" для консервации? Ответы на эти вопросы мы нашли в тематическом моделировании и векторных представлениях слов․

Gensim: Открывая Скрытые Темы

Библиотека Gensim стала для нас настоящим открытием в мире тематического моделирования․ Мы использовали её для реализации таких алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Эти методы позволяют нам автоматически выявлять абстрактные "темы" в коллекции документов․ Например, анализируя тысячи новостных статей, мы можем обнаружить темы, связанные с "политикой", "спортом", "экономикой" или "технологиями", даже если эти слова прямо не указаны в заголовках․ Это невероятно мощный инструмент для анализа больших текстовых массивов, таких как отзывы клиентов или публикации в социальных сетях․

В нашей практике мы часто применяли LDA для следующих задач:

- Анализ отзывов клиентов: Выявление наиболее частых проблем или преимуществ продуктов/услуг․

- Категоризация статей: Автоматическое присвоение тематических меток новым документам․

- Исследование трендов: Отслеживание изменений в интересах аудитории на основе текстовых данных․

Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), показало нам, что выбор метода часто зависит от конкретной задачи и характеристик данных․ LDA хорошо работает с предположением о распределении слов по темам, в то время как NMF может быть более интерпретируемым за счет неотрицательности компонентов․

Word Embeddings: Слово как Вектор

Но что, если мы хотим не просто найти темы, а понять тонкие семантические связи между отдельными словами? Здесь на помощь приходят Word Embeddings – векторные представления слов․ Мы активно использовали модели Word2Vec и GloVe, также доступные через Gensim․ Эти модели обучаются на огромных корпусах текста и присваивают каждому слову вектор из сотен чисел․ Удивительная особенность этих векторов заключается в том, что слова с похожим значением или контекстом располагаются близко друг к другу в многомерном пространстве․

Мы часто демонстрируем это на примере: если взять вектор слова "король", вычесть вектор "мужчина" и прибавить вектор "женщина", мы получим вектор, очень близкий к вектору слова "королева"․ Это открывает двери для:

- Поиска синонимов и связанных слов․

- Определения смысловой близости между документами․

- Улучшения производительности многих NLP-задач, таких как классификация текста․

Помимо Word2Vec и GloVe, мы также работали с FastText, особенно для задач, где важна работа с редкими словами или морфологически богатыми языками․ FastText способен создавать векторы для слов, которые не встречались в обучающем корпусе, за счет анализа их субсловных единиц (символьных n-грамм), что делает его незаменимым инструментом в определенных сценариях․

"Язык — это не просто набор символов; это система, которая отражает наше мышление, наши связи и наш мир․ Понимание этого, первый шаг к созданию интеллектуальных машин․"

Преобразование Текста в Данные: Векторизаторы и Регулярные Выражения

Прежде чем мы сможем подать текст в любую модель машинного обучения, его необходимо преобразовать в числовой формат․ Это процесс, который мы называем векторизацией․ Мы сталкивались с различными подходами, каждый из которых имеет свои преимущества в зависимости от задачи․

Собственные Векторизаторы: От Частот до Значимости

В Scikit-learn мы нашли мощные и гибкие инструменты для создания числовых представлений текста․ CountVectorizer, например, просто подсчитывает частоту каждого слова в документе․ Это простой, но эффективный метод, который мы часто использовали для быстрых экспериментов или когда важна абсолютная частотность слов․ Однако, его недостаток — он не учитывает значимость слова: очень частые слова (стоп-слова) могут доминировать․

Для более тонкого анализа мы переходили к TfidfVectorizer (Term Frequency-Inverse Document Frequency)․ Этот векторизатор не только учитывает частоту слова в документе, но и его редкость во всем корпусе․ Слова, которые часто встречаются в одном документе, но редко в других, получают более высокий вес, что делает их более значимыми․ Мы применяли TF-IDF для:

- Классификации текстов, где уникальные слова являются сильными признаками категории․

- Извлечения ключевых фраз, поскольку слова с высоким TF-IDF часто являются индикаторами основной темы․

- Поиска похожих документов, основываясь на их векторных представлениях․

Регулярные Выражения (re) для Идеальной Чистоты

Любой, кто работал с реальными текстовыми данными, знает, что они редко бывают чистыми․ HTML-теги, случайные символы, URL-адреса, эмодзи, сленг – всё это требует предварительной обработки․ Здесь нашими незаменимыми помощниками стали регулярные выражения (библиотека `re` в Python)․ Мы научились использовать их для:

- Очистки от HTML-тегов: Удаление разметки из веб-страниц, полученных через веб-скрейпинг (например, с использованием Beautiful Soup)․

- Нормализации пунктуации: Замена множественных пробелов на одинарные, удаление лишних символов․

- Обработки эмодзи и сленга: Приведение их к стандартизированному виду или удаление, в зависимости от задачи․

- Извлечения специфической информации: Дат, чисел, email-адресов, телефонных номеров․

Эти операции критически важны, поскольку "мусор" в данных может существенно исказить результаты последующего анализа․ Мы всегда уделяем особое внимание этапу предобработки, так как чистота данных — залог успеха в NLP․

Классификация и Анализ: Scikit-learn и Анализ Тональности

Когда текст преобразован в числа, мы можем применять мощные алгоритмы машинного обучения для решения самых разнообразных задач․ Классификация текста и анализ тональности — одни из наиболее востребованных направлений в нашей практике․

Scikit-learn: Наш Выбор для Классификации

Библиотека Scikit-learn — это швейцарский нож для машинного обучения, и мы активно используем её для классификации текстов․ Будь то категоризация новостных статей, фильтрация спама или распределение обращений клиентов по темам, Scikit-learn предоставляет широкий спектр алгоритмов: от простых наивных байесовских классификаторов до более сложных SVM (Support Vector Machines) и логистической регрессии․

Наш типичный пайплайн для классификации выглядит так:

- Предварительная обработка текста: Токенизация, лемматизация, удаление стоп-слов, очистка․

- Векторизация текста: TF-IDF или Word Embeddings․

- Обучение модели: Выбор классификатора (например, `SGDClassifier` или `LogisticRegression`) и его обучение на размеченных данных․

- Оценка качества: Использование метрик, таких как F1-score, Precision, Recall для оценки производительности модели․

Мы часто проводим сравнение различных методов машинного обучения для NLP, чтобы определить, какой из них лучше всего подходит для конкретной задачи․ Например, наивный байесовский классификатор часто показывает хорошие результаты на небольших и средних наборах данных, а SVM может быть эффективным для более сложных задач с большим количеством признаков․

Анализ Тональности (Sentiment Analysis): Понимая Эмоции

Понимание эмоциональной окраски текста, бесценный навык в современном мире, особенно для бизнеса․ Мы активно применяли анализ тональности для оценки отзывов клиентов, комментариев в социальных сетях и даже финансовых новостей․ Одним из первых инструментов, который мы освоили для этой цели, был VADER (Valence Aware Dictionary and sEntiment Reasoner), входящий в NLTK․ VADER особенно хорош тем, что он учитывает такие нюансы, как восклицательные знаки, заглавные буквы и даже смайлики, что делает его весьма эффективным для анализа коротких, неформальных текстов из социальных сетей․

Однако, мы быстро поняли, что VADER, будучи правилосообразным, не всегда справляется со сложными случаями, такими как сарказм или контекстно-зависимая тональность․ Для более глубокого анализа тональности, особенно в отзывах о продуктах по категориям или в политических постах, мы начали разрабатывать собственные модели на основе машинного обучения, обучая их на размеченных корпусах․ Это позволило нам значительно повысить точность, особенно при работе с тональностью сообщений в социальных сетях (Twitter/Reddit), где язык часто бывает очень специфическим․

Также мы использовали TextBlob для простого NLP и анализа тональности, что оказалось удобным для быстрых прототипов․ TextBlob предоставляет интуитивно понятный интерфейс для многих задач NLP, включая определение тональности, что делает его отличной отправной точкой для новичков․

Передовые Методы: Трансформеры и Глубокое Обучение

Последние годы принесли революционные изменения в мир NLP благодаря появлению трансформерных архитектур и глубокого обучения․ Эти технологии позволили нам решать задачи, которые ранее казались недостижимыми, значительно превзойдя классические методы по качеству и возможностям․

Hugging Face и Трансформеры: Новая Эра NLP

Когда мы впервые столкнулись с библиотекой Hugging Face Transformers, это было как переход от кнопочного телефона к смартфону․ Эти модели, такие как BERT, GPT, RoBERTa, обучены на огромных объёмах текстовых данных и способны понимать контекст слов с беспрецедентной точностью․ Мы применяли их для широкого круга сложных задач NLP:

- Классификация текста: Значительно улучшая точность по сравнению с традиционными методами․

- Распознавание именованных сущностей (NER): Достигая state-of-the-art результатов․

- Вопросно-ответные системы (QA): Позволяя моделям находить точные ответы в больших текстах․

- Генерация текста: Создавая связные и осмысленные предложения и даже целые абзацы (например, с GPT-моделями)․

Особенно впечатляющей для нас стала возможность тонкой настройки (Fine-tuning) предварительно обученных моделей․ Это означает, что мы можем взять уже обученную на общем корпусе модель (например, BERT) и дообучить её на наших специфических данных для конкретной задачи, получая при этом выдающиеся результаты даже с относительно небольшим объёмом размеченных данных․

PyTorch/TensorFlow для Нейросетей NLP

Для создания собственных нейросетей, когда готовых решений трансформеров недостаточно или требуется более глубокий контроль над архитектурой, мы активно используем фреймворки PyTorch и TensorFlow․ С их помощью мы разрабатывали:

- LSTM-сети: Для задач, где важна последовательность слов, например, при анализе временных рядов в текстовых данных․

- Комплексные архитектуры: Объединяя различные слои и механизмы внимания для решения уникальных задач, таких как выявление связей между сущностями или контекстное встраивание․

Работа с этими фреймворками требует более глубоких знаний в области глубокого обучения, но даёт нам неограниченные возможности для экспериментов и создания по-настоящему кастомных решений․ Мы также исследовали возможности GPU-ускорения для обработки больших текстовых массивов, что значительно сокращает время обучения сложных моделей․

Практическое Применение и Специализированные Инструменты

Теория и алгоритмы, это хорошо, но настоящий интерес к NLP у нас просыпается тогда, когда мы видим, как эти инструменты решают реальные задачи․ За годы работы мы собрали целый арсенал специализированных библиотек и подходов для различных сценариев․

Извлечение Информации: От Веб-страниц до PDF

Прежде чем анализировать текст, его нужно откуда-то получить․ Здесь на помощь приходит Beautiful Soup для веб-скрейпинга текста․ Мы использовали её для извлечения контента с веб-сайтов, будь то новостные статьи, отзывы или описания продуктов․ Это позволяет нам собирать огромные объёмы неструктурированных данных для последующей обработки․

Но текст не всегда находится в интернете․ Часто нам приходится работать с документами в формате PDF․ Для этого мы освоили PyMuPDF для извлечения текста из PDF․ Это позволило нам автоматизировать анализ юридических документов, научных статей или финансовых отчётов, которые часто распространяются именно в этом формате․

Многоязычность и Сложная Морфология

Мир не ограничивается английским языком․ Мы активно работали с многоязычными текстовыми корпусами․ Для этих задач нам пригодились такие библиотеки, как Polyglot и Stanza․ Polyglot отлично подходит для базовых задач, таких как токенизация и распознавание языка для множества языков․ Stanza (от Stanford NLP Group) оказалась особенно мощной для языков с богатой морфологией, предоставляя высококачественные модели для POS-теггинга, лемматизации и синтаксического парсинга, в т․ч․ для русского языка․

| Инструмент | Основные Возможности | Примеры Использования |

|---|---|---|

| Beautiful Soup | Парсинг HTML/XML, извлечение данных с веб-страниц | Сбор новостных статей, отзывов, данных для анализа |

| PyMuPDF | Извлечение текста, изображений из PDF-документов | Автоматическая обработка юридических документов, отчетов |

| Polyglot | Многоязычная токенизация, NER, определение языка | Анализ глобальных медиа, поддержка нескольких языков в приложении |

| Stanza | Продвинутый морфологический и синтаксический анализ для многих языков | Исследование грамматической структуры русского текста, лемматизация |

Суммаризация и Извлечение Ключевых Фраз

В условиях информационного потока способность быстро извлекать суть из длинного текста становится крайне ценной․ Мы активно работали над разработкой систем суммаризации текста (Abstractive vs Extractive)․ Экстрактивная суммаризация выбирает наиболее важные предложения из оригинального текста, а абстрактивная — генерирует новый текст, перефразируя и обобщая информацию․ Для экстрактивной суммаризации мы часто использовали библиотеку TextRank, которая также отлично подходит для извлечения ключевых предложений и тем․

Для извлечения ключевых фраз мы также применяли алгоритм RAKE (Rapid Automatic Keyword Extraction), который является простым, но эффективным способом быстро найти наиболее релевантные слова и фразы в документе․ Эти инструменты незаменимы для быстрого понимания содержания больших статей или отчётов․

Чат-боты и Диалоговые Системы

Мечта о "разговоре с машиной" стала реальностью благодаря NLP․ Мы изучали и применяли фреймворки для разработки чат-ботов на Python, в частности Rasa․ Rasa позволяет создавать контекстно-зависимых чат-ботов, способных понимать естественный язык пользователя, управлять диалогом и выполнять действия․ Это открывает огромные возможности для автоматизации клиентской поддержки, создания интеллектуальных ассистентов и интерактивных информационных систем․

Визуализация, Оценка и Будущее NLP

После того, как мы обработали и проанализировали текст, нам необходимо представить результаты в понятной форме и убедиться в качестве наших моделей․

Инструменты для Визуализации Текстовых Данных

Визуализация, это мощный инструмент для понимания текстовых данных․ Мы часто используем облака слов (Word Clouds) для быстрого представления наиболее часто встречающихся терминов․ Для более глубокого анализа связей между словами или темами мы применяем тепловые карты (Heatmaps) или графовые представления․ Библиотеки, такие как Matplotlib и Seaborn, в сочетании с нашими NLP-инструментами, помогают нам создавать наглядные и информативные визуализации․

Оценка Качества Моделей

Ни один проект NLP не обходится без тщательной оценки․ Мы всегда оцениваем качество NER-моделей, классификаторов и других алгоритмов, используя стандартные метрики: F1-score, Precision, Recall․ Это позволяет нам не только понять, насколько хорошо работает наша модель, но и выявить области для улучшения, а также сравнить производительность различных подходов․

Например, для NER-моделей Precision покажет, сколько из предсказанных сущностей являются верными, Recall, сколько верных сущностей было найдено, а F1-score — это гармоническое среднее между Precision и Recall, дающее общую оценку․

Что Дальше?

Мир NLP развивается невероятными темпами․ Мы постоянно следим за новыми трендами и технологиями․ Трансформерные архитектуры для генерации диалогов, анализ стилистики текстов (авторский почерк), работа с нелатинскими алфавитами, анализ текста в медицинских записях, разработка систем обнаружения плагиата — это лишь малая часть тех направлений, которые мы исследуем и внедряем в свою практику․ Обработка больших текстовых массивов (Big Data NLP) становится стандартом, и мы адаптируем наши подходы для работы с огромными объёмами данных, используя распределенные вычисления и оптимизированные алгоритмы․

Мы убеждены, что будущее за гибридными системами, которые сочетают мощь глубокого обучения с экспертными знаниями и правилосообразными подходами․ Это позволит создавать более надёжные, интерпретируемые и эффективные решения для самых сложных задач․

Подробнее: Наши LSI-Запросы для Глубокого Поиска

| Основы токенизации NLTK | Применение spaCy NER | Тематическое моделирование LDA | Word2Vec в Gensim | Анализ тональности VADER |

| CountVectorizer TFIDF | Hugging Face Transformers | Разработка чат-ботов Rasa | Суммаризация текста TextRank | Очистка текста регулярными выражениями |