- Разговор с Машиной: Наш Путь в Мире Обработки Естественного Языка на Python

- Фундамент Понимания: Первичная Обработка Текста

- Токенизация: Разбиваем Текст на Атомы Смысла

- Стемминг и Лемматизация: К Корню Проблемы

- Регулярные Выражения: Хирургическая Точность в Предобработке

- Очистка Данных: Удаляем Шум, Оставляем Смысл

- Векторизация Текста: Мост от Слов к Числам

- Традиционные Векторизаторы: CountVectorizer и TfidfVectorizer

- Word Embeddings: Погружение Слов в Векторное Пространство

- Векторизация Предложений и Документов: Doc2Vec и Контекстное Встраивание

- Основные Задачи NLP: От Сущностей до Эмоций

- Распознавание Именованных Сущностей (NER): Кто, Что, Где и Когда?

- Тематическое Моделирование: О чем Этот Текст?

- Классификация Текстов: Распределяем по Категориям

- Анализ Тональности (Sentiment Analysis): Что Чувствует Автор?

- Суммаризация Текста: Извлекаем Суть

- Продвинутые Методы и Инструменты: За Гранью Основ

- Трансформеры и Hugging Face: Революция в NLP

- Работа с Многоязычными Данными: Мир Без Языковых Барьеров

- Веб-Скрейпинг и Извлечение Информации: Собираем Данные

- Создание Языковых Моделей: Предсказываем Будущее Текста

- Практическое Применение и Кейсы: NLP в Действии

- Разработка Чат-ботов и Вопросно-ответных Систем

- Анализ Отзывов Клиентов и Социальных Сетей

- Анализ Юридических Документов и Финансовой Отчетности

- Автоматическая Категоризация, Тегирование и Извлечение Информации

- Анализ Стилистики и Авторства

- Инструменты для Визуализации и Оценки: Делаем Результаты Очевидными

- Визуализация Текстовых Данных: От Облаков до Тепловых Карт

- Оценка Качества Моделей: Насколько Мы Хороши?

Разговор с Машиной: Наш Путь в Мире Обработки Естественного Языка на Python

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами нашим глубоким погружением в одну из самых увлекательных и быстро развивающихся областей искусственного интеллекта – Обработку Естественного Языка, или NLP (Natural Language Processing). Мы, как опытные блогеры, не просто прочитали пару статей, а буквально жили этим, экспериментировали с кодом, набивали шишки и радовались каждой маленькой победе; Наш опыт показывает, что Python — это не просто язык программирования, это целый мир возможностей для тех, кто хочет научить машину понимать, анализировать и даже генерировать человеческую речь. Давайте вместе отправимся в это захватывающее путешествие, где мы разберем основные концепции, инструменты и продвинутые методики, которые помогут вам освоить магию NLP.

Мир вокруг нас пронизан текстом: социальные сети, электронные письма, статьи, книги, отзывы, юридические документы – все это огромные массивы данных, которые содержат бесценную информацию. Но как извлечь эту информацию, как понять настроение миллионов людей, как автоматически суммировать тысячи страниц текста или даже построить чат-бота, способного вести осмысленный диалог? Именно здесь на помощь приходит NLP. Мы увидим, как с помощью мощных библиотек Python мы можем превратить эту хаотичную массу слов в структурированные данные, готовые к анализу и дальнейшему использованию в самых разнообразных приложениях. Готовы ли вы открыть для себя этот удивительный мир, где слова обретают новую жизнь, а машины начинают "говорить" с нами на нашем языке?

Фундамент Понимания: Первичная Обработка Текста

Прежде чем мы сможем научить машину понимать сложные нюансы человеческой речи, нам необходимо "почистить" и подготовить исходные текстовые данные. Представьте, что вы пытаетесь прочитать книгу, написанную без пробелов, знаков препинания и с опечатками. Машине еще сложнее! Поэтому первый и один из самых важных этапов в любом NLP-проекте – это предобработка текста. Мы прошли этот путь много раз и с уверенностью можем сказать, что качество предобработки напрямую влияет на успех всего проекта.

На этом этапе мы учимся разбивать текст на осмысленные части, приводить слова к их базовой форме, удалять ненужный "шум" и стандартизировать данные. Это основа, на которой строится вся дальнейшая работа. Без тщательной предобработки даже самые продвинутые модели будут выдавать неточные или совершенно бессмысленные результаты. Давайте углубимся в детали и рассмотрим ключевые техники, которые мы активно используем в нашей работе.

Токенизация: Разбиваем Текст на Атомы Смысла

Токенизация – это процесс разбиения текста на более мелкие единицы, называемые токенами. Токенами могут быть слова, символы, подслова или даже целые предложения. Это краеугольный камень любого NLP-проекта, ведь именно токены станут основными строительными блоками для дальнейшего анализа. Если мы не сможем правильно разделить текст, то все последующие шаги будут неэффективны. Мы постоянно сталкиваемся с тем, что разные языки и даже разные стили текста требуют своих подходов к токенизации.

Для этих целей мы чаще всего используем библиотеку NLTK (Natural Language Toolkit) – это своего рода швейцарский нож для начинающих и опытных NLP-специалистов. Она предлагает различные токенизаторы: от простых, разбивающих по пробелам, до более продвинутых, учитывающих особенности языка и пунктуации. Например, `word_tokenize` и `sent_tokenize` из NLTK позволяют нам легко получать списки слов и предложений соответственно. Это невероятно удобно для быстрого старта и исследования данных.

Стемминг и Лемматизация: К Корню Проблемы

После токенизации мы часто сталкиваемся с проблемой того, что одно и то же слово может иметь множество форм: "бежать", "бежит", "бежал", "бегущий". Для компьютера это четыре разных слова, хотя они несут один и тот же базовый смысл. Чтобы решить эту проблему, мы используем стемминг и лемматизацию – процессы приведения слов к их базовой форме. Эти техники помогают нам уменьшить размер словаря, стандартизировать данные и повысить эффективность алгоритмов.

Стемминг – это более грубый подход, который отсекает окончания и суффиксы, чтобы получить "корень" слова (стем). Например, "running" и "runner" могут быть приведены к "runn". Хотя это быстро и просто, стемминг не всегда дает реальное слово, что может быть недостатком. Мы часто начинаем со стемминга для быстрого прототипирования.

Лемматизация, в свою очередь, – это более интеллектуальный процесс, который использует морфологический анализ для приведения слова к его словарной форме (лемме). Например, "am", "are", "is" будут приведены к "be". Это точнее, но и более ресурсоемко. Для продвинутой лемматизации мы активно используем spaCy и Stanza, особенно когда работаем с языками, обладающими богатой морфологией, такими как русский. Эти библиотеки предоставляют высококачественные модели, которые значительно улучшают результаты нашего анализа.

Регулярные Выражения: Хирургическая Точность в Предобработке

Помимо токенизации и нормализации, нам часто приходится выполнять специфические операции по очистке текста: удалять URL-адреса, хештеги, упоминания, HTML-теги, специальные символы или извлекать конкретные паттерны. Здесь на помощь приходят регулярные выражения – мощный инструмент для поиска и манипулирования строками. Мы просто не представляем предобработку текста без использования встроенного модуля `re` в Python.

Регулярные выражения позволяют нам с хирургической точностью определять и модифицировать части текста. Например, удалить все неалфавитные символы, кроме пробелов, или найти все даты в определенном формате. Это особенно полезно при работе с неструктурированным текстом, который часто содержит много "мусора". Мы неоднократно убеждались, что мастерство владения регулярными выражениями значительно ускоряет и упрощает этап очистки данных.

Очистка Данных: Удаляем Шум, Оставляем Смысл

Очистка данных – это не просто удаление пунктуации. Это целый комплекс мер, направленных на минимизацию шума и стандартизацию текста. Мы всегда уделяем этому этапу пристальное внимание, потому что "мусор на входе" неизбежно приводит к "мусору на выходе". Вот некоторые из ключевых аспектов, которые мы учитываем:

- Удаление стоп-слов: Это частотные слова, такие как "и", "в", "на", "он", которые не несут существенной смысловой нагрузки и могут быть удалены для уменьшения размерности данных. NLTK предоставляет списки стоп-слов для многих языков, но иногда нам приходится создавать собственные или адаптировать существующие.

- Очистка от HTML-тегов: При веб-скрейпинге мы часто получаем текст, перемешанный с HTML-разметкой. Библиотека Beautiful Soup – наш незаменимый помощник в этом деле, позволяющий легко извлекать чистый текст.

- Обработка эмодзи и сленга: В современных текстах, особенно в социальных сетях, эмодзи и сленг играют важную роль. Мы разрабатываем инструменты для их нормализации или перевода в текстовое описание, чтобы модели могли их "понимать".

- Удаление пунктуации и чисел: В зависимости от задачи, пунктуация и числа могут быть либо очень важны, либо, наоборот, являться шумом. Мы гибко подходим к этому вопросу, используя регулярные выражения для их удаления или сохранения.

- Обработка неполных и ошибочных данных: Реальные данные редко бывают идеальными. Мы сталкиваемся с опечатками, сокращениями, неполными предложениями. Для проверки грамматики и исправления орфографии мы можем использовать специализированные библиотеки или разрабатывать собственные правила.

Каждый проект уникален, и мы всегда адаптируем наши методы очистки под конкретные требования, чтобы добиться наилучших результатов. Этот этап — это не просто рутина, это искусство, требующее внимания к деталям и глубокого понимания данных.

Векторизация Текста: Мост от Слов к Числам

Машины не понимают слов в том виде, в каком их понимаем мы. Для них это просто последовательности символов. Чтобы алгоритмы машинного обучения могли работать с текстом, нам необходимо преобразовать слова и предложения в числовые векторы. Этот процесс называется векторизацией текста, и он является ключевым этапом в любом NLP-конвейере. Мы убедились, что правильный выбор метода векторизации может кардинально изменить качество конечных моделей;

От простых подсчетов до сложных нейросетевых представлений – методы векторизации постоянно развиваются, предлагая все более точные и контекстно-зависимые способы представления текста. Давайте рассмотрим основные подходы, которые мы активно используем в нашей практике.

Традиционные Векторизаторы: CountVectorizer и TfidfVectorizer

Наш путь в векторизации часто начинается с классических подходов, которые, несмотря на свою простоту, остаются весьма эффективными для многих задач. Эти методы преобразуют текст в разреженные матрицы, где каждая строка представляет документ, а каждый столбец – слово из всего корпуса.

- CountVectorizer: Этот векторизатор из библиотеки Scikit-learn просто подсчитывает частоту появления каждого слова (токена) в документе. Если слово "кот" встречается 5 раз в документе, соответствующая ячейка в векторе будет равна 5. Это простой, но мощный способ получить числовое представление текста. Мы часто используем его для задач, где важна абсолютная частота слов.

- TfidfVectorizer: Более продвинутый подход, который учитывает не только частоту слова в документе (Term Frequency, TF), но и его редкость во всем корпусе документов (Inverse Document Frequency, IDF). Слова, которые часто встречаются в одном документе, но редко – во всех остальных, получают больший вес. Это помогает нам выделить наиболее значимые слова для каждого документа, отфильтровывая общие, но неинформативные термины. TF-IDF – это наш выбор для многих задач классификации и тематического моделирования.

Мы часто сравниваем эти методы, чтобы определить, какой из них лучше подходит для конкретной задачи, так как их эффективность может сильно варьироваться в зависимости от характера данных.

Word Embeddings: Погружение Слов в Векторное Пространство

Традиционные векторизаторы не учитывают семантические отношения между словами. "Король" и "королева" могут быть очень похожи по смыслу, но их векторы будут совершенно разными. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов, которые улавливают их семантические и синтаксические отношения; Мы обнаружили, что это настоящий прорыв в NLP, позволяющий моделям "понимать" смысл слов.

Для создания и работы с Word Embeddings мы активно используем библиотеку Gensim. Она предоставляет реализации таких популярных моделей, как:

- Word2Vec: Разработанный Google, Word2Vec позволяет нам обучать векторы слов таким образом, что слова с похожим значением оказываются близко друг к другу в многомерном векторном пространстве. Мы используем две основные архитектуры:

- Skip-gram: Предсказывает контекстные слова по заданному слову.

- CBOW (Continuous Bag-of-Words): Предсказывает текущее слово по его контексту.

Word2Vec позволяет нам выполнять "векторную арифметику" – например, "король" ─ "мужчина" + "женщина" ≈ "королева". Это поразительно!

Использование предобученных Word Embeddings, таких как те, что доступны для Word2Vec и GloVe, позволяет нам значительно ускорить разработку и повысить качество моделей, особенно когда у нас нет огромного объема данных для обучения собственных векторов.

Векторизация Предложений и Документов: Doc2Vec и Контекстное Встраивание

Word Embeddings отлично работают со словами, но что, если нам нужно получить векторное представление для целого предложения или документа? Здесь на помощь приходят более продвинутые техники. Мы часто сталкиваемся с задачами, где требуется понимание смысла всего текста, а не отдельных слов.

- Doc2Vec (Paragraph Vector): Расширение Word2Vec, которое позволяет нам генерировать векторы для целых документов или абзацев. Doc2Vec обучается таким образом, чтобы векторы семантически похожих документов располагались близко друг к другу. Это невероятно полезно для задач поиска похожих документов, кластеризации текстов и рекомендательных систем.

- Контекстное Встраивание (Contextual Embeddings): С появлением трансформерных архитектур, таких как BERT, мы получили возможность создавать векторные представления слов, которые зависят от их контекста в предложении. Это означает, что слово "банк" будет иметь разные векторы в предложениях "я иду в банк" (финансовое учреждение) и "берег реки – это банк" (географический объект). Эти модели, такие как Sentence Transformers, позволяют нам получать высококачественные векторы для предложений и даже целых документов, учитывая тонкие нюансы смысла. Они стали незаменимыми для задач, требующих глубокого семантического понимания.

- Graph Embeddings: Для анализа взаимосвязей в тексте, например, между сущностями или идеями, мы иногда применяем Graph Embeddings. Они позволяют нам представить текстовые данные в виде графа и затем обучить векторы для узлов и ребер, отражающие их отношения. Это открывает новые горизонты для анализа сложных структурных данных в тексте.

Выбор метода векторизации – это всегда компромисс между вычислительной сложностью, объемом доступных данных и требуемой точностью. Мы постоянно экспериментируем и сравниваем различные подходы, чтобы найти оптимальное решение для каждой конкретной задачи.

Основные Задачи NLP: От Сущностей до Эмоций

После того как текст подготовлен и векторизован, мы можем переходить к решению более сложных и прикладных задач. NLP – это огромная область, охватывающая множество направлений: от извлечения конкретной информации до понимания общего настроения текста. Мы регулярно работаем с этими задачами, применяя различные инструменты и подходы. Давайте рассмотрим наиболее распространенные и важные из них.

Распознавание Именованных Сущностей (NER): Кто, Что, Где и Когда?

Распознавание именованных сущностей (Named Entity Recognition, NER) – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, денежные суммы и т.д. Это одна из фундаментальных задач NLP, которая лежит в основе многих других приложений, таких как извлечение информации, вопросно-ответные системы и суммаризация. Мы постоянно используем NER для автоматического структурирования неструктурированных данных.

Для быстрого и эффективного NER мы чаще всего обращаемся к spaCy. Эта библиотека известна своей производительностью и качественными предобученными моделями для различных языков. С spaCy мы можем легко выделить такие сущности, как "Apple" (ORG), "Тим Кук" (PERSON), "Купертино" (GPE) из предложений. Это значительно упрощает процесс извлечения ключевой информации.

Помимо spaCy, мы также работаем с Flair – еще одной мощной библиотекой, которая предлагает современные модели NER, основанные на глубоком обучении и контекстных эмбеддингах. Flair часто дает более высокие результаты на сложных задачах и для языков с богатой морфологией. Иногда для специализированных задач мы также используем Conditional Random Fields (CRF), особенно когда требуется высокая степень контроля над признаками. А с появлением трансформеров, таких как BERT, мы получили возможность достигать еще более высокой точности в NER, часто применяя BERT для тонкой настройки (fine-tuning) на специфических датасетах.

Тематическое Моделирование: О чем Этот Текст?

Представьте, что у вас есть огромный архив документов, и вы хотите понять, какие основные темы в них затрагиваются, без необходимости читать каждый документ. Тематическое моделирование позволяет нам автоматически обнаруживать скрытые "темы" в коллекции текстов. Это бесценный инструмент для анализа больших текстовых массивов, таких как отзывы клиентов, новостные статьи или научные публикации. Мы используем его для выявления скрытых паттернов и категоризации контента.

Наш основной инструмент для тематического моделирования – это библиотека Gensim. Она предоставляет реализации таких популярных алгоритмов, как:

- LDA (Latent Dirichlet Allocation): Это один из самых распространенных алгоритмов тематического моделирования. LDA предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это смесь слов. Мы обучаем модель, чтобы она выявила эти скрытые темы и определила, какие слова наиболее характерны для каждой темы.

- LSI (Latent Semantic Indexing): Более ранний, но все еще актуальный метод, основанный на сингулярном разложении матрицы "терм-документ". LSI помогает нам обнаруживать скрытые семантические отношения между словами и документами.

- NMF (Non-negative Matrix Factorization): Еще один мощный метод для тематического моделирования, который часто сравнивают с LDA. NMF может быть более интерпретируемым в некоторых случаях и хорошо работает с разреженными данными.

Мы часто проводим сравнение моделей тематического моделирования (LDA vs NMF), чтобы понять, какая из них лучше раскрывает структуру конкретного набора данных. Правильный выбор алгоритма и количества тем критически важен для получения осмысленных результатов.

Классификация Текстов: Распределяем по Категориям

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям; Это может быть определение спама в электронной почте, категоризация новостных статей по темам (спорт, политика, экономика) или анализ тональности. Мы ежедневно сталкиваемся с задачами классификации, и это один из самых востребованных видов NLP-приложений.

Для классификации текстов мы активно используем библиотеку Scikit-learn – это золотой стандарт в машинном обучении на Python. Scikit-learn предоставляет широкий спектр алгоритмов, таких как:

- SVM (Support Vector Machines): Мощный алгоритм, который хорошо работает даже с относительно небольшими наборами данных и высокой размерностью признаков.

- Наивный Байесовский Классификатор: Простой, но часто очень эффективный алгоритм, особенно для задач классификации текста, благодаря своей способности хорошо работать с разреженными данными.

Помимо традиционных методов машинного обучения, мы также применяем глубокое обучение для классификации текстов, используя фреймворки PyTorch и TensorFlow для создания нейронных сетей, таких как LSTM (Long Short-Term Memory). А с появлением трансформеров, таких как BERT, мы получили возможность достигать state-of-the-art результатов в классификации, тонко настраивая предобученные модели под наши специфические задачи. Мы постоянно сравниваем различные методы машинного обучения для NLP, чтобы выбрать наиболее оптимальный для каждой ситуации.

Анализ Тональности (Sentiment Analysis): Что Чувствует Автор?

Понимание эмоциональной окраски текста – невероятно ценная задача для бизнеса, маркетинга и социальных исследований. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв, комментарий или статья положительной, отрицательной или нейтральной. Мы используем его для анализа отзывов клиентов, мониторинга социальных сетей и оценки репутации брендов.

Для быстрого и эффективного анализа тональности на английском языке мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner). VADER специально разработан для работы с текстами из социальных сетей и очень хорошо справляется с сарказмом, сленгом и эмодзи, что делает его незаменимым для анализа тональности сообщений в социальных сетях (Twitter/Reddit).

Помимо VADER, мы также применяем TextBlob для простого анализа тональности, хотя его возможности более ограничены. Для более сложных и многоязычных задач мы разрабатываем собственные модели на основе машинного обучения или используем трансформеры. Анализ тональности финансовых новостей или отзывов о продуктах требует особой точности, и мы часто тонко настраиваем модели для этих специфических доменов, учитывая контекст и возможный сарказм.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли люди и куда они идут."

– Рита Мэй Браун

Суммаризация Текста: Извлекаем Суть

В мире, переполненном информацией, способность быстро извлекать ключевые идеи из длинных текстов становится критически важной. Суммаризация текста позволяет нам автоматически создавать краткие изложения документов. Это может быть полезно для новостных агрегаторов, систем документооборота или для быстрого ознакомления с содержанием больших статей. Мы активно работаем над созданием систем суммаризации текста, чтобы помочь нашим читателям и коллегам экономить время.

Мы различаем два основных подхода к суммаризации:

- Экстрактивная суммаризация (Extractive Summarization): Этот метод извлекает наиболее важные предложения или фразы из исходного текста и объединяет их для создания резюме. Полученное резюме состоит исключительно из фрагментов оригинального текста. Для этого мы часто используем алгоритм TextRank (реализованный, например, в библиотеке Textacy или собственными силами), который строит граф предложений и ранжирует их по важности.

- Абстрактивная суммаризация (Abstractive Summarization): Более сложный подход, при котором система генерирует новое резюме, перефразируя и синтезируя информацию из исходного текста. Это похоже на то, как человек пишет аннотацию, не просто копируя предложения. Абстрактивная суммаризация требует глубокого понимания текста и часто реализуется с помощью трансформерных моделей (Hugging Face), которые могут генерировать связный и осмысленный новый текст.

Сравнение моделей суммирования: экстрактивная и абстрактная – это постоянный процесс в нашей работе, так как каждый подход имеет свои преимущества и недостатки в зависимости от задачи и доступных ресурсов. Экстрактивная проще в реализации, но может быть менее гибкой, тогда как абстрактивная предлагает более качественные резюме, но требует более сложных моделей и больших вычислительных ресурсов.

Продвинутые Методы и Инструменты: За Гранью Основ

Мир NLP не стоит на месте, и то, что вчера казалось фантастикой, сегодня становится обыденностью. Глубокое обучение и, в частности, трансформерные архитектуры, произвели настоящую революцию в обработке естественного языка. Мы постоянно изучаем и внедряем новейшие разработки, чтобы оставаться на переднем крае этой захватывающей области. Давайте рассмотрим некоторые из наиболее продвинутых инструментов и методов, которые мы используем для решения сложных задач.

Трансформеры и Hugging Face: Революция в NLP

Трансформеры – это архитектура нейронных сетей, которая изменила ландшафт NLP. Они позволяют моделям обрабатывать текст, учитывая контекст каждого слова во всем предложении, а не только в узком окне. Библиотека Hugging Face Transformers стала де-факто стандартом для работы с этими моделями, предоставляя простой интерфейс для доступа к сотням предобученных моделей и инструментов для их тонкой настройки. Мы активно используем Hugging Face для большинства наших продвинутых проектов.

- BERT (Bidirectional Encoder Representations from Transformers): Модель, которая может быть тонко настроена (fine-tuning) для широкого круга задач NLP, таких как классификация текста, NER, вопросно-ответные системы. Мы применяем BERT для задач классификации, когда требуется высокая точность, и для NER, когда стандартные методы уже не справляются.

- GPT (Generative Pre-trained Transformer): Семейство моделей, известных своими впечатляющими возможностями в генерации текста. Мы используем Transformer-модели для генерации текста, диалогов, кода и даже для автоматического перефразирования. Это открывает двери для создания по-настоящему интерактивных и творческих NLP-приложений.

Тонкая настройка (Fine-tuning) предварительно обученных моделей на наших собственных данных – это мощный подход, который позволяет нам достигать высокой производительности с относительно небольшими наборами данных и меньшими вычислительными затратами, чем обучение с нуля.

Работа с Многоязычными Данными: Мир Без Языковых Барьеров

В глобализированном мире все чаще возникает необходимость обрабатывать тексты на разных языках. Мы сталкиваемся с многоязычными текстовыми корпусами, и для нас важно иметь инструменты, способные эффективно работать с ними. Это могут быть отзывы клиентов из разных стран или международные новостные сводки.

- Polyglot: Отличная библиотека для мультиязычности, которая позволяет нам выполнять токенизацию, NER, анализ тональности и другие задачи для многих языков, включая редкие. Мы используем Polyglot для быстрого анализа текстов на языках, для которых нет специализированных глубоких моделей.

- Stanza: Разработанная Стэнфордским университетом, Stanza предоставляет высококачественные модели для языков с богатой морфологией, таких как русский, арабский или финский. Мы используем Stanza для продвинутой лемматизации, синтаксического парсинга и POS-теггинга, когда требуется глубокий лингвистический анализ.

- Разработка систем машинного перевода на Python: С появлением трансформеров, мы также экспериментируем с созданием собственных систем машинного перевода, используя PyTorch/TensorFlow и Hugging Face. Это позволяет нам адаптировать перевод под узкоспециализированные тексты.

Веб-Скрейпинг и Извлечение Информации: Собираем Данные

Большая часть текстовых данных, с которыми мы работаем, находится в интернете или в различных документах. Чтобы получить доступ к этим данным, нам нужны инструменты для их сбора и извлечения. Мы не можем анализировать то, чего у нас нет.

- Beautiful Soup: Наша незаменимая библиотека для веб-скрейпинга текста. Beautiful Soup позволяет нам легко парсить HTML-страницы, извлекать нужные элементы и очищать текст от ненужной разметки. Мы используем ее для сбора статей, отзывов, новостей и других публично доступных текстовых данных.

- PyMuPDF (fitz): Для извлечения текста из PDF-документов мы используем библиотеку PyMuPDF. Она позволяет нам программно открывать PDF-файлы, извлекать текст, изображения и даже работать со структурой документа. Это очень полезно при работе с юридическими документами, отчетами или научными статьями, представленными в формате PDF.

- Извлечение ключевых фраз (RAKE, TextRank): Помимо NER, нам часто нужно извлекать не именованные, но важные ключевые фразы. Мы используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) или TextRank (для извлечения ключевых предложений), чтобы автоматически выделять наиболее значимые термины и идеи из текста.

Создание Языковых Моделей: Предсказываем Будущее Текста

Языковая модель – это система, которая оценивает вероятность последовательности слов. Это фундаментальная концепция в NLP, лежащая в основе многих задач, таких как машинный перевод, распознавание речи и автозаполнение текста. Мы строим языковые модели, чтобы понимать, как слова сочетаются друг с другом.

- N-граммы: Простейший тип языковых моделей, который предсказывает следующее слово на основе предыдущих N-. Мы анализируем частотность n-грамм (например, биграмм или триграмм), чтобы понять, какие последовательности слов наиболее характерны для данного корпуса текста. Это полезно для анализа частотности слов и n-грамм, а также для построения базовых языковых моделей.

- Продвинутые языковые модели: С появлением трансформеров, языковые модели стали значительно более сложными и мощными. Мы используем Transformer-модели для генерации текста, которые могут создавать целые абзацы, статьи и даже диалоги, основываясь на заданном контексте. Это открывает огромные возможности для творческих приложений NLP.

Практическое Применение и Кейсы: NLP в Действии

Теория и инструменты – это хорошо, но настоящий интерес к NLP приходит, когда мы видим, как эти технологии применяются для решения реальных проблем. Мы реализовали множество проектов, используя рассмотренные выше методы, и хотим поделиться некоторыми из наиболее интересных и показательных кейсов; Эти примеры демонстрируют, как NLP превращает сырые данные в ценные инсайты и автоматизированные решения.

Разработка Чат-ботов и Вопросно-ответных Систем

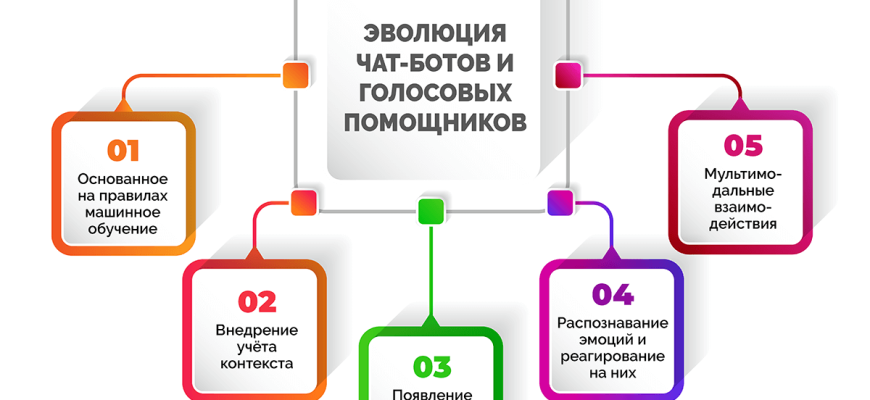

Чат-боты и вопросно-ответные системы (QA) – это, пожалуй, одни из самых популярных и наглядных применений NLP. Мы активно работаем над созданием интеллектуальных агентов, способных понимать вопросы пользователей и предоставлять релевантные ответы. Это могут быть боты для поддержки клиентов, виртуальные ассистенты или системы поиска информации в больших базах знаний.

- Разработка чат-ботов на Python (Rasa framework): Для создания сложных, контекстно-зависимых чат-ботов мы часто используем фреймворк Rasa. Rasa позволяет нам разрабатывать диалоговые системы, которые не просто отвечают на вопросы, но и ведут осмысленный диалог, запоминают контекст и могут выполнять действия.

- Разработка систем вопросно-ответных систем (QA): Для QA-систем мы используем комбинацию NER, извлечения ключевых фраз и, конечно же, трансформерных моделей. Модели BERT, например, отлично подходят для поиска ответа в заданном тексте (экстрактивные QA-системы), а более сложные генеративные модели могут даже формировать ответ, которого нет дословно в источнике (абстрактивные QA-системы). Мы также работаем над созданием FAQ на основе документов, автоматически извлекая вопросы и ответы.

Анализ Отзывов Клиентов и Социальных Сетей

Отзывы клиентов – это золотая жила информации для любого бизнеса. Но как проанализировать тысячи или миллионы отзывов? NLP позволяет нам автоматизировать этот процесс, извлекая ценные инсайты. Мы регулярно помогаем компаниям понять, что думают их клиенты.

- Анализ тональности отзывов о продуктах, фильмах, ресторанах: Мы используем анализ тональности для определения общего настроения отзывов. Это помогает компаниям понять, какие аспекты их продуктов или услуг вызывают положительные или отрицательные эмоции.

- Анализ поведенческих паттернов в чатах и отзывах: Помимо тональности, мы анализируем частотность слов и n-грамм, чтобы выявить повторяющиеся проблемы, пожелания или поведенческие паттерны. Это позволяет нам не только понять "что", но и "почему".

- Анализ тональности сообщений в социальных сетях (Twitter/Reddit) с учетом сарказма: Социальные сети представляют особую сложность из-за обилия сленга, эмодзи и сарказма. Мы используем специализированные модели и подходы, такие как VADER, чтобы справиться с этими нюансами и получить точный анализ тональности.

- Применение Topic Modeling для анализа отзывов: Тематическое моделирование позволяет нам автоматически определить основные темы, которые обсуждаются в отзывах. Например, в отзывах о телефоне это могут быть "камера", "батарея", "производительность".

Анализ Юридических Документов и Финансовой Отчетности

Юридические и финансовые документы – это сложнейшие тексты, требующие высокой точности и внимания к деталям. NLP предлагает мощные инструменты для их автоматической обработки, что значительно экономит время и снижает риск ошибок. Мы работаем над применением Python для анализа юридических документов и финансовой отчетности.

- Извлечение дат и чисел из текста: Для юридических документов критически важно извлекать даты, суммы, имена сторон. Мы используем NER и регулярные выражения для точного извлечения этой информации.

- Анализ текстов в юридических контрактах: Мы разрабатываем системы для автоматического выявления ключевых положений, обязательств, условий и рисков в контрактах, что помогает юристам быстрее ориентироваться в больших объемах документов.

- Анализ тональности финансовых новостей: Понимание эмоциональной окраски новостей может влиять на решения инвесторов. Мы используем NLP для анализа тональности финансовых новостей, чтобы выявлять потенциальные рыночные движения.

- Разработка систем обнаружения плагиата: С помощью библиотек для измерения сходства строк, таких как TextDistance или Jellyfish, мы разрабатываем системы для обнаружения плагиата в текстах, сравнивая документы на предмет их уникальности.

Автоматическая Категоризация, Тегирование и Извлечение Информации

Управление большим объемом текстового контента – это постоянная задача для медиа-компаний, библиотек и корпораций. NLP позволяет нам автоматизировать процессы категоризации, тегирования и извлечения ключевой информации, что делает контент более доступным и управляемым.

- Разработка систем автоматической категоризации статей/новостей: Мы используем классификацию текстов для автоматического распределения статей по предопределенным категориям, таким как "спорт", "технологии", "политика".

- Разработка систем для автоматического создания тегов: На основе извлеченных ключевых фраз и тематического моделирования мы создаем инструменты для автоматического присвоения тегов контенту, что улучшает его поиск и навигацию.

- Анализ текста для извлечения ключевых фраз: Помимо упомянутых RAKE и TextRank, мы используем трансформеры для более глубокого извлечения ключевых фраз, которые могут быть неочевидны при поверхностном прочтении.

- Разработка моделей для выявления связей между сущностями: NER помогает найти сущности, но что, если нам нужно понять, как они связаны? Мы разрабатываем модели, которые могут выявлять отношения между сущностями (например, "Тим Кук" является CEO "Apple"), что создает структурированную базу знаний.

Анализ Стилистики и Авторства

Иногда нам нужно не просто понять смысл текста, но и проанализировать его форму: кто его написал, каков стиль автора, есть ли в тексте какие-либо аномалии. Это интересная и сложная область NLP.

- Анализ стилистики текстов (авторский почерк): Мы используем метрики лексического богатства, частотности функциональных слов, длины предложений и другие стилистические характеристики для анализа "почерка" автора; Это может быть полезно для сравнительного анализа литературы или маркетинговых материалов.

- Разработка систем для определения авторства текста: На основе стилистических признаков мы создаем модели, которые могут предсказывать автора текста из нескольких кандидатов. Это сложная задача, требующая тщательного подбора признаков.

- Разработка инструмента для проверки грамматики и исправления орфографии: Хотя есть готовые решения, мы иногда создаем собственные инструменты для проверки грамматики, особенно для специфических доменов или языков, где стандартные чекеры не справляются.

Инструменты для Визуализации и Оценки: Делаем Результаты Очевидными

После того как мы провели весь анализ и построили модели, нам необходимо представить результаты в понятной форме и оценить качество нашей работы. Визуализация помогает нам быстро понять основные закономерности, а метрики оценки – объективно измерить эффективность моделей. Мы всегда помним, что конечные пользователи часто не являются специалистами в NLP, поэтому наглядность и интерпретируемость очень важны.

Визуализация Текстовых Данных: От Облаков до Тепловых Карт

Визуализация – это мощный способ донести сложные инсайты простым языком. Мы используем различные техники для визуализации текстовых данных, чтобы сделать наши выводы более доступными и убедительными.

- Облака слов (Word Clouds): Это простой, но очень эффективный способ визуализировать наиболее часто встречающиеся слова в корпусе текста. Размер слова в облаке обычно пропорционален его частоте. Это отличный способ быстро понять, о чем идет речь в большом объеме текста.

- Тепловые карты (Heatmaps): Мы используем тепловые карты для визуализации матриц сходства, например, между документами или темами. Это помогает нам быстро увидеть кластеры похожих элементов.

- Диаграммы и графики: Для анализа частотности слов, n-грамм, распределения тональности или других метрик мы используем стандартные библиотеки для построения графиков, такие как Matplotlib и Seaborn.

- Использование Sweetviz для анализа текстовых данных: Эта библиотека предоставляет быстрый и интерактивный анализ данных, включая текстовые поля, позволяя нам визуализировать распределения и взаимосвязи.

Оценка Качества Моделей: Насколько Мы Хороши?

Создать модель – это только полдела. Нам необходимо объективно оценить ее производительность. В NLP, как и в машинном обучении в целом, существуют стандартные метрики для оценки качества моделей. Мы всегда тестируем наши модели на отложенных данных, чтобы убедиться в их обобщающей способности.

- F1-score, Precision, Recall: Эти метрики являются стандартными для оценки классификационных моделей, включая NER.

- Precision (точность): Доля правильно предсказанных положительных классов от всех предсказанных положительных классов.

- Recall (полнота): Доля правильно предсказанных положительных классов от всех реальных положительных классов.

- F1-score: Гармоническое среднее Precision и Recall, которое дает сбалансированную оценку.

Мы используем эти метрики для оценки качества NER-моделей, классификаторов и других систем.

Вот мы и подошли к концу нашего обширного путешествия по миру Обработки Естественного Языка на Python. Мы вместе прошли путь от базовой предобработки текста до создания сложных систем на основе трансформерных архитектур. Мы увидели, как Python, с его богатой экосистемой библиотек, становится незаменимым инструментом для каждого, кто хочет разгадать тайны человеческого языка и научить машины понимать его. От токенизации и стемминга до тематического моделирования и анализа тональности, от разработки чат-ботов до извлечения фактов из юридических документов – возможности NLP поистине безграничны.

Наш опыт показывает, что ключ к успеху в NLP лежит в постоянном обучении, экспериментировании и глубоком понимании как лингвистических особенностей, так и технических аспектов машинного обучения. Мир NLP развивается с невероятной скоростью, и то, что сегодня кажется передовым, завтра уже может стать стандартом. Трансформеры и большие языковые модели открыли новую эру, где машины не просто анализируют, но и генерируют текст, ведут осмысленные диалоги и даже пишут код. Мы верим, что в ближайшем будущем NLP будет играть еще более центральную роль в нашей жизни, автоматизируя рутинные задачи, улучшая взаимодействие человека с компьютером и открывая новые горизонты для исследований и инноваций.

Мы надеемся, что эта статья стала для вас не просто источником информации, но и вдохновением для собственных экспериментов и проектов. Не бойтесь начинать, пробовать новое, набивать шишки – именно так мы и обретаем свой бесценный опыт. Возможно, именно вы станете тем, кто сделает следующий прорыв в этой увлекательной области. Продолжайте учиться, творить и разговаривать с машинами – и пусть ваш путь в NLP будет таким же захватывающим и продуктивным, как и наш. Удачи в ваших начинаниях, и до новых встреч на страницах нашего блога!

Подробнее

| Основы NLTK: Токенизация и стемминг | Использование spaCy для быстрого NER | Библиотека Gensim для тематического моделирования (LDA, LSI) | Word Embeddings: Word2Vec и GloVe с использованием Gensim | Анализ тональности (Sentiment Analysis) с VADER |

| Трансформеры (Hugging Face) для сложных задач NLP | Разработка собственных векторизаторов текста (CountVectorizer, TfidfVectorizer) | Применение Scikit-learn для классификации текстов | Разработка систем суммаризации текста (Abstractive vs Extractive) | Анализ текста для извлечения ключевых фраз |