- Разговор с Текстом: Наш Путь в Мире NLP с Python

- Основы основ: Подготовка текста к анализу

- Токенизация, стемминг и лемматизация: Дробим и упрощаем

- Очистка данных: Регулярные выражения и стоп-слова

- Векторизация текста: Превращаем слова в числа

- Сбор данных: Веб-скрейпинг с Beautiful Soup

- Погружение в смысл: Извлечение информации

- NER: Распознавание именованных сущностей

- Word Embeddings: От слов к векторам смысла

- Тематическое моделирование: Обнаруживаем скрытые темы

- Извлечение ключевых фраз: Суть в нескольких словах

- Эмоции и отношения: Анализ тональности и стилистики

- Анализ тональности (Sentiment Analysis): Чувствуем пульс аудитории

- Анализ стилистики и неформального языка

- Машинное обучение в NLP: От классификации до генерации

- Классификация текстов: Распределяем по категориям

- Кластеризация текстов: Ищем естественные группы

- Трансформеры и глубокое обучение: Новая эра в NLP

- Разработка систем: От чат-ботов до суммаризации

- Продвинутые техники и вызовы

- Многоязычный NLP: За пределами английского

- Работа с "грязными" данными и специфическими форматами

- Анализ связей и паттернов

- Инструменты для оценки и визуализации

- Разработка собственных инструментов и автоматизация

- Наши любимые инструменты: Краткий обзор библиотек

Разговор с Текстом: Наш Путь в Мире NLP с Python

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами чем-то по-настоящему захватывающим, тем, что изменило наш взгляд на обработку информации и открыло двери в совершенно новые миры. Речь пойдет об Обработке Естественного Языка, или NLP (Natural Language Processing), и о том, как Python стал нашим верным спутником в этом увлекательном путешествии. За последние годы мы углубились в эту область, и каждый новый проект, каждая новая библиотека приносили нам удивительные открытия. Мы прошли путь от первых, робких шагов в токенизации до создания сложных систем на базе трансформеров, и готовы рассказать вам о наших приключениях, уроках и, конечно же, о том, как вы можете начать свой собственный путь.

Мир вокруг нас полон текста: электронные письма, сообщения в социальных сетях, научные статьи, отзывы клиентов, юридические документы, медицинские записи. Представьте, сколько ценной информации скрыто в этих потоках слов! NLP, это мост, который позволяет нам не просто читать и понимать этот текст, но и анализировать его, извлекать скрытые смыслы, автоматизировать рутинные задачи и даже генерировать новый контент. Мы убеждены, что каждый, кто работает с данными, рано или поздно столкнется с необходимостью обрабатывать текстовую информацию, и Python предлагает для этого невероятно мощный и гибкий инструментарий. Давайте вместе погрузимся в этот мир и рассмотрим основные вехи, которые мы освоили, и те инструменты, которые стали нашими незаменимыми помощниками.

Основы основ: Подготовка текста к анализу

Прежде чем мы сможем заставить компьютер "понять" человеческий язык, нам необходимо подготовить этот язык к анализу. Представьте, что вы хотите испечь пирог: сначала нужно подготовить ингредиенты, измельчить их, смешать. То же самое и с текстом. Этот этап, известный как предобработка, является одним из самых важных и трудоемких. Мы научились, что качество предобработки напрямую влияет на точность и полезность дальнейшего анализа. Наш опыт показал, что игнорирование даже, казалось бы, мелких деталей на этом этапе может привести к серьезным ошибкам в конечных результатах.

Токенизация, стемминг и лемматизация: Дробим и упрощаем

Первый шаг в предобработке — это токенизация. Это процесс разделения текста на более мелкие единицы, называемые токенами, которыми могут быть слова, фразы или даже символы. Например, предложение "Мы любим NLP!" может быть разделено на токены ["Мы", "любим", "NLP", "!"]. Мы активно используем библиотеку NLTK (Natural Language Toolkit) для этих задач, так как она предлагает широкий спектр токенизаторов, подходящих для разных сценариев.

После токенизации часто возникает необходимость привести слова к их базовой форме. Здесь в игру вступают стемминг и лемматизация. Стемминг — это более грубый процесс, который просто отсекает суффиксы и префиксы, чтобы получить "корень" слова. Например, слова "бегущий", "бежал", "бегать" могут быть сведены к "бег". Мы часто используем стеммеры из NLTK, такие как PorterStemmer или SnowballStemmer, когда скорость обработки важнее абсолютной точности.

Лемматизация, в отличие от стемминга, более интеллектуальный процесс; Она использует словарные базы и морфологический анализ, чтобы привести слово к его канонической (словарной) форме, называемой леммой. Так, "бегущий", "бежал", "бегать" будут приведены к "бегать". Для лемматизации мы предпочитаем spaCy, особенно для английского языка, так как она обеспечивает высокую точность и скорость. Для языков с богатой морфологией, таких как русский, мы обнаружили, что Stanza от Stanford NLP предлагает отличные возможности, обеспечивая глубокий лингвистический анализ.

Вот как мы обычно сравниваем эти подходы на практике:

| Метод | Цель | Пример | Библиотеки | Преимущества |

|---|---|---|---|---|

| Токенизация | Разделение текста на слова/фразы | "Кошки бегут" -> ["Кошки", "бегут"] | NLTK, spaCy | Фундамент для любого анализа |

| Стемминг | Усечение слова до корня | "Бегущий" -> "бег" | NLTK (Porter, Snowball) | Быстрый, уменьшает размер словаря |

| Лемматизация | Приведение слова к словарной форме | "Бегущий" -> "бегать" | spaCy, NLTK (WordNetLemmatizer), Stanza | Точный, сохраняет смысл слова |

Очистка данных: Регулярные выражения и стоп-слова

Сырой текст редко бывает чистым. Он может содержать HTML-теги, пунктуацию, цифры, специальные символы, URL-адреса и другие "шумы", которые не несут смысловой нагрузки для нашего анализа. Для борьбы с этим мы активно используем регулярные выражения (модуль `re` в Python). Это мощный инструмент для поиска и замены текстовых паттернов, который позволяет нам эффективно очищать данные.

Еще один важный этап — удаление стоп-слов. Это общие слова, такие как "и", "в", "на", "он", которые встречаются очень часто, но обычно не добавляют уникального смысла в контексте большинства задач NLP. NLTK предоставляет списки стоп-слов для многих языков, но мы часто создаем и свои собственные, специфичные для предметной области. Например, в анализе отзывов о продукте слова типа "продукт" или "покупка" могут быть стоп-словами, если они встречаются слишком часто и не несут уникальной информации о тональности.

Векторизация текста: Превращаем слова в числа

Компьютеры лучше всего работают с числами, а не с текстом. Поэтому одним из ключевых шагов является преобразование текстовых данных в числовые векторы. Этот процесс называется векторизацией. Мы начинали с простых методов и постепенно осваивали более сложные.

- CountVectorizer: Это простейший метод, который создает матрицу, где каждая строка представляет документ, а каждый столбец — уникальное слово из всего корпуса текстов. Значение в ячейке — это количество раз, которое данное слово встречается в данном документе.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Этот метод более продвинутый. Он не только учитывает частоту слова в документе (TF), но и придает больший вес словам, которые являются редкими в общем корпусе документов (IDF). Таким образом, слова, уникальные для конкретного документа, получают больший вес, что позволяет лучше выявлять важные термины. Мы обнаружили, что TF-IDF часто дает значительно лучшие результаты по сравнению с простым подсчетом слов, особенно в задачах классификации.

Разработка собственных векторизаторов или тонкая настройка существующих (например, настройка n-грамм, минимальной/максимальной частоты слов) — это то, что мы постоянно делаем для улучшения качества моделей. Это позволяет нам адаптировать процесс векторизации под конкретные задачи и данные.

Сбор данных: Веб-скрейпинг с Beautiful Soup

Для любого анализа нужны данные. Очень часто эти данные находятся на веб-страницах. Мы неоднократно использовали библиотеку Beautiful Soup для веб-скрейпинга. Это позволяет нам извлекать текст из HTML-структуры сайтов, что является незаменимым инструментом для формирования собственных корпусов текстов для обучения и тестирования наших NLP-моделей. От сбора отзывов клиентов до анализа новостных статей — Beautiful Soup всегда приходил на помощь.

Погружение в смысл: Извлечение информации

После того как текст подготовлен и векторизован, мы можем перейти к более интересным задачам, извлечению из него ценной информации. Это то, что действительно позволяет нам "разговаривать" с текстом и получать ответы на наши вопросы. На этом этапе мы переходим от простого преобразования к глубокому анализу.

NER: Распознавание именованных сущностей

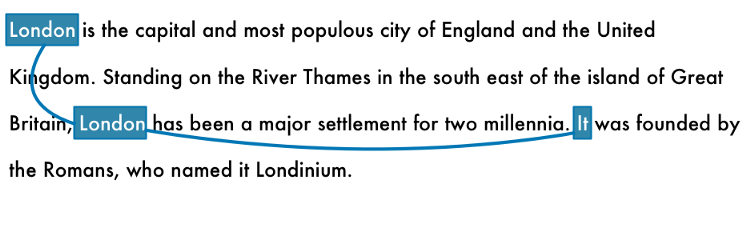

Распознавание именованных сущностей (Named Entity Recognition, NER) — одна из наших любимых задач. Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, организаций, географические названия, даты, денежные суммы и т.д. Представьте, что вы читаете тысячи новостных статей и хотите быстро узнать, какие компании упоминаются, кто является ключевыми фигурами или где происходили события. NER делает это возможным.

Мы активно используем spaCy для быстрого и точного NER. Она поставляется с предварительно обученными моделями для различных языков, что позволяет нам сразу приступить к работе. Когда требуется более высокая точность или работа со специфическими сущностями, мы обращаемся к более продвинутым библиотекам, таким как Flair, которая основана на мощных нейросетевых архитектурах и часто демонстрирует выдающиеся результаты. Также мы экспериментировали с использованием CRF (Conditional Random Fields) для распознавания сущностей, когда необходимо было создать модель для очень специфической предметной области с ограниченным набором размеченных данных.

Word Embeddings: От слов к векторам смысла

Один из самых значительных прорывов в NLP за последние годы, это Word Embeddings, или векторные представления слов. Вместо того чтобы просто присваивать каждому слову уникальный ID, Word Embeddings представляют слова как плотные векторы в многомерном пространстве. Главная идея в том, что слова, имеющие схожее значение, будут располагаться близко друг к другу в этом пространстве. Это позволяет моделям улавливать семантические отношения между словами.

Мы много работали с:

- Word2Vec: Это одна из первых и наиболее популярных моделей, предложенная Google. Она бывает двух видов: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). Мы используем библиотеку Gensim для обучения собственных Word2Vec моделей на наших данных.

- GloVe (Global Vectors for Word Representation): Другой популярный метод, который сочетает в себе преимущества глобальной матричной факторизации и локальных оконных методов.

- FastText: Разработанный Facebook, FastText расширяет Word2Vec, представляя слова как набор символьных n-грамм. Это позволяет ему лучше работать с редкими словами и справляться с опечатками.

Помимо отдельных слов, мы также научились векторизовать целые предложения и документы. Для этого мы применяем Sentence Transformers и Doc2Vec (расширение Word2Vec от Gensim). Эти методы позволяют нам сравнивать документы по их смысловому содержанию, находить похожие статьи или кластеризовать большие массивы текстов.

Тематическое моделирование: Обнаруживаем скрытые темы

Когда у нас есть большой корпус документов, часто возникает вопрос: о чем все эти тексты? Тематическое моделирование, это мощный инструмент, который помогает нам автоматически обнаруживать скрытые абстрактные "темы" в коллекции текстов. Каждая тема представлена набором слов, которые часто встречаются вместе.

Мы активно применяем библиотеку Gensim для:

- LDA (Latent Dirichlet Allocation): Это один из самых популярных алгоритмов тематического моделирования. Он предполагает, что каждый документ представляет собой смесь нескольких тем, и каждая тема состоит из распределения слов.

- LSI (Latent Semantic Indexing): Более старый, но все еще полезный метод, основанный на сингулярном разложении (SVD) матрицы "слово-документ".

- NMF (Non-negative Matrix Factorization): Еще один метод, который часто используется для тематического моделирования и хорошо себя показывает, особенно когда нужно интерпретировать компоненты.

Мы часто сравниваем модели LDA и NMF, чтобы выбрать ту, которая лучше всего подходит для конкретного набора данных и задачи, основываясь на интерпретируемости тем и их связности. Этот подход незаменим для анализа отзывов клиентов, новостных лент или научных публикаций.

Извлечение ключевых фраз: Суть в нескольких словах

Иногда нам нужно быстро понять, о чем идет речь в документе, выделив из него наиболее важные слова или фразы. Для этого мы используем алгоритмы извлечения ключевых фраз. Мы успешно применяли:

- RAKE (Rapid Automatic Keyword Extraction): Это довольно простой, но эффективный алгоритм, который основан на частотности слов и их встречаемости в пределах предложений.

- TextRank: Более сложный алгоритм, основанный на PageRank, который строит граф из слов или предложений и ранжирует их по важности. Мы используем TextRank не только для извлечения ключевых слов, но и для суммаризации текста, выделяя наиболее важные предложения.

Разработка систем суммаризации текста, будь то экстрактивная (извлечение существующих предложений) или абстрактивная (генерация новых предложений, передающих смысл), стала для нас одним из наиболее интересных направлений. Хотя абстрактивная суммаризация требует более сложных моделей на основе трансформеров, экстрактивные методы с TextRank уже дают впечатляющие результаты.

Эмоции и отношения: Анализ тональности и стилистики

Текст — это не просто набор фактов, это еще и отражение эмоций, мнений и отношений. Понимание этих аспектов позволяет нам глубже анализировать данные и принимать более обоснованные решения. Мы активно исследовали, как компьютер может "почувствовать" настроение, выраженное в словах.

Анализ тональности (Sentiment Analysis): Чувствуем пульс аудитории

Анализ тональности, или сентимент-анализ, стал неотъемлемой частью нашего инструментария. Он позволяет определить эмоциональную окраску текста — положительную, отрицательную или нейтральную. Это критически важно для анализа отзывов клиентов, сообщений в социальных сетях и финансовых новостей.

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Мы часто используем VADER для анализа тональности, особенно в коротких текстах из социальных сетей. Он специально обучен для понимания тональности, выраженной в неформальном языке, включая смайлики, сокращения и сленг.

- TextBlob: Это еще одна простая, но мощная библиотека для анализа тональности, а также для других базовых задач NLP. Хотя у нее есть свои ограничения, для быстрого прототипирования она незаменима.

Анализ тональности сообщений в социальных сетях (Twitter/Reddit) с учетом сарказма и иронии — это отдельная сложная задача, над которой мы постоянно работаем, исследуя более продвинутые модели. Мы также применяли анализ тональности для финансовых новостей, чтобы предсказывать изменения на рынке, и для анализа отзывов о продуктах по категориям, выявляя сильные и слабые стороны.

Анализ стилистики и неформального языка

Помимо тональности, мы также углублялись в анализ стилистики текстов, пытаясь определить авторский почерк, сложность предложений, использование специфической лексики. Это может быть полезно для задач определения авторства или для адаптации контента под целевую аудиторию.

Современные тексты часто содержат эмодзи и сленг, и игнорировать их — значит упускать часть смысла. Мы разрабатывали собственные инструменты для нормализации сленга и учитывали эмодзи в анализе тональности, что значительно повышает точность наших моделей. Построение специализированных словарей и тезаурусов для таких задач стало для нас привычной практикой.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Машинное обучение в NLP: От классификации до генерации

Истинная мощь NLP раскрывается, когда мы сочетаем его с методами машинного обучения. Это позволяет нам не просто извлекать информацию, но и делать прогнозы, классифицировать данные и даже генерировать новый текст. Мы прошли путь от классических алгоритмов до современных нейросетей, и каждый этап приносил новые возможности.

Классификация текстов: Распределяем по категориям

Классификация текстов — одна из самых распространенных задач в NLP. Это может быть категоризация статей по темам, фильтрация спама, определение жанра книги или классификация отзывов по их тональности. Мы активно используем библиотеку Scikit-learn для этих целей, так как она предоставляет широкий спектр алгоритмов машинного обучения.

- SVM (Support Vector Machines): Мы часто применяем SVM для классификации текста, так как они хорошо работают с высокоразмерными данными (как в случае с TF-IDF векторизацией) и часто дают отличные результаты.

- Наивный Байесовский классификатор: Это простой, но очень эффективный алгоритм, который хорошо подходит для классификации текстов, особенно когда есть много независимых признаков (слов).

С развитием глубокого обучения мы перешли к использованию фреймворков, таких как PyTorch и TensorFlow, для создания более сложных нейросетей NLP, включая LSTM-сети (Long Short-Term Memory). Эти сети способны улавливать долгосрочные зависимости в тексте, что делает их идеальными для задач, где важен контекст.

Кластеризация текстов: Ищем естественные группы

В отличие от классификации, где у нас есть предопределенные категории, кластеризация — это метод машинного обучения без учителя, который позволяет нам находить естественные группы или кластеры в наших данных. Это особенно полезно, когда мы не знаем заранее, какие темы или категории существуют в нашем текстовом корпусе. Мы использовали Scikit-learn для применения таких алгоритмов, как K-Means и DBSCAN, для кластеризации текстов и отзывов.

Трансформеры и глубокое обучение: Новая эра в NLP

Появление трансформерных архитектур, таких как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer), произвело революцию в NLP. Эти модели, как правило, предварительно обучены на огромных объемах текста и способны понимать контекст слова гораздо лучше, чем предыдущие методы. Мы активно используем библиотеку Hugging Face Transformers для широкого круга задач:

- Сложные задачи NLP: От улучшенного NER до анализа тональности с учетом тонких нюансов.

- Генерация текста: GPT-модели позволяют нам создавать связный и осмысленный текст — от написания статей до генерации диалогов для чат-ботов.

- Машинный перевод: Трансформеры являются основой современных систем машинного перевода, обеспечивая выдающееся качество.

- Вопросно-ответные системы (QA): Мы разрабатываем QA-системы, которые могут находить ответы на вопросы в больших текстовых корпусах, используя трансформерные модели.

- Тонкая настройка (Fine-tuning): Мы берем предварительно обученные модели и дообучаем их на наших специфических данных, чтобы адаптировать их под конкретные задачи с высокой точностью. Например, fine-tuning BERT для задачи NER или классификации в узкоспециализированной области.

Использование GPU-ускорения стало необходимостью при работе с такими моделями, и мы активно применяем его для обработки больших текстовых массивов.

Разработка систем: От чат-ботов до суммаризации

Наш опыт включает и разработку полноценных NLP-систем:

- Чат-боты на Python: Мы экспериментировали с фреймворком Rasa для создания интерактивных чат-ботов, способных понимать естественный язык и вести диалог.

- Системы суммаризации текста: Как экстрактивные (выделяющие ключевые предложения), так и абстрактивные (генерирующие новые сокращенные версии) с использованием трансформерных моделей.

- Системы машинного перевода: Разработка решений для автоматического перевода узкоспециализированных текстов, где обычные переводчики не справляются.

- Системы для автоматической категоризации статей и тегирования контента: Это существенно упрощает навигацию и поиск информации.

Продвинутые техники и вызовы

Мир NLP постоянно развивается, и мы постоянно сталкиваемся с новыми вызовами и осваиваем продвинутые техники. Наш путь не ограничивается базовыми задачами; мы всегда ищем способы улучшить наши системы и расширить их возможности.

Многоязычный NLP: За пределами английского

Работа с многоязычными текстовыми корпусами — это отдельная область. Мы обнаружили, что для языков с богатой морфологией, таких как русский, необходимы специализированные инструменты. Stanza отлично справляется с морфологическим анализом и синтаксическим парсингом для русского языка. Для мультиязычности и анализа редких языков мы использовали библиотеку Polyglot.

Работа с нелатинскими алфавитами в Python NLP требует особого внимания к кодировкам и правильной обработке символов, и мы накопили в этом существенный опыт.

Работа с "грязными" данными и специфическими форматами

В реальном мире данные редко бывают идеальными. Мы часто сталкиваемся с проблемами обработки неполных и ошибочных данных. Это требует разработки инструментов для очистки текста, исправления орфографии (например, с помощью библиотеки Jellyfish для сравнения строк и поиска похожих), нормализации пунктуации и удаления HTML-тегов.

Извлечение текста из PDF-документов стало возможным благодаря библиотеке PyMuPDF, что позволило нам анализировать юридические и медицинские записи, финансовые отчетности, которые часто хранятся в этом формате.

Анализ связей и паттернов

Мы не ограничиваемся анализом отдельных слов или документов. Мы также разрабатываем модели для выявления связей между сущностями (например, кто связан с какой организацией) и используем Graph Embeddings для анализа взаимосвязей в тексте. Анализ частотности слов и n-грамм, а также выявление поведенческих паттернов в чатах и пользовательских запросах, помогает нам лучше понимать динамику общения и потребности пользователей.

Анализ временных рядов в текстовых данных позволяет нам отслеживать изменения тональности или тем с течением времени, например, в новостных лентах или постах в социальных сетях, выявляя сезонность или тренды.

Инструменты для оценки и визуализации

Как понять, насколько хороша наша модель? Оценка качества моделей — это критически важный этап. Мы используем такие метрики, как F1-score, Precision и Recall для оценки NER-моделей и других классификаторов. Сравнение различных методов векторизации (TF-IDF vs Word2Vec), моделей тематического моделирования (LDA vs NMF) и методов лемматизации (SpaCy vs NLTK) позволяет нам выбирать оптимальные подходы.

Визуализация текстовых данных помогает нам лучше понять результаты анализа. Мы создаем облака слов (Word Clouds) для быстрого обзора ключевых терминов и тепловые карты (Heatmaps) для отображения взаимосвязей или частотности. Библиотека Sweetviz также оказалась полезной для быстрого EDA (Exploratory Data Analysis) текстовых данных.

Разработка собственных инструментов и автоматизация

Часто для специфических задач нам приходится разрабатывать собственные инструменты: для автоматической разметки данных, для проверки грамматики и фактов (Fact-Checking), для создания словарей терминов и тезаурусов. Это позволяет нам максимально адаптировать решения под наши нужды и автоматизировать рутинные процессы.

Обработка текста в режиме реального времени (Streaming NLP), это еще одна область, в которой мы активно работаем, разрабатывая системы, способные анализировать потоковые данные, например, из социальных медиа или лог-файлов.

Наши любимые инструменты: Краткий обзор библиотек

За время нашего пути мы собрали внушительный арсенал библиотек Python, каждая из которых по-своему уникальна и незаменима. Вот краткий список тех, что стали нашими верными спутниками:

- NLTK: Классика жанра, наш стартовый набор для токенизации, стемминга, работы со стоп-словами и базового морфологического анализа.

- spaCy: Мощная и быстрая библиотека для продакшн-уровня NLP, особенно для NER, лемматизации и синтаксического парсинга.

- Gensim: Наш выбор для тематического моделирования (LDA, LSI, NMF), Word2Vec и Doc2Vec.

- Scikit-learn: Универсальный фреймворк для машинного обучения, незаменим для классификации и кластеризации текстов, а также для создания кастомных векторизаторов (CountVectorizer, TfidfVectorizer).

- Hugging Face Transformers: С этим фреймворком мы погрузились в мир трансформеров — BERT, GPT и другие модели для самых сложных задач.

- TextBlob: Простая в использовании библиотека для быстрого анализа тональности и других базовых операций.

- VADER: Специализированный инструмент для анализа тональности в социальных сетях.

- Beautiful Soup: Наш надежный помощник для веб-скрейпинга и извлечения текста из HTML.

- Stanza: Отличный выбор для глубокого лингвистического анализа, особенно для русского языка и языков с богатой морфологией.

- PyTorch / TensorFlow: Фреймворки для создания нейросетей, от LSTM до более сложных архитектур.

- Rasa: Инструмент для разработки умных чат-ботов.

- Polyglot: Для работы с мультиязычными текстами и редкими языками.

- Textacy: Продвинутая библиотека для извлечения информации, работы с зависимостями и другими сложными задачами.

- FastText: Для эффективной работы с редкими словами и Word Embeddings.

- RAKE / TextRank: Для извлечения ключевых слов и суммаризации.

- Flair: Для state-of-the-art NER и других задач глубокого обучения в NLP.

- Sweetviz: Для быстрого визуального анализа текстовых данных.

- PyMuPDF: Для извлечения текста из PDF-документов.

- Jellyfish: Для сравнения строк и поиска ошибок.

- Sentence Transformers: Для векторизации предложений и документов.

- TextDistance: Для измерения сходства между текстами и поиска дубликатов.

- Scipy: Для научных вычислений и анализа текстовых данных.

- Gentle: Для распознавания речи (Speech-to-Text), открывая новые горизонты в работе с аудио.

Этот список постоянно пополняется, ведь мир NLP не стоит на месте, и мы всегда в поиске новых, более эффективных решений.

Наш путь в мире NLP с Python, это непрерывное обучение и исследование. Мы видели, как простые скрипты превращаются в мощные аналитические системы, как текст, который когда-то был просто набором символов, начинает раскрывать свои тайны, предоставляя бесценные инсайты; От базовой предобработки до глубокого обучения с трансформерами, Python оказался невероятно гибким и мощным инструментом, способным решать самые разнообразные задачи.

Мы верим, что будущее принадлежит тем, кто умеет извлекать смысл из данных, и текстовые данные здесь занимают особое место. Неважно, начинаете ли вы свой путь или уже являетесь опытным специалистом, мир NLP постоянно предлагает новые вызовы и возможности. Мы надеемся, что наш опыт вдохновит вас на собственные исследования и поможет вам освоить этот захватывающий мир. Продолжайте экспериментировать, учиться и, самое главное, наслаждаться процессом! Ведь разговор с текстом — это не просто задача, это искусство, которое с каждым днем становится все более доступным благодаря таким замечательным инструментам, как Python и его богатая экосистема библиотек.

Подробнее

| NLP основы Python | Токенизация стемминг NLTK | NER spaCy Python | Тематическое моделирование LDA | Анализ тональности VADER |

| Word Embeddings Word2Vec | Трансформеры Hugging Face | Классификация текстов Scikit-learn | Разработка чат-ботов Rasa | Очистка текста регулярные выражения |