- Расшифровка Языка: Ваш Полный Путеводитель по NLP в Python от А до Я

- Первые Шаги в Мир Текста: От Сырых Данных к Понятным Блокам

- Основы NLTK: Токенизация и Стемминг

- Продвинутая Лемматизация и Стемминг с SpaCy

- Регулярные Выражения (re) в Предобработке Текста

- Использование TextBlob для Простого NLP

- Превращаем Слова в Числа: Векторизация и Представление Текста

- Разработка Собственных Векторизаторов Текста: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Раскрываем Смыслы: Основные Задачи и Методы NLP

- Использование SpaCy для Быстрого NER (Распознавание Именованных Сущностей)

- Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

- Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

- Применение Scikit-learn для Классификации Текстов

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Продвинутые Приложения и Специализированные Инструменты

- Библиотека Beautiful Soup для Веб-Скрейпинга Текста

- Обработка Многоязычных Текстовых Корпусов: Polyglot и Stanza

- Анализ Текста для Извлечения Ключевых Фраз с RAKE и TextRank

- Разработка Систем Суммаризации Текста (Abstractive vs Extractive)

- Инструменты для Визуализации Текстовых Данных (Word Clouds‚ Heatmaps)

- Практические Задачи и Реальные Сценарии

- Анализ Текстов Отзывов Клиентов

- Разработка Чат-ботов на Python (Rasa Framework)

- Анализ Стиллистики Текстов (Авторский Почерк) и Обнаружение Плагиата

- Обработка Больших Текстовых Массивов (Big Data NLP)

Расшифровка Языка: Ваш Полный Путеводитель по NLP в Python от А до Я

В современном мире текст окружает нас повсюду: от электронных писем и сообщений в социальных сетях до научных статей и юридических документов. Поток информации настолько огромен‚ что человеческий мозг просто не в состоянии обработать и понять все нюансы. Именно здесь на помощь приходит Обработка Естественного Языка (NLP — Natural Language Processing) – захватывающая область на стыке искусственного интеллекта‚ компьютерной лингвистики и машинного обучения‚ которая позволяет компьютерам понимать‚ интерпретировать и генерировать человеческий язык. Мы‚ как опытные блогеры и энтузиасты технологий‚ постоянно ищем способы сделать сложные вещи доступными и понятными. И сегодня мы погрузимся в мир NLP с использованием Python‚ чтобы показать вам‚ как мы можем не просто читать текст‚ но и заставить его говорить с нами‚ раскрывая скрытые смыслы и закономерности.

Возможно‚ вы уже сталкивались с NLP‚ даже не подозревая об этом. Голосовые помощники‚ такие как Siri или Алиса‚ системы автокоррекции‚ спам-фильтры в электронной почте‚ рекомендательные системы‚ которые предлагают вам следующий фильм или товар – всё это работает благодаря сложным алгоритмам обработки естественного языка. Наша цель в этой статье – не просто перечислить инструменты‚ но и показать‚ как мы на собственном опыте используем их для решения реальных задач‚ превращая хаотичный массив слов в структурированные данные‚ готовые к анализу и дальнейшему применению. Мы пройдем путь от самых азов до продвинутых концепций‚ таких как трансформеры‚ и покажем‚ как мы строим системы‚ которые не только понимают‚ но и генерируют текст.

Первые Шаги в Мир Текста: От Сырых Данных к Понятным Блокам

Прежде чем компьютер сможет что-либо понять в нашем тексте‚ нам нужно его подготовить. Представьте‚ что вы хотите испечь пирог: сначала нужно отмерить ингредиенты‚ просеять муку‚ нарезать фрукты. В NLP этот процесс называется предобработкой текста. Мы на этом этапе превращаем сырой‚ неструктурированный текст в форму‚ пригодную для машинной обработки. Это фундамент‚ на котором мы строим все наши дальнейшие аналитические модели.

Основы NLTK: Токенизация и Стемминг

Наш первый инструмент в арсенале – это NLTK (Natural Language Toolkit). Это одна из старейших и наиболее полных библиотек для NLP в Python‚ которая служит отличной отправной точкой для новичков. Мы начинаем с токенизации – процесса разделения текста на отдельные «токены» или слова. Без этого шага‚ компьютер воспринимал бы весь текст как одну длинную строку‚ что совершенно бесполезно для анализа. NLTK предлагает простые и эффективные функции для этого.

После токенизации мы часто сталкиваемся с тем‚ что одно и то же слово может иметь разные формы (например‚ «бегать»‚ «бегу»‚ «бежал»). Для многих задач нам нужно свести их к одной базовой форме. Здесь на помощь приходит стемминг (stemming) – процесс усечения слов до их «корня» или основы. Это не всегда создает реальное слово‚ но позволяет алгоритмам рассматривать однокоренные слова как одно и то же понятие. Нам приходится учитывать‚ что стемминг может быть достаточно агрессивным‚ поэтому мы всегда взвешиваем его применимость.

Продвинутая Лемматизация и Стемминг с SpaCy

Хотя NLTK прекрасно справляется с базовыми задачами‚ для более сложных и точных операций мы часто обращаемся к spaCy. Это библиотека‚ разработанная с учетом производительности и использующая продвинутые нейронные сети для обработки текста. В отличие от стемминга‚ лемматизация (lemmatization) с помощью spaCy возвращает нам не просто корень‚ а словарную (нормальную) форму слова‚ учитывая его часть речи и грамматический контекст. Например‚ «бежали» станет «бежать»‚ а не просто «беж». Это критически важно для задач‚ где сохранение смысла слова имеет первостепенное значение.

Мы регулярно используем spaCy не только для лемматизации‚ но и для синтаксического парсинга‚ который позволяет нам понять грамматическую структуру предложения‚ определить подлежащие‚ сказуемые и взаимосвязи между словами. Это открывает двери для более глубокого анализа текста‚ например‚ для извлечения фактов и отношений.

Регулярные Выражения (re) в Предобработке Текста

Несмотря на мощь библиотек‚ иногда нам нужно решать специфические задачи очистки текста‚ которые выходят за рамки стандартных функций токенизации или лемматизации. Здесь в дело вступают регулярные выражения (re) – мощный инструмент для поиска и замены текстовых паттернов. Мы используем их для:

- Удаления HTML-тегов из веб-страниц‚ полученных с помощью веб-скрейпинга.

- Извлечения конкретных данных‚ таких как даты‚ номера телефонов‚ адреса электронной почты.

- Нормализации пунктуации‚ удаления лишних пробелов или специальных символов.

- Работы с эмодзи и сленгом‚ где нужно распознать специфические паттерны.

Мастерство владения регулярными выражениями – это ценный навык для любого специалиста по NLP‚ позволяющий нам гибко адаптироваться к самым разнообразным форматам текстовых данных.

Использование TextBlob для Простого NLP

Для быстрых и несложных задач‚ когда нам не нужна максимальная производительность или глубокий анализ‚ мы часто обращаемся к TextBlob. Эта библиотека построена поверх NLTK и предоставляет более дружелюбный интерфейс для выполнения базовых операций. Она идеально подходит для прототипирования и быстрого получения результатов. С TextBlob мы можем легко:

- Разделить текст на предложения и слова.

- Определить часть речи (POS-теггинг).

- Выполнить стемминг и лемматизацию.

- Определить язык текста‚ что крайне полезно при работе с многоязычными корпусами.

TextBlob – это как швейцарский нож для мелких задач NLP‚ который всегда под рукой и позволяет нам быстро получить необходимую информацию без глубокого погружения в детали.

Превращаем Слова в Числа: Векторизация и Представление Текста

Компьютеры понимают числа‚ а не слова. Чтобы мы могли применять алгоритмы машинного обучения к тексту‚ нам необходимо преобразовать слова и предложения в числовые векторы. Этот процесс‚ называемый векторизацией или эмбеддингом‚ является краеугольным камнем современного NLP. Наша задача – найти такое численное представление‚ которое бы максимально точно отражало семантическое значение слов и их взаимосвязи.

Разработка Собственных Векторизаторов Текста: CountVectorizer и TfidfVectorizer

Начнем с классики – CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn.

CountVectorizer просто подсчитывает частоту появления каждого слова в документе. Мы создаем словарь всех уникальных слов в нашем корпусе‚ а затем каждый документ представляем как вектор‚ где каждая позиция соответствует слову из словаря‚ а значение – количеству его появлений. Это просто‚ но эффективно для многих задач. Однако‚ у него есть недостаток: слова‚ часто встречающиеся во всех документах (например‚ предлоги или артикли)‚ могут доминировать‚ не неся при этом особого смысла.

Чтобы решить эту проблему‚ мы используем TfidfVectorizer (Term Frequency-Inverse Document Frequency). Этот векторизатор не только учитывает частоту слова в документе (TF)‚ но и придает больший вес словам‚ которые редко встречаются в других документах (IDF). Таким образом‚ слова‚ которые являются уникальными и важными для конкретного документа‚ получают более высокий балл. Мы часто применяем TF-IDF для задач классификации текстов и извлечения ключевых фраз‚ так как он помогает нам выделить наиболее информативные термины.

Пример использования TF-IDF:

Если мы анализируем отзывы клиентов‚ слово "отлично" может быть частым (высокий TF)‚ но оно может быть и во многих отзывах (низкий IDF)‚ что снижает его уникальность. А вот слово "задержка" или "брак" могут иметь невысокий TF‚ но очень высокий IDF‚ если они встречаются только в негативных отзывах‚ делая их более значимыми для определения негативного тона.

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

CountVectorizer и TF-IDF хороши‚ но они не учитывают семантическую близость слов. То есть‚ слова "король" и "царь" для них будут так же далеки‚ как "король" и "стол". Здесь в игру вступают Word Embeddings – векторные представления слов‚ которые захватывают их смысловые отношения. Мы активно используем Gensim – библиотеку‚ специализирующуюся на тематическом моделировании и работе с векторными представлениями.

С помощью Gensim мы обучаем модели Word2Vec и GloVe.

- Word2Vec (представленный Google) строит векторные представления слов таким образом‚ что слова с похожим контекстом (то есть‚ слова‚ которые часто встречаются рядом) оказываються близки друг к другу в многомерном пространстве. Мы можем выполнять с этими векторами арифметические операции‚ например‚ "король ― мужчина + женщина = королева".

- GloVe (Global Vectors for Word Representation)‚ разработанный в Стэнфорде‚ также создает векторные представления‚ но делает это‚ анализируя глобальную статистику сопоставлений слов в корпусе.

Эти подходы позволяют нам перейти от простого подсчета слов к пониманию их смысловых связей‚ что критически важно для более сложных задач‚ таких как анализ тональности‚ тематическое моделирование и машинный перевод.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Что делать‚ если нам нужно представить не отдельное слово‚ а целое предложение или документ? Для этого мы используем расширения Word Embeddings.

- Doc2Vec (также известный как Paragraph2Vec) – это расширение Word2Vec‚ которое позволяет нам генерировать векторные представления для целых документов или абзацев. Gensim также предоставляет отличную реализацию Doc2Vec‚ которую мы успешно применяем для поиска похожих документов или кластеризации текстов.

- Sentence Transformers – это более современный подход‚ основанный на архитектуре трансформеров. Эти модели специально обучены для создания семантически значимых векторных представлений предложений‚ которые затем можно сравнивать с помощью косинусного сходства. Мы используем Sentence Transformers для задач поиска семантически похожих вопросов в FAQ‚ определения дубликатов статей или анализа поведенческих паттернов в чатах.

Использование этих методов позволяет нам перевести высокоуровневые текстовые сущности в численную форму‚ открывая путь для применения мощных алгоритмов машинного обучения.

Раскрываем Смыслы: Основные Задачи и Методы NLP

После того как мы подготовили текст и преобразовали его в числа‚ мы можем приступить к решению конкретных задач NLP. Эта часть нашей работы наиболее увлекательна‚ ведь именно здесь мы заставляем компьютер "думать" и "понимать".

Использование SpaCy для Быстрого NER (Распознавание Именованных Сущностей)

Одной из наиболее фундаментальных и полезных задач в NLP является Распознавание Именованных Сущностей (NER – Named Entity Recognition). Это процесс идентификации и классификации именованных сущностей в тексте‚ таких как имена людей‚ организаций‚ географических объектов‚ дат‚ денежных сумм и т.д. Мы активно используем spaCy для NER‚ так как она предлагает высокопроизводительные и точные предобученные модели для множества языков‚ включая русский.

Когда мы обрабатываем большой массив новостных статей или юридических документов‚ NER позволяет нам автоматически извлекать ключевую информацию‚ такую как участники событий‚ места их проведения и временные рамки. Это значительно ускоряет процесс анализа и позволяет строить сложные системы извлечения фактов.

Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

Часто‚ работая с большими коллекциями документов‚ мы хотим понять‚ какие основные темы в них обсуждаются‚ без необходимости читать каждый документ вручную. Для этого мы применяем тематическое моделирование‚ и нашим незаменимым помощником здесь является Gensim.

- LDA (Latent Dirichlet Allocation) – это один из самых популярных алгоритмов тематического моделирования. Он предполагает‚ что каждый документ является смесью нескольких тем‚ а каждая тема‚ в свою очередь‚ является смесью слов. LDA помогает нам автоматически обнаруживать скрытые темы в текстовых корпусах.

- LSI (Latent Semantic Indexing) – еще один метод‚ который использует сингулярное разложение для выявления скрытых семантических структур в тексте. LSI очень эффективен для определения семантического сходства между словами и документами.

Мы используем тематическое моделирование для анализа отзывов клиентов‚ чтобы выявить основные болевые точки или‚ наоборот‚ сильные стороны продукта. Это также помогает нам категоризировать статьи или понимать общие тенденции в больших объемах неструктурированных данных.

Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

Понимание эмоциональной окраски текста – крайне важная задача для бизнеса и социальных исследований. Мы хотим знать‚ что люди думают о продукте‚ услуге или событии. Этим занимается анализ тональности (Sentiment Analysis).

Для быстрого и эффективного анализа тональности англоязычного текста мы часто обращаемся к VADER (Valence Aware Dictionary and sEntiment Reasoner). Это лексический и основанный на правилах анализатор тональности‚ который специально разработан для анализа тональности в социальных сетях. Он не требует обучения на больших данных и умеет учитывать нюансы‚ такие как использование заглавных букв‚ пунктуации и усилителей.

Для более простого анализа или для быстрого прототипирования мы также используем TextBlob‚ который предоставляет встроенную функцию для определения тональности‚ возвращая полярность (от -1 до +1) и субъективность текста. Однако‚ для русского языка или более глубокого анализа‚ нам приходится применять более сложные модели‚ основанные на машинном обучении и трансформерах.

Применение Scikit-learn для Классификации Текстов

Одной из самых распространенных задач в NLP является классификация текстов – то есть присвоение метки или категории документу. Будь то спам-фильтр‚ категоризация новостей по темам или определение языка‚ Scikit-learn предоставляет мощный и гибкий инструментарий для этих целей.

Мы часто используем различные модели машинного обучения из Scikit-learn:

- Наивный Байесовский классификатор (Naive Bayes): Прост в реализации и часто дает хорошие результаты‚ особенно для текста.

- Метод опорных векторов (SVM – Support Vector Machines): Мощный алгоритм‚ который отлично справляется с высокоразмерными данными‚ такими как векторы текста.

- Логистическая регрессия (Logistic Regression): Несмотря на название‚ это классификатор‚ который хорошо работает как базовый уровень.

Перед использованием этих моделей мы обязательно векторизуем наш текст‚ чаще всего с помощью TF-IDF. Результаты классификации мы оцениваем с помощью метрик‚ таких как точность (Precision)‚ полнота (Recall) и F1-мера‚ чтобы убедиться в качестве нашей модели.

"Язык ─ это одежда мысли."

Трансформеры (Hugging Face) для Сложных Задач NLP

Последние годы принесли революцию в NLP благодаря архитектуре трансформеров. Это вершина современных достижений‚ позволяющая нам решать задачи‚ которые ранее казались невозможными. Библиотека Hugging Face Transformers стала де-факто стандартом для работы с этими моделями‚ предоставляя доступ к сотням предобученных моделей‚ таких как BERT‚ GPT‚ RoBERTa и многих других.

Мы используем трансформеры для:

- Тонкой настройки (Fine-tuning) предварительно обученных моделей под наши специфические задачи‚ будь то классификация текста‚ NER или суммаризация. Это позволяет нам достигать результатов‚ которые значительно превосходят традиционные методы.

- Генерации текста (с использованием моделей типа GPT)‚ что открывает возможности для автоматического создания контента‚ ответов на вопросы или даже написания кода.

- Разработки систем вопросно-ответных систем (QA)‚ где модель может находить точные ответы на вопросы в заданном тексте.

- Машинного перевода‚ создавая системы‚ способные переводить текст между языками с удивительной точностью.

Работа с трансформерами требует больше вычислительных ресурсов‚ но результаты‚ которые они дают‚ оправдывают эти затраты‚ позволяя нам создавать по-настоящему интеллектуальные системы.

Продвинутые Приложения и Специализированные Инструменты

Мир NLP не ограничивается только базовыми задачами. Существует множество специализированных инструментов и методов‚ которые позволяют нам решать уникальные и сложные проблемы‚ работая с разнообразными источниками данных и типами текстов. Мы постоянно исследуем новые возможности и интегрируем их в наши проекты.

Библиотека Beautiful Soup для Веб-Скрейпинга Текста

Часто данные‚ которые нам нужны для NLP‚ находятся в открытом доступе на веб-сайтах. Для их сбора мы используем Beautiful Soup – библиотеку Python для парсинга HTML и XML документов. Она позволяет нам:

- Извлекать заголовки‚ параграфы‚ ссылки и другие текстовые элементы со страниц.

- Фильтровать ненужную информацию‚ такую как рекламные блоки или навигационные меню.

- Собирать большие объемы текстовых данных для дальнейшего анализа.

Веб-скрейпинг – это первый шаг во многих проектах‚ где нам нужен свежий или специфический текстовый корпус‚ и Beautiful Soup делает этот процесс максимально удобным и эффективным.

Обработка Многоязычных Текстовых Корпусов: Polyglot и Stanza

Мир не ограничивается одним языком‚ и наши проекты тоже. Работа с многоязычными текстами требует специализированных инструментов.

- Polyglot – это легкая библиотека‚ предоставляющая широкий спектр функций для многих языков‚ включая определение языка‚ токенизацию‚ NER‚ анализ тональности и лемматизацию. Мы используем ее‚ когда нам нужна быстрая обработка для относительно редких языков или когда мы работаем с разнообразными многоязычными данными.

- Stanza (разработанная Stanford NLP Group) – это более мощная и точная библиотека‚ особенно для языков с богатой морфологией‚ таких как русский. Она предоставляет полные конвейеры для обработки текста‚ включая токенизацию‚ POS-теггинг‚ лемматизацию и синтаксический анализ‚ с высокой точностью. Мы часто выбираем Stanza для глубокого анализа русского текста.

Эти библиотеки позволяют нам преодолевать языковые барьеры и проводить комплексный анализ текстов на разных языках.

Анализ Текста для Извлечения Ключевых Фраз с RAKE и TextRank

В больших текстах найти основную идею или ключевые концепции бывает непросто. Для автоматического извлечения ключевых фраз мы используем несколько подходов:

- RAKE (Rapid Automatic Keyword Extraction) – это алгоритм‚ основанный на графах‚ который идентифицирует ключевые фразы‚ анализируя частоту слов и их встречаемость в пределах заданных границ (например‚ между знаками пунктуации). Он прост в реализации и часто дает хорошие результаты для различных типов текста.

- TextRank – это еще один алгоритм‚ основанный на графах‚ вдохновленный PageRank. Он ранжирует слова или предложения в тексте на основе их связей. Мы используем TextRank не только для извлечения ключевых фраз‚ но и для суммаризации текста‚ выбирая наиболее значимые предложения‚ которые наилучшим образом отражают содержание документа.

Извлечение ключевых фраз и суммаризация – это бесценные инструменты для быстрого осмысления больших объемов информации.

Разработка Систем Суммаризации Текста (Abstractive vs Extractive)

Автоматическая суммаризация – это задача создания краткого‚ но информативного изложения более длинного текста. Мы различаем два основных подхода:

- Экстрактивная суммаризация (Extractive Summarization): Эта техника выбирает наиболее важные предложения или фразы из исходного текста и объединяет их в краткое изложение. TextRank – яркий пример такого подхода. Мы используем ее‚ когда важно сохранить оригинальную формулировку.

- Абстрактивная суммаризация (Abstractive Summarization): Этот более сложный подход генерирует новые предложения‚ которые не обязательно присутствуют в исходном тексте‚ но передают его основной смысл. Это требует более глубокого понимания текста и часто реализуется с использованием трансформерных моделей (например‚ на базе GPT или T5). Абстрактивная суммаризация позволяет создавать более связные и естественные резюме‚ но является более сложной в реализации.

Выбор между этими методами зависит от конкретной задачи и доступных ресурсов. Для информационных дайджестов мы часто склоняемся к экстрактивной‚ а для создания уникальных обзоров – к абстрактивной.

Инструменты для Визуализации Текстовых Данных (Word Clouds‚ Heatmaps)

Числа и таблицы – это хорошо‚ но иногда нам нужно наглядно представить результаты анализа. Визуализация помогает быстро понять основные закономерности в текстовых данных.

- Облака слов (Word Clouds): Это отличный способ быстро показать наиболее часто встречающиеся слова в тексте. Размер слова в облаке пропорционален его частоте. Мы используем их для первоначального исследования корпусов или для создания красивых отчетов.

- Тепловые карты (Heatmaps): Когда мы анализируем сходство между документами или словами (например‚ на основе косинусного сходства векторов)‚ тепловые карты позволяют нам визуализировать эти отношения. Более интенсивный цвет указывает на более высокое сходство.

Кроме того‚ библиотеки вроде Matplotlib и Seaborn позволяют нам строить различные графики распределения частотности слов‚ N-грамм и другие статистические визуализации.

Практические Задачи и Реальные Сценарии

Все эти инструменты и методы обретают истинную ценность‚ когда мы применяем их для решения реальных проблем. В нашей практике мы сталкиваемся с широким спектром задач‚ где NLP играет ключевую роль.

Анализ Текстов Отзывов Клиентов

Один из наиболее частых сценариев‚ с которыми мы работаем – это анализ отзывов клиентов. Это золотая жила информации для любого бизнеса. Мы используем комбинацию техник:

| Этап | Метод / Инструмент | Цель |

|---|---|---|

| Сбор данных | Beautiful Soup‚ API соцсетей | Получение отзывов с сайтов‚ форумов‚ соцсетей. |

| Предобработка | NLTK‚ spaCy‚ регулярные выражения | Очистка от HTML‚ пунктуации‚ токенизация‚ лемматизация. |

| Анализ тональности | VADER‚ TextBlob‚ BERT-классификаторы | Определение позитивной‚ негативной или нейтральной окраски. Учет сарказма и сленга. |

| Тематический анализ | Gensim (LDA‚ LSI) | Выявление основных тем‚ которые затрагивают клиенты (цена‚ качество‚ доставка‚ сервис). |

| Извлечение ключевых фраз | RAKE‚ TextRank | Выделение конкретных проблем или преимуществ продукта. |

Такой комплексный подход позволяет нам предоставлять компаниям глубокие инсайты о том‚ что их клиенты действительно думают и чувствуют‚ помогая принимать обоснованные бизнес-решения.

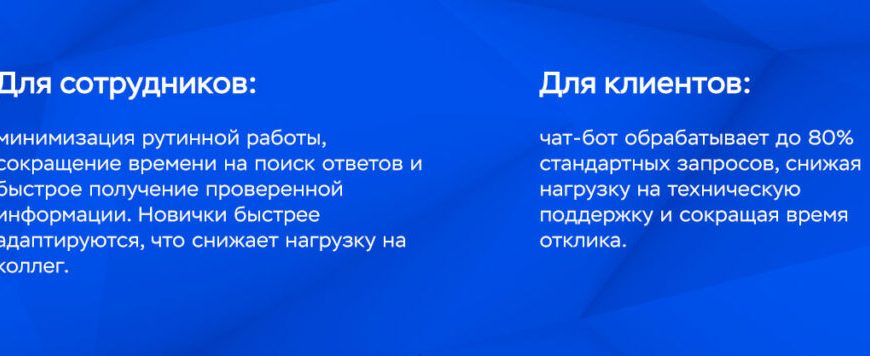

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты стали неотъемлемой частью современного клиентского сервиса и внутренних коммуникаций. Мы имеем опыт разработки интеллектуальных чат-ботов‚ используя Rasa Framework. Rasa – это фреймворк с открытым исходным кодом‚ который позволяет создавать контекстно-зависимые диалоговые системы.

В основе Rasa лежит несколько ключевых NLP-компонентов:

- NLU (Natural Language Understanding): Отвечает за понимание намерений пользователя (например‚ "заказать пиццу") и извлечение сущностей (например‚ "пепперони"‚ "большая").

- Core: Управляет диалогом‚ определяя следующий шаг бота на основе истории разговора и предсказаний NLU.

Мы обучаем модели NLU на собственных данных‚ чтобы бот мог понимать специфический сленг или терминологию‚ характерную для конкретной отрасли. Разработка чат-ботов – это увлекательный процесс‚ который объединяет все наши знания в области NLP для создания интерактивных и полезных систем.

Анализ Стиллистики Текстов (Авторский Почерк) и Обнаружение Плагиата

Иногда нам нужно пойти дальше простого понимания смысла и углубиться в сам стиль написания текста. Анализ стилистики текстов позволяет нам выявлять уникальные черты авторского почерка. Мы анализируем такие параметры‚ как:

- Частотность использования определенных слов и фраз.

- Длина предложений и абзацев.

- Разнообразие лексики (лексическое богатство).

- Использование пунктуации и грамматических конструкций.

Эти методы также лежат в основе систем обнаружения плагиата. Сравнивая текстовые документы на предмет сходства с использованием таких библиотек‚ как TextDistance (для измерения сходства строк и документов) и векторизации (TF-IDF‚ Doc2Vec)‚ мы можем выявлять заимствования и определять степень их оригинальности. Это особенно актуально для академической среды или анализа контента.

Обработка Больших Текстовых Массивов (Big Data NLP)

Когда речь идет об анализе миллионов или миллиардов текстовых документов‚ традиционные подходы могут оказаться слишком медленными или требовательными к памяти. В таких случаях мы применяем специализированные подходы для Big Data NLP.

- Распределенные вычисления: Используем фреймворки‚ такие как Apache Spark‚ для параллельной обработки текстовых данных на кластерах.

- Оптимизированные библиотеки: SpaCy‚ например‚ известна своей производительностью и способностью обрабатывать большие объемы текста. Gensim также оптимизирован для работы с большими корпусами при обучении Word2Vec или LDA.

- GPU-ускорение: Для работы с трансформерными моделями и нейронными сетями мы активно используем GPU‚ что значительно сокращает время обучения и инференса. PyTorch и TensorFlow предоставляют отличные возможности для работы с GPU.

Обработка больших данных требует не только знания NLP‚ но и навыков работы с распределенными системами и оптимизации ресурсов‚ что является неотъемлемой частью нашего опыта.

Как мы видим‚ мир Обработки Естественного Языка в Python – это обширная и постоянно развивающаяся область. От фундаментальной токенизации и стемминга до сложных трансформерных моделей‚ способных генерировать человекоподобный текст‚ у нас есть арсенал инструментов для решения практически любой задачи‚ связанной с языком. Мы прошли путь от простых текстовых файлов до глубокого семантического анализа‚ от извлечения именованных сущностей до создания интерактивных чат-ботов и систем суммаризации.

Каждый инструмент‚ каждая библиотека‚ которые мы рассмотрели‚ представляют собой часть большого пазла‚ позволяющего нам раскрывать скрытые смыслы в потоках информации. Важно помнить‚ что выбор правильного инструмента зависит от конкретной задачи‚ объема данных‚ требуемой точности и доступных вычислительных ресурсов. Наш опыт показывает‚ что комбинация различных подходов‚ гибкость и постоянное обучение новым методикам являются ключом к успеху в этой динамичной сфере.

Мы надеемся‚ что этот путеводитель вдохновил вас на собственные эксперименты и открытия в мире NLP. Возможности безграничны‚ и каждый день появляются новые достижения. Самое главное – это не бояться пробовать‚ учиться на ошибках и постоянно совершенствовать свои навыки. Мы убеждены‚ что с Python и его мощными библиотеками вы сможете заставить текст говорить с вами на совершенно новом уровне. Удачи в ваших лингвистических приключениях!

Подробнее

| Python для анализа текста | Библиотеки NLP в Python | Машинное обучение текста | Векторные представления слов | Нейронные сети для NLP |

| Анализ тональности Python | Извлечение сущностей SpaCy | Тематическое моделирование LDA | Трансформеры Hugging Face | Разработка чат-ботов Rasa |