- Путешествие в мир слов: Как мы осваивали NLP на Python и превращали текст в золото

- Первые шаги: Когда текст становится данными

- Инструменты для быстрого старта: NLTK, spaCy и TextBlob

- От слов к числам: Искусство векторизации текста

- Классические подходы: CountVectorizer и TF-IDF

- Смысловые представления: Word Embeddings (Word2Vec, GloVe, FastText) и Doc2Vec

- Скрытые смыслы: Тематическое моделирование и Анализ тональности

- Тематическое моделирование: LDA, LSI и NMF

- Анализ тональности: От VADER до глубоких моделей

- Машинное обучение на страже текста: Классификация и Распознавание сущностей

- Классификация текстов: От спама до категорий

- Распознавание именованных сущностей (NER): Имена, места, даты

- Эра Трансформеров и Глубокого Обучения: Новая реальность NLP

- Hugging Face и предобученные модели: BERT, GPT

- Продвинутые применения Трансформеров

- Специализированные задачи и инструменты: Расширяем горизонты

- Сбор и очистка данных: Основа любого проекта

- Многоязычность и особенности языка

- Извлечение информации и суммаризация

- Больше, чем просто текст: Стиль, эмоции и проверка фактов

- Визуализация, большие данные и будущие вызовы

- Вместо заключения: Наше NLP-путешествие продолжается

Путешествие в мир слов: Как мы осваивали NLP на Python и превращали текст в золото

Привет, друзья и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами удивительным путешествием, которое совершили, погружаясь в бездонный океан обработки естественного языка (NLP) с помощью Python. Это не просто рассказ о технологиях, это история о том, как мы научились видеть за буквами смыслы, за предложениями, эмоции, а за огромными массивами текста — ценнейшие инсайты. Мир вокруг нас переполнен текстом: электронные письма, сообщения в мессенджерах, статьи, отзывы, юридические документы, логи, и каждый из этих фрагментов содержит потенциально важную информацию. Наша задача была научиться её извлекать, анализировать и использовать. И Python с его богатейшей экосистемой библиотек стал нашим верным компаньоном в этом приключении.

Мы помним те времена, когда текстовые данные казались нам чем-то неподъемным, сложным и требующим глубоких лингвистических знаний. Однако, шаг за шагом, осваивая новые инструменты и подходы, мы убедились: NLP доступно каждому, кто готов экспериментировать и учиться. В этой статье мы расскажем о наших самых значимых открытиях, поделимся практическими советами и покажем, как мы применяли различные библиотеки и модели для решения реальных задач; Приготовьтесь, будет интересно, ведь мы собираемся разобрать всё: от самых основ до продвинутых трансформеров!

Первые шаги: Когда текст становится данными

Наше погружение в NLP началось с осознания простой истины: компьютер не понимает человеческий язык так, как мы. Для машины текст — это всего лишь последовательность символов. Чтобы сделать его "понятным", нам пришлось научиться его структурировать и преобразовывать. И здесь на помощь пришли фундаментальные техники предобработки.

Одной из первых библиотек, с которой мы познакомились, была NLTK (Natural Language Toolkit). Это настоящий швейцарский нож для работы с текстом, полный модулей для самых разных задач. Мы начали с токенизации — процесса разбиения текста на отдельные слова или предложения. Это кажется очевидным, но попробуйте правильно разделить предложения, когда нет явных знаков препинания, или учесть сокращения! NLTK предоставил нам готовые токенизаторы, и это значительно упростило нашу жизнь.

Далее мы столкнулись с проблемой того, что одно и то же слово может иметь разные формы ("бегать", "бегал", "бегущий"). Для того чтобы привести их к единому корню, мы освоили стемминг и лемматизацию. Стемминг (например, с помощью алгоритма Портера из NLTK) просто отсекает окончания, что быстро, но иногда приводит к не совсем "словарным" словам. Лемматизация (которую мы находили более точной, особенно с использованием spaCy или продвинутых модулей NLTK) стремится привести слово к его словарной форме, что гораздо полезнее для последующего анализа.

Но что делать, если в тексте есть лишние символы, HTML-теги, специальные знаки или просто мусор? Здесь на арену вышли регулярные выражения (re). Мы потратили немало времени, изучая синтаксис `re`, и можем сказать, что это одна из самых мощных и универсальных техник для очистки данных. С их помощью мы научились удалять нежелательные символы, находить паттерны, извлекать email-адреса или номера телефонов. Это был настоящий прорыв в нашей способности "причесывать" данные.

Инструменты для быстрого старта: NLTK, spaCy и TextBlob

Помимо базовой предобработки, мы быстро поняли, что нам нужны более комплексные решения для таких задач, как определение частей речи (POS-теггинг), распознавание именованных сущностей (NER) и синтаксический анализ.

NLTK, как мы уже упоминали, стал нашей отправной точкой. Он предоставил нам доступ к обширным корпусам текстов и алгоритмам для POS-теггинга, chunking’а и других лингвистических задач. Мы использовали его для анализа частотности слов и N-грамм, что помогало нам выявлять наиболее значимые слова и фразы в больших текстах.

Однако, когда дело дошло до производительности и более "умного" анализа, мы открыли для себя spaCy. Эта библиотека просто поразила нас своей скоростью и точностью, особенно в задачах распознавания именованных сущностей (NER). spaCy умеет эффективно выделять имена людей, организаций, географические названия, даты и многое другое прямо из текста. Это существенно сократило время, которое мы раньше тратили на ручную разметку или сложные регулярные выражения. Синтаксический парсинг со spaCy также оказался невероятно мощным инструментом для понимания структуры предложений.

Для более простых и быстрых задач, таких как базовый анализ тональности или определение языка, мы часто обращались к TextBlob. Эта библиотека является надстройкой над NLTK и предоставляет очень удобный API для выполнения многих NLP-операций, не требуя глубокого погружения в детали. Она идеально подходила для быстрых прототипов и анализа небольших текстовых фрагментов.

| Библиотека | Основные задачи | Преимущества | Особенности |

|---|---|---|---|

| NLTK | Токенизация, стемминг, лемматизация, POS-теггинг, работа с корпусами | Гибкость, большой набор алгоритмов, образовательный ресурс | Иногда медленнее, требует загрузки моделей |

| spaCy | NER, синтаксический парсинг, токенизация, лемматизация | Высокая скорость, точность, готовые модели для многих языков | Менее модульный, чем NLTK, может быть избыточен для простых задач |

| TextBlob | Анализ тональности, определение языка, базовая предобработка | Простота использования, интуитивный API, быстрые прототипы | Ограниченная функциональность для сложных задач |

От слов к числам: Искусство векторизации текста

Как мы уже поняли, компьютеры лучше всего работают с числами. Поэтому одним из ключевых этапов в нашем NLP-путешествии стало преобразование текста в числовые векторы — процесс, известный как векторизация текста. Это позволяет применять к тексту мощные алгоритмы машинного обучения.

Классические подходы: CountVectorizer и TF-IDF

Мы начали с самых простых, но эффективных методов. CountVectorizer из Scikit-learn позволяет нам создать матрицу, где каждая строка соответствует документу, а каждый столбец — уникальному слову (термину) в нашем корпусе, и значения в ячейках показывают, сколько раз каждое слово встречается в документе. Это простой, но мощный способ получить частотную характеристику текста.

Однако, мы быстро заметили, что очень частые слова (вроде "и", "в", "на") не несут много смысловой нагрузки. Для решения этой проблемы мы перешли к TfidfVectorizer (Term Frequency-Inverse Document Frequency). TF-IDF не просто считает частоту слова в документе, но и взвешивает её обратной частотой документа, то есть тем, насколько редко это слово встречается во всём корпусе. Таким образом, слова, которые часто встречаются в конкретном документе, но редко во всём корпусе, получают более высокий вес, что делает их более значимыми. Мы активно использовали TF-IDF для задач классификации текстов и извлечения ключевых фраз.

Смысловые представления: Word Embeddings (Word2Vec, GloVe, FastText) и Doc2Vec

Классические методы векторизации, хоть и полезны, не учитывают семантическую связь между словами. То есть, слова "король" и "царь" будут для них совершенно разными сущностями, без какой-либо связи по смыслу. И здесь на сцену вышли Word Embeddings — векторные представления слов, которые улавливают их семантические и синтаксические отношения.

Нашим первым знакомством с ними стал Word2Vec, который мы осваивали с помощью библиотеки Gensim. Мы узнали о двух его архитектурах: Skip-gram и CBOW. Skip-gram предсказывает контекстные слова по целевому слову, а CBOW, целевое слово по контексту. Результат, плотные векторы, где слова с похожим значением располагаются близко друг к другу в многомерном пространстве. Мы помним, как были поражены, когда впервые увидели, что вектор("король") ⎻ вектор("мужчина") + вектор("женщина") ≈ вектор("королева")! Это открыло для нас совершенно новые горизонты.

Позже мы также экспериментировали с GloVe (Global Vectors for Word Representation), который комбинирует преимущества матричной факторизации и локальных контекстных окон. А для работы с редкими словами и морфологически богатыми языками мы нашли очень полезным FastText, также из Gensim. FastText умеет работать с подсловами (char n-gram), что позволяет ему создавать векторы даже для слов, которых он не видел во время обучения.

Но что если нам нужно получить векторное представление не слова, а целого документа или предложения? Для этого мы освоили Doc2Vec, который является расширением Word2Vec. Он позволил нам сравнивать документы по их смысловому содержанию, кластеризовать их и находить похожие тексты, что было крайне полезно для систем рекомендаций и поиска.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Эта цитата всегда напоминала нам о глубине и сложности языка, а наши инструменты NLP помогали нам расшифровывать эти карты.

Скрытые смыслы: Тематическое моделирование и Анализ тональности

После того как мы научились представлять текст в числовом виде, перед нами открылись возможности для извлечения более глубоких смыслов и паттернов.

Тематическое моделирование: LDA, LSI и NMF

Часто нам нужно было понять, о чем говорят большие коллекции документов. Ручное чтение тысяч отзывов или статей, задача нереальная. И тут на помощь пришло тематическое моделирование. Мы освоили несколько ключевых алгоритмов:

- LDA (Latent Dirichlet Allocation): Это вероятностная модель, которая предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема — это смесь слов. Мы использовали Gensim для реализации LDA и были поражены, как она помогает автоматически обнаруживать скрытые темы в больших корпусах текста, например, в отзывах клиентов или новостных статьях.

- LSI (Latent Semantic Indexing): Основан на сингулярном разложении (SVD) и также используется для выявления скрытых семантических структур. Мы находили его полезным для задач поиска информации и группировки документов.

- NMF (Non-negative Matrix Factorization): Этот метод хорошо показал себя в сравнении с LDA, особенно когда мы работали с более разреженными данными. NMF также выявляет темы, представляя их как наборы слов, но делает это с помощью факторизации матриц.

Сравнение этих моделей показало нам, что выбор зависит от конкретной задачи и характеристик данных. LDA часто дает более интерпретируемые темы, а NMF может быть быстрее и давать хорошие результаты на определенных типах данных.

Анализ тональности: От VADER до глубоких моделей

Понимание эмоциональной окраски текста — это критически важная задача для многих приложений, от анализа отзывов клиентов до мониторинга социальных сетей. Наше путешествие в анализ тональности (Sentiment Analysis) началось с простых, но эффективных инструментов.

Первым делом мы познакомились с VADER (Valence Aware Dictionary and sEntiment Reasoner), который особенно хорошо подходит для анализа коротких текстов из социальных сетей. VADER использует правило-основанный подход и словарь, а также учитывает такие особенности, как заглавные буквы, знаки препинания и усилители ("очень хорошо"). Он быстро давал нам оценки позитивности, негативности и нейтральности.

Позже мы перешли к более продвинутым методам. Мы использовали TextBlob для быстрого определения тональности, но для более сложных сценариев, например, с учетом сарказма или контекста, нам пришлось разрабатывать собственные модели. Мы применяли Scikit-learn для классификации текстов, обучая модели (например, SVM или Наивный Байес) на размеченных наборах данных. Это позволило нам адаптировать анализ тональности под специфику наших данных, будь то отзывы о фильмах, финансовых новостях или политических постах.

Анализ тональности сообщений в социальных сетях (Twitter/Reddit) представил свои уникальные вызовы, включая работу с эмодзи и сленгом. Мы учились очищать эти данные и включать эти элементы в наши модели, чтобы получать более точные результаты.

Машинное обучение на страже текста: Классификация и Распознавание сущностей

Когда текст преобразован в числовой формат, а его скрытые темы и тональность обнаружены, наступает время для решения более структурированных задач с помощью машинного обучения.

Классификация текстов: От спама до категорий

Классификация текстов — это одна из самых распространенных задач в NLP. Мы использовали её для всего: от фильтрации спама и категоризации статей до анализа отзывов клиентов по категориям.

С библиотекой Scikit-learn мы освоили множество алгоритмов:

- Наивный Байесовский классификатор: Простой, но часто очень эффективный, особенно для текстовых данных.

- SVM (Support Vector Machines): Мощный алгоритм, который хорошо работает в высокоразмерных пространствах, что характерно для векторизованного текста.

- Логистическая регрессия: Хотя это алгоритм регрессии, он прекрасно подходит для бинарной и мультиклассовой классификации.

Мы учились выбирать правильный алгоритм, тюнинговать гиперпараметры и оценивать качество наших моделей с помощью таких метрик, как F1-score, Precision и Recall. Разработка систем автоматической категоризации статей стала для нас одним из самых успешных проектов в этой области.

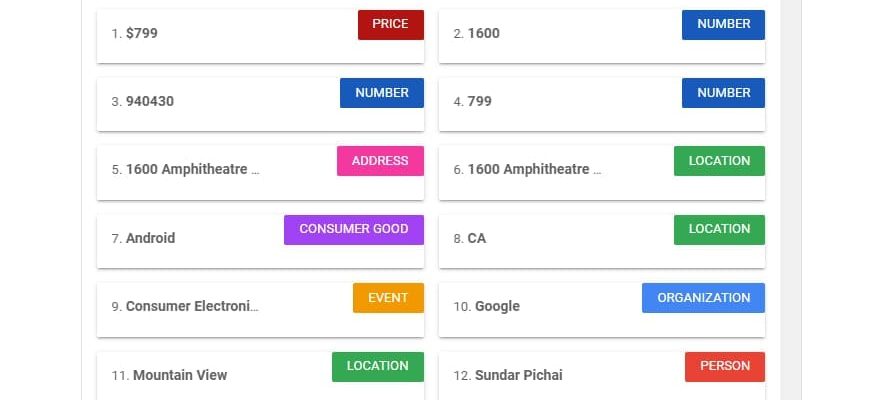

Распознавание именованных сущностей (NER): Имена, места, даты

Как мы уже упоминали, NER, это задача извлечения структурированной информации из неструктурированного текста путем идентификации и классификации именованных сущностей. Мы начали со spaCy, который предоставляет готовые, высокопроизводительные модели.

Но по мере роста наших потребностей, мы стали исследовать и другие подходы:

- CRF (Conditional Random Fields): Это статистический метод, который мы применяли, когда требовалась большая гибкость и возможность учитывать контекст слова в последовательности.

- Flair: Эта библиотека нас очень впечатлила своей способностью достигать state-of-the-art результатов в NER, особенно с использованием контекстных строковых эмбеддингов. Мы использовали Flair для современного NER и обнаружили, что он значительно превосходит многие классические подходы в точности.

Разработка систем для автоматической разметки сущностей и выявления связей между ними стала важной частью нашего арсенала. Мы применяли BERT для задачи NER, чтобы добиваться еще более высокой точности, особенно в сложных случаях.

Эра Трансформеров и Глубокого Обучения: Новая реальность NLP

Если все предыдущие методы казались нам мощными, то появление Трансформеров полностью перевернуло наше представление о возможностях NLP. Это был настоящий квантовый скачок.

Hugging Face и предобученные модели: BERT, GPT

Библиотека Hugging Face Transformers стала для нас вратами в этот новый мир. Она предоставила легкий доступ к сотням предобученных моделей, таких как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer).

Мы использовали BERT для самых разных задач: классификации текстов, NER, вопросно-ответных систем (QA). Его способность понимать контекст слова на основе всего предложения, а не только его ближайших соседей, дала нам беспрецедентную точность. Тонкая настройка (Fine-tuning) предварительно обученных моделей под наши специфические задачи стала рутинной практикой и позволяла нам достигать выдающихся результатов с относительно небольшими объемами размеченных данных.

GPT-модели открыли для нас мир генерации текста. Мы экспериментировали с ними для создания автоматических ответов, суммаризации текста (как абстрактивной, так и экстрактивной) и даже для генерации кода. Способность этих моделей к связному и осмысленному тексту до сих пор вызывает у нас восторг.

Мы также применяли PyTorch/TensorFlow для создания собственных нейросетей NLP, когда требовалось что-то уникальное или когда мы хотели глубоко понять архитектуру моделей. Создание LSTM-сетей для последовательного анализа текста было одним из таких экспериментов.

Продвинутые применения Трансформеров

С Трансформерами мы смогли реализовать задачи, которые раньше казались научной фантастикой:

- Вопросно-ответные системы (QA): Создание систем, которые могут находить ответы на вопросы в больших текстовых корпусах.

- Машинный перевод: Используя Transformer-модели, мы экспериментировали с созданием систем машинного перевода, в т.ч. для узкоспециализированных текстов.

- Суммаризация текста: Разработка систем, которые могут автоматически создавать краткие изложения длинных документов, как путем извлечения ключевых предложений (экстрактивная), так и путем генерации нового текста (абстрактивная).

- Анализ тональности с учетом сарказма: Трансформеры показали себя гораздо лучше в распознавании сложных нюансов, таких как сарказм и ирония, по сравнению с более простыми моделями.

- Векторизация предложений и документов с контекстом: Используя Sentence Transformers, мы получили высококачественные векторные представления целых предложений и документов, учитывающие их контекст.

Специализированные задачи и инструменты: Расширяем горизонты

Помимо основных направлений, наше путешествие в NLP привело нас к множеству специализированных задач, каждая из которых требовала своих уникальных инструментов и подходов.

Сбор и очистка данных: Основа любого проекта

Без качественных данных никакой, даже самый продвинутый, алгоритм не покажет хороших результатов. Поэтому мы уделяли много внимания веб-скрейпингу текста с помощью библиотеки Beautiful Soup. Она позволила нам извлекать текст из HTML-страниц, статей и блогов, создавая собственные корпуса данных для обучения.

Работа с неструктурированным текстом всегда начинается с очистки данных. Мы разрабатывали инструменты для удаления HTML-тегов, нормализации пунктуации, маркировки и удаления стоп-слов, а также для исправления орфографии. Иногда мы сталкивались с необходимостью извлекать текст из PDF-файлов, и здесь незаменимой оказалась библиотека PyMuPDF.

Многоязычность и особенности языка

Современный мир многоязычен, и наши проекты часто требовали работы с текстами на разных языках. Мы использовали библиотеку Polyglot для мультиязычности, а также Stanza (разработанную Stanford NLP Group), которая оказалась особенно мощной для языков с богатой морфологией, таких как русский, предоставляя высокоточные модели для токенизации, POS-теггинга и синтаксического анализа.

Работа с нелатинскими алфавитами в Python NLP всегда представляла собой отдельный вызов, но современные библиотеки значительно упростили эту задачу.

Извлечение информации и суммаризация

Мы активно использовали различные методы для извлечения ключевых фраз и предложений:

- RAKE (Rapid Automatic Keyword Extraction): Простой, но эффективный алгоритм для извлечения ключевых слов.

- TextRank: Алгоритм, основанный на PageRank, который мы применяли не только для извлечения ключевых слов, но и для суммаризации текста путем выбора наиболее важных предложений.

Разработка систем суммаризации текста (как экстрактивной, так и абстрактивной) стала одним из наших любимых направлений. Экстрактивная суммаризация выбирает наиболее важные предложения из исходного текста, а абстрактивная, генерирует новый, сокращенный текст. С Transformer-моделями мы добились впечатляющих результатов в абстрактивной суммаризации.

Больше, чем просто текст: Стиль, эмоции и проверка фактов

Наши интересы простирались и за пределы чистого извлечения информации:

- Анализ стилистики текстов (авторский почерк): Мы пытались определить авторство текста, анализируя уникальные лексические, синтаксические и структурные особенности.

- Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг играют огромную роль. Мы разрабатывали инструменты для нормализации сленга и учитывали эмодзи в анализе тональности.

- Разработка систем обнаружения плагиата: Используя библиотеки для измерения сходства строк и документов, такие как Jellyfish и Textdistance, мы создавали инструменты для выявления дубликатов и плагиата.

- Разработка инструмента для проверки фактов (Fact-Checking): Это сложная, но крайне важная задача, которую мы начали исследовать, пытаясь автоматически проверять утверждения в тексте на соответствие известным фактам.

Визуализация, большие данные и будущие вызовы

Каким бы мощным ни был наш анализ, без наглядной визуализации его результаты сложно понять. Мы использовали различные инструменты для визуализации текстовых данных, такие как Word Clouds для быстрого понимания частотности слов, и Heatmaps для отображения корреляций или распределений.

Работа с большими текстовыми массивами (Big Data NLP) постоянно ставила перед нами новые вызовы в плане производительности и масштабируемости. Мы учились оптимизировать наши алгоритмы, использовать GPU-ускорение для глубоких моделей и применять распределенные вычисления, чтобы обрабатывать гигабайты и терабайты текста.

Анализ временных рядов в текстовых данных, например, выявление сезонности в отзывах или изменение тональности новостей с течением времени, открывал для нас новые измерения в понимании данных.

Одним из постоянных вызовов оставалась обработка неполных и ошибочных данных. Реальный мир далек от идеальных учебных корпусов, и мы постоянно работали над улучшением наших инструментов для очистки и нормализации.

Мы также начали заглядывать в будущее, исследуя такие направления, как разработка систем чат-ботов на Python (например, с использованием Rasa framework), создание словарей и тезаурусов, и даже анализ метаданных текста для извлечения дополнительной информации.

Вместо заключения: Наше NLP-путешествие продолжается

Итак, мы поделились с вами нашим обширным опытом погружения в мир обработки естественного языка с помощью Python. От простейшей токенизации до сложнейших трансформерных архитектур — каждый этап этого пути был полон открытий и вызовов. Мы видели, как текст, который когда-то казался нам просто набором символов, превращается в источник ценных знаний, позволяя нам понимать клиентов, предсказывать тренды, автоматизировать рутинные задачи и даже генерировать новые смыслы.

Экосистема Python для NLP невероятно богата и постоянно развивается. NLTK, spaCy, Gensim, Scikit-learn, Hugging Face Transformers — это лишь некоторые из тех инструментов, которые стали нашими верными помощниками. Мы верим, что возможности NLP безграничны, и каждый, кто готов потратить время на изучение этих удивительных технологий, сможет найти в них что-то свое, что-то, что изменит его подход к работе с информацией.

Наше путешествие продолжается, и мы уверены, что впереди нас ждет еще много интересных открытий. Мы призываем вас не бояться экспериментировать, пробовать новые библиотеки и алгоритмы, ведь именно так рождаются самые интересные и полезные проекты. Присоединяйтесь к нам в этом увлекательном приключении!

Подробнее

| Основы NLTK | SpaCy для NER | Gensim тематическое моделирование | Word2Vec объяснение | Анализ тональности VADER |

| Трансформеры Hugging Face | Суммаризация текста Python | BERT для классификации | Лемматизация vs Стемминг | Векторизация TF-IDF |