Раскрываем Тайны Текста: Наш Путь в Мир NLP с Python

Привет, друзья! Сегодня мы приглашаем вас в увлекательное путешествие по безграничным просторам обработки естественного языка (NLP) с нашим верным спутником — языком программирования Python. Мы, как опытные исследователи текстовых джунглей, готовы поделиться личными открытиями, проверенными методами и теми инструментами, которые не раз помогали нам превращать хаотичные наборы слов в ценные инсайты и умные системы. Приготовьтесь, ведь перед нами откроются двери в мир, где машины начинают понимать человеческую речь!

В современном мире, где информация является ключевым активом, способность анализировать и извлекать смысл из огромных объемов текстовых данных становится не просто полезным навыком, а настоящей суперсилой. От анализа отзывов клиентов до автоматической категоризации новостных статей, от создания интеллектуальных чат-ботов до систем машинного перевода — области применения NLP безграничны. И именно Python, благодаря своей богатой экосистеме библиотек, стал де-факто стандартом для любого, кто хочет погрузиться в эту захватывающую дисциплину. Мы покажем вам, как шаг за шагом освоить этот мощный инструментарий, опираясь на наш практический опыт.

Основы Предобработки Текста: С Чего Начинается Магия?

Прежде чем мы сможем заставить компьютер "понять" текст, его необходимо подготовить. Представьте, что вы хотите приготовить изысканное блюдо: сначала нужно очистить и нарезать ингредиенты. В NLP этот этап называется предобработкой, и он является краеугольным камнем любого успешного проекта. Без качественно предобработанных данных даже самые продвинутые модели будут работать неэффективно. Мы научились уделять этому этапу максимальное внимание, и вам советуем поступать так же.

Токенизация и Стемминг с NLTK

Первый шаг в предобработке, это токенизация. Это процесс разделения текста на отдельные слова или фразы, которые мы называем токенами. Например, предложение "Мы любим NLP!" будет разбито на токены ["Мы", "любим", "NLP", "!"]. NLTK (Natural Language Toolkit) — это одна из старейших и наиболее уважаемых библиотек в Python для NLP, которая предоставляет нам отличные инструменты для токенизации. Мы часто начинаем именно с нее, потому что она проста в освоении и очень мощна.

После токенизации мы часто сталкиваемся с проблемой: одно и то же слово может иметь разные формы (бегать, бегущий, бежал). Стемминг — это процесс усечения слов до их корневой формы (стема), что помогает нам рассматривать разные формы одного слова как одну и ту же сущность. Например, слова "работать", "работает", "работал" могут быть сведены к "работ". NLTK предлагает несколько алгоритмов стемминга, таких как PorterStemmer и SnowballStemmer, которые мы активно используем для английского и других языков, чтобы уменьшить размер словаря и улучшить производительность моделей.

Лемматизация: Глубже, чем Стемминг

Хотя стемминг и полезен, он иногда может приводить к нереальным корням слов. Например, "красота" может стать "красот". Здесь на помощь приходит лемматизация. Это более сложный процесс, который приводит слово к его базовой словарной форме (лемме), учитывая его часть речи и контекст. Лемматизация всегда возвращает существующее слово из словаря, что делает результаты более осмысленными и качественными.

Для лемматизации мы отдаем предпочтение библиотекам, таким как spaCy и Stanza, особенно когда работаем с языками с богатой морфологией, вроде русского. Эти библиотеки используют более сложные лингвистические модели и часто дают значительно лучшие результаты, чем простые стеммеры. Например, "были" будет приведено к "быть", а не к "был". Мы заметили, что инвестиции времени в качественную лемматизацию окупаются с лихвой на последующих этапах анализа.

Регулярные Выражения: Очистка Данных

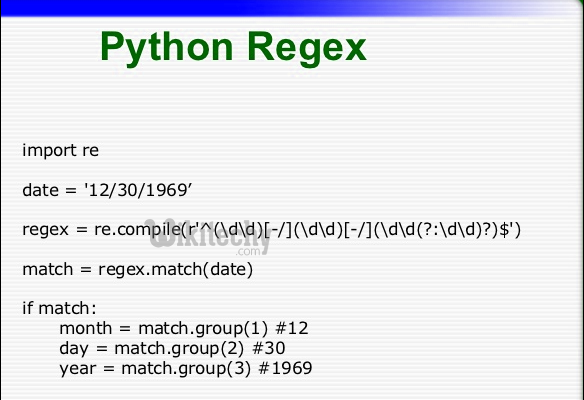

Сырые текстовые данные редко бывают чистыми. Они часто содержат HTML-теги, URL-адреса, специальные символы, лишние пробелы и другие "шумы", которые могут помешать нашему анализу. Регулярные выражения (библиотека `re` в Python) — это наш швейцарский армейский нож для борьбы с этим беспорядком. Мы используем их для поиска и замены специфических паттернов в тексте, эффективно удаляя все, что не относится к смысловой нагрузке.

Например, с помощью регулярных выражений мы можем легко удалить все URL-адреса из текста, очистить его от HTML-тегов или привести все к нижнему регистру для единообразия. Это мощный инструмент, который требует некоторой практики, но как только вы освоите его основы, он станет незаменимым в вашем арсенале NLP. Мы всегда рекомендуем сначала тщательно изучить структуру данных, чтобы написать наиболее точные и эффективные регулярные выражения.

Стоп-слова и Пунктуация: Избавляемся от Шума

Не все слова в тексте одинаково важны для извлечения смысла. Такие слова, как "и", "в", "на", "он", "она" (стоп-слова), встречаются очень часто, но не несут существенной смысловой нагрузки. Удаление стоп-слов помогает уменьшить размер данных и сфокусировать модели на более значимых терминах. NLTK предоставляет списки стоп-слов для многих языков, и мы часто их используем, а иногда даже создаем собственные списки для специфических доменов.

Аналогично, пунктуация (запятые, точки, восклицательные знаки) также часто удаляется, если она не является критически важной для конкретной задачи (например, для анализа тональности, где восклицательный знак может указывать на сильные эмоции). Мы всегда взвешиваем, нужно ли удалять пунктуацию или ее стоит оставить, в зависимости от контекста задачи. Этот этап, наряду с приведением текста к нижнему регистру, является стандартной практикой для большинства наших проектов.

Извлекаем Смысл: Сущности и Темы

После того как текст очищен и подготовлен, мы можем перейти к более сложным задачам — извлечению информации и пониманию его содержания. Это как после огранки драгоценного камня, когда его истинная красота начинает сиять. Мы стремимся не просто читать слова, а находить в них скрытые паттерны, связи и ключевые элементы.

Распознавание Именованных Сущностей (NER): spaCy и Flair

Распознавание именованных сущностей (Named Entity Recognition, NER) — это задача по идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические места, даты, денежные суммы и т.д.. Это невероятно мощный инструмент для структурирования неструктурированного текста и извлечения конкретных фактов. Например, из предложения "Тим Кук посетил Берлин 15 января" NER выделит "Тим Кук" как персону, "Берлин" как место и "15 января" как дату.

Для быстрого и эффективного NER мы активно используем библиотеку spaCy. Она известна своей скоростью и точностью, предоставляя готовые модели для различных языков. Если же нам требуется более высокая точность или работа с языками с богатой морфологией, мы обращаемся к Flair. Flair часто демонстрирует впечатляющие результаты, особенно для современного NER, используя контекстуальные эмбеддинги. Мы часто сравниваем их производительность на наших данных, чтобы выбрать наиболее подходящий инструмент.

Тематическое Моделирование: Gensim (LDA, LSI) и NMF

В больших текстовых корпусах часто бывает трудно вручную определить, о чем говорят документы. Тематическое моделирование — это набор алгоритмов, которые позволяют нам автоматически выявлять скрытые темы в коллекции текстов. Это как волшебный фонарь, который подсвечивает основные идеи, скрытые в массиве данных. Мы использовали его для анализа отзывов клиентов, новостных лент и даже юридических документов.

Библиотека Gensim является нашим основным инструментом для тематического моделирования. Она отлично реализована для работы с большими текстовыми корпусами и предлагает такие алгоритмы, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA предполагает, что каждый документ представляет собой смесь тем, а каждая тема — смесь слов. NMF (Non-negative Matrix Factorization) — это еще один мощный метод, который мы используем, особенно когда нам нужна более интерпретируемая матрица тем и слов. Сравнение моделей тематического моделирования (LDA vs NMF) всегда является частью нашего рабочего процесса, так как они дают разные, но часто дополняющие друг друга результаты.

Извлечение Ключевых Фраз: RAKE и TextRank

Помимо общих тем, часто бывает необходимо извлечь наиболее важные слова и фразы, которые точно характеризуют содержание текста. Это помогает нам быстро понять суть документа, не читая его целиком. Для этого мы применяем методы извлечения ключевых фраз.

Одним из простых, но эффективных алгоритмов является RAKE (Rapid Automatic Keyword Extraction). Он основан на частотности слов и их расположении относительно стоп-слов. Мы часто используем его для быстрого получения набора ключевых слов. Для более сложных задач и извлечения ключевых предложений мы обращаемся к TextRank. TextRank — это алгоритм, основанный на графах, который определяет важность слов или предложений, аналогично тому, как Google PageRank определяет важность веб-страниц. Он позволяет нам не только извлекать ключевые слова, но и создавать экстрактивные резюме, выбирая наиболее релевантные предложения.

"Язык — это дорожная карта культуры. Он говорит вам, откуда приходят его люди и куда они идут;"

— Рита Мэй Браун

От Слов к Числам: Векторизация Текста

Компьютеры, в отличие от людей, не понимают слов напрямую. Они работают с числами. Поэтому одним из важнейших шагов в NLP является преобразование текста в числовые векторы, которые могут быть поданы на вход алгоритмам машинного обучения. Этот процесс называется векторизацией текста, и мы исследовали множество подходов к нему.

Классические Методы: CountVectorizer и TF-IDF

Самыми базовыми, но все еще очень мощными методами векторизации являются CountVectorizer и TF-IDF (Term Frequency-Inverse Document Frequency). CountVectorizer просто подсчитывает количество вхождений каждого слова в документ, создавая вектор, где каждое измерение соответствует уникальному слову в корпусе. Это просто и интуитивно понятно, но имеет свои недостатки, так как не учитывает важность слов.

TF-IDF улучшает этот подход, присваивая каждому слову вес, который отражает, насколько слово важно для документа в коллекции. Если слово часто встречается в документе, но редко в других документах корпуса, его TF-IDF вес будет высоким. Мы часто используем TF-IDF для задач классификации и кластеризации текстов, поскольку он хорошо справляется с выделением наиболее информативных слов.

Word Embeddings: Word2Vec, GloVe и FastText

Классические методы имеют один существенный недостаток: они не учитывают семантическое сходство слов. Слова "кошка" и "кот" или "машина" и "автомобиль" будут рассматриваться как совершенно разные сущности. Здесь на сцену выходят Word Embeddings — это плотные векторные представления слов, где семантически близкие слова располагаются близко друг к другу в многомерном пространстве. Это был настоящий прорыв в NLP!

Мы активно используем Word2Vec (созданный Google) и GloVe (Global Vectors for Word Representation, разработанный Стэнфордом). Word2Vec, в частности, имеет две архитектуры: Skip-gram и CBOW (Continuous Bag of Words), которые обучаются предсказывать контекст слова или слово по его контексту. FastText, расширение Word2Vec от Facebook, также очень полезен, особенно для работы с редкими словами и языками с богатой морфологией, так как он учитывает подсловные единицы (n-граммы символов). Gensim предоставляет отличные реализации всех этих моделей, позволяя нам легко создавать собственные эмбеддинги или использовать предварительно обученные.

Doc2Vec и Sentence Transformers: Векторизация на Уровне Предложений и Документов

Если Word Embeddings отлично работают со словами, то как быть, если нам нужно получить векторное представление целого предложения или документа? Doc2Vec (также известный как Paragraph Vector) — это расширение Word2Vec, которое позволяет нам создавать плотные векторы для целых документов. Это очень полезно для задач, таких как поиск похожих документов, кластеризация или классификация.

В последние годы появились еще более продвинутые методы, такие как Sentence Transformers. Эти модели, основанные на архитектуре трансформеров, способны генерировать высококачественные эмбеддинги для предложений и документов, которые прекрасно улавливают их семантический смысл. Мы используем их для поиска семантически похожих текстов, что невозможно сделать с помощью обычных векторизаторов. Эти модели значительно улучшили наши возможности в работе с большими текстовыми массивами и сравнительной оценке документов.

Машинное Обучение в NLP: Классификация и Анализ

После того как мы преобразовали текст в числовые векторы, мы можем применять мощные алгоритмы машинного обучения для решения широкого круга задач. Это тот момент, когда текст перестает быть просто текстом и становится данными, которые можно анализировать, классифицировать и предсказывать на их основе.

Классификация Текстов с Scikit-learn: От Спама до Категорий

Классификация текста — одна из самых распространенных задач в NLP. Она включает в себя присвоение заранее определенных категорий текстовым документам. Например, мы можем классифицировать электронные письма как "спам" или "не спам", новости по темам ("спорт", "политика", "экономика"), или отзывы клиентов как "положительные" или "отрицательные". Для этих задач мы обычно обращаемся к библиотеке Scikit-learn.

Scikit-learn, это золотой стандарт для машинного обучения в Python, и он предоставляет богатый набор алгоритмов, таких как SVM (Support Vector Machines), наивный байесовский классификатор, логистическая регрессия и многие другие. Мы часто начинаем с простых моделей, таких как наивный байесовский классификатор, из-за его скорости и хорошей базовой производительности, а затем переходим к более сложным, таким как SVM, для достижения лучшей точности. Ключевым моментом здесь является правильный выбор признаков (векторизация) и гиперпараметров модели.

Анализ Тональности: VADER, TextBlob и Трансформеры

Анализ тональности (Sentiment Analysis) — это процесс определения эмоциональной окраски текста: позитивной, негативной или нейтральной. Это критически важно для понимания общественного мнения, анализа отзывов о продуктах, мониторинга социальных сетей и многого другого. Мы часто используем его для анализа финансовых новостей, отзывов о фильмах или сообщений в социальных сетях.

Для быстрого и простого анализа тональности мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который хорошо работает с текстами из социальных сетей и способен учитывать такие нюансы, как восклицательные знаки и эмодзи. TextBlob также предлагает простой интерфейс для определения тональности, хотя его точность может быть ниже для сложных случаев. Однако для более глубокого и контекстно-зависимого анализа тональности, особенно с учетом сарказма или иронии, мы обращаемся к моделям, основанным на трансформерах (например, из библиотеки Hugging Face). Они показывают гораздо лучшие результаты, так как способны улавливать тонкие нюансы человеческой речи.

Нейросети для NLP: PyTorch/TensorFlow и LSTM/Transformer-модели

Когда классические методы машинного обучения достигают своих пределов, на помощь приходят нейронные сети. Глубокое обучение произвело революцию в NLP, позволив моделям улавливать более сложные зависимости и паттерны в текстовых данных. Мы используем фреймворки PyTorch и TensorFlow для создания и обучения наших нейросетей.

Раньше мы много работали с рекуррентными нейронными сетями (RNN), в частности с LSTM (Long Short-Term Memory) и GRU, которые хорошо справлялись с последовательными данными, такими как текст. Они могли "помнить" информацию из предыдущих частей последовательности. Однако с появлением архитектуры трансформеров, таких как BERT, GPT и их многочисленные вариации, мы переключили свое внимание на них. Трансформеры, благодаря механизму внимания, способны обрабатывать всю последовательность одновременно, улавливая дальние зависимости, что привело к беспрецедентному росту производительности в большинстве задач NLP.

Революция Трансформеров: Hugging Face и Не Только

Если и есть одна технология, которая полностью изменила ландшафт NLP за последние несколько лет, то это трансформеры. Они открыли новую эру в понимании и генерации естественного языка, и мы были свидетелями этой невероятной эволюции. Библиотека Hugging Face Transformers стала нашим незаменимым инструментом в работе с этими моделями.

BERT и Его Производные: Новая Эра Понимания Контекста

BERT (Bidirectional Encoder Representations from Transformers) от Google стал прорывной моделью, способной понимать контекст слова, учитывая все остальные слова в предложении, как слева, так и справа. Это позволило ему достичь невероятных результатов в таких задачах, как вопросно-ответные системы, классификация и распознавание именованных сущностей. Мы активно применяем BERT для задач классификации, NER и выявления связей между сущностями.

С тех пор появилось множество производных BERT, таких как RoBERTa, XLNet, DistilBERT и ALBERT, каждая из которых предлагает свои улучшения или оптимизации. Hugging Face предоставляет нам доступ к сотням предварительно обученных моделей, что значительно ускоряет разработку и позволяет нам использовать самые современные достижения NLP, даже не имея огромных вычислительных ресурсов для обучения моделей с нуля.

Генерация Текста: GPT и Другие Языковые Модели

Трансформеры также открыли невероятные возможности в области генерации текста. Модели, такие как GPT (Generative Pre-trained Transformer) от OpenAI, способны генерировать связный, грамматически правильный и даже творческий текст на основе заданного начального фрагмента. Мы экспериментировали с ними для создания контента, генерации диалогов для чат-ботов и даже для автоматического перефразирования.

Эти модели могут быть использованы для создания статей, написания кода, суммаризации и даже для имитации стиля письма. Мы были поражены их способностью генерировать текст, который зачастую трудно отличить от написанного человеком. Конечно, это требует осторожности и этического подхода, но потенциал огромен.

Тонкая Настройка (Fine-tuning): Адаптация Моделей под Наши Нужды

Одна из самых мощных особенностей трансформерных моделей заключается в возможности их тонкой настройки (fine-tuning) под конкретную задачу или домен. Предварительно обученные модели, такие как BERT или GPT, уже "знают" очень много о языке, потому что были обучены на огромных объемах текста. Мы берем такую модель и дообучаем ее на небольшом, специфичном для нашей задачи наборе данных;

Это позволяет нам достичь высокой производительности с относительно небольшим объемом размеченных данных и значительно меньшими вычислительными затратами по сравнению с обучением модели с нуля. Тонкая настройка предварительно обученных моделей стала стандартной практикой в наших проектах, будь то классификация финансовых новостей, анализ тональности отзывов о продуктах или разработка систем для автоматической разметки данных.

Практические Задачи и Продвинутые Инструменты

После освоения основ и передовых концепций, мы можем применять наши знания для решения реальных, сложных задач. NLP — это не только теория, это прежде всего практический инструмент для создания полезных систем.

Системы Вопросно-Ответных Систем (QA): Как Получить Ответы из Текста

Вопросно-ответные системы (Question Answering, QA), это системы, которые способны автоматически отвечать на вопросы, заданные на естественном языке, используя предоставленный текст или базу знаний. Это невероятно полезно для поддержки клиентов, поиска информации в больших документах или создания интеллектуальных помощников. Мы работали над такими системами, которые извлекают факты из новостей или юридических документов.

Современные QA-системы часто строятся на основе трансформерных моделей, таких как BERT, которые могут находить точный фрагмент текста, содержащий ответ на вопрос. Мы используем PyTorch/TensorFlow для создания таких нейросетей, обучая их на специализированных датасетах для QA, чтобы они могли эффективно искать и извлекать нужную информацию.

Суммаризация Текста: Извлекаем Суть (Abstractive vs Extractive)

В мире переизбытка информации способность быстро получать суть длинных документов становится критически важной. Суммаризация текста, это процесс создания краткого, но информативного изложения исходного текста. Мы различаем два основных подхода:

Мы применяем эти методы для создания автоматических резюме статей, новостей и даже длинных отзывов клиентов. Сравнение моделей суммирования: экстрактивная и абстрактная, показывает, что абстрактивные модели могут быть более гибкими и генерировать более человекоподобные резюме, но экстрактивные часто более предсказуемы и сохраняют оригинальные формулировки.

Веб-скрейпинг для Текста: Beautiful Soup

Часто данные, необходимые для наших NLP-проектов, находятся не в аккуратных CSV-файлах, а разбросаны по просторам Интернета. Веб-скрейпинг — это процесс автоматического извлечения данных с веб-сайтов. Для этого мы часто используем библиотеку Beautiful Soup в Python.

Beautiful Soup позволяет нам парсить HTML и XML документы, легко извлекая нужные текстовые блоки, заголовки, ссылки и другие элементы. Это первый шаг к получению сырых текстовых данных, которые затем проходят через наш конвейер предобработки. Мы использовали Beautiful Soup для сбора статей, отзывов с сайтов, информации из блогов и форумов, что является незаменимым этапом для создания больших текстовых корпусов.

Работа с Многоязычными Текстами: Polyglot, Stanza

Мир не ограничивается одним языком, и наши NLP-проекты тоже не должны. Работа с многоязычными текстовыми корпусами представляет свои уникальные вызовы, особенно когда дело доходит до языков с богатой морфологией или нелатинскими алфавитами.

Для мультиязычности и анализа редких языков мы обращаемся к библиотекам, таким как Polyglot и Stanza. Polyglot предоставляет инструменты для токенизации, определения языка, NER и анализа тональности для множества языков. Stanza (разработанный Stanford NLP Group) — это мощный инструмент для языков с богатой морфологией, предлагающий комплексный лингвистический анализ, включая токенизацию, POS-теггинг, лемматизацию и синтаксический парсинг для многих языков, включая русский. Мы применяем их для разработки систем машинного перевода на Python и анализа отзывов клиентов на разных языках.

Разработка Чат-ботов: Rasa framework

Чат-боты стали повсеместными, помогая нам с поддержкой клиентов, автоматизацией процессов и предоставлением информации. Разработка чат-ботов на Python, это еще одна захватывающая область применения NLP. Мы использовали фреймворк Rasa для создания сложных, контекстно-ориентированных чат-ботов.

Rasa позволяет нам не просто отвечать на вопросы, но и вести осмысленный диалог, запоминать контекст беседы и выполнять действия. Он включает в себя компоненты для NLU (Natural Language Understanding) для понимания намерений пользователя и извлечения сущностей, а также для управления диалогом. Это гораздо больше, чем просто "если…то…", и требует глубокого понимания NLP и проектирования диалогов.

Измерение и Оценка: Как Понять, Что Мы Делаем Хорошо?

Создать модель, это только полдела. Как мы можем быть уверены, что наша модель действительно работает хорошо? В NLP, как и в любом другом разделе машинного обучения, критически важна оценка качества наших моделей. Мы всегда тщательно подходим к этому этапу, чтобы гарантировать надежность и эффективность наших решений.

Метрики Качества Моделей: F1-score, Precision, Recall

Для оценки качества моделей классификации мы используем стандартные метрики, которые помогают нам понять, насколько хорошо наша модель справляется с задачей:

Мы также используем метрики, специфичные для конкретных задач, например, для оценки качества NER-моделей. Понимание этих метрик позволяет нам не только выбрать лучшую модель, но и выявить слабые стороны нашего подхода и улучшить его.

Визуализация Текстовых Данных: Word Clouds, Heatmaps

Визуализация играет огромную роль не только в представлении результатов, но и в понимании самих данных и процесса работы модели. Мы используем различные инструменты для визуализации текстовых данных, чтобы сделать наши инсайты более доступными и понятными.

Кроме того, мы применяем инструменты вроде Sweetviz для анализа текстовых данных, чтобы быстро получить сводную информацию и выявить потенциальные проблемы в данных, что является важным шагом перед началом моделирования. Визуализация — это не просто украшение, это неотъемлемая часть процесса исследования и анализа.

Наш путь по миру NLP с Python был долгим и насыщенным, но мы надеемся, что он вдохновил вас на собственные исследования. Мы прошли от основ предобработки текста до продвинутых трансформерных моделей, от извлечения сущностей до генерации текста, от анализа тональности до создания чат-ботов. Каждый шаг в этом путешествии открывал нам новые возможности и показывал, насколько мощным инструментом является Python для работы с естественным языком.

Мы верим, что способность извлекать смысл из текста, автоматизировать рутинные задачи и создавать интеллектуальные системы будет только расти в цене. NLP — это динамично развивающаяся область, где каждый день появляются новые исследования и инструменты. Мы продолжаем учиться, экспериментировать и делиться своими знаниями. Надеемся, что эта статья станет для вас отправной точкой или полезным ориентиром в вашем собственном захватывающем приключении в мире обработки естественного языка. Удачных вам исследований!