- Тайны текста: Как мы, блогеры, раскрываем потенциал NLP в Python

- Основы предобработки текста: Первый шаг к пониманию

- Токенизация: Разделяй и властвуй над словами

- Стемминг и лемматизация: К корням смысла

- Регулярные выражения (re): Хирургия текста

- Очистка данных и стоп-слова: Устраняем шум

- Представление текста: От слов к числам

- Классические векторизаторы: Счет и важность

- Word Embeddings: Слова с контекстом

- Векторизация предложений и документов: Понимание целого

- Основные библиотеки и фреймворки: Наш инструментарий

- NLTK: Фундамент лингвистики

- spaCy: Скорость и эффективность для продакшена

- TextBlob: Простота для быстрого старта

- Gensim: Тематическое моделирование и векторные представления

- Scikit-learn: Машинное обучение для текста

- Трансформеры (Hugging Face): Новый уровень понимания

- Прикладные задачи NLP: От анализа к действию

- Анализ тональности: Понимаем эмоции

- Распознавание именованных сущностей (NER): Выделяем главное

- Тематическое моделирование: Обнаруживаем скрытые темы

- Классификация текстов: Распределяем по категориям

- Суммаризация текста: Извлекаем суть

- Продвинутые техники и специальные библиотеки: Расширяем горизонты

- Работа с многоязычными текстами и специфическими форматами

- Инструменты для визуализации и извлечения знаний

- Разработка чат-ботов и вопросно-ответных систем

- Масштабирование и оптимизация

Тайны текста: Как мы, блогеры, раскрываем потенциал NLP в Python

Привет, дорогие читатели и коллеги-энтузиасты! Наш мир буквально утопает в тексте. Социальные сети, новостные ленты, блоги, научные статьи, отзывы клиентов – все это огромные массивы данных, которые хранят в себе бесценные идеи, эмоции и информацию. Но как из этого океана слов выудить жемчужины смысла? Как заставить компьютер не просто хранить текст, а понимать его? Именно здесь на сцену выходит обработка естественного языка, или NLP (Natural Language Processing), и, как мы с вами знаем, Python является нашим верным спутником в этом увлекательном путешествии.

За годы работы с текстом мы накопили немало опыта, экспериментируя с различными библиотеками, моделями и подходами. От самых азов, вроде подсчета слов, до сложных нейросетевых архитектур, способных генерировать осмысленные предложения – мы прошли долгий путь. И сегодня мы хотим поделиться с вами нашим глубоким погружением в мир NLP, показать, как мы используем эти мощные инструменты для анализа, структурирования и даже создания текстового контента, превращая хаос в упорядоченное знание. Приготовьтесь, нас ждет подробный рассказ о том, как Python помогает нам разгадывать загадки человеческой речи!

Основы предобработки текста: Первый шаг к пониманию

Прежде чем мы сможем что-либо осмысленное сделать с текстом, его нужно подготовить. Представьте, что вы хотите приготовить изысканное блюдо: сначала нужно очистить, нарезать и подготовить ингредиенты. То же самое и с текстом. Этот этап, называемый предобработкой, является фундаментом для любых последующих аналитических задач, и мы уделяем ему особое внимание, ведь качество конечного результата напрямую зависит от чистоты и адекватности входных данных.

Мы начинаем с самых базовых, но критически важных шагов, которые позволяют привести текст к унифицированному виду, устранить шум и выделить ключевые элементы. Это не просто технические операции, это искусство, требующее понимания лингвистических нюансов и целей нашего анализа. Давайте рассмотрим ключевые этапы, которые мы регулярно применяем в наших проектах.

Токенизация: Разделяй и властвуй над словами

Первое, что мы делаем, это токенизация. Это процесс разделения текста на более мелкие единицы, называемые токенами. Чаще всего токенами являются слова, но иногда это могут быть символы, подслова или даже целые предложения. Например, фраза "Привет, мир!" может быть разбита на токены "Привет", ",", "мир", "!". Почему это важно? Потому что компьютер не "читает" текст так, как мы. Ему нужны дискретные единицы для анализа.

Мы используем различные подходы к токенизации в зависимости от задачи. Для простых случаев достаточно разделить текст по пробелам, но это не всегда эффективно, особенно с пунктуацией или составными словами. В NLTK, одной из наших любимых библиотек, есть специализированные токенизаторы, такие как word_tokenize и sent_tokenize, которые справляються с этими нюансами гораздо лучше. Они учитывают особенности языка и пунктуации, что позволяет нам получать более точные токены. Мы всегда помним, что правильная токенизация – это ключ к успешному дальнейшему анализу.

Стемминг и лемматизация: К корням смысла

После токенизации мы часто сталкиваемся с проблемой, что одно и то же слово может иметь множество форм (например, "бежал", "бегущий", "бегать"). Для компьютера это разные слова, хотя они несут одно и то же корневое значение. Здесь на помощь приходят стемминг и лемматизация – методы приведения слов к их базовой форме.

Стемминг – это более грубый процесс. Он просто отсекает окончания слов, чтобы получить "корень" (стем). Например, "running", "runner", "runs" могут быть приведены к "run". Мы используем стеммеры из NLTK, такие как PorterStemmer или SnowballStemmer, которые достаточно быстры и эффективны для многих задач, особенно когда скорость обработки важнее абсолютной лингвистической точности.

Лемматизация, в отличие от стемминга, является более интеллектуальным процессом. Она использует словарь и морфологический анализ, чтобы привести слово к его словарной (базовой) форме – лемме. Например, "better" будет преобразовано в "good", а не просто отсечено до "bett". Для лемматизации мы часто обращаемся к WordNetLemmatizer из NLTK или, что более предпочтительно для нас, к spaCy. SpaCy предлагает более продвинутую и точную лемматизацию, особенно для различных частей речи, что критически важно для глубокого анализа. Мы всегда сравниваем результаты этих методов, чтобы выбрать наиболее подходящий для конкретной задачи, будь то анализ тональности или тематическое моделирование.

Регулярные выражения (re): Хирургия текста

В предобработке текста мы активно используем регулярные выражения (модуль re в Python). Это невероятно мощный инструмент для поиска, замены и извлечения паттернов в строках. С помощью регулярных выражений мы можем:

- Удалять HTML-теги из веб-страниц, оставляя только чистый текст.

- Извлекать email-адреса, URL-ссылки, даты или номера телефонов.

- Нормализовать пунктуацию, например, заменять несколько пробелов на один, или удалять специальные символы.

- Работать с эмодзи и сленгом, преобразуя их в более стандартизированные формы или удаляя.

Мы часто используем регулярные выражения для первоначальной очистки "сырого" текста, полученного, например, с веб-сайтов или из PDF-документов. Это позволяет нам быстро избавиться от ненужного форматирования и шума, который может помешать дальнейшему анализу.

Очистка данных и стоп-слова: Устраняем шум

После токенизации и лемматизации, текст всё ещё может содержать слова, которые не несут существенной смысловой нагрузки для нашей конкретной задачи. Это так называемые стоп-слова (например, "и", "в", "на", "он", "она" и т.д.). Их удаление помогает уменьшить размер данных и сфокусироваться на более значимых терминах. NLTK предоставляет списки стоп-слов для многих языков, которые мы с успехом применяем.

Помимо стоп-слов, мы также занимаемся общей очисткой: удаляем числовые значения, если они нерелевантны, приводим весь текст к нижнему регистру для унификации и обрабатываем неполные или ошибочные данные. Например, в отзывах пользователей часто встречаются опечатки или нестандартные сокращения. Мы разрабатываем собственные инструменты для нормализации сленга и исправления орфографии, используя такие библиотеки, как Jellyfish для сравнения строк и поиска похожих слов.

Представление текста: От слов к числам

Как мы уже упоминали, компьютеры не понимают текст в привычном для нас виде. Чтобы машины могли работать с языком, нам нужно преобразовать слова и предложения в числовые векторы. Этот процесс называется векторизацией текста, и он является одним из самых фундаментальных аспектов NLP. Мы исследовали множество методов и подходов, каждый из которых имеет свои преимущества и области применения.

Выбор правильного метода векторизации часто определяет успех всей модели. Мы постоянно экспериментируем, чтобы найти оптимальный баланс между вычислительной сложностью, точностью и способностью улавливать семантические нюансы языка.

Классические векторизаторы: Счет и важность

Наш путь в векторизации текста начался с классических методов, которые по-прежнему остаются очень актуальными и эффективными для многих задач. Мы активно используем их благодаря их простоте и интерпретируемости.

- CountVectorizer: Этот метод из библиотеки Scikit-learn просто подсчитывает частоту появления каждого слова в документе. Он создает матрицу, где строки – это документы, а столбцы – уникальные слова (словарный запас). Значения в ячейках – это количество вхождений слова в документ. Это отличный способ получить базовое числовое представление текста.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF идет дальше, чем просто подсчет. Он не только учитывает, как часто слово встречается в документе (TF), но и насколько оно уникально для всего корпуса документов (IDF). Слова, которые встречаются во многих документах (например, стоп-слова), получают низкий вес, а уникальные и информативные слова – высокий. Это позволяет нам выделять действительно важные термины в тексте.

Мы часто используем эти векторизаторы для задач классификации текстов, например, для определения категории статьи или спама в сообщениях. Их простота позволяет быстро получать результаты и легко интерпретировать значимость слов.

Word Embeddings: Слова с контекстом

Классические векторизаторы хорошо работают, но у них есть один существенный недостаток: они не улавливают семантическую связь между словами. То есть, "король" и "королева" для них так же далеки, как "король" и "банан". Здесь на помощь приходят Word Embeddings – векторные представления слов, которые отображают их семантическое значение. Слова с похожим значением или контекстом будут располагаться близко друг к другу в многомерном пространстве.

Мы активно работаем с такими моделями, как:

- Word2Vec: Разработанный Google, Word2Vec обучается на больших текстовых корпусах и генерирует плотные векторы для каждого слова. Он имеет две основные архитектуры:

- Skip-gram: Предсказывает окружающие слова по заданному слову.

- CBOW (Continuous Bag of Words): Предсказывает текущее слово на основе его контекста.

Мы используем библиотеку Gensim для обучения наших собственных Word2Vec моделей или загрузки уже предобученных.

Используя Word Embeddings, мы можем выполнять такие интересные операции, как "король ⎻ мужчина + женщина = королева" в векторном пространстве, что открывает новые горизонты для анализа семантики.

Векторизация предложений и документов: Понимание целого

Если Word Embeddings дают нам векторы для слов, то для анализа более крупных единиц, таких как предложения или целые документы, нам нужны их векторные представления. Мы используем несколько подходов:

- Усреднение Word Embeddings: Самый простой способ – усреднить векторы всех слов в предложении или документе. Это дает приемлемые результаты, но теряет порядок слов и контекст.

- Doc2Vec: Также из Gensim, Doc2Vec (или Paragraph Vector) является расширением Word2Vec, которое способно генерировать векторы для целых документов. Это позволяет нам находить семантически похожие документы или кластеризовать их.

- Sentence Transformers: Это семейство моделей на основе трансформеров, которые генерируют высококачественные векторные представления для предложений и даже целых параграфов. Они сохраняют контекст и семантику значительно лучше, чем усреднение Word Embeddings, и мы активно применяем их для задач поиска семантически похожих предложений или кластеризации текстов.

- Контекстное встраивание (Contextual Embeddings): С появлением трансформеров, таких как BERT, мы получили возможность создавать векторные представления слов, которые учитывают их контекст в предложении. То есть, слово "банк" будет иметь разный вектор в предложениях "речной банк" и "финансовый банк". Это открывает совершенно новые возможности для глубокого понимания текста.

Сравнение различных методов векторизации – это постоянный процесс в нашей работе. Мы смотрим на такие метрики, как точность классификации, качество кластеризации и, конечно, вычислительные ресурсы, чтобы выбрать лучший подход для каждой конкретной задачи. Каждая из этих техник приближает нас к тому, чтобы компьютер "понял" текст так же глубоко, как это делаем мы.

Основные библиотеки и фреймворки: Наш инструментарий

В мире Python NLP существует огромное количество библиотек, каждая из которых имеет свои сильные стороны и предназначение. Мы, как опытные блогеры и практики, собрали свой арсенал инструментов, которые помогают нам решать широкий спектр задач. От фундаментальных операций до сложных нейросетевых моделей – эти библиотеки стали нашими незаменимыми помощниками.

Мы не просто используем их, а постоянно изучаем их возможности, сравниваем производительность и адаптируем к нашим конкретным потребностям. Давайте рассмотрим те, что составляют основу нашего рабочего процесса.

NLTK: Фундамент лингвистики

NLTK (Natural Language Toolkit) – это, пожалуй, первая библиотека, с которой мы знакомились, когда только начинали погружаться в NLP. Это своего рода "швейцарский нож" для базовых лингвистических задач. NLTK предоставляет нам доступ к огромному количеству корпусов, лексических ресурсов и алгоритмов для:

- Токенизации (

word_tokenize,sent_tokenize). - Стемминга (Porter, Snowball).

- Лемматизации (WordNetLemmatizer).

- POS-теггинга (Part-of-Speech tagging) – определения части речи для каждого слова.

- Синтаксического парсинга (построение деревьев зависимостей).

- Анализа частотности слов и n-грамм.

- Работы со стоп-словами.

Для нас NLTK служит отличной отправной точкой для быстрого прототипирования и изучения основ. Он идеально подходит для задач, где не требуется высокая производительность, но важна глубина лингвистического анализа и доступ к разнообразным данным. Мы часто используем его для морфологического анализа и создания словарей.

spaCy: Скорость и эффективность для продакшена

Когда речь заходит о более серьезных проектах, особенно тех, что требуют высокой скорости и эффективности, мы обращаемся к spaCy. Это современная библиотека NLP, разработанная с учетом производительности и удобства использования в продакшене. SpaCy отличается от NLTK тем, что предоставляет готовые, оптимизированные модели для различных языков, которые включают в себя:

- Быструю токенизацию.

- Продвинутую лемматизацию, которая учитывает контекст слова.

- Распознавание именованных сущностей (NER) – это одна из самых сильных сторон spaCy. Он может быстро и точно находить имена людей, организаций, географические названия, даты и многое другое. Мы используем его для извлечения ключевых фактов из статей и документов.

- POS-теггинг и синтаксический парсинг зависимостей, которые позволяют нам понять структуру предложения.

- Векторизацию слов (через встроенные или подключаемые модели).

Мы предпочитаем spaCy для проектов, где важна скорость и точность. Например, для быстрого NER на большом объеме данных или для реализации синтаксического парсинга в режиме реального времени. Он также отлично подходит для работы с русским языком благодаря наличию качественных моделей.

TextBlob: Простота для быстрого старта

Для самых простых задач, особенно для быстрого анализа тональности или проверки грамматики, мы иногда используем TextBlob. Это библиотека, построенная поверх NLTK, но с гораздо более простым API. TextBlob позволяет нам буквально в несколько строк кода:

- Проводить анализ тональности (полярность и субъективность).

- Выполнять POS-теггинг.

- Лемматизацию и стемминг.

- Перевод текста и определение языка.

Однако, важно понимать его ограничения. TextBlob отлично подходит для демонстраций и прототипов, но для серьезных, продакшн-уровня задач мы обычно выбираем более мощные и гибкие инструменты, такие как spaCy или специализированные модели машинного обучения. Мы используем его, когда нужно быстро получить общую картину или для обучения новичков.

Gensim: Тематическое моделирование и векторные представления

Для работы с векторными представлениями слов и документов, а также для тематического моделирования, Gensim – это наш основной выбор. Эта библиотека оптимизирована для обработки больших текстовых массивов и предоставляет эффективные реализации таких алгоритмов, как:

- LDA (Latent Dirichlet Allocation): Позволяет нам обнаруживать скрытые "темы" в коллекции документов. Мы используем LDA для анализа отзывов клиентов, чтобы понять, какие общие темы беспокоят пользователей, или для категоризации статей.

- LSI (Latent Semantic Indexing): Еще один метод тематического моделирования, который помогает нам находить семантически похожие документы.

- Word2Vec, Doc2Vec, FastText: Gensim предоставляет удобные API для обучения и использования этих моделей Word Embeddings. Это позволяет нам создавать собственные векторные представления слов, адаптированные под наши уникальные данные.

Gensim особенно ценен, когда мы работаем с большими объемами неструктурированного текста и хотим извлечь из него высокоуровневые темы или найти скрытые связи между документами. Это мощный инструмент для анализа текстовых данных в финансовой отчетности или анализа блогов и форумов.

Scikit-learn: Машинное обучение для текста

Когда дело доходит до применения классических алгоритмов машинного обучения к текстовым данным, Scikit-learn становится нашим незаменимым помощником. Эта библиотека предоставляет широкий спектр инструментов для:

- Классификации текстов: Мы используем такие алгоритмы, как SVM (Support Vector Machines), Наивный Байесовский классификатор, Логистическая регрессия для задач определения спама, категоризации новостей, анализа тональности.

- Кластеризации текстов: Методы, такие как K-Means или DBSCAN, помогают нам группировать похожие документы без предварительной разметки. Это полезно для автоматической категоризации или обнаружения скрытых тем.

- Выбора признаков и оценки моделей.

Scikit-learn отлично интегрируется с векторизаторами, такими как CountVectorizer и TfidfVectorizer, позволяя нам легко создавать полные конвейеры для обработки и анализа текста. Мы постоянно сравниваем различные методы машинного обучения для NLP, чтобы найти наиболее эффективный алгоритм для каждой задачи.

Трансформеры (Hugging Face): Новый уровень понимания

Последние годы принесли революцию в NLP с появлением архитектуры Трансформеров и библиотеки Hugging Face Transformers. Это изменило наш подход к сложным задачам. Трансформеры, такие как BERT, GPT, RoBERTa, T5, способны улавливать глубокие контекстные связи в тексте, что недоступно классическим моделям.

Мы используем Hugging Face Transformers для:

- Сложных задач NER, которые требуют более тонкого понимания контекста.

- Анализа тональности с учетом сарказма и нюансов.

- Вопросно-ответных систем (QA): Модели, такие как BERT, могут находить ответы в тексте, что мы используем для создания FAQ на основе документов.

- Генерации текста: С помощью GPT-подобных моделей мы экспериментируем с автоматическим созданием контента, перефразированием и генерацией диалогов для чат-ботов.

- Машинного перевода: Трансформеры показывают выдающиеся результаты в этой области.

- Тонкой настройки (Fine-tuning) предварительно обученных моделей на наших собственных данных, что позволяет нам достигать высокой точности даже с относительно небольшими размеченными датасетами.

Они требуют больше вычислительных ресурсов (часто GPU-ускорения), но их производительность и универсальность делают их незаменимыми для передовых задач NLP. Мы видим в них будущее и активно внедряем в наши проекты.

"Язык – это лабиринт, по которому мы идем, оставляя за собой следы слов, и только с помощью правильных инструментов мы можем разобраться в нем." – В.В. Набоков.

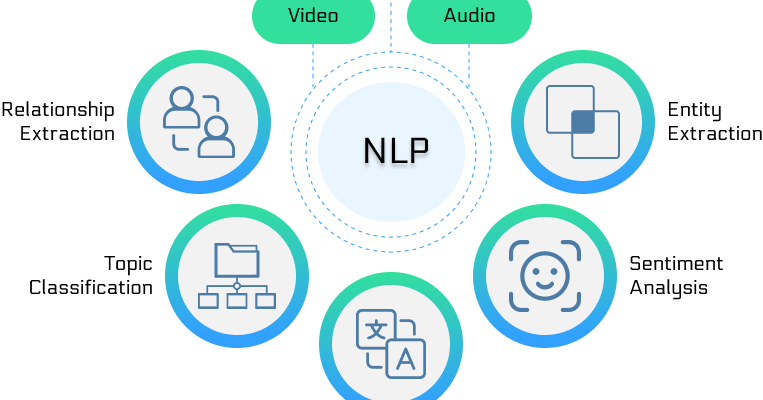

Прикладные задачи NLP: От анализа к действию

После того, как мы освоили основы предобработки и векторизации, а также научились использовать мощные библиотеки, перед нами открывается целый мир прикладных задач. NLP – это не просто академическая дисциплина; это набор инструментов, которые мы используем для решения реальных проблем, от улучшения взаимодействия с клиентами до автоматизации рутинных процессов.

Мы постоянно ищем новые способы применения этих технологий, чтобы сделать нашу работу с текстом более эффективной и осмысленной. Давайте рассмотрим некоторые из ключевых задач, которые мы регулярно решаем с помощью NLP.

Анализ тональности: Понимаем эмоции

Одной из самых востребованных задач является анализ тональности (Sentiment Analysis). Это процесс определения эмоциональной окраски текста – положительной, отрицательной или нейтральной. Для нас, как блогеров, это критически важно для понимания реакции аудитории на наши статьи, а также для анализа отзывов о продуктах или услуг, которые мы рассматриваем.

Мы используем различные подходы:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Для анализа тональности сообщений в социальных сетях (Twitter/Reddit) VADER является отличным выбором. Он основан на правилах и лексиконе, хорошо справляется с эмодзи и сленгом, что делает его весьма эффективным для неформального текста.

- Машинное обучение с Scikit-learn: Для более сложных задач, например, анализа тональности финансовых новостей или отзывов о фильмах, мы обучаем собственные классификаторы, используя TF-IDF векторы и алгоритмы SVM или наивного Байеса.

- Трансформеры: Для глубокого анализа, особенно когда нужно учесть сарказм или тонкие нюансы, мы обращаемся к предобученным трансформерным моделям из Hugging Face. Они дают нам возможность улавливать более сложные эмоциональные паттерны.

Мы также активно анализируем тональность отзывов о ресторанах и постах о политике, чтобы выявить общие настроения и тенденции.

Распознавание именованных сущностей (NER): Выделяем главное

Распознавание именованных сущностей (NER) – это процесс идентификации и классификации именованных объектов в тексте, таких как имена людей, организаций, местоположений, дат и т.д. Это невероятно полезно для извлечения структурированной информации из неструктурированного текста.

Наш основной инструмент для NER – это spaCy, который предоставляет быстрые и точные модели. Для более сложных и кастомизированных задач, а также для языков с богатой морфологией, мы используем Stanza (разработанный Stanford NLP Group) или Flair, который также основан на нейронных сетях и дает отличные результаты, особенно при тонкой настройке.

Мы применяем NER для:

- Извлечения фактов из новостей.

- Анализа юридических документов для выявления сторон, дат и условий.

- Автоматической разметки данных для обучения других моделей;

Постоянно оцениваем качество наших NER-моделей с помощью таких метрик, как F1-score, Precision и Recall, чтобы убедиться в их надежности.

Тематическое моделирование: Обнаруживаем скрытые темы

Когда у нас есть большой объем текстовых данных, бывает сложно вручную понять, о чем идет речь в каждом документе или какие общие темы их объединяют. Здесь на помощь приходит тематическое моделирование – алгоритмы, которые автоматически обнаруживают скрытые абстрактные "темы" в коллекции текстов.

Мы активно используем библиотеку Gensim для реализации таких моделей, как:

- LDA (Latent Dirichlet Allocation): Позволяет нам выявить набор тем и определить, какие слова наиболее характерны для каждой темы, а также к каким темам относится каждый документ. Мы используем LDA для анализа отзывов о продуктах, чтобы выделить ключевые аспекты, которые волнуют покупателей, или для анализа блогов и форумов, чтобы понять интересы сообщества.

- LSI (Latent Semantic Indexing): Еще один эффективный метод для поиска скрытых семантических связей.

Мы также проводим сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), чтобы выбрать наиболее подходящий подход для конкретного корпуса текстов. Это позволяет нам не только выделять темы, но и анализировать их временные ряды, выявляя сезонность или эволюцию интересов.

Классификация текстов: Распределяем по категориям

Классификация текстов – это задача присвоения тексту одной или нескольких предопределенных категорий. Это одна из самых распространенных задач в NLP, которую мы используем для множества целей:

- Автоматическая категоризация новостей: Распределение статей по рубрикам (спорт, политика, экономика).

- Фильтрация спама: Определение, является ли сообщение нежелательным.

- Анализ текстов отзывов клиентов: Классификация отзывов по категориям проблем или преимуществ.

- Определение стиля письма и авторства текста.

Мы используем Scikit-learn с различными алгоритмами (SVM, Наивный Байес, Логистическая регрессия) после векторизации текста с помощью TF-IDF или Word Embeddings. Для более сложных задач и когда у нас есть достаточно размеченных данных, мы переходим к применению PyTorch/TensorFlow для создания нейросетей (например, LSTM-сетей) или используем BERT для задач классификации, который дает более высокую точность благодаря контекстному пониманию.

Суммаризация текста: Извлекаем суть

В мире информационного перегруза, способность быстро извлекать суть из длинных текстов становится бесценной. Суммаризация текста – это процесс создания краткого, но информативного изложения исходного документа.

Мы различаем два основных подхода:

- Экстрактивная суммаризация (Extractive Summarization): Выбирает наиболее важные предложения из исходного текста и объединяет их в краткое изложение. Для этого мы часто используем алгоритмы на основе графов, такие как TextRank, который определяет важность предложений.

- Абстрактивная суммаризация (Abstractive Summarization): Генерирует новые предложения, которые передают смысл исходного текста, но не обязательно присутствуют в нем. Это более сложная задача, требующая глубокого понимания языка. Для этого мы применяем Transformer-модели (например, из Hugging Face), которые могут создавать связные и грамматически правильные резюме.

Сравнение моделей суммирования – это постоянная задача для нас, поскольку качество сильно зависит от типа текста и целей. Мы используем суммаризацию для быстрого обзора длинных статей, юридических документов или отчетов.

Продвинутые техники и специальные библиотеки: Расширяем горизонты

Мир NLP постоянно развивается, и мы, как блогеры, стремящиеся быть на острие технологий, постоянно изучаем и внедряем новые, более продвинутые техники и специализированные библиотеки. Это позволяет нам решать еще более сложные и уникальные задачи, выходящие за рамки стандартных классификаций и извлечений.

Эти инструменты помогают нам не только улучшать качество анализа, но и автоматизировать процессы, которые раньше казались невозможными без участия человека.

Работа с многоязычными текстами и специфическими форматами

Наш мир многоязычен, и тексты, с которыми мы работаем, далеко не всегда ограничиваются одним языком. Обработка многоязычных текстовых корпусов – это отдельное искусство, требующее специализированных инструментов.

- Polyglot: Эта библиотека отлично подходит для мультиязычности, позволяя нам проводить токенизацию, NER, анализ тональности и определение языка для множества языков, включая редкие.

- Stanza: Особенно ценна для языков с богатой морфологией, предоставляя высокоточные модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга на русском и других сложных языках.

- Обработка нелатинских алфавитов: Это требует особого внимания к кодировкам и выбору моделей, обученных на соответствующих языковых данных.

Помимо языков, мы часто сталкиваемся с текстом, хранящимся в недружественных форматах. PyMuPDF позволяет нам эффективно извлекать текст из PDF-документов, что крайне важно при анализе юридических документов или финансовых отчетов, которые часто представлены именно в этом формате.

Инструменты для визуализации и извлечения знаний

Числа и векторы – это хорошо, но для человека гораздо нагляднее визуальные представления. Мы используем различные инструменты для визуализации текстовых данных, чтобы сделать наши выводы более понятными и убедительными:

- Word Clouds: Облака слов – простой, но эффективный способ показать наиболее часто встречающиеся слова в тексте.

- Heatmaps: Тепловые карты помогают визуализировать корреляции между словами или темами.

- Анализ частотности слов и n-грамм: Это базовая, но очень информативная техника. Мы не просто подсчитываем, но и анализируем частотность редких слов и их значение, а также частотность имен собственных.

- RAKE (Rapid Automatic Keyword Extraction): Для извлечения ключевых фраз и слов, RAKE является простым, но эффективным алгоритмом, который помогает нам быстро понять суть документа.

- TextRank: Помимо суммаризации, TextRank также отлично подходит для извлечения ключевых предложений и тем из текста, используя принципы ранжирования, похожие на PageRank.

Мы также используем Textacy – мощную библиотеку для продвинутой обработки текста, которая предоставляет инструменты для извлечения информации, работы с зависимостями и анализа стилистики текстов (например, для определения авторского почерка).

Разработка чат-ботов и вопросно-ответных систем

Создание интерактивных систем, способных понимать и генерировать человеческий язык, является одной из самых захватывающих областей NLP.

- Rasa framework: Для разработки чат-ботов на Python мы активно используем Rasa. Это полноценный фреймворк, который позволяет создавать контекстно-зависимых ботов, способных вести сложные диалоги, распознавать намерения пользователя и извлекать сущности.

- Вопросно-ответные системы (QA): С помощью трансформеров (например, BERT) мы разрабатываем системы, способные находить точные ответы на вопросы в больших массивах документов. Это критически важно для автоматизации поддержки клиентов или создания внутренних баз знаний.

- Генерация диалогов: Используя Transformer-модели, мы экспериментируем с автоматической генерацией ответов для чат-ботов, что делает их общение более естественным и динамичным.

Мы также анализируем поведенческие паттерны в чатах, чтобы улучшать взаимодействие и эффективность наших ботов.

Масштабирование и оптимизация

Работа с текстом часто означает работу с огромными объемами данных. Обработка больших текстовых массивов (Big Data NLP) требует особого подхода и оптимизации.

- Использование GPU-ускорения: Для обучения сложных нейросетевых моделей и трансформеров мы активно используем GPU. Библиотеки PyTorch и TensorFlow изначально спроектированы для работы с GPU, что значительно ускоряет процессы.

- Обработка текста в режиме реального времени (Streaming NLP): Для задач, где скорость имеет решающее значение (например, анализ тональности в социальных сетях или мониторинг новостей), мы разрабатываем системы, способные обрабатывать текстовые потоки "на лету".

- Gensim для больших данных: Благодаря своей оптимизации, Gensim отлично подходит для работы с большими коллекциями документов при тематическом моделировании.

Мы постоянно ищем способы оптимизации наших алгоритмов и инфраструктуры, чтобы обрабатывать еще большие объемы данных с максимальной эффективностью.

Как мы видим, мир обработки естественного языка в Python огромен и постоянно расширяется. От простейшей токенизации до сложных трансформерных моделей, способных генерировать осмысленные тексты, мы прошли долгий путь, и каждый день открываем для себя что-то новое. Мы, как блогеры, используем эти инструменты не только для анализа окружающего нас текстового ландшафта, но и для того, чтобы делать наш собственный контент более эффективным, целевым и понятным для аудитории.

Наш опыт показывает, что ключ к успеху в NLP лежит в постоянном обучении, экспериментировании и адаптации. Нет универсального решения для всех задач; каждая проблема требует своего подхода, своего набора инструментов и своей доли креативности. Мы надеемся, что наш рассказ вдохновит вас на собственные исследования и поможет вам в вашем путешествии по этому удивительному миру, где слова превращаются в данные, а данные – в знание. Продолжайте кодить, продолжайте учиться, и пусть ваш текст всегда будет понятен не только людям, но и машинам.

.

Подробнее

| Python NLP библиотеки | Трансформеры в NLP | Анализ тональности Python | Тематическое моделирование LDA | Извлечение сущностей spaCy |

| Word2Vec GloVe сравнение | Лемматизация стемминг разница | Обработка больших текстовых данных | Разработка чат-ботов Python | Машинный перевод Python |