- Разгадывая Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

- Первые Шаги: От Сырого Текста к Значимым Единицам

- Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

- Регулярные Выражения: Наш Швейцарский Нож для Очистки Текста

- Представление Текста для Машин: От Слов к Числам

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: Когда Слова Обретают Смысл

- Извлечение Смысла и Структуры: Глубже в Текст

- Распознавание Именованных Сущностей (NER) и Синтаксический Парсинг

- Тематическое Моделирование: Обнаружение Скрытых Темы

- Анализ Тональности (Sentiment Analysis): Понимание Эмоций

- От Моделей к Приложениям: Создание Интеллектуальных Систем

- Классификация и Категоризация Текстов

- Извлечение Ключевой Информации и Суммаризация

- Чат-боты и Вопросно-ответные Системы

- Инструменты и Методы для Специфических Задач

- Работа с Разнообразными Источниками и Языками

- Качество Данных и Дополнительные Анализы

- Визуализация и Оценка

- Будущее NLP: Трансформеры и Большие Данные

Разгадывая Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

Привет, друзья-энтузиасты и просто любопытные умы! Сегодня мы отправляемся в увлекательное путешествие по безграничным просторам, где слова оживают, а машины учатся понимать человеческую речь. Мы говорим об Обработке Естественного Языка, или NLP (Natural Language Processing), и о том, как Python стал нашим незаменимым проводником в этом удивительном мире. Если вы когда-либо задумывались, как поисковые системы понимают ваши запросы, как чат-боты отвечают на вопросы или как анализируются миллионы отзывов клиентов, то эта статья для вас. Мы покажем вам, как с помощью мощных библиотек и подходов мы, обычные люди, можем заставить компьютеры читать, понимать и даже генерировать текст.

Наш опыт в этой сфере убедил нас, что NLP, это не просто набор сложных алгоритмов, а скорее искусство и наука одновременно. Мы постоянно сталкиваемся с новыми вызовами, будь то обработка сленга в социальных сетях, анализ юридических документов или создание интеллектуальных помощников. И каждый раз Python предлагает нам элегантные и эффективные решения. Давайте же вместе погрузимся в этот мир и рассмотрим основные инструменты и концепции, которые мы используем в нашей повседневной практике, чтобы превратить хаотичный поток слов в ценные знания.

Первые Шаги: От Сырого Текста к Значимым Единицам

Любое взаимодействие с текстом начинается с его подготовки. Представьте себе огромную гору слов, знаков препинания, цифр и символов. Прежде чем мы сможем извлечь из неё смысл, нам нужно разобрать эту гору на отдельные, осмысленные кирпичики. Именно здесь на помощь приходят базовые операции NLP, такие как токенизация, стемминг и лемматизация, а также регулярные выражения для очистки данных.

Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

Когда мы только начинаем работать с текстом, перед нами встаёт задача разделить его на базовые единицы — слова или предложения. Этот процесс называется токенизацией. Мы используем такие библиотеки, как NLTK (Natural Language Toolkit) и spaCy, которые предлагают мощные и гибкие инструменты для токенизации на разных языках. NLTK, например, отлично подходит для экспериментов и обучения, предоставляя множество алгоритмов токенизации, от простых разделений по пробелам до более сложных, учитывающих особенности языков.

После токенизации мы часто сталкиваемся с проблемой того, что одно и то же слово может иметь разные формы (например, "бегать", "бегал", "бегущий"). Чтобы привести их к общей основе, мы применяем стемминг или лемматизацию. Стемминг, как правило, отсекает окончания, пытаясь найти "корень" слова, но не всегда даёт грамматически корректные результаты. Лемматизация, в свою очередь, приводит слово к его словарной форме (лемме), что обычно даёт более точные и осмысленные результаты. Мы предпочитаем продвинутую лемматизацию с spaCy, поскольку она учитывает часть речи и контекст, что особенно важно для языков с богатой морфологией, таких как русский.

Регулярные Выражения: Наш Швейцарский Нож для Очистки Текста

Перед тем как приступить к более сложным анализам, текст часто нуждается в серьёзной очистке. Удаление HTML-тегов, специальных символов, цифр, лишних пробелов или даже смайликов — всё это рутина, без которой не обойтись. Мы активно используем модуль re (регулярные выражения) в Python. Это невероятно мощный инструмент, который позволяет нам находить и манипулировать строками по сложным шаблонам. С помощью регулярных выражений мы можем:

- Удалять HTML-теги из веб-страниц, полученных через веб-скрейпинг.

- Нормализовать пунктуацию, заменяя несколько знаков препинания на один или удаляя ненужные.

- Обрабатывать эмодзи и сленг, либо удаляя их, либо заменяя на стандартизированные формы, если это требуется для анализа.

- Удалять стоп-слова (часто встречающиеся, но малоинформативные слова, такие как "и", "в", "на"), хотя для некоторых задач мы сохраняем их.

Эти базовые операции формируют фундамент для всех последующих этапов анализа. Без чистого и правильно размеченного текста даже самые продвинутые алгоритмы будут работать неэффективно или давать ошибочные результаты. Мы всегда уделяем особое внимание этому этапу, понимая, что "мусор на входе — мусор на выходе".

Представление Текста для Машин: От Слов к Числам

Компьютеры не "понимают" слова так, как мы. Для них текст — это просто последовательность символов. Чтобы машины могли работать с текстом, нам необходимо преобразовать его в числовой формат, который можно подавать на вход алгоритмам машинного обучения. Этот процесс называется векторизацией.

Классические Векторизаторы: CountVectorizer и TF-IDF

Мы начинаем с самых распространённых методов, таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn.

- CountVectorizer просто подсчитывает частоту каждого слова в документе. Это создаёт разреженную матрицу, где строки представляют документы, а столбцы — уникальные слова в нашем корпусе. Это простой, но часто эффективный подход, особенно для задач классификации.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency) идёт дальше. Он не только учитывает, как часто слово встречается в документе (TF), но и как редко оно встречается во всём корпусе документов (IDF). Таким образом, слова, которые являются уникальными для определённого документа, получают больший вес, а общие слова (вроде "и", "в") — меньший. Мы часто используем TF-IDF, когда нам нужно выделить наиболее значимые слова в документе, например, для извлечения ключевых фраз.

Мы неоднократно сравнивали эти методы, и выбор всегда зависит от конкретной задачи и характеристик данных. Иногда более простые решения оказываются наиболее подходящими.

Сравнение TF-IDF и Word2Vec:

| Критерий | TF-IDF | Word2Vec/Doc2Vec |

|---|---|---|

| Представление | Частота/вес слова в документе относительно корпуса. | Плотные векторы, отражающие семантическое сходство. |

| Контекст | Не учитывает семантический контекст слов. | Учитывает контекст, в котором слова встречаются. |

| Размерность | Высокая (размер словаря), разреженная. | Низкая, плотная. |

| Применение | Извлечение ключевых слов, простая классификация. | Семантический поиск, рекомендательные системы, сложные классификации. |

Word Embeddings: Когда Слова Обретают Смысл

Революция в представлении текста произошла с появлением Word Embeddings (векторных представлений слов). Вместо простых подсчётов, эти методы учатся представлять слова в виде плотных векторов в многомерном пространстве, где слова со схожим значением располагаются ближе друг к другу. Мы активно используем модели Word2Vec и GloVe, а также FastText, особенно для работы с редкими словами и морфологически богатыми языками.

- Word2Vec (Skip-gram и CBOW) из библиотеки Gensim позволяет нам обучать собственные эмбеддинги на больших корпусах текста. Мы обнаружили, что обученные на наших данных векторы часто работают лучше, чем предобученные, особенно в специфических предметных областях.

- GloVe (Global Vectors for Word Representation) похож на Word2Vec, но использует глобальную статистику сопутствия слов.

- FastText, также от Facebook, является расширением Word2Vec, который учитывает морфологию слов, представляя их как набор символьных n-грамм. Это делает его особенно ценным для языков, где слова могут иметь множество форм, и для обработки слов, которые не встречались в обучающем корпусе.

Когда речь заходит о представлении целых документов или предложений, мы обращаемся к Doc2Vec (расширению Word2Vec) или, что ещё мощнее, к Sentence Transformers. Последние позволяют нам получать высококачественные векторные представления предложений и документов, сохраняя их семантический смысл. Это открывает двери для таких задач, как поиск семантически похожих документов, кластеризация текстов и построение рекомендательных систем.

Извлечение Смысла и Структуры: Глубже в Текст

После того как текст преобразован в числовое представление, мы можем начать извлекать из него более сложные сущности и паттерны. Это включает в себя распознавание именованных сущностей, тематическое моделирование и анализ тональности.

Распознавание Именованных Сущностей (NER) и Синтаксический Парсинг

Распознавание именованных сущностей (NER) — это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, локации, даты и т.д.. Для нас это один из ключевых инструментов для извлечения структурированной информации из неструктурированного текста.

- Мы часто используем spaCy для быстрого NER. Его предобученные модели очень эффективны и позволяют нам быстро получать качественные результаты.

- Для более сложных задач или языков с богатой морфологией мы обращаемся к библиотекам вроде Flair или моделям на основе BERT из Hugging Face Transformers. Они позволяют достигать выдающейся точности, особенно после тонкой настройки (fine-tuning) на наших специфических данных;

- В некоторых случаях, когда стандартные модели не справляются, мы используем CRF (Conditional Random Fields) для распознавания сущностей, обучая собственные модели на размеченных данных.

Помимо NER, для понимания структуры предложений мы применяем синтаксический парсинг и анализ зависимостей, также с помощью spaCy. Это позволяет нам понять, как слова связаны друг с другом в предложении, кто является субъектом действия, какой объект затронут и т.д. Эти данные бесценны для создания более продвинутых систем, таких как вопросно-ответные системы или системы извлечения фактов.

Тематическое Моделирование: Обнаружение Скрытых Темы

Представьте, что у вас есть тысячи документов, и вы хотите понять, о чём они, не читая каждый из них. Здесь на помощь приходит тематическое моделирование. Мы используем библиотеку Gensim для таких алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Эти модели позволяют нам автоматически обнаруживать скрытые темы в больших коллекциях документов.

Мы часто сравниваем модели тематического моделирования (LDA vs NMF). LDA хорошо работает, когда темы могут пересекаться, а NMF (Non-negative Matrix Factorization) часто даёт более интерпретируемые темы, особенно когда мы хотим, чтобы каждое слово принадлежало только одной теме. Выбор между ними зависит от особенностей данных и наших целей. Тематическое моделирование незаменимо для анализа текстов отзывов клиентов, блогов, форумов и автоматической категоризации статей.

"Язык — это дорожная карта культуры. Он говорит вам, откуда люди пришли и куда они идут."

— Рита Мэй Браун

Анализ Тональности (Sentiment Analysis): Понимание Эмоций

Понять, что люди думают или чувствуют по отношению к продукту, услуге или событию, — это одна из самых востребованных задач NLP. Анализ тональности позволяет нам определить эмоциональную окраску текста — положительную, отрицательную или нейтральную.

- Для быстрого и простого анализа мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично подходит для коротких текстов, особенно из социальных сетей.

- TextBlob также предоставляет простой интерфейс для анализа тональности и определения языка. Однако мы знаем его ограничения и для более сложных сценариев ищем альтернативы.

- Когда мы работаем с анализом тональности сообщений в социальных сетях (Twitter/Reddit), мы сталкиваемся с такими вызовами, как сарказм, ирония и использование сленга. Здесь мы часто прибегаем к трансформерным архитектурам для распознавания эмоций, которые способны улавливать тонкие нюансы.

- Мы также применяем анализ тональности в очень специфических областях, например, для анализа тональности финансовых новостей, где требуется особая точность и понимание контекста.

Мы разрабатываем инструменты для нормализации сленга и работы с эмодзи, чтобы улучшить качество анализа тональности в современных текстах. Это позволяет нашим моделям быть более точными и релевантными в постоянно меняющемся языковом ландшафте.

От Моделей к Приложениям: Создание Интеллектуальных Систем

Наш опыт показывает, что истинная ценность NLP раскрывается, когда мы применяем эти инструменты для решения реальных задач, создавая интеллектуальные системы, которые помогают людям и бизнесу.

Классификация и Категоризация Текстов

Одной из наиболее распространённых задач является классификация текстов — присвоение тексту одной или нескольких категорий. Это может быть классификация спама, маршрутизация запросов клиентов, категоризация новостных статей или анализ отзывов о продуктах.

- Мы активно используем Scikit-learn для классификации текстов, применяя такие алгоритмы, как SVM (Support Vector Machines) и наивный байесовский классификатор. Они являются отличной отправной точкой и часто дают хорошие результаты.

- Для более сложных задач и больших объемов данных мы переходим к применению PyTorch/TensorFlow для создания нейросетей NLP. LSTM-сети (Long Short-Term Memory) и, конечно же, трансформерные архитектуры (BERT) позволяют нам достигать современного уровня производительности. Мы проводим тонкую настройку (Fine-tuning) предварительно обученных моделей, чтобы адаптировать их под наши специфические задачи.

- Мы также разрабатываем системы для автоматической категоризации статей и новостей, что значительно упрощает управление контентом.

Извлечение Ключевой Информации и Суммаризация

Часто нам нужно не просто классифицировать текст, но и извлечь из него наиболее важные фрагменты или создать краткое изложение.

- Для извлечения ключевых фраз и слов мы применяем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) и TextRank. Эти методы помогают нам быстро определить наиболее значимые термины в документе.

- Суммаризация текста — ещё одна важная задача. Мы работаем над разработкой системы суммаризации текста, которая может быть экстрактивной (выбирает самые важные предложения из исходного текста) или абстрактивной (генерирует новые предложения, передающие смысл). Для абстрактивной суммаризации мы используем Transformer-модели, которые демонстрируют впечатляющие результаты. Мы постоянно сравниваем модели суммирования: экстрактивная и абстрактная, чтобы выбрать наиболее подходящий подход для конкретного случая.

- Извлечение фактов из новостей и создание FAQ на основе документов — это практические применения этих техник, которые мы успешно реализуем.

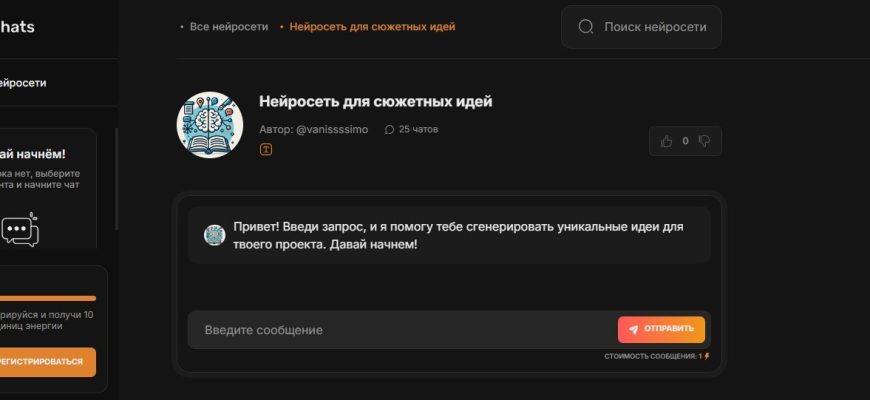

Чат-боты и Вопросно-ответные Системы

Мечта о машинах, способных вести осмысленный диалог, становится реальностью благодаря NLP. Мы занимаемся разработкой чат-ботов на Python, используя такие фреймворки, как Rasa. Это позволяет нам создавать интерактивные системы, которые могут отвечать на вопросы, выполнять задачи и общаться с пользователями естественным образом.

Разработка систем вопросно-ответных систем (QA) — это более сложная задача, где машина должна не просто отвечать по шаблону, а понимать вопрос и находить ответ в большом корпусе документов. Здесь мы активно используем трансформерные модели, особенно BERT, которые способны с высокой точностью находить релевантные фрагменты текста. Мы также экспериментируем с Transformer-моделями для генерации диалогов, чтобы сделать общение с ботами ещё более естественным.

Инструменты и Методы для Специфических Задач

Мир NLP огромен, и каждый день появляются новые задачи и инструменты. Мы постоянно исследуем и внедряем лучшие практики для различных сценариев.

Работа с Разнообразными Источниками и Языками

Текст может поступать из самых разных источников и на разных языках.

- Для извлечения текста из веб-страниц мы используем библиотеку Beautiful Soup для веб-скрейпинга текста. Это позволяет нам собирать огромные объемы данных для анализа.

- Если текст заперт в PDF-документах, мы применяем PyMuPDF для извлечения текста из PDF, что особенно актуально для анализа юридических или научных документов.

- Обработка многоязычных текстовых корпусов является нашей постоянной задачей. Мы используем такие библиотеки, как Polyglot и Stanza, которые поддерживают множество языков, включая языки с богатой морфологией, такие как русский. Разработка систем машинного перевода на Python, особенно для узкоспециализированных текстов, также входит в сферу наших интересов.

- Мы также сталкиваемся с работой с нелатинскими алфавитами, и современные библиотеки NLP хорошо адаптированы для этого.

Качество Данных и Дополнительные Анализы

Качество исходных данных напрямую влияет на результаты. Мы уделяем большое внимание их предобработке и анализу.

- Проблемы обработки неполных и ошибочных данных всегда являются вызовом. Мы разрабатываем инструменты для очистки текста, проверки грамматики и исправления орфографии, часто используя такие библиотеки, как Jellyfish для сравнения строк и поиска похожих слов.

- Для анализа стилистики текстов (авторский почерк) мы исследуем частотность слов, n-грамм, длину предложений и другие метрики. Это помогает нам, например, в разработке систем для определения авторства текста.

- Разработка систем обнаружения плагиата также основывается на сравнении текстов, для чего мы можем использовать TextDistance для измерения сходства.

- Мы также занимаемся анализом метаданных текста, чтобы получить дополнительный контекст.

Визуализация и Оценка

Понимание результатов анализа не менее важно, чем сам анализ.

- Для визуализации текстовых данных мы используем Word Clouds для отображения частотности слов и Heatmaps для визуализации матриц сходства. Библиотеки, такие как Sweetviz, также могут помочь в анализе текстовых данных, предоставляя быстрые и информативные отчёты.

- Когда мы разрабатываем новые модели, мы всегда проводим оценку качества NER-моделей (F1-score, Precision, Recall) и других алгоритмов. Эти метрики позволяют нам объективно сравнивать эффективность различных подходов. Мы также сравниваем эффективность различных токенизаторов, лемматизаторов и векторизаторов, чтобы выбрать оптимальное решение.

Будущее NLP: Трансформеры и Большие Данные

Последние годы ознаменовались появлением трансформерных архитектур, таких как BERT, GPT и другие модели из библиотеки Hugging Face Transformers. Они изменили ландшафт NLP, позволив нам достигать беспрецедентной точности во многих задачах.

- Мы активно используем трансформеры для сложных задач NLP, включая классификацию, NER, суммаризацию и машинный перевод.

- BERT для задач классификации и NER стал нашим стандартом для многих проектов.

- Transformer-модели для генерации текста (GPT) открыли новые возможности для создания контента, от статей до диалогов и даже кода. Мы экспериментируем с использованием трансформеров для анализа кода (сжатие кода).

- Когда речь заходит об обработке больших текстовых массивов (Big Data NLP), трансформеры и специализированные библиотеки, такие как Gensim, показывают свою мощь, позволяя нам эффективно работать с петабайтами текстовых данных.

Мы постоянно следим за новейшими исследованиями и инструментами, чтобы оставаться на переднем крае NLP. Разработка инструментов для автоматической разметки данных, создание словарей и тезаурусов, анализ поведенческих паттернов в чатах и отзывах, обработка текста в режиме реального времени — все это часть нашей повседневной работы и нашего стремления сделать машины умнее.

Как вы видите, мир обработки естественного языка на Python невероятно богат и разнообразен. От самых базовых операций, таких как токенизация, до сложных нейросетевых архитектур, таких как трансформеры — у нас есть арсенал инструментов для решения практически любой текстовой задачи. Мы постоянно учимся, экспериментируем и внедряем новые подходы, чтобы наши системы могли лучше понимать и взаимодействовать с человеческим языком. Наш путь в NLP, это непрерывное исследование, полное открытий и новых возможностей.

Мы надеемся, что эта статья вдохновила вас на собственные эксперименты и показала, насколько доступным и мощным может быть NLP с Python. Присоединяйтесь к нам в этом увлекательном путешествии, ведь будущее, где машины и люди общаются без барьеров, уже не за горами!

На этом статья заканчивается.

Подробнее

| NLTK основы | spaCy NER | Word2Vec обучение | Анализ тональности Python | Hugging Face Transformers |

| Текстовая классификация | Тематическое моделирование LDA | Чат-боты Rasa | Векторизация текстов | Очистка текстовых данных |