- Разгадывая Язык Машин: Наш Путь в Мир Обработки Естественного Языка с Python

- Основы Обработки Текста: Первый Шаг к Пониманию

- Предобработка: От Сырого Текста к Чистым Данным

- Токенизация и Стемминг (NLTK)

- Лемматизация (SpaCy, NLTK, Stanza)

- Регулярные Выражения (re)

- Удаление Стоп-Слов, Пунктуации, HTML-Тегов

- Обработка Неполных и Ошибочных Данных

- Библиотеки-Помощники для Быстрого Старта

- NLTK: Наш Ветеран в NLP

- SpaCy: Скорость и Эффективность

- TextBlob: Простота для Повседневных Задач

- Textacy, Pattern, Polyglot: Расширенные Возможности

- Представление Текста для Машин: От Слов к Числам

- Векторизаторы на основе Частотности

- CountVectorizer

- TfidfVectorizer

- Анализ Частотности Слов и N-грамм

- Векторные Представления Слов (Word Embeddings)

- Word2Vec (Gensim)

- GloVe

- FastText: Работа с Редкими Словами

- Векторизация Предложений и Документов

- Doc2Vec (Gensim)

- Sentence Transformers

- Векторизация с Учетом Контекста (Контекстное Встраивание)

- Основные Задачи NLP: Разбираемся в Сути

- Распознавание Именованных Сущностей (NER)

- SpaCy для Быстрого NER

- CRF для Распознавания Сущностей

- Flair для Современного NER

- Разметка и Оценка NER-Моделей

- Анализ Тональности (Sentiment Analysis)

- VADER для Базового Анализа

- TextBlob для Простого Анализа

- Анализ Тональности в Социальных Сетях, Отзывах (с учетом сарказма, эмодзи, сленга)

- Классификация Текстов

- Scikit-learn (SVM, Наивный Байес)

- Применение BERT для Задач Классификации

- Keras/TensorFlow для Создания LSTM-Сетей

- Классификация с PyTorch

- Тематическое Моделирование

- LDA, LSI (Gensim)

- NMF

- Суммаризация Текста

- Экстрактивная и Абстрактивная Суммаризация

- TextRank для Извлечения Ключевых Предложений

- Использование Transformer-моделей для Суммаризации

- Извлечение Ключевых Фраз и Слов

- RAKE для Извлечения Ключевых Слов

- TextRank для Выделения Тем

- Эра Трансформеров: Новый Уровень Понимания

- Hugging Face и Трансформерные Архитектуры

- BERT, GPT, T5 для Сложных Задач

- Тонкая Настройка (Fine-tuning) Предобученных Моделей

- Применение Трансформеров

- Генерация Текста и Диалогов

- Машинный Перевод

- Распознавание Эмоций

- Анализ Кода

- Практические Приложения и Продвинутые Техники

- Построение Интеллектуальных Систем

- Вопросно-ответные Системы (QA)

- Чат-боты (Rasa framework)

- Системы Автоматической Категоризации и Тегирования

- Системы Обнаружения Плагиата

- Системы Проверки Фактов (Fact-Checking)

- Работа с Разнообразными Текстовыми Источниками

- Веб-скрейпинг Текста (Beautiful Soup)

- Извлечение Текста из PDF (PyMuPDF)

- Анализ Лог-файлов

- Анализ Юридических и Медицинских Документов

- Мультиязычный NLP

- Обработка Многоязычных Текстовых Корпусов

- Использование Polyglot и Stanza для Языков с Богатой Морфологией

- Дополнительные Инструменты и Методы

- Синтаксический Парсинг (SpaCy)

- Анализ Стилистики Текстов (Авторский Почерк)

- Создание Словарей и Тезаурусов

- Измерение Сходства Строк и Документов (Jellyfish, Textdistance)

- Визуализация Текстовых Данных (Word Clouds, Heatmaps)

- Обработка Текста в Режиме Реального Времени (Streaming NLP)

- GPU-ускорение в NLP

- Вызовы и Перспективы: Куда Движется NLP?

Разгадывая Язык Машин: Наш Путь в Мир Обработки Естественного Языка с Python

Приветствуем, дорогие читатели и коллеги по увлечению! Сегодня мы отправляемся в увлекательное путешествие по безграничным просторам обработки естественного языка, или NLP (Natural Language Processing). Это область, где компьютеры учатся понимать, интерпретировать и даже генерировать человеческий язык. Представьте себе: машины, которые не просто обрабатывают данные, а улавливают нюансы значения, эмоции и контекст! Звучит как научная фантастика, но благодаря Python и множеству мощных библиотек, это стало нашей повседневной реальностью.

Мы, как опытные исследователи и энтузиасты, уже много лет погружены в эту удивительную сферу, и за это время накопили огромный опыт, которым хотим поделиться с вами. Нам посчастливилось наблюдать, как NLP из нишевой академической дисциплины превратилось в одну из самых востребованных и быстроразвивающихся областей в сфере искусственного интеллекта. От умных помощников в наших смартфонах до сложных систем анализа больших данных — NLP вездесуще, и его потенциал продолжает расти. Давайте вместе исследуем, как Python становится нашим незаменимым инструментом в этом захватывающем деле.

В современном мире, где информация является ключевым активом, объем генерируемого текста ошеломляет. Социальные сети, новостные ленты, научные статьи, клиентские отзывы, юридические документы — все это потоки неструктурированного текста, которые содержат бесценные знания. Однако для человека обработка такого количества данных вручную становится непосильной задачей. Именно здесь на помощь приходит обработка естественного языка. Она позволяет нам автоматизировать анализ, извлечение информации, классификацию и даже генерацию текста, открывая двери для совершенно новых возможностей в бизнесе, науке и повседневной жизни.

Мы живем в эпоху, когда каждый клик, каждая фраза в чате, каждое сообщение в мессенджере может быть потенциальным источником данных для улучшения продуктов, персонализации сервисов или даже прогнозирования рыночных тенденций. NLP — это мост между хаосом человеческого языка и упорядоченным миром компьютерной логики. Без него мы были бы затоплены информацией, не имея возможности ее эффективно использовать. Python, благодаря своей простоте, обширной экосистеме библиотек и активному сообществу, стал де-факто стандартом для разработки NLP-приложений, позволяя нам превращать сложные идеи в работающие решения с удивительной скоростью и эффективностью.

Основы Обработки Текста: Первый Шаг к Пониманию

Прежде чем мы сможем научить машину "читать" и "понимать" текст, нам необходимо этот текст подготовить. Сырые данные, полученные из различных источников, редко бывают идеальными. Они могут содержать шум, ошибки, форматирование, которое не несет смысловой нагрузки для алгоритмов. Поэтому предобработка является краеугольным камнем любого NLP-проекта. Это этап, на котором мы очищаем, структурируем и нормализуем текст, делая его пригодным для дальнейшего анализа.

Мы всегда начинаем с того, что текст должен быть максимально "чистым" и единообразным, чтобы наши модели могли сфокусироваться на содержании, а не на синтаксическом шуме. Этот процесс требует внимания к деталям и понимания того, как различные этапы предобработки влияют на конечный результат; От выбора правильного токенизатора до эффективной лемматизации — каждый шаг имеет значение, и мы готовы поделиться нашими лучшими практиками.

Предобработка: От Сырого Текста к Чистым Данным

Наш опыт показывает, что качество предобработки напрямую влияет на успех всего проекта NLP. Мы используем целый арсенал техник и инструментов для превращения хаотичного текстового потока в структурированные данные. Давайте рассмотрим основные этапы, которые мы применяем на практике.

Токенизация и Стемминг (NLTK)

Первым шагом всегда является токенизация – процесс разбиения текста на более мелкие единицы, называемые токенами. Токены могут быть словами, символами пунктуации, числами или даже предложениями. Мы используем различные подходы к токенизации в зависимости от задачи. Например, для большинства задач мы применяем токенизацию по словам, но иногда бывает полезно токенизировать по предложениям, чтобы сохранить контекст. Библиотека NLTK (Natural Language Toolkit) предоставляет нам широкий выбор токенизаторов, таких как word_tokenize и sent_tokenize.

После токенизации часто следует стемминг – процесс уменьшения словоформы до ее корневого слова или "стебля". Цель стемминга – свести различные формы одного и того же слова к общему корню, чтобы они рассматривались как одна и та же сущность. Например, слова "бежать", "бежит", "бегал" могут быть сведены к "беж". Мы часто используем стеммеры из NLTK, такие как PorterStemmer или SnowballStemmer, особенно для языков с богатой морфологией.

Лемматизация (SpaCy, NLTK, Stanza)

В отличие от стемминга, лемматизация — это более сложный процесс, который также направлен на приведение слова к его базовой форме, но с учетом морфологического анализа и словаря. Лемматизация гарантирует, что полученная базовая форма (лемма) является действительным словом. Например, "был", "есть", "будет" будут сведены к лемме "быть". Мы предпочитаем лемматизацию стеммингу, когда точность имеет первостепенное значение, поскольку она обеспечивает более осмысленные результаты.

Для лемматизации мы активно используем SpaCy благодаря ее скорости и высокому качеству для многих языков, включая английский. Для русского языка и других языков с богатой морфологией мы часто обращаемся к Stanza (от Стэнфордского университета), которая демонстрирует отличные результаты. Конечно, NLTK также предлагает свои лемматизаторы, например, WordNetLemmatizer, который хорошо работает для английского языка.

Регулярные Выражения (re)

Регулярные выражения (RegEx) – это мощный инструмент для поиска и манипулирования текстовыми шаблонами. Мы используем их на каждом этапе предобработки: для удаления нежелательных символов, ссылок, хэштегов, упоминаний, чисел, специальных символов или для извлечения определенных паттернов из текста. Модуль re в Python является нашим верным помощником в этом деле, позволяя нам гибко настраивать правила очистки.

Например, нам часто приходится удалять из текста email-адреса или URL-ссылки, которые могут засорять данные и отвлекать модели от истинного смысла. С помощью регулярных выражений мы можем написать компактный и эффективный код для выполнения таких задач, обеспечивая чистоту наших корпусов.

Удаление Стоп-Слов, Пунктуации, HTML-Тегов

Стоп-слова – это часто встречающиеся слова (например, "и", "в", "на", "он", "она"), которые, как правило, не несут существенной смысловой нагрузки для большинства задач NLP. Их удаление помогает уменьшить размер данных и сфокусировать анализ на более значимых словах. NLTK и SpaCy предоставляют готовые списки стоп-слов для различных языков, которые мы можем легко использовать или модифицировать.

Пунктуация также часто удаляется, если она не критична для задачи (например, для анализа тональности, где восклицательные знаки могут быть важны). HTML-теги являются типичным "шумом" при веб-скрейпинге и должны быть удалены, чтобы получить чистый текст. Мы используем комбинацию регулярных выражений и специализированных библиотек, таких как Beautiful Soup (для HTML), для эффективной очистки.

Обработка Неполных и Ошибочных Данных

Реальные данные редко бывают идеальными. Мы постоянно сталкиваемся с пропусками, опечатками, грамматическими ошибками и неполными фразами. Использование библиотек, таких как Jellyfish для сравнения строк или разработка собственных инструментов для проверки грамматики и исправления орфографии, становится необходимостью. Иногда нам приходится разрабатывать алгоритмы для нормализации сленга или работы с эмодзи, чтобы учесть особенности современных текстов из социальных сетей. Это требует гибкости и готовности адаптировать наши методы под конкретный источник данных.

Например, в анализе отзывов клиентов мы часто сталкиваемся с сокращениями и сленгом. Мы создаем собственные словари и правила для нормализации таких выражений, чтобы обеспечить их корректное распознавание моделями. Это итеративный процесс, который часто требует ручной разметки и последующей автоматизации.

Библиотеки-Помощники для Быстрого Старта

Python обязан своей популярностью в NLP не только простоте языка, но и невероятно богатой экосистеме библиотек. Они предоставляют нам готовые инструменты для выполнения большинства задач, позволяя сосредоточиться на логике приложения, а не на низкоуровневой реализации. Мы полагаемся на несколько ключевых библиотек, каждая из которых имеет свои сильные стороны.

NLTK: Наш Ветеран в NLP

NLTK (Natural Language Toolkit) — это, пожалуй, одна из старейших и наиболее полных библиотек для NLP на Python. Мы начинали свой путь в NLP именно с NLTK, и она до сих пор остается нашим выбором для многих базовых задач. Она предоставляет инструменты для токенизации, стемминга, лемматизации, POS-теггинга (разметка частей речи), морфологического анализа, построения языковых моделей на основе N-грамм и многого другого. NLTK отлично подходит для обучения, исследования и прототипирования, предлагая множество алгоритмов и корпусов данных.

Мы ценим NLTK за ее модульность и возможность глубоко погрузиться в детали каждого алгоритма. Она также содержит множество учебных данных, что делает ее идеальной для тех, кто только начинает изучать NLP.

SpaCy: Скорость и Эффективность

Если NLTK – это наш академический помощник, то SpaCy – это боевой конь для промышленного NLP. Мы используем SpaCy, когда нам нужна высокая производительность и готовые к продакшену модели. Она оптимизирована для скорости и эффективности, предлагая предварительно обученные модели для распознавания именованных сущностей (NER), синтаксического парсинга, лемматизации и векторизации слов для множества языков.

SpaCy особенно хороша для быстрого NER и реализации синтаксического парсинга. Ее конвейерная архитектура позволяет нам легко создавать сложные цепочки обработки текста, а возможность работы с GPU ускоряет процесс для больших объемов данных. Для русского языка SpaCy также предлагает хорошие модели, которые мы активно используем.

TextBlob: Простота для Повседневных Задач

Иногда нам не нужны сложные модели или глубокий анализ; нам просто нужен быстрый и простой способ выполнить базовые задачи NLP. Здесь на помощь приходит TextBlob. Это библиотека, построенная поверх NLTK, которая предоставляет простой API для таких операций, как токенизация, POS-теггинг, извлечение существительных, анализ тональности и даже перевод. Она идеальна для быстрых прототипов или для задач, где не требуется максимальная точность.

Мы часто используем TextBlob для простого анализа тональности или определения языка в небольших проектах, когда скорость разработки важнее тонкой настройки. Однако мы также осознаем ее ограничения и знаем, когда следует переходить к более мощным инструментам.

Textacy, Pattern, Polyglot: Расширенные Возможности

Помимо основных, мы также используем специализированные библиотеки для более нишевых задач:

- Textacy: Эта библиотека, построенная на SpaCy, предоставляет расширенный набор функций для извлечения информации, анализа ключевых фраз, работы с зависимостями и многого другого. Мы часто обращаемся к ней, когда SpaCy недостаточно.

- Pattern: Это веб-майнинговая библиотека для Python, которая также включает в себя инструменты для NLP, такие как POS-теггер, NER, анализатор тональности и склонения. Она может быть полезна для анализа социальных сетей и других веб-данных.

- Polyglot: Если мы работаем с редкими или мультиязычными текстовыми корпусами, Polyglot становится незаменимой. Она поддерживает широкий спектр языков для токенизации, NER, определения языка и морфологического анализа, что делает ее отличным выбором для глобальных проектов.

Представление Текста для Машин: От Слов к Числам

После того как мы очистили и подготовили наш текст, возникает следующий фундаментальный вопрос: как машина может его "понять"? Компьютеры работают с числами, а не со словами. Поэтому ключевым этапом в NLP является преобразование текста в числовые векторы, которые могут быть поданы на вход алгоритмам машинного обучения. Этот процесс называется векторизацией текста, и мы используем различные подходы, каждый из которых имеет свои преимущества и недостатки.

Мы всегда ищем наиболее подходящий метод векторизации для конкретной задачи, поскольку выбор этого метода может существенно повлиять на производительность наших моделей. От простых частотных представлений до сложных контекстуальных встраиваний — каждый подход открывает новые возможности для анализа.

Векторизаторы на основе Частотности

Самые простые, но часто эффективные методы векторизации основаны на частотности слов в документе или корпусе. Они создают разреженные векторы, где каждое измерение соответствует уникальному слову в словаре.

CountVectorizer

CountVectorizer – это базовый, но очень полезный инструмент из библиотеки Scikit-learn. Он преобразует коллекцию текстовых документов в матрицу подсчета токенов (слов). Каждая строка в матрице представляет документ, а каждый столбец – уникальное слово из всего корпуса. Значение в ячейке – это количество раз, когда данное слово встречается в данном документе;

Мы часто используем CountVectorizer для задач, где важна абсолютная частотность слов, например, для анализа частотности слов и N-грамм или для простой классификации текста. Он прост в понимании и реализации, что делает его отличным выбором для первого этапа анализа.

TfidfVectorizer

TfidfVectorizer (Term Frequency-Inverse Document Frequency) – это более продвинутый метод, который также подсчитывает частоту слов, но при этом учитывает их важность. TF-IDF присваивает вес каждому слову, который пропорционален тому, как часто слово появляется в документе (TF), но обратно пропорционален тому, как часто слово появляется во всем корпусе (IDF). Таким образом, редкие, но значимые слова получают более высокий вес, чем общие стоп-слова.

Мы предпочитаем TfidfVectorizer для большинства задач классификации и тематического моделирования, поскольку он лучше отражает семантическую значимость слов. Сравнение TF-IDF vs Word2Vec показывает, что TF-IDF остается мощным инструментом, особенно когда требуется интерпретируемость векторов.

Анализ Частотности Слов и N-грамм

Помимо векторизации, мы также проводим прямой анализ частотности слов и N-грамм. N-грамма – это последовательность из N слов. Например, для фразы "машинное обучение" "машинное" и "обучение" являются 1-граммами, а "машинное обучение" – 2-граммой. Анализ N-грамм помогает нам выявлять устойчивые словосочетания, фразы и даже анализировать частотность редких слов и их значение. Это особенно полезно для извлечения ключевых фраз и построения языковых моделей на основе N-грамм, которые могут предсказывать следующее слово в последовательности.

Векторные Представления Слов (Word Embeddings)

Частотные методы имеют одно существенное ограничение: они не учитывают семантическое сходство между словами. То есть, "король" и "королева" будут восприниматься как совершенно разные слова, хотя они семантически связаны. Векторные представления слов (Word Embeddings) решают эту проблему, отображая слова в плотные векторы чисел таким образом, что семантически похожие слова располагаются близко друг к другу в векторном пространстве.

Word2Vec (Gensim)

Word2Vec – это одна из самых известных и влиятельных моделей для создания векторных представлений слов. Она была разработана Google и реализована в Python, в частности, в библиотеке Gensim. Word2Vec имеет две основные архитектуры: Skip-gram и CBOW (Continuous Bag-of-Words). Skip-gram предсказывает контекстные слова по данному слову, а CBOW предсказывает слово по его контексту. Мы активно используем Gensim для обучения собственных моделей Word2Vec на больших корпусах текста, а также используем предобученные модели.

Сравнение моделей Word2Vec (Skip-gram vs CBOW) показывает, что Skip-gram обычно лучше справляется с редкими словами, а CBOW быстрее обучается. Выбор зависит от специфики нашей задачи и характеристик данных.

GloVe

GloVe (Global Vectors for Word Representation) – это еще один популярный метод создания векторных представлений, разработанный в Стэнфордском университете. В отличие от Word2Vec, который основан на локальном контексте, GloVe использует глобальную статистику со-встречаемости слов в корпусе. Он объединяет идеи методов, основанных на локальном окне, и методов, основанных на матричной факторизации.

Мы используем GloVe, особенно когда нам нужны высококачественные предобученные векторы для английского языка, так как доступно множество таких моделей, обученных на огромных корпусах (например, Common Crawl или Wikipedia).

FastText: Работа с Редкими Словами

FastText, разработанный Facebook AI, является расширением Word2Vec, которое решает проблему работы с редкими словами и словами, не входящими в словарь (out-of-vocabulary, OOV). FastText представляет слова как суммы векторов их n-грам символов. Это означает, что даже если слово не встречалось во время обучения, его вектор может быть составлен из векторов его символьных n-грамм, которые встречались. Это делает FastText особенно полезным для языков с богатой морфологией или для корпусов с большим количеством опечаток.

Мы часто выбираем FastText, когда имеем дело с редкими словами или когда нам нужно более надежное представление для морфологически сложных языков, поскольку он обеспечивает более устойчивые векторы.

Векторизация Предложений и Документов

Векторные представления слов великолепны, но что, если нам нужно получить вектор для целого предложения или документа? Нам нужны методы, которые могут агрегировать или создавать представления для больших текстовых блоков.

Doc2Vec (Gensim)

Doc2Vec (также известный как Paragraph Vectors) – это расширение Word2Vec, которое позволяет создавать векторные представления не только для слов, но и для целых документов (предложений, абзацев, статей). Он учится сопоставлять каждому документу уникальный вектор, который отражает его семантическое содержание. Мы используем Doc2Vec из библиотеки Gensim для представления целых документов, что особенно полезно для задач поиска сходных документов или их кластеризации.

Векторизация текста с использованием Doc2Vec позволяет нам сравнивать документы между собой, находить ближайшие по смыслу, что очень ценно, например, при разработке систем рекомендаций или обнаружения плагиата.

Sentence Transformers

С появлением трансформерных моделей появились и новые, более мощные способы векторизации предложений. Sentence Transformers – это фреймворк, который позволяет создавать плотные векторные представления предложений, которые улавливают их семантику. Он основан на предобученных моделях трансформеров (например, BERT) и дообучен таким образом, чтобы семантически похожие предложения имели близкие векторные представления.

Мы используем Sentence Transformers для задач, требующих высокой точности в сравнении предложений, таких как поиск семантически похожих вопросов в FAQ, кластеризация предложений или обнаружение дубликатов. Это гораздо более мощный подход, чем простое усреднение Word2Vec-векторов слов в предложении.

Векторизация с Учетом Контекста (Контекстное Встраивание)

Самые современные методы векторизации, такие как BERT и другие трансформерные модели, создают контекстные встраивания. Это означает, что векторное представление слова зависит от его контекста в предложении. Например, слово "банк" будет иметь разные векторы в предложениях "я иду в банк" (финансовое учреждение) и "берег реки – это банк" (географический объект). Это революционный подход, который позволяет машинам улавливать тончайшие семантические нюансы.

Мы активно применяем эти методы, используя предобученные трансформерные модели, для задач, где требуется глубокое понимание контекста, таких как вопросно-ответные системы или сложный анализ тональности с учетом сарказма.

Основные Задачи NLP: Разбираемся в Сути

После того как мы подготовили и численно представили текст, мы можем переходить к решению конкретных задач NLP. Эти задачи охватывают широкий спектр приложений, от извлечения именованных сущностей до анализа настроения текста, и составляют основу многих интеллектуальных систем. Мы постоянно работаем над этими задачами, используя различные алгоритмы и подходы, чтобы достичь наилучших результатов.

Каждая из этих задач имеет свои особенности и требует специфического подхода, но все они опираются на фундаментальные принципы предобработки и векторизации текста. Давайте погрузимся в мир основных задач NLP, которые мы успешно решаем.

Распознавание Именованных Сущностей (NER)

Распознавание именованных сущностей (Named Entity Recognition, NER) – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, организаций, географические названия, даты, время, денежные суммы и т.д. Это одна из ключевых задач в извлечении информации, поскольку она позволяет нам структурировать неструктурированный текст.

SpaCy для Быстрого NER

Для большинства наших проектов, где требуется быстрое и точное распознавание сущностей, мы используем SpaCy. Ее предобученные модели для NER очень эффективны и позволяют нам мгновенно извлекать такие сущности, как PERSON, ORG, GPE (геополитическая единица) и многие другие. SpaCy также позволяет нам легко дообучать или создавать собственные модели NER, если стандартные категории недостаточны для нашей задачи. Например, для анализа юридических документов мы можем обучить модель распознавать "статьи закона" или "номера дел".

CRF для Распознавания Сущностей

До появления глубокого обучения, Условные случайные поля (Conditional Random Fields, CRF) были одним из самых популярных алгоритмов для NER. CRF – это статистическая модель, которая хорошо подходит для задач последовательной разметки, где метка слова зависит не только от самого слова, но и от контекста (соседних слов). Мы до сих пор используем CRF для распознавания сущностей в нишевых задачах, где данных для обучения глубоких нейросетей недостаточно, или когда требуется более прозрачная модель.

Flair для Современного NER

Flair – это мощная библиотека для NLP, разработанная Humboldt University of Berlin. Она известна своими современными моделями NER, которые достигают передовых результатов, особенно благодаря использованию контекстных встраиваний символьного уровня. Flair позволяет нам достигать высокой точности, особенно на языках с богатой морфологией. Мы обращаемся к Flair, когда стандартные решения не дают нужной точности, и нам необходима "тяжелая артиллерия" для извлечения сущностей.

Разметка и Оценка NER-Моделей

Разработка эффективной NER-модели часто требует ручной разметки данных. Мы создаем собственные инструменты для автоматической разметки данных или используем специализированные платформы для разметки. После обучения модели критически важна ее оценка качества. Мы используем стандартные метрики, такие как F1-score, Precision и Recall, чтобы измерить, насколько хорошо наша модель распознает сущности. Precision показывает, сколько из предсказанных сущностей верны, Recall – сколько из всех истинных сущностей было найдено, а F1-score – это гармоническое среднее между Precision и Recall.

Эти метрики помогают нам понять сильные и слабые стороны наших моделей и направляют нас в процессе их улучшения. Мы постоянно стремимся к балансу между точностью и полнотой.

Анализ Тональности (Sentiment Analysis)

Анализ тональности (Sentiment Analysis), или анализ настроений, – это процесс определения эмоциональной окраски текста: является ли он позитивным, негативным или нейтральным. Эта задача имеет огромное значение для бизнеса, маркетинга, анализа социальных медиа и многих других областей.

VADER для Базового Анализа

Для базового анализа тональности, особенно в текстах из социальных сетей, мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner). Это лексический и основанный на правилах анализатор тональности, который специально обучен на данных из социальных сетей. Он очень хорошо справляется с сленгом, эмодзи и акронимами, что делает его отличным выбором для быстрого анализа тональности сообщений в социальных сетях (Twitter/Reddit).

VADER возвращает составную оценку тональности, которая учитывает как позитивные, так и негативные слова, а также усилители и ослабители. Это позволяет нам получить более нюансированный результат, чем просто "позитивный/негативный".

TextBlob для Простого Анализа

Как мы уже упоминали, TextBlob предлагает очень простой API для анализа тональности. Он возвращает две метрики: полярность (от -1.0 до +1.0, где -1.0 – негативно, +1.0 – позитивно) и субъективность (от 0.0 до 1.0, где 0.0 – объективно, 1.0 – субъективно). Для быстрых проверок или небольших проектов TextBlob вполне достаточен. Мы используем его, когда не требуется глубокое понимание контекста или когда ресурсы ограничены.

Анализ Тональности в Социальных Сетях, Отзывах (с учетом сарказма, эмодзи, сленга)

Более сложные сценарии требуют учета нюансов человеческого языка. Анализ тональности сообщений в социальных сетях, анализ текстов отзывов клиентов, анализ тональности финансовых новостей или отзывов о фильмах/ресторанах — все это задачи, которые мы регулярно решаем. Для этого мы часто используем более продвинутые модели на основе машинного обучения и глубокого обучения, способные улавливать сарказм, иронию, а также корректно интерпретировать эмодзи и сленг. Это требует создания специализированных обучающих наборов данных и тонкой настройки моделей.

Например, для определения тональности в социальных медиа с учетом сарказма, мы можем использовать трансформерные архитектуры, которые лучше понимают контекст и могут различать буквальное и переносное значение слов.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Эта цитата прекрасно отражает суть нашей работы в NLP – мы не просто анализируем слова, мы пытаемся понять культурный контекст, эмоции и намерения, которые за ними стоят. Это делает нашу работу такой увлекательной и значимой.

Классификация Текстов

Классификация текстов – это задача присвоения тексту одной или нескольких предопределенных категорий. Это одна из самых распространенных задач в NLP, применяемая во множестве областей, от фильтрации спама до категоризации новостей.

Scikit-learn (SVM, Наивный Байес)

Для классификации текстов мы часто начинаем с классических алгоритмов машинного обучения из библиотеки Scikit-learn. Алгоритмы, такие как Метод опорных векторов (SVM) и Наивный Байесовский классификатор, показывают отличные результаты на многих задачах, особенно когда данные хорошо размечены и объем не слишком велик. Мы используем их в сочетании с векторизаторами TF-IDF или CountVectorizer.

Например, для автоматической категоризации статей или новостей, SVM и Наивный Байес могут быть очень эффективны, обеспечивая при этом хорошую интерпретируемость результатов по сравнению с более сложными нейронными сетями.

Применение BERT для Задач Классификации

В последние годы трансформерные модели, такие как BERT, произвели революцию в классификации текстов. Мы используем BERT для задач, требующих глубокого контекстного понимания, так как он позволяет достигать передовых результатов. Fine-tuning (тонкая настройка) предобученной модели BERT на нашем специфическом наборе данных для классификации значительно повышает точность по сравнению с классическими методами.

BERT особенно эффективен для сложных задач, таких как анализ тональности финансовых новостей, где требуется различать тонкие семантические различия, или для автоматической категоризации статей по очень специфическим темам.

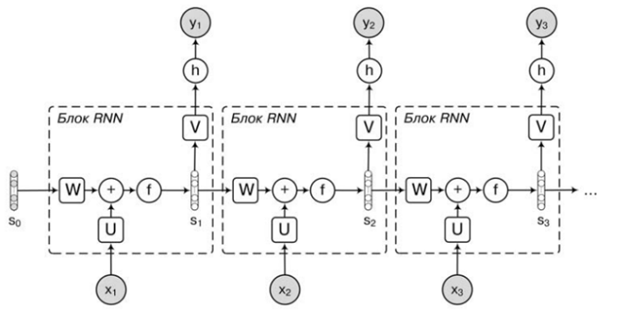

Keras/TensorFlow для Создания LSTM-Сетей

Для задач, где важна последовательность слов и их взаимосвязь, мы используем рекуррентные нейронные сети, такие как LSTM (Long Short-Term Memory). Библиотеки Keras и TensorFlow предоставляют нам удобные инструменты для создания и обучения таких сетей. LSTM-сети хорошо подходят для классификации длинных текстов, где обычные Feed-Forward сети могут упустить долгосрочные зависимости.

Мы применяем LSTM для задач, где важен порядок слов, например, для анализа стилистики текстов (авторский почерк) или для анализа временных рядов в текстовых данных, где события в тексте развиваются последовательно.

Классификация с PyTorch

Наряду с TensorFlow, PyTorch является еще одним мощным фреймворком для глубокого обучения, который мы активно используем. Он предоставляет большую гибкость и часто предпочтителен для исследований и прототипирования. Мы применяем классификацию текста с использованием PyTorch, создавая кастомные архитектуры нейронных сетей, включая BERT-подобные модели, для достижения максимальной производительности в сложных задачах.

Тематическое Моделирование

Тематическое моделирование – это метод машинного обучения без учителя, который позволяет обнаруживать "скрытые" темы в большом корпусе текстовых документов. Вместо того чтобы вручную маркировать документы, мы позволяем алгоритму самостоятельно выявлять группы слов, которые часто встречаются вместе, формируя таким образом темы.

LDA, LSI (Gensim)

Мы активно используем библиотеку Gensim для тематического моделирования, в частности, для реализации алгоритмов LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA – это вероятностная модель, которая предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это смесь слов. LSI, основанный на сингулярном разложении (SVD), обнаруживает латентные семантические структуры в тексте.

Эти методы позволяют нам анализировать текст для выявления скрытых тем в больших массивах данных, таких как клиентские отзывы, научные статьи или новостные ленты. Например, для анализа отзывов о продуктах по категориям мы можем использовать LDA, чтобы автоматически выделить темы, о которых говорят клиенты (например, "качество сборки", "время доставки", "цена").

NMF

Помимо LDA и LSI, мы также используем NMF (Non-negative Matrix Factorization) для тематического моделирования. NMF – это метод матричной факторизации, который разлагает матрицу "документ-слово" на две матрицы: "документ-тема" и "тема-слово". Он особенно хорош, когда мы хотим получить темы, которые легко интерпретировать, поскольку веса в матрицах неотрицательны.

Сравнение моделей тематического моделирования (LDA vs NMF) показывает, что NMF часто дает более четкие и разделимые темы, в то время как LDA лучше подходит для ситуаций, когда документ может принадлежать нескольким темам одновременно. Выбор между ними зависит от специфики данных и наших целей.

Суммаризация Текста

Суммаризация текста – это задача создания краткого и связного изложения более длинного документа или набора документов, сохраняя при этом ключевую информацию. Это бесценный инструмент для обработки больших объемов информации.

Экстрактивная и Абстрактивная Суммаризация

Мы различаем два основных подхода к суммаризации: экстрактивная и абстрактивная. Экстрактивная суммаризация выбирает наиболее важные предложения или фразы из исходного текста и объединяет их для создания резюме. Полученное резюме состоит из дословных фрагментов оригинала. Абстрактивная суммаризация, напротив, генерирует новые предложения, которые могут не присутствовать в исходном тексте, но передают его смысл, подобно тому, как человек пересказывает текст своими словами. Это более сложная задача, требующая глубокого понимания языка;

Сравнение моделей суммирования: экстрактивная и абстрактная показывает, что экстрактивные методы обычно проще в реализации и дают хорошие результаты, в то время как абстрактивные методы, хотя и более продвинутые, все еще сталкиваются с проблемами связности и точности.

TextRank для Извлечения Ключевых Предложений

Для экстрактивной суммаризации мы часто используем алгоритм TextRank (реализованный, например, в библиотеке sumy). TextRank – это алгоритм, основанный на графах, который определяет важность предложений в тексте, аналогично тому, как PageRank определяет важность веб-страниц. Он строит граф, где узлы – это предложения, а ребра показывают их сходство. Наиболее "важные" предложения (с высоким рейтингом) затем выбираются для создания резюме.

Мы используем TextRank для извлечения ключевых предложений и суммаризации, особенно когда нужно быстро получить краткое содержание длинной статьи или документа.

Использование Transformer-моделей для Суммаризации

Для абстрактивной суммаризации мы обращаемся к трансформерным моделям, особенно к моделям из семейства Hugging Face (например, T5, BART). Эти модели, обученные на огромных объемах данных, способны генерировать связные и осмысленные резюме. Мы используем их для задач, где требуется не просто выделить предложения, а перефразировать и создать новое, оригинальное изложение. Это особенно актуально для разработки системы суммаризации текста (Abstractive vs Extractive), где мы хотим получить более человекоподобное резюме.

Извлечение Ключевых Фраз и Слов

Извлечение ключевых фраз и слов – это процесс автоматической идентификации наиболее важных терминов или концепций в тексте. Это помогает нам быстро понять основное содержание документа.

RAKE для Извлечения Ключевых Слов

Для извлечения ключевых слов мы часто используем алгоритм RAKE (Rapid Automatic Keyword Extraction). RAKE – это неконтролируемый, основанный на фразах алгоритм, который определяет ключевые слова и фразы в тексте, анализируя частотность слов и их со-встречаемость. Он достаточно прост в реализации и дает хорошие результаты для многих типов текстов.

TextRank для Выделения Тем

Помимо суммаризации предложений, TextRank также может быть использован для выделения тем и извлечения ключевых фраз. Вместо предложений, узлами графа могут быть слова или фразы, и алгоритм определит наиболее важные из них. Мы используем этот подход, когда нам нужно быстро получить набор терминов, которые лучше всего описывают содержание документа.

Эра Трансформеров: Новый Уровень Понимания

Появление архитектуры трансформеров и таких моделей, как BERT и GPT, ознаменовало собой настоящую революцию в NLP. Эти модели, основанные на механизме внимания, способны улавливать долгосрочные зависимости в тексте и понимать контекст на беспрецедентном уровне. Мы активно используем эти технологии для решения самых сложных задач.

Трансформеры изменили правила игры, позволив нам создавать модели, которые не просто обрабатывают слова, а действительно начинают "понимать" язык. Это открывает двери для создания гораздо более интеллектуальных и адаптивных систем.

Hugging Face и Трансформерные Архитектуры

Мы не можем говорить о трансформерах без упоминания Hugging Face. Эта компания создала невероятную экосистему, включающую библиотеку Transformers, которая предоставляет доступ к сотням предобученных моделей (BERT, GPT, RoBERTa, T5 и многим другим) и инструментам для их использования. Hugging Face стал нашим основным инструментом для работы с трансформерами.

BERT, GPT, T5 для Сложных Задач

Модели, такие как BERT (Bidirectional Encoder Representations from Transformers), GPT (Generative Pre-trained Transformer) и T5 (Text-to-Text Transfer Transformer), являются краеугольными камнями современного NLP. BERT отлично подходит для задач понимания языка (например, классификация, NER, вопросно-ответные системы), в то время как GPT и T5 превосходны в задачах генерации текста.

Мы используем эти модели для сложных задач NLP, где требуется глубокое контекстное понимание и высокая точность. Например, BERT для применения BERT для задачи NER или GPT для использования Transformer-моделей для генерации текста (GPT).

Тонкая Настройка (Fine-tuning) Предобученных Моделей

Одним из ключевых преимуществ трансформеров является возможность тонкой настройки (Fine-tuning) предварительно обученных моделей на наших собственных данных; Это позволяет нам адаптировать мощные общие языковые модели к конкретным задачам и доменным областям, достигая при этом высокой производительности с относительно небольшим объемом размеченных данных. Мы постоянно проводим тонкую настройку для улучшения наших моделей в задачах классификации, NER, суммаризации и многих других.

Применение Трансформеров

Трансформеры открыли двери для решения задач, которые ранее казались недостижимыми, или требовали огромных усилий.

Генерация Текста и Диалогов

С помощью моделей GPT и других генеративных трансформеров, мы можем создавать системы для генерации текста, которые могут писать статьи, генерировать креативные истории, создавать рекламные тексты или даже генерировать код. Мы также используем их для генерации диалогов, что является основой для создания более естественных и интерактивных чат-ботов.

Машинный Перевод

Трансформеры значительно улучшили качество машинного перевода. Мы используем модели, такие как Google’s T5 или mBART, для создания высококачественных систем перевода, способных работать с множеством языков. Это включает в себя разработку систем машинного перевода на Python и адаптацию их для перевода узкоспециализированных текстов, таких как юридические или медицинские документы.

Распознавание Эмоций

Понимание эмоционального состояния говорящего или пишущего является ключевым для многих приложений. Использование трансформерных архитектур для распознавания эмоций позволяет нам точно определять широкий спектр эмоций (гнев, радость, грусть, страх и т.д.) в тексте, что гораздо сложнее, чем просто анализ тональности.

Анализ Кода

Интересной и новой областью применения трансформеров является анализ кода. Мы исследуем возможности использования этих моделей для таких задач, как сжатие кода, генерация документации, обнаружение ошибок или даже генерация кода по текстовому описанию. Это открывает новые горизонты на стыке NLP и разработки программного обеспечения.

Практические Приложения и Продвинутые Техники

Наш опыт простирается далеко за пределы базовых задач. Мы активно применяем NLP для создания реальных, работающих систем, которые решают сложные проблемы в различных отраслях. Это требует не только глубокого понимания алгоритмов, но и умения интегрировать их в комплексные решения.

Мы постоянно исследуем новые методы и инструменты, чтобы расширить границы возможного и создавать более интеллектуальные, эффективные и удобные для пользователя приложения.

Построение Интеллектуальных Систем

Практическое применение NLP часто выражается в создании сложных интеллектуальных систем.

Вопросно-ответные Системы (QA)

Разработка систем вопросно-ответных систем (QA) – это одна из самых захватывающих задач в NLP. Цель QA-системы – найти точный ответ на вопрос пользователя в заданном корпусе документов. Мы используем трансформерные модели (например, на основе BERT) для извлечения ответов из текста, что позволяет нам создавать очень точные и эффективные системы.

Чат-боты (Rasa framework)

Мы активно занимаемся разработкой чат-ботов на Python. Для создания сложных, контекстно-зависимых ботов, мы используем фреймворк Rasa. Rasa предоставляет полный стек для разработки разговорных ИИ, включая NLU (Natural Language Understanding) для понимания намерений пользователя и Core для управления диалогом. Это позволяет нам создавать ботов, которые не просто отвечают на вопросы, но и ведут осмысленный диалог, запоминают контекст и выполняют сложные действия.

Системы Автоматической Категоризации и Тегирования

Для управления большим объемом контента мы разрабатываем системы автоматической категоризации статей и автоматического тегирования контента. Эти системы используют алгоритмы классификации текста для автоматического присвоения категориям и тегам новым документам, что значительно упрощает их организацию и поиск.

Системы Обнаружения Плагиата

Разработка систем обнаружения плагиата – еще одна важная задача, которую мы решаем с помощью NLP. Мы используем методы измерения сходства документов (например, на основе Doc2Vec или Textdistance) для сравнения текстов и выявления потенциальных случаев плагиата.

Системы Проверки Фактов (Fact-Checking)

В мире дезинформации разработка инструмента для проверки фактов (Fact-Checking) становится крайне актуальной. Мы исследуем подходы, которые используют NLP для сопоставления утверждений в тексте с надежными источниками информации, помогая выявлять ложные или недостоверные данные.

Работа с Разнообразными Текстовыми Источниками

Текст может поступать из самых разных источников, и мы должны быть готовы работать с любым из них.

Веб-скрейпинг Текста (Beautiful Soup)

Значительная часть текстовых данных находится в интернете; Мы используем библиотеку Beautiful Soup для веб-скрейпинга текста с веб-страниц. Она позволяет нам парсить HTML и XML документы, извлекая чистый текстовый контент для дальнейшей обработки. Это наш первый шаг при работе с данными из открытых источников;

Извлечение Текста из PDF (PyMuPDF)

Многие важные документы хранятся в формате PDF. Для извлечения текста из PDF мы используем библиотеку PyMuPDF (или Fitz). Она позволяет нам программно открывать, читать и извлекать текст, изображения и метаданные из PDF-файлов, что критически важно для анализа юридических, финансовых или медицинских документов.

Анализ Лог-файлов

Лог-файлы серверов и приложений содержат ценную информацию о работе систем. Мы применяем NLP для анализа лог-файлов, выявления аномалий, ошибок, паттернов использования и других важных данных, которые могут помочь в мониторинге и оптимизации систем.

Анализ Юридических и Медицинских Документов

Специализированные тексты, такие как юридические контракты и медицинские записи, представляют собой особую сложность из-за их специфической терминологии и структуры. Мы разрабатываем кастомные NLP-решения для анализа юридических документов (извлечение дат, условий, сторон) и анализа текста в медицинских записях (извлечение диагнозов, симптомов, процедур), что требует глубоких доменных знаний и создания специализированных словарей и моделей.

Мультиязычный NLP

Мир не ограничивается английским языком. Мы активно работаем с текстами на разных языках, что требует особых подходов и инструментов.

Обработка Многоязычных Текстовых Корпусов

Обработка многоязычных текстовых корпусов – это сложная задача, требующая учета лингвистических особенностей каждого языка. Мы используем универсальные модели трансформеров (например, mBERT, XLM-R) и специализированные библиотеки для работы с различными языками.

Использование Polyglot и Stanza для Языков с Богатой Морфологией

Для языков с богатой морфологией, таких как русский, арабский или финский, стандартные методы могут быть недостаточно эффективны. Мы используем Polyglot, которая поддерживает множество языков для различных задач NLP, и Stanza, которая предоставляет высококачественные модели для русского языка и других языков с комплексной морфологией, включая морфологический анализ и синтаксический парсинг.

Дополнительные Инструменты и Методы

Наш арсенал инструментов постоянно пополняется, и мы используем множество дополнительных техник для решения специфических задач.

Синтаксический Парсинг (SpaCy)

Синтаксический парсинг – это процесс анализа грамматической структуры предложения. SpaCy предоставляет нам отличные инструменты для реализации синтаксического парсинга и анализа зависимостей между словами в предложении. Это помогает нам понимать, кто что делает, какой объект на кого действует и другие структурные отношения, что критично для извлечения связей между сущностями.

Анализ Стилистики Текстов (Авторский Почерк)

Анализ стилистики текстов (авторский почерк) – это задача идентификации автора текста на основе его уникальных языковых особенностей. Мы используем различные метрики (лексическое богатство, частотность функциональных слов, длина предложений) и алгоритмы машинного обучения для разработки системы для определения авторства текста.

Создание Словарей и Тезаурусов

Для многих доменных задач нам необходимо создание словарей и тезаурусов. Мы разрабатываем инструменты для автоматического извлечения терминов и их отношений, что значительно улучшает качество специализированных NLP-моделей.

Измерение Сходства Строк и Документов (Jellyfish, Textdistance)

Для задач, таких как поиск дубликатов, исправление опечаток или обнаружение плагиата, нам необходимо измерять сходство между строками или документами. Мы используем библиотеки, такие как Jellyfish для сравнения строк (расстояние Левенштейна, Джаро-Винклера) и Textdistance для измерения сходства документов и строк. Это позволяет нам эффективно находить похожие элементы в больших текстовых массивах.

Визуализация Текстовых Данных (Word Clouds, Heatmaps)

Инструменты для визуализации текстовых данных крайне важны для понимания и интерпретации результатов NLP. Мы используем Word Clouds для отображения наиболее часто встречающихся слов и Heatmaps для визуализации матриц сходства или весов слов, что помогает нам быстро получить инсайты из наших данных.

Обработка Текста в Режиме Реального Времени (Streaming NLP)

Для некоторых приложений, таких как мониторинг социальных сетей или анализ чатов, требуется обработка текста в режиме реального времени (Streaming NLP). Мы разрабатываем конвейеры данных, которые могут обрабатывать текстовые потоки с минимальной задержкой, используя оптимизированные модели и эффективные алгоритмы.

GPU-ускорение в NLP

Для работы с большими моделями трансформеров и огромными объемами данных, использование GPU-ускорения становится необходимостью. Мы оптимизируем наши пайплайны и модели для работы на GPU, используя такие библиотеки, как PyTorch или TensorFlow, что значительно сокращает время обучения и инференса.

Вызовы и Перспективы: Куда Движется NLP?

Несмотря на все достигнутые успехи, мир NLP не лишен вызовов. Мы постоянно сталкиваемся с проблемами, которые требуют новых подходов и инновационных решений.

Одной из главных проблем является работа с неполными и ошибочными данными. Реальный мир полон опечаток, неграмматичных предложений, неформального языка и сленга. Создание робастных моделей, способных справляться с этим "шумом", остается актуальной задачей. Кроме того, анализ тональности с учетом сарказма, иронии и сложных эмоциональных нюансов все еще требует значительных усилий.

Важным вызовом является также этичность и предвзятость в моделях. Модели, обученные на больших массивах данных, могут унаследовать и усиливать существующие в данных социальные стереотипы и предрассудки. Мы активно работаем над методами выявления и снижения предвзятости, чтобы наши NLP-системы были справедливыми и недискриминационными.

Будущее NLP обещает быть еще более захватывающим. Мы видим его интеграцию с другими областями ИИ, такими как компьютерное зрение и робототехника, что приведет к созданию по-настоящему мультимодальных интеллектуальных систем. Развитие более "объяснимых" моделей (Explainable AI), которые могут не только давать ответы, но и объяснять логику своих решений, также является приоритетом. Мы уверены, что Python останется краеугольным камнем в этом развитии, предоставляя гибкость и мощь, необходимые для воплощения самых смелых идей.

Мы прошли долгий путь от простейшей токенизации до сложных трансформерных архитектур, способных генерировать осмысленные тексты и отвечать на каверзные вопросы. Обработка естественного языка с Python — это не просто набор инструментов, это философия, которая позволяет нам заглянуть в самый центр человеческого общения, понять его структуру, смысл и эмоции. Это область, которая постоянно развивается, предлагая новые вызовы и невероятные возможности для тех, кто готов погрузиться в нее с головой.

Наша цель как блогеров и практиков — вдохновлять и делиться знаниями, чтобы каждый из вас мог найти свой путь в этом удивительном мире. Мы надеемся, что эта статья стала для вас не только исчерпывающим руководством, но и источником вдохновения для новых проектов и открытий. Помните: человеческий язык — это бесценный ресурс, и мы только начинаем учиться его по-настоящему разгадывать. Продолжайте экспериментировать, учиться и творить — будущее NLP в ваших руках!

Подробнее

| Основы NLP Python | Токенизация Стемминг Лемматизация | Векторизация текста Word2Vec | Распознавание сущностей NER SpaCy | Анализ тональности Sentiment Analysis |

| Тематическое моделирование LDA | Трансформеры Hugging Face | Разработка чат-ботов Rasa | Машинный перевод Python | Анализ больших текстовых данных |