- Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

- Первые Шаги: Основы Предобработки и Фундаментальные Библиотеки

- NLTK: Наш Старый Добрый Друг для Базовых Операций

- spaCy: Скорость и Производительность для Промышленного NLP

- Регулярные Выражения (re): Наш Неизменный Помощник в Очистке Текста

- Как Компьютер "Понимает" Слова: Векторизация и Встраивания

- Классические Векторизаторы: CountVectorizer и TfidfVectorizer

- Word Embeddings: От Слов к Смыслу с Word2Vec и GloVe

- От Слов к Документам: Doc2Vec и Sentence Transformers

- Сердце NLP: Ключевые Задачи и Их Решение

- Распознавание Именованных Сущностей (NER): Ищем Важное

- Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

- Тематическое Моделирование (Topic Modeling): Находим Скрытые Темы

- Классификация Текстов: Автоматическая Категоризация

- Продвинутые Методы и Современные Инструменты

- Трансформеры (Hugging Face): Новый Уровень Понимания Языка

- Создание Нейросетей NLP с PyTorch/TensorFlow

- Дополнительные Инструменты и Библиотеки: Наш Арсенал

- Прикладные Аспекты и Разработка Решений

- Анализ и Моделирование: От Отзывов до Юридических Документов

- Разработка Собственных Инструментов и Систем

- Вызовы и Перспективы: Куда Движется NLP

Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

Привет‚ дорогие читатели и коллеги-энтузиасты больших данных! Сегодня мы приглашаем вас в увлекательное путешествие по безграничным просторам обработки естественного языка‚ или NLP‚ как принято называть его в наших кругах. Это область‚ которая позволяет компьютерам не просто видеть буквы и слова‚ а понимать смысл‚ контекст и даже эмоции‚ скрывающиеся за ними. Звучит как научная фантастика? Возможно‚ но мы уверяем вас‚ что это уже реальность‚ и Python является нашим верным проводником в этом захватывающем мире.

За годы наших экспериментов и проектов мы убедились‚ что NLP — это не просто набор алгоритмов‚ а целое искусство‚ требующее как глубоких технических знаний‚ так и интуитивного понимания языка. Мы видели‚ как компании трансформируют свой бизнес‚ анализируя отзывы клиентов‚ как исследователи открывают новые закономерности в огромных массивах текстов‚ и как чат-боты становятся практически неотличимыми от человека. Все это благодаря мощным инструментам и библиотекам‚ доступным в экосистеме Python. Давайте же вместе погрузимся в этот мир и разберем‚ как мы используем эти инструменты для решения самых амбициозных задач.

Первые Шаги: Основы Предобработки и Фундаментальные Библиотеки

Прежде чем мы сможем заставить компьютер "понять" текст‚ нам нужно его подготовить. Представьте‚ что вы хотите прочитать старую‚ пыльную книгу. Сначала вы протрете ее от пыли‚ возможно‚ склеите порванные страницы. Точно так же мы поступаем с текстом: очищаем его от "шума" и приводим к стандартизированному виду. Этот этап‚ известный как предобработка текста‚ является краеугольным камнем любого NLP-проекта‚ и мы всегда уделяем ему особое внимание.

Наш опыт показывает‚ что без качественной предобработки даже самые продвинутые модели будут работать неэффективно. Мы начинаем с базовых‚ но критически важных шагов‚ таких как токенизация‚ стемминг и лемматизация. Для этих целей мы чаще всего обращаемся к проверенным временем библиотекам‚ которые стали de facto стандартами в мире Python NLP.

NLTK: Наш Старый Добрый Друг для Базовых Операций

Библиотека NLTK (Natural Language Toolkit) — это наш первый помощник‚ когда речь заходит о фундаментальных задачах NLP. Мы воспринимаем ее как швейцарский нож для работы с текстом. Она предоставляет огромное количество функций для токенизации‚ стемминга‚ лемматизации‚ POS-теггинга (разметки частей речи) и многого другого. Ее модульная структура позволяет нам легко выбирать и комбинировать нужные компоненты.

Например‚ для токенизации‚ то есть разбиения текста на отдельные слова или предложения‚ мы используем NLTK‚ чтобы получить структурированный набор данных. После этого мы можем применить стемминг‚ который отсекает суффиксы и префиксы‚ приводя слова к их корневой форме (например‚ "running"‚ "ran"‚ "runs" превращаются в "run"). Хотя стемминг иногда приводит к созданию несуществующих слов‚ он отлично подходит для задач‚ где важна скорость и не требуется идеальная лингвистическая точность. Когда же нам нужна максимальная точность и полноценные словарные формы слов‚ мы переходим к лемматизации‚ которая‚ в отличие от стемминга‚ использует словарь и морфологический анализ для приведения слова к его базовой форме (лемме). Мы обнаружили‚ что для большинства наших проектов лемматизация дает более качественные результаты‚ особенно для русского языка с его богатой морфологией.

spaCy: Скорость и Производительность для Промышленного NLP

Если NLTK – это наша база‚ то spaCy – это высокопроизводительный двигатель для большинства наших промышленных проектов. Мы ценим spaCy за его невероятную скорость‚ эффективность и готовность к работе в продакшене. Он поставляется с предварительно обученными моделями для различных языков‚ что значительно упрощает такие задачи‚ как распознавание именованных сущностей (NER)‚ синтаксический парсинг и POS-теггинг.

Одной из наших любимых функций spaCy является NER. С его помощью мы можем автоматически извлекать из текста имена людей‚ названия организаций‚ географические объекты‚ даты и многое другое. Это невероятно полезно для структурирования неструктурированных данных‚ например‚ для анализа новостных статей или юридических документов. Мы применяли spaCy для быстрого NER в проектах‚ где требовалось обрабатывать огромные объемы текста в кратчайшие сроки‚ и он ни разу нас не подвел. Его способность выполнять синтаксический парсинг также позволяет нам понять грамматическую структуру предложений‚ что критически важно для более сложных задач‚ таких как вопросно-ответные системы.

Регулярные Выражения (re): Наш Неизменный Помощник в Очистке Текста

Помимо специализированных библиотек‚ мы активно используем модуль re в Python для работы с регулярными выражениями. Это универсальный инструмент для поиска и замены паттернов в тексте. Хотя и может показаться сложным на первый взгляд‚ освоив его‚ мы получаем огромную гибкость в очистке данных. Регулярные выражения позволяют нам удалять HTML-теги‚ пунктуацию‚ числа‚ ссылки‚ эмодзи или любые другие нежелательные символы‚ которые могут загрязнять наши данные и мешать анализу.

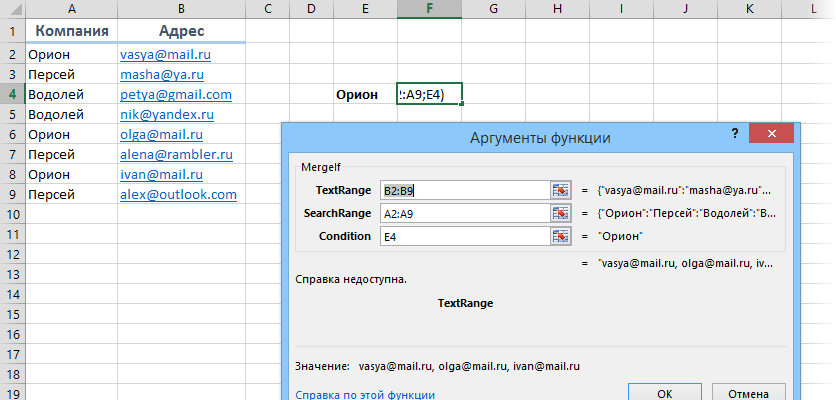

Например‚ если нам нужно очистить текст от всех символов‚ кроме букв‚ или извлечь конкретные паттерны‚ такие как номера телефонов или адреса электронной почты‚ регулярные выражения приходят на помощь. Мы часто создаем собственные "фильтры" на основе re для специфических задач предобработки‚ что позволяет нам добиться максимальной чистоты и релевантности текстовых данных перед тем‚ как передать их более сложным моделям.

Как Компьютер "Понимает" Слова: Векторизация и Встраивания

Текст‚ каким мы его читаем‚ состоит из букв и слов; Но для компьютера это просто последовательность символов. Чтобы машина могла работать с текстом‚ его нужно преобразовать в числовой формат. Этот процесс называется векторизацией или встраиванием (embeddings). Мы всегда ищем наилучший способ представить текст в виде векторов‚ поскольку от этого напрямую зависит качество работы последующих алгоритмов машинного обучения.

Классические Векторизаторы: CountVectorizer и TfidfVectorizer

Наш путь в мир векторизации часто начинается с классических методов‚ таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. Эти инструменты создают числовое представление текста на основе частотности слов.

- CountVectorizer просто подсчитывает‚ сколько раз каждое слово встречается в документе. В результате мы получаем матрицу‚ где строки – это документы‚ а столбцы – уникальные слова в нашем корпусе текста‚ а значения – количество вхождений. Это простой‚ но эффективный способ‚ особенно для задач‚ где важна абсолютная частотность слов.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency) идет дальше‚ учитывая не только частотность слова в документе‚ но и его редкость во всем корпусе. Мы находим этот метод более мощным‚ так как он присваивает больший вес словам‚ которые часто встречаются в конкретном документе‚ но редки в других‚ тем самым выделяя наиболее релевантные термины. Это особенно полезно для извлечения ключевых фраз и тематического моделирования.

Мы часто разрабатываем собственные векторизаторы‚ комбинируя эти подходы с дополнительными этапами предобработки‚ такими как удаление стоп-слов или n-грамм‚ чтобы лучше адаптировать их под специфику нашей задачи. Это позволяет нам создавать более информативные и менее "шумные" векторные представления.

Word Embeddings: От Слов к Смыслу с Word2Vec и GloVe

Векторизаторы на основе частотности имеют свои ограничения; они не учитывают семантическое сходство слов. То есть‚ слова "король" и "королева" будут считаться столь же разными‚ как "король" и "банан". Здесь на помощь приходят Word Embeddings – распределенные представления слов‚ которые отображают слова в многомерное векторное пространство таким образом‚ что слова со схожим значением имеют близкие векторы. Мы используем библиотеку Gensim для работы с такими моделями‚ как Word2Vec и GloVe.

Word2Vec‚ разработанный Google‚ позволяет нам обучать модели‚ которые предсказывают окружающие слова (Skip-gram) или слово на основе его контекста (CBOW). Мы обнаружили‚ что это приводит к удивительным результатам‚ где векторные операции (например‚ "король" ⎯ "мужчина" + "женщина" ≈ "королева") действительно работают. GloVe (Global Vectors for Word Representation) – это еще один популярный метод‚ который сочетает в себе статистические подходы с предсказательными моделями. Мы часто сравниваем эти модели‚ чтобы выбрать наиболее подходящую для конкретной задачи‚ будь то анализ тональности или тематическое моделирование.

От Слов к Документам: Doc2Vec и Sentence Transformers

Когда нам нужно представить не отдельные слова‚ а целые предложения или документы в виде векторов‚ мы обращаемся к Doc2Vec (расширение Word2Vec) или к Sentence Transformers. Doc2Vec позволяет нам получить векторное представление для всего документа‚ сохраняя при этом информацию о смысле. Это очень полезно для поиска похожих документов или для классификации больших текстовых блоков. Sentence Transformers‚ в свою очередь‚ предоставляют высококачественные векторные представления предложений‚ что значительно упрощает задачи сравнения предложений‚ поиска семантически похожих текстов и кластеризации.

Мы активно используем эти методы для векторизации предложений и документов‚ что является ключевым шагом во многих наших проектах‚ от систем рекомендаций до анализа отзывов клиентов. Чем лучше мы можем численно представить текст‚ тем точнее будут наши аналитические модели.

Сердце NLP: Ключевые Задачи и Их Решение

После того как текст очищен и преобразован в числовой формат‚ мы можем приступить к решению конкретных задач NLP. Диапазон этих задач огромен‚ от определения настроения текста до автоматического перевода. Мы постоянно экспериментируем с различными подходами‚ чтобы найти наиболее эффективные решения.

Распознавание Именованных Сущностей (NER): Ищем Важное

NER – это как детектив‚ который ищет важные улики в тексте. Как мы уже упоминали‚ spaCy – отличный инструмент для этого. Однако для более сложных или специализированных задач мы используем другие подходы. Например‚ для языков с богатой морфологией или для специфических доменных сущностей (таких как медицинские термины или юридические статьи)‚ мы можем использовать библиотеку Stanza‚ разработанную Стэнфордским университетом. Она предоставляет более глубокий лингвистический анализ и предварительно обученные модели для множества языков.

Также мы применяем условные случайные поля (CRF) для распознавания сущностей‚ когда требуется высокая точность и возможность тонкой настройки модели под очень специфические наборы данных. А для самых современных и производительных решений мы обращаемся к библиотеке Flair‚ которая позволяет строить state-of-the-art NER-модели на основе глубоких нейронных сетей и контекстных встраиваний.

Оценка качества NER-моделей (F1-score‚ Precision‚ Recall) является для нас критически важным этапом. Мы тщательно анализируем метрики‚ чтобы убедиться‚ что наши модели не только быстро работают‚ но и выдают максимально точные результаты‚ минимизируя как ложноположительные‚ так и ложноотрицательные срабатывания.

Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

Понимание настроения‚ выраженного в тексте‚ является одной из самых востребованных задач NLP. Будь то отзывы клиентов‚ сообщения в социальных сетях или финансовые новости‚ анализ тональности позволяет нам оценить эмоциональную окраску текста. Мы используем несколько подходов для этого:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Отличный инструмент для анализа тональности‚ особенно хорошо работает с текстами из социальных сетей‚ поскольку он обучен на данных‚ содержащих эмодзи и сленг. Он быстро и эффективно определяет‚ является ли текст позитивным‚ негативным или нейтральным.

-

TextBlob: Это простая в использовании библиотека‚ которая предоставляет функционал для анализа тональности‚ а также для POS-теггинга и N-грамм. Мы часто используем ее для быстрого прототипирования и простых задач. Однако мы также осознаем ее ограничения и в более сложных сценариях прибегаем к другим решениям.

- Трансформеры (Hugging Face): Для более глубокого и контекстно-зависимого анализа тональности мы обращаемся к трансформерным моделям из библиотеки Hugging Face. Эти модели‚ такие как BERT‚ способны улавливать тонкие нюансы настроения‚ включая сарказм‚ что делает их незаменимыми для анализа тональности сообщений в социальных сетях‚ где язык часто бывает неоднозначным.

Анализ тональности отзывов клиентов‚ постов в социальных сетях (Twitter/Reddit)‚ финансовых новостей – это лишь малая часть того‚ где мы успешно применяем эти методы. Мы даже работаем над инструментами для анализа тональности в медицинских записях‚ где контекст имеет решающее значение.

Тематическое Моделирование (Topic Modeling): Находим Скрытые Темы

Когда у нас есть огромный объем текстовых данных‚ и мы хотим понять‚ о чем они говорят‚ тематическое моделирование становится нашим лучшим другом. Оно позволяет нам автоматически обнаруживать скрытые темы в коллекции документов. Мы активно используем библиотеку Gensim для этих целей‚ особенно для реализации моделей LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

LDA – это вероятностная модель‚ которая предполагает‚ что каждый документ представляет собой смесь нескольких тем‚ а каждая тема – это смесь слов. LSI‚ в свою очередь‚ использует сингулярное разложение для выявления латентных семантических связей между словами и документами. Мы регулярно сравниваем эти модели‚ а также NMF (Non-negative Matrix Factorization)‚ чтобы выбрать ту‚ которая лучше всего раскрывает темы в конкретном наборе данных‚ будь то отзывы о продуктах или статьи в блогах.

"Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут." – Рита Мэй Браун

Эта цитата прекрасно отражает нашу философию. Работая с языком‚ мы не просто анализируем данные; мы погружаемся в культуру‚ историю и мысли людей. Тематическое моделирование помогает нам увидеть эти "дорожные карты" в огромных массивах текста‚ выявить неочевидные связи и тенденции.

Классификация Текстов: Автоматическая Категоризация

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Мы применяем Scikit-learn для классификации текстов‚ используя такие алгоритмы‚ как SVM (Support Vector Machines)‚ наивный байесовский классификатор‚ логистическая регрессия и другие. Это позволяет нам автоматически категоризировать статьи‚ фильтровать спам‚ маршрутизировать запросы клиентов или определять жанр текста.

Для более сложных задач‚ где требуеться учет контекста и глубокое понимание языка‚ мы переходим к нейронным сетям. Мы используем PyTorch/TensorFlow для создания LSTM-сетей (Long Short-Term Memory) или сверточных нейронных сетей (CNN)‚ которые отлично справляются с последовательными данными‚ такими как текст. А с появлением трансформерных моделей‚ таких как BERT‚ мы получили еще более мощные инструменты для классификации‚ способные учитывать контекст каждого слова в предложении‚ значительно повышая точность.

Продвинутые Методы и Современные Инструменты

Мир NLP постоянно развивается‚ и мы стараемся идти в ногу со временем‚ осваивая новые библиотеки и архитектуры. То‚ что еще вчера казалось вершиной технологий‚ сегодня уже может быть частью стандартного пайплайна.

Трансформеры (Hugging Face): Новый Уровень Понимания Языка

Трансформерные архитектуры‚ такие как BERT‚ GPT‚ RoBERTa и другие‚ произвели настоящую революцию в NLP. Благодаря библиотеке Hugging Face Transformers мы можем легко использовать эти предварительно обученные модели для широкого спектра задач‚ от классификации и NER до генерации текста и машинного перевода. Мы обнаружили‚ что тонкая настройка (fine-tuning) этих моделей на наших собственных данных позволяет достигать результатов‚ которые были немыслимы всего несколько лет назад. Они способны улавливать контекст каждого слова‚ что критически важно для понимания сложных текстов‚ сарказма‚ иронии и других тонкостей человеческой речи.

Мы используем трансформеры для задач классификации‚ суммаризации текста (как экстрактивной‚ так и абстрактивной)‚ машинного перевода‚ генерации текста (например‚ для чат-ботов или автозаполнения)‚ а также для создания систем вопросно-ответных систем (QA)‚ которые могут находить точные ответы на вопросы в больших массивах документов. Это как иметь под рукой универсальный "мозг"‚ способный мыслить на языке.

Создание Нейросетей NLP с PyTorch/TensorFlow

Хотя готовые трансформеры невероятно мощны‚ иногда нам нужно создавать собственные архитектуры нейронных сетей или глубоко кастомизировать существующие. Для этого мы активно используем фреймворки PyTorch и TensorFlow. Они предоставляют гибкость для экспериментов с различными слоями‚ функциями активации и оптимизаторами.

Мы строим на них LSTM-сети для анализа последовательностей‚ используем их для создания сложных моделей для выявления связей между сущностями в тексте‚ для разработки систем суммаризации‚ а также для работы с нелатинскими алфавитами‚ где стандартные модели могут требовать доработки. Возможность работать на низком уровне с этими фреймворками дает нам полный контроль над процессом обучения и позволяет решать по-настоящему уникальные задачи.

Дополнительные Инструменты и Библиотеки: Наш Арсенал

Помимо основных библиотек‚ в нашем арсенале есть множество других специализированных инструментов‚ которые помогают нам решать конкретные задачи:

| Библиотека/Инструмент | Основное Назначение | Наши Кейсы Использования |

|---|---|---|

| Gensim | Тематическое моделирование (LDA‚ LSI)‚ Word Embeddings (Word2Vec‚ Doc2Vec) | Анализ больших текстовых массивов‚ поиск скрытых тем в отзывах и документах. |

| TextBlob | Простой NLP (тональность‚ POS-теггинг‚ N-граммы‚ перевод) | Быстрый анализ тональности‚ определение языка‚ прототипирование. |

| Beautiful Soup | Веб-скрейпинг‚ извлечение текста из HTML | Сбор данных с веб-сайтов‚ очистка текста от HTML-тегов. |

| PyMuPDF | Извлечение текста из PDF-документов | Автоматическая обработка юридических документов‚ отчетов. |

| Polyglot | Многоязычный NLP (NER‚ тональность‚ определение языка) | Обработка многоязычных текстовых корпусов‚ анализ редких языков. |

| Textacy | Высокоуровневый NLP (извлечение ключевых слов‚ резюмирование‚ анализ связей) | Извлечение информации‚ анализ зависимостей‚ работа с неструктурированным текстом. |

| RASA Framework | Разработка чат-ботов и диалоговых систем | Создание интеллектуальных чат-ботов для поддержки клиентов. |

| Jellyfish | Сравнение строк‚ вычисление расстояний (Левенштейна‚ Джаро-Винклера) | Поиск дубликатов‚ исправление опечаток‚ сравнение имен; |

| Sweetviz | Автоматический EDA (Exploratory Data Analysis) | Быстрый анализ текстовых данных‚ визуализация распределений. |

| TextRank | Извлечение ключевых предложений и слов‚ суммаризация | Автоматическое резюмирование‚ выделение главных тем. |

| RAKE (Rapid Automatic Keyword Extraction) | Извлечение ключевых слов | Быстрое определение наиболее важных терминов в документе. |

Прикладные Аспекты и Разработка Решений

Наш опыт показывает‚ что чистые алгоритмы – это лишь часть успеха. Настоящая ценность NLP проявляется‚ когда мы применяем эти инструменты для решения конкретных‚ реальных задач. Мы постоянно работаем над разработкой систем‚ которые автоматизируют рутинные процессы и предоставляют ценные инсайты.

Анализ и Моделирование: От Отзывов до Юридических Документов

Мы регулярно проводим глубокий анализ текстов из самых разных источников. Например‚ анализ отзывов клиентов позволяет нам выявлять болевые точки продукта‚ понимать‚ что нравится пользователям‚ и даже предсказывать отток. Мы разбиваем отзывы по категориям‚ анализируем их тональность и выявляем скрытые темы с помощью тематического моделирования.

В области юридических документов мы используем Python для извлечения ключевых дат‚ сущностей (имен сторон‚ названий компаний)‚ условий контрактов. Это значительно ускоряет процесс анализа и снижает вероятность человеческих ошибок. Мы также разрабатываем системы обнаружения плагиата‚ которые сравнивают документы и выявляют совпадения с помощью метрик сходства текста‚ таких как TextDistance.

Обработка больших текстовых массивов (Big Data NLP) требует оптимизации и использования GPU-ускорения для обучения моделей. Мы постоянно ищем способы масштабировать наши решения‚ чтобы справляться с петабайтами текстовых данных‚ будь то лог-файлы или архивы веб-страниц.

Разработка Собственных Инструментов и Систем

Часто готовых решений оказывается недостаточно‚ и тогда мы приступаем к разработке собственных инструментов:

- Системы суммаризации текста: Мы работаем над созданием как экстрактивных (выбирают ключевые предложения из исходного текста)‚ так и абстрактивных (генерируют новые предложения‚ передающие суть) систем суммаризации‚ используя как классические алгоритмы (TextRank)‚ так и трансформерные модели.

- Инструменты для проверки грамматики и орфографии: Для обеспечения высокого качества генерируемого или обрабатываемого текста мы создаем собственные модули‚ которые дополняют существующие библиотеки‚ учитывая специфику русского языка или предметной области.

- Системы автоматической категоризации и тегирования: На основе наших классификационных моделей мы разрабатываем решения‚ которые автоматически присваивают теги или категории статьям‚ новостям‚ продуктам‚ что значительно упрощает навигацию и поиск информации.

- Чат-боты и вопросно-ответные системы: Используя фреймворки вроде Rasa и трансформерные модели‚ мы строим интеллектуальные чат-боты‚ способные понимать естественный язык‚ отвечать на вопросы и вести диалог‚ а также системы‚ которые могут находить ответы в базе знаний.

- Инструменты для нормализации сленга и эмодзи: В эпоху социальных сетей нам часто приходится работать с неформальным языком. Мы разрабатываем инструменты‚ которые могут нормализовать сленг‚ обрабатывать эмодзи и учитывать их влияние на тональность или смысл текста.

Мы также не забываем о визуализации текстовых данных. Word Clouds‚ Heatmaps и другие графические представления помогают нам быстро понять основные тенденции‚ частотность слов‚ связи между темами‚ делая результаты анализа более доступными для неспециалистов.

Вызовы и Перспективы: Куда Движется NLP

Работа с текстом не лишена вызовов. Неполные и ошибочные данные‚ неоднозначность языка‚ необходимость обработки многоязычных корпусов – все это требует постоянного совершенствования наших подходов и инструментов. Мы всегда стремимся найти наиболее надежные и эффективные решения.

Однако перспективы NLP безграничны. Мы видим‚ как эта область продолжает трансформировать наш мир‚ делая взаимодействие человека с компьютером более естественным и интуитивным. От автоматического перевода узкоспециализированных текстов до анализа стилистики авторов‚ от выявления скрытых тем до генерации кода – возможности кажутся бесконечными. Мы уверены‚ что Python с его богатой экосистемой библиотек останется в авангарде этого развития‚ позволяя нам и дальше раскрывать тайны текста и создавать по-настоящему интеллектуальные системы.

Мы надеемся‚ что наше путешествие по миру NLP на Python вдохновило вас. Это захватывающая область‚ полная возможностей для творчества и инноваций. Присоединяйтесь к нам‚ и давайте вместе продолжим исследовать и формировать будущее обработки естественного языка!

На этом статья заканчивается.

Подробнее

| NLTK токенизация стемминг | spaCy NER | Gensim тематическое моделирование | Scikit-learn классификация текстов | Word Embeddings Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face NLP | Разработка векторизаторов текста | Регулярные выражения предобработка | Продвинутая лемматизация |