- Раскрываем Тайны Текста: Наше Путешествие в Мир NLP на Python

- Первые Шаги: Подготовка Текста к Анализу

- Токенизация: Разделение на Смысловые Единицы

- Стемминг и Лемматизация: Приводим Слова к Нормальной Форме

- Очистка Текста: Избавляемся от Шума

- Векторизация: От Слов к Числам

- Простые, но Эффективные: CountVectorizer и TF-IDF

- Word Embeddings: От Частот к Смыслу

- Контекстные Встраивания: Революция Трансформеров

- Понимание Текста: Извлечение Смысла

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов: Распределение по Категориям

- Продвинутые Методы и Современные Инструменты

- Трансформеры: Глубокое Понимание и Генерация

- Синтаксический Парсинг и Анализ Зависимостей

- Работа с Разнообразными Данными и Языками

- Разработка Инструментов и Систем

- Визуализация Текстовых Данных

Раскрываем Тайны Текста: Наше Путешествие в Мир NLP на Python

Привет, дорогие друзья и коллеги по страсти к данным! Сегодня мы с вами отправимся в увлекательное путешествие, которое изменило наш взгляд на мир информации, окружающий нас. Мы погрузимся в самые глубины текстовых данных, разберемся, как "научить" компьютер понимать человеческий язык, и откроем для себя мощь, которую таит в себе обработка естественного языка (NLP). Это не просто набор алгоритмов или модных терминов – это целая философия взаимодействия с одним из самых сложных и богатых источников информации: нашим с вами языком.

Мы помним те времена, когда текстовые данные казались непроходимым лесом: огромные массивы неструктурированной информации, скрывающие в себе ответы на тысячи вопросов. Как выудить из них самое ценное? Как понять настроение клиентов по их отзывам? Как автоматически классифицировать тысячи статей? Эти вопросы не давали нам покоя. И вот, спустя годы экспериментов, чтения бесчисленных статей и проб и ошибок, мы готовы поделиться нашим опытом, проверенными инструментами и глубоким пониманием того, как Python стал нашим верным проводником в этом сложном, но невероятно интересном мире.

Эта статья – не просто теоретический обзор. Это наш личный, выстраданный путь, полный открытий и инсайтов. Мы расскажем о библиотеках, которые стали нашими лучшими друзьями, о концепциях, которые казались магией, а затем превратились в мощные инструменты, и о том, как мы применяем NLP для решения реальных задач. Приготовьтесь, будет интересно и, надеемся, очень полезно!

Первые Шаги: Подготовка Текста к Анализу

Прежде чем мы сможем заставить компьютер "читать" и "понимать" текст, нам нужно его подготовить. Представьте, что вы хотите испечь пирог. Вы же не бросаете все ингредиенты сразу в печь, верно? Сначала их нужно подготовить: отмерить, смешать, измельчить. Точно так же и с текстом. Этот этап называется предобработкой, и он критически важен для успеха любого NLP-проекта. Мы всегда начинаем именно с него, ведь от качества предобработки зависит чистота и точность последующего анализа.

Наш опыт показал, что игнорирование или недостаточно тщательная предобработка – это верный путь к получению бессмысленных результатов. Компьютер, в отличие от человека, не способен интуитивно отфильтровать шум или распознать одно и то же слово в разных формах без нашей помощи. Поэтому, давайте разберем основные этапы, которые мы всегда проходим, работая с текстовыми данными.

Токенизация: Разделение на Смысловые Единицы

Первое, что мы делаем, это токенизация. По сути, это процесс разбиения текста на более мелкие, осмысленные единицы, называемые токенами. Чаще всего токенами выступают слова или знаки препинания. Например, предложение "Мы любим NLP!" можно разбить на токены ["Мы", "любим", "NLP", "!"]. Кажется просто, но на самом деле есть нюансы, особенно с сокращениями, дефисами и числами.

Для этих целей мы обычно используем два мощных инструмента: NLTK (Natural Language Toolkit) и spaCy. NLTK предлагает различные токенизаторы, например, word_tokenize для слов и sent_tokenize для предложений. SpaCy же делает это еще более элегантно и быстро, особенно когда речь идет о больших объемах данных, и умеет учитывать контекст, что очень важно.

Вот небольшой пример, чтобы вы понимали, о чем мы говорим:

import nltk

from nltk.tokenize import word_tokenize, sent_tokenize

import spacy

Пример с NLTK

text_nltk = "NLTK, это мощная библиотека. Мы используем ее для токенизации!"

tokens_nltk_words = word_tokenize(text_nltk)

tokens_nltk_sents = sent_tokenize(text_nltk)

print(f"NLTK (слова): {tokens_nltk_words}")

print(f"NLTK (предложения): {tokens_nltk_sents}")

Пример со spaCy

Нужно скачать модель: python -m spacy download en_core_web_sm

nlp = spacy.load("en_core_web_sm")

text_spacy = "SpaCy ⏤ это быстрая и эффективная библиотека. Мы обожаем её!"

doc = nlp(text_spacy)

tokens_spacy_words = [token.text for token in doc]

tokens_spacy_sents = [sent.text for sent in doc.sents]

print(f"SpaCy (слова): {tokens_spacy_words}")

print(f"SpaCy (предложения): {tokens_spacy_sents}")

Как видите, оба инструмента справляются, но spaCy интегрирует токенизацию в более широкий процесс обработки, что делает его очень удобным для последующих шагов.

Стемминг и Лемматизация: Приводим Слова к Нормальной Форме

Представьте, что слова "бежал", "бегущий", "бегать" и "бег" – это всё вариации одного и того же корня. Для компьютера же это четыре разных слова. Чтобы унифицировать их и уменьшить размер словаря, мы используем стемминг или лемматизацию. Эти техники помогают нам привести слова к их базовой форме.

Стемминг – это более грубый метод. Он просто отсекает окончания, пытаясь найти "корень" слова, но не всегда гарантирует, что полученный "стем" будет корректным словом. Например, "красота" может превратиться в "красот", что не является реальным словом. NLTK предлагает стеммеры, такие как Porter Stemmer и Snowball Stemmer, которые хорошо работают для английского языка.

Лемматизация – это более интеллектуальный процесс. Она использует морфологический анализ слова, чтобы привести его к словарной (базовой) форме, называемой леммой. Это всегда будет существующее слово. Например, "бежал" станет "бежать", "лучший" – "хороший". Мы предпочитаем лемматизацию стеммингу, когда точность критична, хотя она и требует больше вычислительных ресурсов.

SpaCy отлично справляется с лемматизацией, используя глубокие нейронные сети для определения лемм, что делает её особенно точной, в т.ч. для русского языка (при использовании соответствующих моделей). NLTK также имеет свой лемматизатор (WordNetLemmatizer), но он требует указания части речи, что усложняет его использование.

Мы часто сталкивались с тем, что для языков с богатой морфологией, таких как русский, стандартные подходы NLTK не всегда идеальны. В таких случаях Stanza (разработанная Stanford NLP Group) показывает себя очень хорошо, предлагая продвинутую лемматизацию, POS-теггинг и синтаксический анализ для многих языков, включая русский. Это наш выбор, когда нужно глубоко работать с морфологией.

Очистка Текста: Избавляемся от Шума

Сырой текст – это всегда беспорядок. Помимо слов, там могут быть HTML-теги, URL-адреса, числа, знаки препинания, специальные символы, эмодзи и т.д.. Всё это – "шум", который мешает анализу. Наша цель – максимально очистить текст, оставив только релевантную информацию.

Для очистки мы активно используем регулярные выражения (библиотека re в Python). Это невероятно мощный инструмент для поиска и замены текстовых паттернов. С их помощью мы можем удалять HTML-теги, ссылки, числа, приводить текст к нижнему регистру, удалять лишние пробелы и многое другое.

Вот типичный набор операций, которые мы применяем:

- Приведение к нижнему регистру (для унификации слов).

- Удаление HTML-тегов (если текст получен из веба, например, с помощью Beautiful Soup для веб-скрейпинга).

- Удаление URL-адресов.

- Удаление чисел и знаков препинания (или замена их на пробелы).

- Удаление стоп-слов (артикли, предлоги, союзы, которые не несут смысловой нагрузки). Мы используем списки стоп-слов из NLTK или spaCy, а иногда создаем собственные, специфичные для домена.

- Нормализация сленга и эмодзи (сложная задача, часто требующая создания специальных словарей).

Этот этап требует тщательности и часто итеративного подхода, потому что "чистый" текст для одной задачи может быть "недостаточно чистым" или "переочищенным" для другой. Важно найти золотую середину.

Векторизация: От Слов к Числам

Когда текст очищен и приведен к нормальной форме, встает следующая задача: как представить его компьютеру? Компьютеры не понимают слова; они понимают числа. Поэтому нам нужно преобразовать текстовые данные в числовые векторы – процесс, называемый векторизацией. Это сердце многих NLP-алгоритмов, ведь именно векторы являются входными данными для моделей машинного обучения.

Мы прошли долгий путь от простых методов до сложнейших нейросетевых подходов, и каждый из них имеет свои преимущества и области применения.

Простые, но Эффективные: CountVectorizer и TF-IDF

Наши первые шаги в векторизации были связаны с CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. Это классические, но до сих пор очень полезные методы:

- CountVectorizer: Просто подсчитывает, сколько раз каждое слово встречается в документе. В результате мы получаем матрицу, где строки – это документы, а столбцы – уникальные слова во всей коллекции (словаре). Значения в ячейках – это частоты слов. Это очень просто и понятно, но не учитывает важность слова.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Этот метод не только подсчитывает частоту слова в документе (TF), но и взвешивает ее обратной частотой документа (IDF), то есть насколько редко слово встречается в других документах коллекции. Таким образом, слова, которые часто встречаются в одном документе, но редко во всей коллекции, получают больший вес. Это позволяет выделить более "значимые" слова. Мы часто используем TF-IDF для задач классификации и извлечения ключевых слов.

Вот сравнение этих методов на нашем опыте:

| Метод | Преимущества | Недостатки | Типичные Задачи |

|---|---|---|---|

| CountVectorizer | Простота, скорость, легко интерпретировать | Не учитывает важность слов, высокие размерности | Базовая классификация, анализ частотности |

| TfidfVectorizer | Учитывает важность слов, выделяет ключевые термины | Потеря семантического значения, высокие размерности | Классификация, поиск релевантности, извлечение ключевых слов |

Word Embeddings: От Частот к Смыслу

Хотя TF-IDF и CountVectorizer эффективны, они не улавливают семантические отношения между словами. Слова "король" и "королева" могут иметь похожие контексты, но для этих векторизаторов они будут так же далеки друг от друга, как "король" и "банан". Здесь на помощь приходят Word Embeddings – векторные представления слов, которые кодируют их смысл и отношения с другими словами в многомерном пространстве.

Мы активно используем Word2Vec и GloVe, часто с помощью библиотеки Gensim, которая позволяет легко обучать эти модели на наших собственных корпусах или использовать предобученные. Эти модели позволяют нам увидеть, что слова, близкие по смыслу, имеют близкие векторные представления. Это открыло для нас совершенно новые возможности в задачах, где важна семантика, например, в рекомендательных системах или поиске синонимов.

FastText, также из Gensim, развивает идею Word2Vec, учитывая подслова (n-граммы символов). Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией, где новые слова могут быть образованы из известных корней. Мы обнаружили, что FastText часто дает лучшие результаты, когда данных мало или словари очень большие.

А что, если нам нужно получить вектор для целого документа или предложения, а не просто для отдельных слов? Здесь в игру вступают Doc2Vec (расширение Word2Vec) и Sentence Transformers. Doc2Vec позволяет нам обучать векторы для целых документов, улавливая их общий смысл. Sentence Transformers, основанные на архитектуре трансформеров, выдают высококачественные векторные представления предложений и даже целых параграфов, учитывая тонкий контекст.

Контекстные Встраивания: Революция Трансформеров

Но настоящая революция в векторизации произошла с появлением контекстных встраиваний, основанных на архитектуре трансформеров. Модели вроде BERT (Bidirectional Encoder Representations from Transformers) и других из экосистемы Hugging Face Transformers изменили всё. В отличие от Word2Vec или GloVe, где каждое слово имеет один фиксированный вектор, BERT генерирует вектор слова, который меняется в зависимости от его контекста в предложении. Это позволяет ему различать, например, "банк" как финансовое учреждение и "берег реки".

Мы используем Hugging Face Transformers для получения этих мощных контекстных встраиваний, которые затем подаем на вход нашим моделям машинного обучения. Это значительно улучшило качество наших решений в задачах, требующих глубокого понимания смысла, таких как распознавание именованных сущностей или вопросно-ответные системы. Конечно, эти модели требуют больше ресурсов, но результаты оправдывают затраты.

Понимание Текста: Извлечение Смысла

После того как мы подготовили текст и перевели его в числовой формат, начинается самое интересное – извлечение смысла. Именно здесь NLP показывает свою истинную мощь, позволяя нам решать задачи, которые еще недавно казались уделом фантастики. Мы научились не просто обрабатывать текст, а понимать его, анализировать и даже генерировать.

Распознавание Именованных Сущностей (NER)

Одной из наиболее востребованных задач, которую мы решаем, является Распознавание Именованных Сущностей (NER). Это процесс автоматического определения и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т.д. Представьте, как это упрощает анализ новостей, юридических документов или медицинских записей!

Для NER мы чаще всего используем spaCy. Его предобученные модели невероятно быстры и точны. Если же нам требуется более высокая точность или работа с языками, для которых нет готовых моделей, мы обращаемся к Hugging Face Transformers. Их модели, такие как BERT, могут быть тонко настроены (fine-tuning) на наших собственных размеченных данных, что позволяет достигать впечатляющих результатов даже в узкоспециализированных областях. Иногда мы также используем CRF (Conditional Random Fields) для NER, особенно когда данных для обучения трансформеров недостаточно, или требуется более легковесное решение.

Мы также сталкивались с необходимостью автоматической разметки данных для обучения NER-моделей. Это сложный процесс, но существуют инструменты и полуавтоматические подходы, которые помогают нам ускорить создание обучающих выборок. Оценка качества NER-моделей (F1-score, Precision, Recall) – это неотъемлемая часть нашей работы, чтобы убедиться в надежности наших решений.

Анализ Тональности (Sentiment Analysis)

Понимание эмоций и мнений, выраженных в тексте, – это бесценно для бизнеса, политики и даже для личного использования. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв положительным, отрицательным или нейтральным. Мы активно применяем его для анализа отзывов клиентов, сообщений в социальных сетях (Twitter, Reddit), а также для анализа тональности финансовых новостей, где каждое слово может иметь огромное значение.

Для простых задач мы начинаем с VADER (Valence Aware Dictionary and sEntiment Reasoner) – это правиловой, лексический подход, который отлично работает "из коробки" для английского языка, учитывая даже степень интенсивности эмоций и сарказм. Для более сложных случаев, особенно для русского языка или специфических доменов, мы обучаем собственные модели классификации на основе текстовых векторов (TF-IDF, Word Embeddings) с использованием Scikit-learn или даже нейронных сетей на PyTorch/TensorFlow.

TextBlob также предлагает простой API для анализа тональности, но мы заметили, что его ограничения становятся очевидными при работе со сложными или специфическими текстами, где требуется более глубокое понимание контекста. Работа с эмодзи и сленгом в современных текстах – это отдельная большая задача, требующая постоянного обновления наших словарей и моделей.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут." – Рита Мэй Браун

Тематическое Моделирование (Topic Modeling)

Иногда нам нужно понять, о каких основных темах идет речь в большой коллекции документов, не имея заранее размеченных данных. Здесь на помощь приходит Тематическое Моделирование – это метод машинного обучения без учителя, который автоматически выявляет "скрытые" темы в текстовых данных. Это как найти главные разделы в огромной библиотеке, не читая каждую книгу целиком.

Мы регулярно используем библиотеку Gensim для реализации LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA – это один из самых популярных алгоритмов, который предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это смесь слов. LSI, в свою очередь, использует сингулярное разложение (SVD) для выявления скрытых семантических структур.

Мы также сравнивали LDA с NMF (Non-negative Matrix Factorization). NMF часто дает более интерпретируемые темы, особенно когда мы работаем с разреженными матрицами, такими как TF-IDF. Выбор метода зависит от характеристик данных и конкретной задачи, но Gensim предоставляет удобный интерфейс для экспериментов с обоими.

Тематическое моделирование стало для нас незаменимым инструментом для анализа текстов отзывов, новостных статей, блогов и форумов, помогая быстро выявить основные обсуждаемые вопросы и тренды.

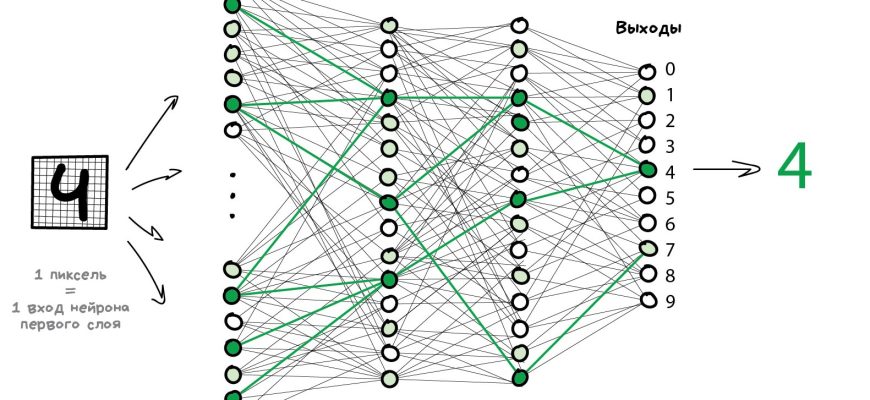

Классификация Текстов: Распределение по Категориям

Одна из самых распространенных задач в NLP – это классификация текстов, то есть автоматическое присвоение тексту одной или нескольких категорий. Будь то спам-фильтрация, категоризация новостей, отзывов о продуктах или юридических документов, классификация экономит огромное количество времени и ресурсов.

Мы используем Scikit-learn как нашу основную "рабочую лошадку" для классификации. В нашем арсенале: SVM (Support Vector Machines), Наивный Байесовский классификатор, логистическая регрессия. Эти модели, в сочетании с TF-IDF или Word Embeddings, дают отличные результаты для большинства задач. Для более сложных сценариев, где требуеться учитывать тонкие зависимости и контекст, мы обращаемся к PyTorch/TensorFlow для создания нейросетевых моделей, таких как LSTM-сети или сверточные нейронные сети (CNN).

И, конечно, с появлением трансформеров, BERT стал нашим выбором для задач классификации, требующих максимальной точности. Мы часто используем предобученные модели BERT из Hugging Face и тонко настраиваем их на наших специфических данных. Это дает нам значительное преимущество, особенно когда объем размеченных данных ограничен.

Продвинутые Методы и Современные Инструменты

Мир NLP развивается с невероятной скоростью. То, что еще вчера казалось прорывным, сегодня становится стандартом, а завтра уже может быть дополнено или заменено чем-то новым. Мы постоянно следим за этими изменениями, интегрируя передовые методы в нашу работу.

Трансформеры: Глубокое Понимание и Генерация

Как мы уже упоминали, трансформеры, особенно в рамках библиотеки Hugging Face, изменили правила игры. Они позволяют нам не только глубоко понимать текст, но и генерировать его. Мы используем их для:

- Машинного перевода: Создание систем, способных переводить текст между языками с удивительной точностью. Для узкоспециализированных текстов мы можем тонко настраивать модели на наших двуязычных корпусах.

- Суммаризации текста: Автоматическое создание кратких изложений длинных документов. Мы различаем экстрактивную суммаризацию (извлечение наиболее важных предложений из исходного текста, здесь отлично работает TextRank) и абстрактивную суммаризацию (генерация нового, связного текста, передающего суть оригинала, что является сложной задачей для трансформеров).

- Генерации текста: От написания статей и ответов на вопросы (вопросно-ответные системы, QA) до генерации кода и диалогов для чат-ботов. Модели GPT стали для нас мощным инструментом для креативных и автоматизированных задач.

- Тонкой настройки (Fine-tuning) предобученных моделей: Мы берем огромные, уже обученные модели и дообучаем их на небольших, специфичных для нашей задачи наборах данных. Это позволяет достичь высокой точности, не требуя огромных вычислительных ресурсов для обучения с нуля.

Работа с трансформерами – это захватывающий опыт, который постоянно открывает новые горизонты в NLP. Однако мы всегда помним о вычислительной сложности и необходимости тщательного выбора модели для конкретной задачи.

Синтаксический Парсинг и Анализ Зависимостей

Иногда нам недостаточно просто знать слова и их леммы. Нам нужно понять структуру предложения, как слова связаны друг с другом. Для этого мы используем синтаксический парсинг и анализ зависимостей.

SpaCy предоставляет отличные инструменты для этих задач. Он позволяет нам построить дерево зависимостей, которое показывает, какое слово зависит от какого и как они связаны грамматически. Это очень полезно для извлечения информации, построения вопросно-ответных систем и анализа стилистики текстов (например, для определения авторского почерка).

import spacy

nlp_ru = spacy.load("ru_core_news_sm") # Или другая модель для русского

text = "Мы используем SpaCy для анализа зависимостей в предложениях."

doc = nlp_ru(text)

for token in doc:

print(f"{token.text:10} {token.lemma_:10} {token.pos_:10} {token.dep_:10} {token.head.text:10}")

Этот простой пример показывает, как каждое слово связано с "головой" – словом, от которого оно зависит. Это открывает путь к более глубокому пониманию структуры языка.

Работа с Разнообразными Данными и Языками

Наш опыт не ограничивается только английским или русским языками. Мы часто сталкиваемся с необходимостью обработки многоязычных текстовых корпусов. Здесь нам помогают библиотеки, такие как Polyglot и Stanza, которые поддерживают широкий спектр языков и предоставляют инструменты для токенизации, лемматизации, POS-теггинга и NER для них.

Мы также научились извлекать текст из различных форматов источников: Beautiful Soup для веб-скрейпинга и извлечения текста из HTML, PyMuPDF для эффективного извлечения текста из PDF-документов. Это позволяет нам работать с огромными объемами неструктурированных данных из самых разных источников.

Нельзя забывать и об анализе метаданных текста, что часто дает дополнительную ценную информацию, не содержащуюся непосредственно в самом тексте.

Разработка Инструментов и Систем

Наше путешествие в NLP – это не только использование готовых библиотек, но и разработка собственных инструментов и систем. Вот некоторые из них, которые мы создавали:

- Системы вопросно-ответных систем (QA): От простых на основе правил до сложных, использующих трансформеры для поиска ответов в больших корпусах документов.

- Чат-боты на Python: Мы работали с фреймворком Rasa для создания интеллектуальных разговорных агентов.

- Системы обнаружения плагиата: Использование методов сравнения строк (например, с библиотекой Jellyfish) и векторизации документов для выявления схожести текстов.

- Инструменты для проверки грамматики и орфографии: Разработка собственных решений или интеграция существующих API.

- Системы автоматической категоризации и тегирования контента: Помогают организовывать большие объемы информации.

- Инструменты для извлечения ключевых фраз: Помимо TF-IDF, мы используем RAKE (Rapid Automatic Keyword Extraction) и TextRank, которые показывают себя очень хорошо.

- Анализ частотности слов и n-грамм: Простой, но часто очень информативный метод для понимания структуры текста и выявления распространенных паттернов.

Каждый из этих проектов – это отдельная история, полная вызовов и триумфов, где мы применяем весь накопленный опыт в NLP.

Визуализация Текстовых Данных

Визуализация – это ключ к пониманию сложных данных. В NLP мы часто используем облака слов (Word Clouds) для быстрого выявления наиболее частых терминов. Для анализа связей между словами или темами мы можем строить графы или использовать тепловые карты (Heatmaps) для отображения матриц схожести. Библиотеки вроде Matplotlib и Seaborn в сочетании с Sweetviz для более глубокого анализа данных помогают нам представить результаты нашего анализа в наглядной и понятной форме.

Наше путешествие в мир обработки естественного языка на Python было долгим и поучительным. Мы начали с базовой предобработки, научились превращать слова в числа, а затем – извлекать смысл, классифицировать, суммировать и даже генерировать текст. Мы освоили мощные библиотеки, такие как NLTK, spaCy, Gensim, Scikit-learn и, конечно, революционные Hugging Face Transformers. Каждый инструмент, каждая концепция открывали для нас новые возможности и позволяли решать все более сложные задачи.

Мы видим, что NLP – это не просто набор технологий; это область, которая постоянно развивается, предлагая новые горизонты для исследований и применений. От анализа тональности финансовых новостей до разработки систем обнаружения плагиата, от обработки многоязычных корпусов до создания интеллектуальных чат-ботов – возможности практически безграничны. Мы верим, что глубокое понимание человеческого языка с помощью машин – это один из ключей к решению самых сложных проблем нашего времени.

Мы надеемся, что наш опыт и знания, которыми мы поделились в этой статье, вдохновят вас на собственные эксперименты и открытия в этом захватывающем мире. Присоединяйтесь к нам, и давайте вместе продолжим раскрывать тайны текста, ведь в каждом слове, в каждом предложении скрыта целая вселенная информации, ждущая своего исследователя. Удачи в ваших NLP-проектах!

На этом статья заканчивается.

Подробнее

| NLTK токенизация | spaCy NER | Gensim LDA | Scikit-learn классификация текста | Word2Vec GloVe |

| Анализ тональности Python | Трансформеры Hugging Face | Векторизация текста TF-IDF | Лемматизация стемминг | Разработка чат-ботов Python |